一句话造世界!开发者用10天婚假爆肝,让AI小镇真正「活」了过来

一句话造世界!开发者用10天婚假爆肝,让AI小镇真正「活」了过来2023年斯坦福「AI小镇」火了,后续也诞生了大量类似的热门项目,但所有这类项目都有一个共同瓶颈——世界是人工搭建的,固定的。最近,一位独立开发者用10天婚假爆肝了一个项目WorldX:输入一句话、5分钟,一个完整的AI世界就诞生了——地图、角色、动画、人设全部自动生成,AI角色们自主在其中生活、对话、形成记忆、产生戏剧性的涌现行为。

搜索

搜索

2023年斯坦福「AI小镇」火了,后续也诞生了大量类似的热门项目,但所有这类项目都有一个共同瓶颈——世界是人工搭建的,固定的。最近,一位独立开发者用10天婚假爆肝了一个项目WorldX:输入一句话、5分钟,一个完整的AI世界就诞生了——地图、角色、动画、人设全部自动生成,AI角色们自主在其中生活、对话、形成记忆、产生戏剧性的涌现行为。

8人团队干10个月,AI只需一夜!英伟达祭出「造芯」神技:芯片设计效率狂飙百倍,非人类直觉的设计方案惊呆工程师。硅基生命开始自进化,人类正退居二线?进来看黄仁勋的秘密武器。

我发现:Claude 一边把中国大陆挡在门外,一边在认认真真做简体中文。事情是这样—— 前两天我把 Claude 文档 URL 里的 /en/ 改成了 /zh-CN/。页面唰地就变了。整站简体中文,翻译贼讲究。

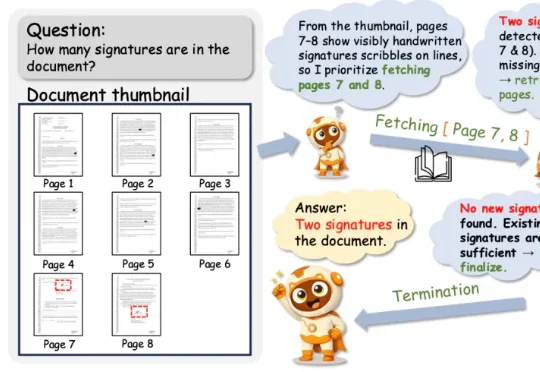

Doc-V* 由小米大模型 Plus 团队和华中科技大学 VLRLab 团队合作提出,一种从「静态阅读」到「主动探索」的多页文档理解新范式,通过交互式视觉推理让模型像人一样有策略地阅读长文档。

世界模型黑马横空出世!就在刚刚,生数科技的MotuBrain零宣发登顶双榜,直接打通「看懂世界+执行行动」,而且不同的是,他们把World Action Model适配多个头部机器人本体,完成多个长程任务,这是国产AI的硬核突围!从此,具身智能彻底迈入新纪元。

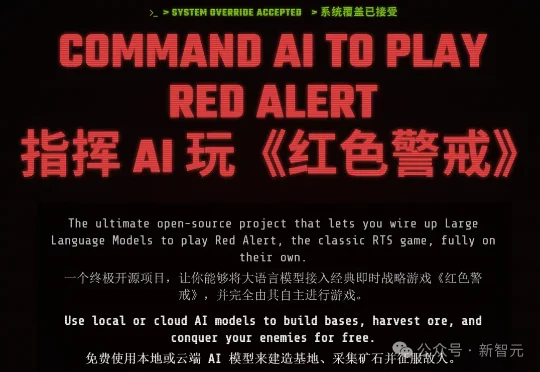

红警不再只是童年游戏,而成了AI Agent的硬核训练场:OpenRA-RL把25Hz实时战场、50个工具调用和64局并发打包开源,让大模型第一次真正站上RTS战争迷雾里的公开考场。

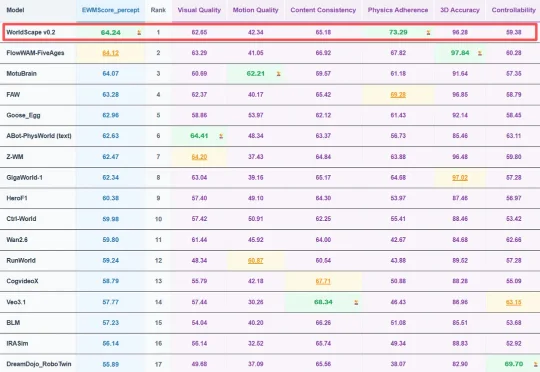

近日,全球具身世界模型权威基准评测 WorldArena 正式更新最新榜单。Manifold AI 流形空间研发的世界模型 WorldScape 0.2,凭借其在物理规律遵循与多源交互理解上的突破取得 WorldArena 榜单全球第一,充分展现了国产世界模型在复杂动态场景生成与具身控制中的高精度、强泛化与物理可信度。与其同场竞技的包括英伟达、谷歌等国外巨头和星动纪元、极佳视界等国内具身智能公司。

Harness(驯马)会成为这个(AI)时代最关键的能力之一。这是小马智行CTO楼天城,在与量子位的对话中,给出的最新判断。在他看来,如今的AI越来越像一匹脱缰野马。它开始学会了「调用」:调用工具、调用skills……因此能通过这些脚手架,自我演进,和人类打配合。

而我们之所以注意到这种玩法,是因为最近一则醒目的消息:3D 打印界扛把子拓竹的模型平台 MakerWorld 迎来了一位新盟友 —— 胡渊鸣创立的 Meshy AI。提起胡渊鸣,机器之心的读者应该都不陌生。2019 年,我们就开始报道他的计算机图形库「太極」。2020 年,他因用 99 行代码复刻《冰雪奇缘》积雪物理特效被大众所熟知,登顶社交媒体热搜。如今,多年过去,他已经在新的赛道领跑。

允中 发自 凹非寺 量子位 | 公众号 QbitAI 这两天,大家伙朋友圈是不是被GPT-Image-2刷屏了? 文字渲染精准、高密度的信息图,复杂布局和美学UI一次到位,真实感爆棚。 连社交媒体截图