首个文本到3D生成RL范式诞生,攻克几何与物理合理性

首个文本到3D生成RL范式诞生,攻克几何与物理合理性在大语言模型和文生图领域,强化学习(RL)已成为提升模型思维链与生成质量的关键方法。

搜索

搜索

在大语言模型和文生图领域,强化学习(RL)已成为提升模型思维链与生成质量的关键方法。

你的生成模型真的「懂几何」吗?还是只是在假装对齐相机轨迹?

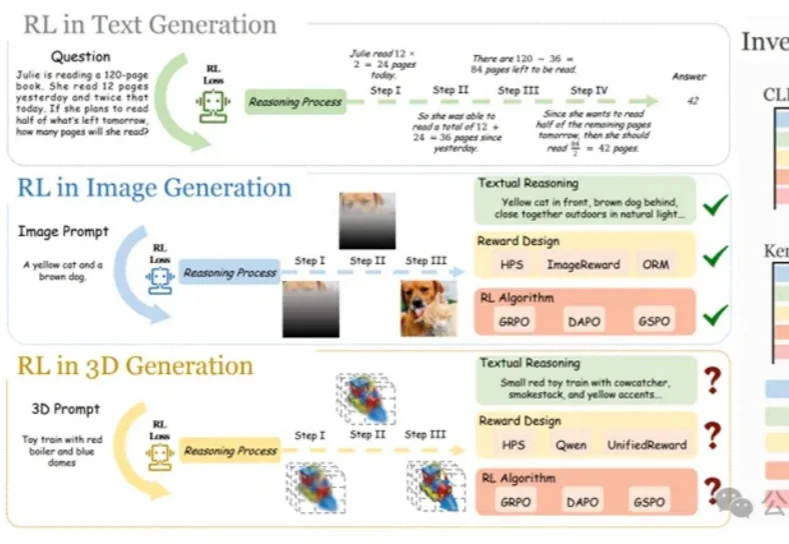

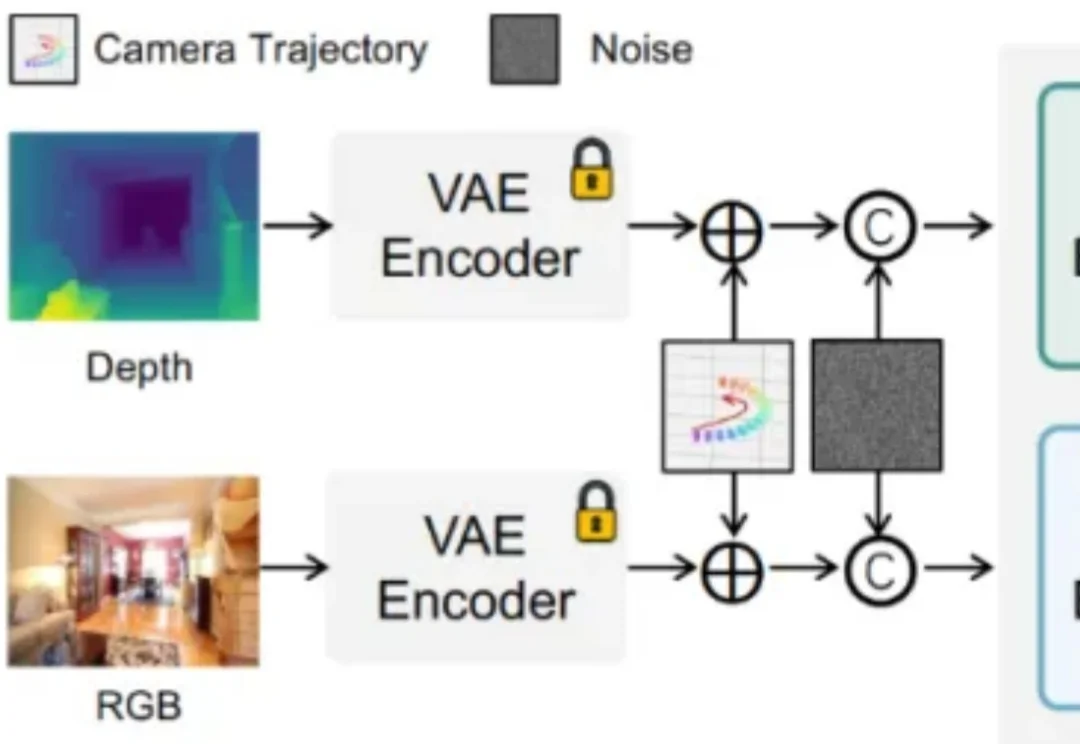

现有视频生成模型往往难以兼顾「运镜」与「摄影美学」的精确控制。为此,华中科技大学、南洋理工大学、商汤科技和上海人工智能实验室团队推出了 CineCtrl。作为首个统一的视频摄影控制 V2V 框架,CineCtrl 通过解耦交叉注意力机制,摆脱了多控制信号共同控制的效果耦合问题,实现了对视频相机外参轨迹与摄影效果的独立、精细、协调控制。

可支持24帧/秒的长时流式生成。

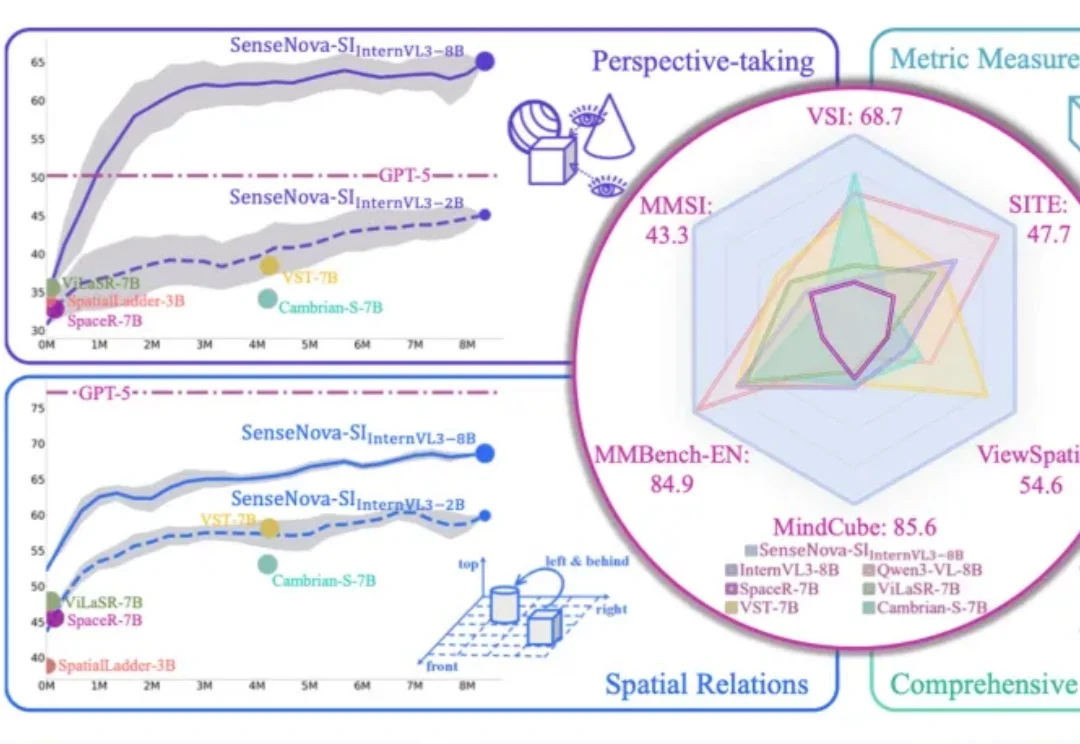

李飞飞团队最新的空间智能模型Cambrian-S,首次被一个国产开源AI超越了。

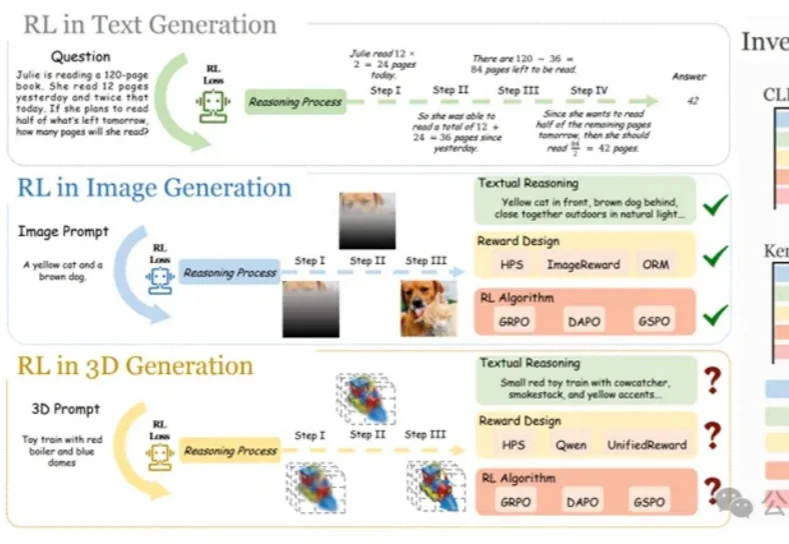

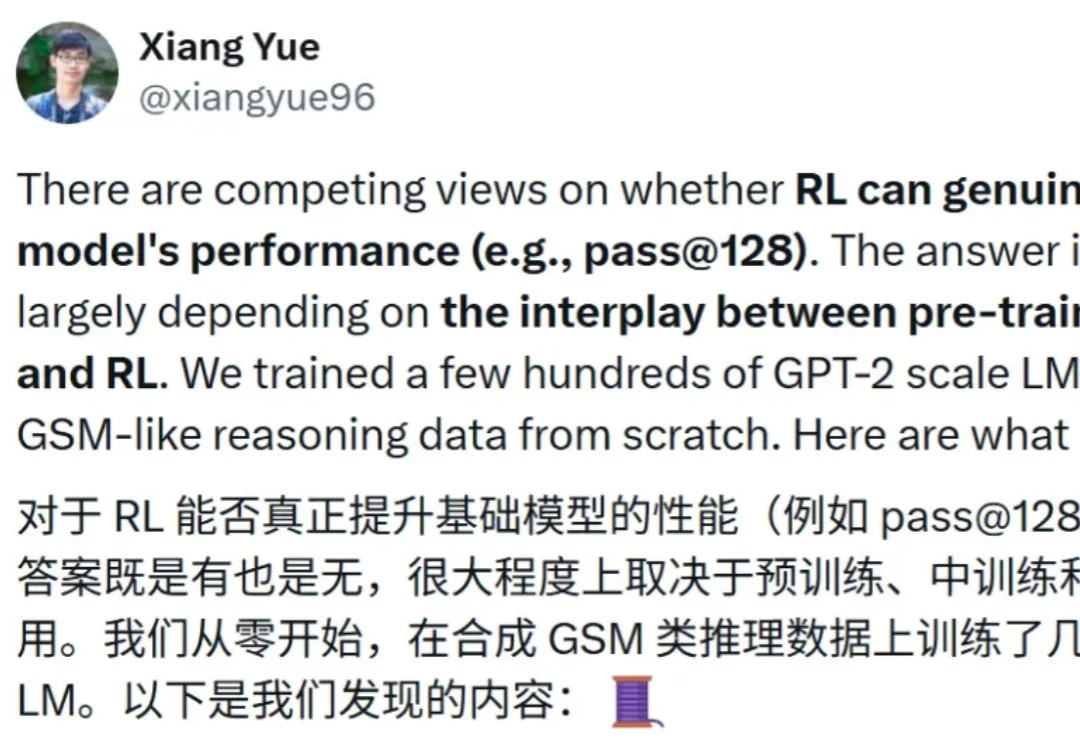

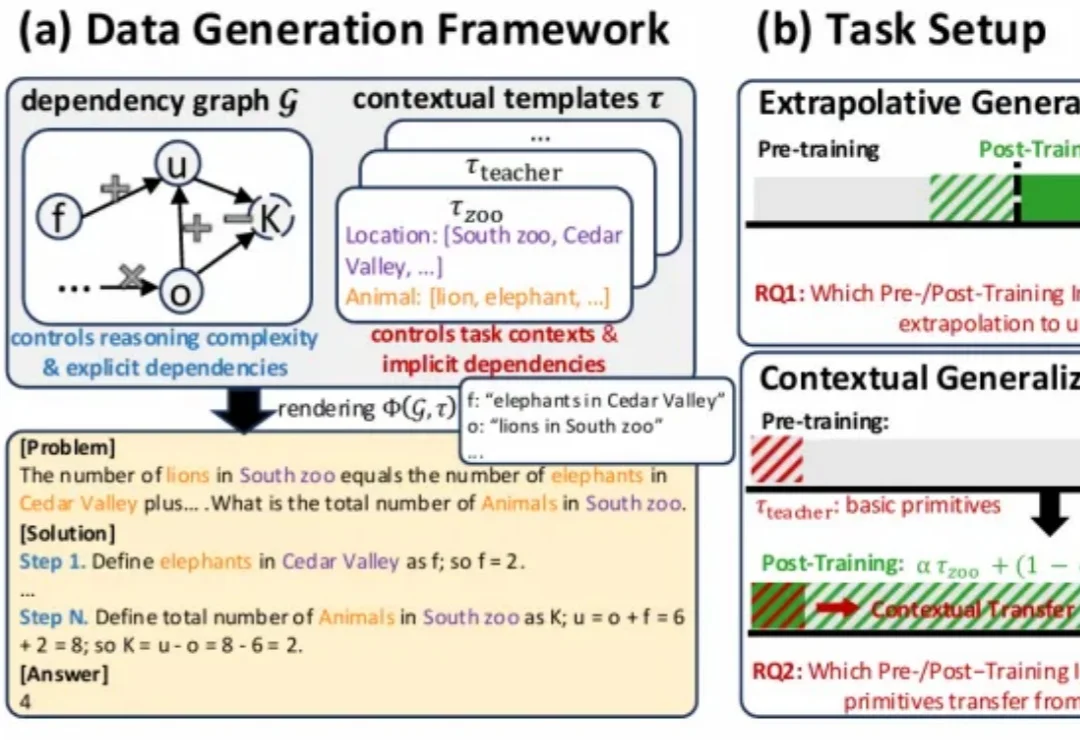

近期,强化学习(RL)技术在提升语言模型的推理能力方面取得了显著成效。

近期,强化学习(RL)技术在提升语言模型的推理能力方面取得了显著成效。

在 Physical Intelligence 最新的成果 π0.6 论文里,他们介绍了 π0.6 迭代式强化学习的思路来源:

世界模型赛道,又有老面孔新鲜入局! 就在刚刚,Runway发布旗下首个通用世界模型GWM-1。 不止于此,还打包发布了一系列世界模型变体:模拟真实环境的GWM Worlds;

昨天,苹果一篇新论文在 arXiv 上公开然后又匆匆撤稿。原因不明。论文中,苹果揭示了他们开发的一个基于 TPU 的可扩展 RL 框架 RLAX。是的,你没有看错,不是 GPU,也不是苹果自家的 M 系列芯片,而是谷歌的 TPU!还不止如此,这篇论文的研究中还用到了亚马逊的云和中国的 Qwen 模型。