英伟达一夜回血!马斯克狂烧30亿GPU给老黄续命,10倍算力创Scaling Law神话

英伟达一夜回血!马斯克狂烧30亿GPU给老黄续命,10倍算力创Scaling Law神话一度狂跌的英伟达股价,又被Grok-3盘活了?20万块GPU训出的模型超越DeepSeek和OpenAI,证明Scaling Law还在继续增长!Ai2研究者大佬直言:Grok-3,就是DeepSeek给美国AI企业压力的又一力证。

搜索

搜索

一度狂跌的英伟达股价,又被Grok-3盘活了?20万块GPU训出的模型超越DeepSeek和OpenAI,证明Scaling Law还在继续增长!Ai2研究者大佬直言:Grok-3,就是DeepSeek给美国AI企业压力的又一力证。

强化学习训练数据越多,模型推理能力就越强?新研究提出LIM方法,揭示提升推理能力的关键在于优化数据质量,而不是数据规模。该方法在小模型上优势尽显。从此,强化学习Scaling Law可能要被改写了!

英伟达巧妙地将DeepSeek-R1与推理时扩展相结合,构建了全新工作流程,自动优化生成GPU内核,取得了令人瞩目的成果。

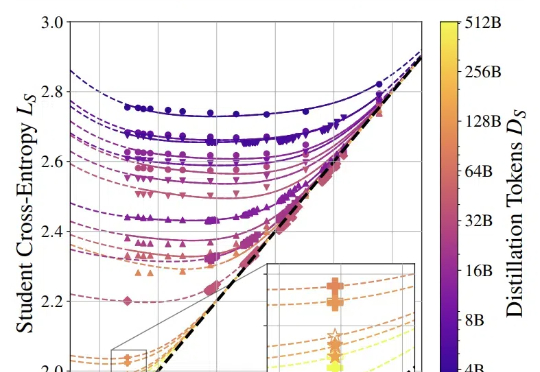

蒸馏模型的性能可以量化估算了。

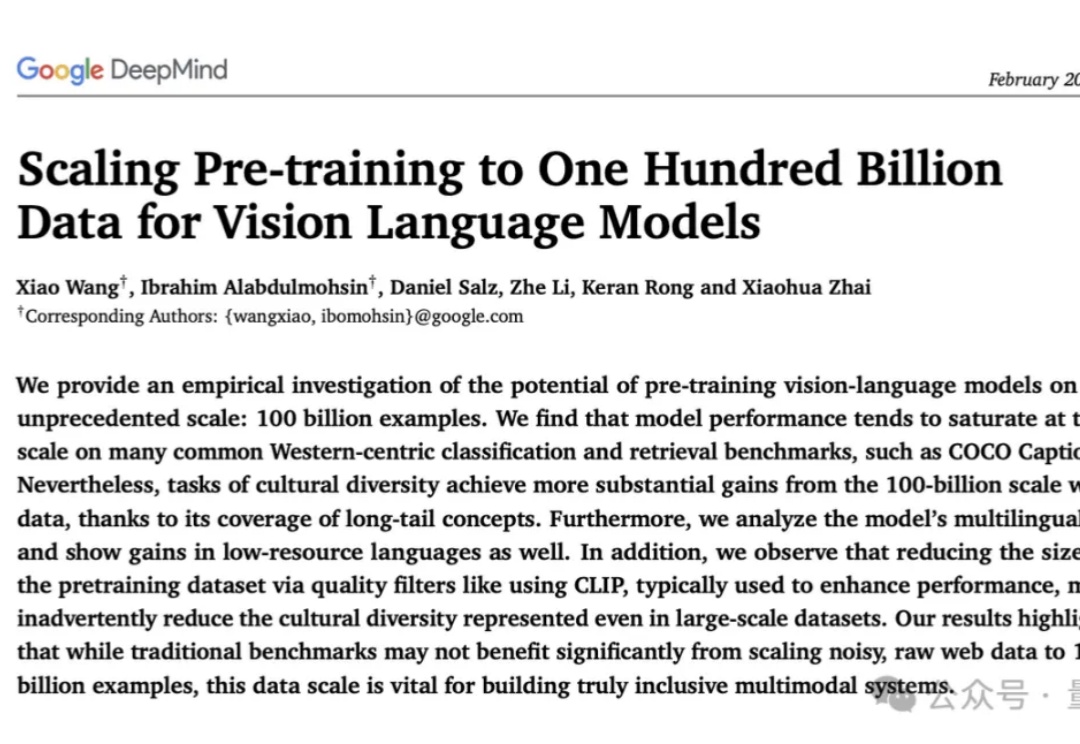

史上最大规模视觉语言数据集:1000亿图像-文本对!

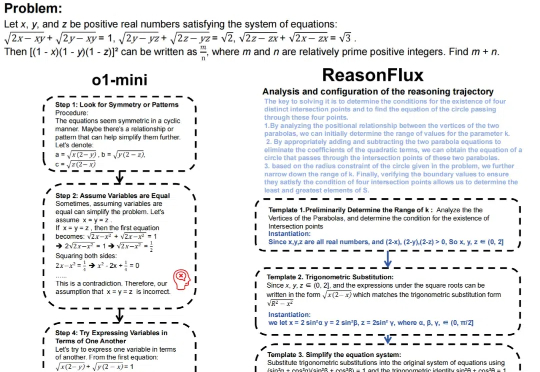

【新智元导读】仅凭测试时Scaling,1B模型竟完胜405B!多机构联手巧妙应用计算最优TTS策略,不仅0.5B模型在数学任务上碾压GPT-4o,7B模型更是力压o1、DeepSeek R1这样的顶尖选手。

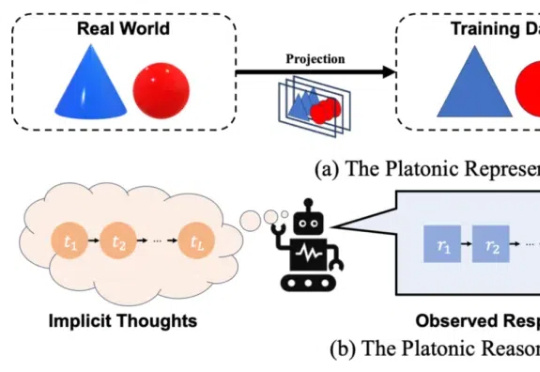

推理大语言模型(LLM),如 OpenAI 的 o1 系列、Google 的 Gemini、DeepSeek 和 Qwen-QwQ 等,通过模拟人类推理过程,在多个专业领域已超越人类专家,并通过延长推理时间提高准确性。推理模型的核心技术包括强化学习(Reinforcement Learning)和推理规模(Inference scaling)。

刚刚,OpenAI奥特曼的最新AI观察出炉:Scaling Law将保持不变,短时间内没有理由停止对AI进行指数增长级的投资!1、AI能力与投入资源呈对数关系 2、AI使用成本每年降低约10倍 3、AI带来的社会经济价值呈超级指数增长

「慢思考」(Slow-Thinking),也被称为测试时扩展(Test-Time Scaling),成为提升 LLM 推理能力的新方向。近年来,OpenAI 的 o1 [4]、DeepSeek 的 R1 [5] 以及 Qwen 的 QwQ [6] 等顶尖推理大模型的发布,进一步印证了推理过程的扩展是优化 LLM 逻辑能力的有效路径。

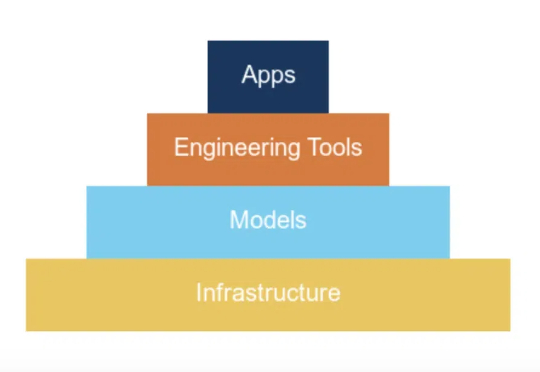

Ilya Sutskever 在 NeurIPS 会上直言:大模型预训练这条路可能已经走到头了。上周的 CES 2025,黄仁勋有提到,在英伟达看来,Scaling Laws 仍在继续,所有新 RTX 显卡都在遵循三个新的扩展维度:预训练、后训练和测试时间(推理),提供了更佳的实时视觉效果。