ChatGPT数学进阶之路!OpenAI研究员自爆:ChatGPT从数不清数到给出埃尔德什问题全新解法;数学是衡量模型进步的重要基准;AI自动化研究员

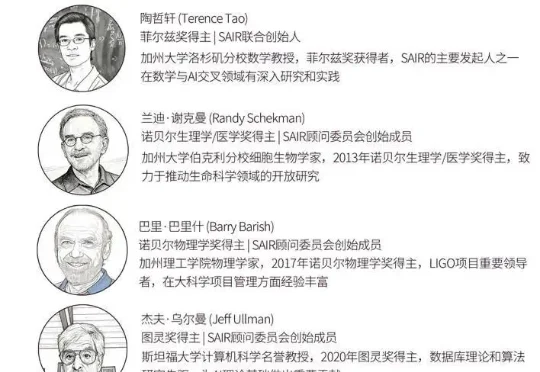

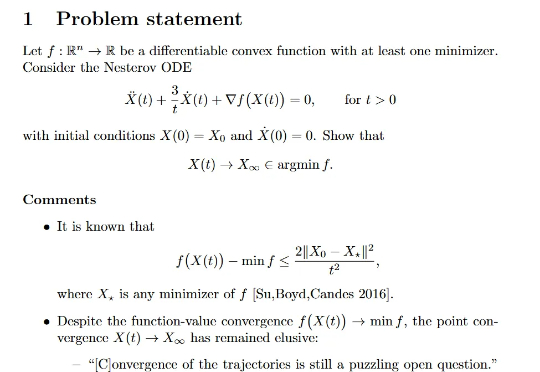

ChatGPT数学进阶之路!OpenAI研究员自爆:ChatGPT从数不清数到给出埃尔德什问题全新解法;数学是衡量模型进步的重要基准;AI自动化研究员今天,OpenAI 官方播客发布了一期节目,让内部研究员 Sebastian Bubeck 和 Ernest Ryu 出来回答这一问题,毕竟大家都十分好奇。Ernest 近期刚加入 OpenAI 担任研究员,他之前是加州大学洛杉矶分校(UCLA)数学系的教授,研究优化和机器学习理论。他是最早尝试用 ChatGPT 解数学开放问题的那批人之一。