ICML 2026|表格异常检测能否告别「one-for-one」?OFA-TAD迈向one-for-all通用异常检测新范式

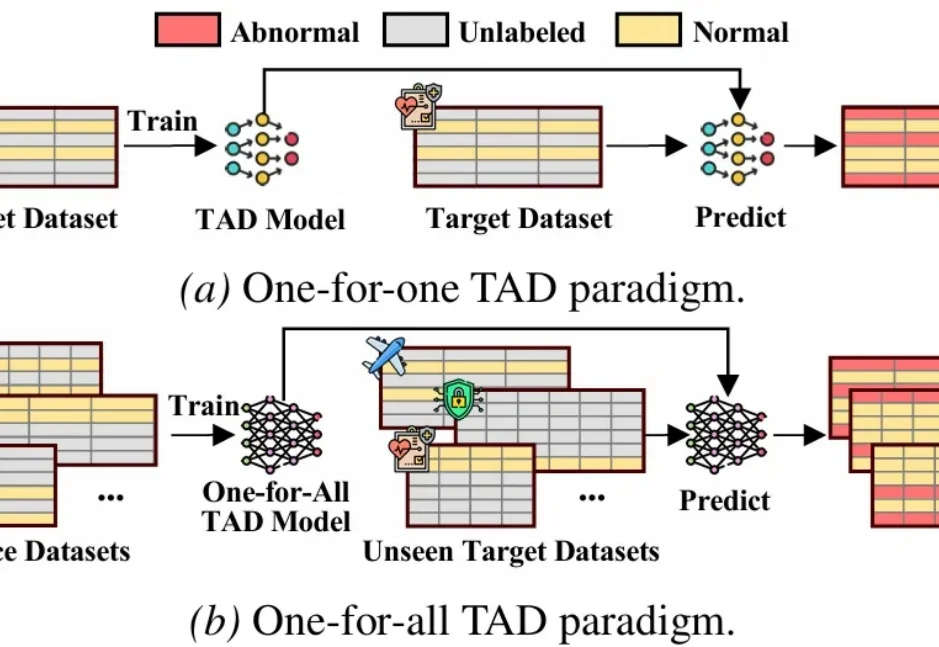

ICML 2026|表格异常检测能否告别「one-for-one」?OFA-TAD迈向one-for-all通用异常检测新范式表格异常检测(Tabular Anomaly Detection,TAD)旨在从结构化数据中精准识别显著偏离正常分布的稀有样本,其在医疗诊断、金融风控及网络安全等关键领域的数据挖掘与安全保障任务中发挥着核心作用。

搜索

搜索

表格异常检测(Tabular Anomaly Detection,TAD)旨在从结构化数据中精准识别显著偏离正常分布的稀有样本,其在医疗诊断、金融风控及网络安全等关键领域的数据挖掘与安全保障任务中发挥着核心作用。

5 月 19 日,OpenAI 联合创始人、「Vibe Coding」之父 Andrej Karpathy 宣布加入 Anthropic 预训练团队。他将组建新团队,用 Claude 加速预训练研究。一个做过Hinton和李飞飞学生、奥特曼同事、马斯克直属下属的人,为什么甘愿做 Dario Amodei 的「-2」?Anthropic 又为什么非要招他?

GPU 烧算力,电网烧钱,最后是普通消费者买单。

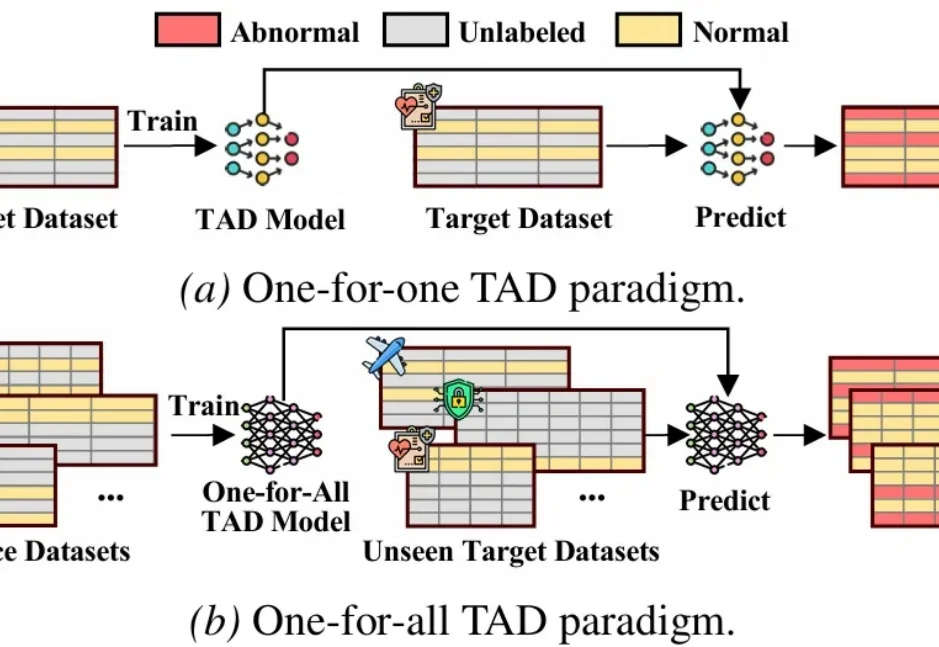

xbench,就是红杉自己弄的那个中立评测lab,刚刚又整了个新活:让 AI 做药企的数据分析,跟人类实习生比个高低,然后遥遥领先的赢了

扩散模型杀进了文本生成的地盘,而巨头们为了抢它,已经打起来了。

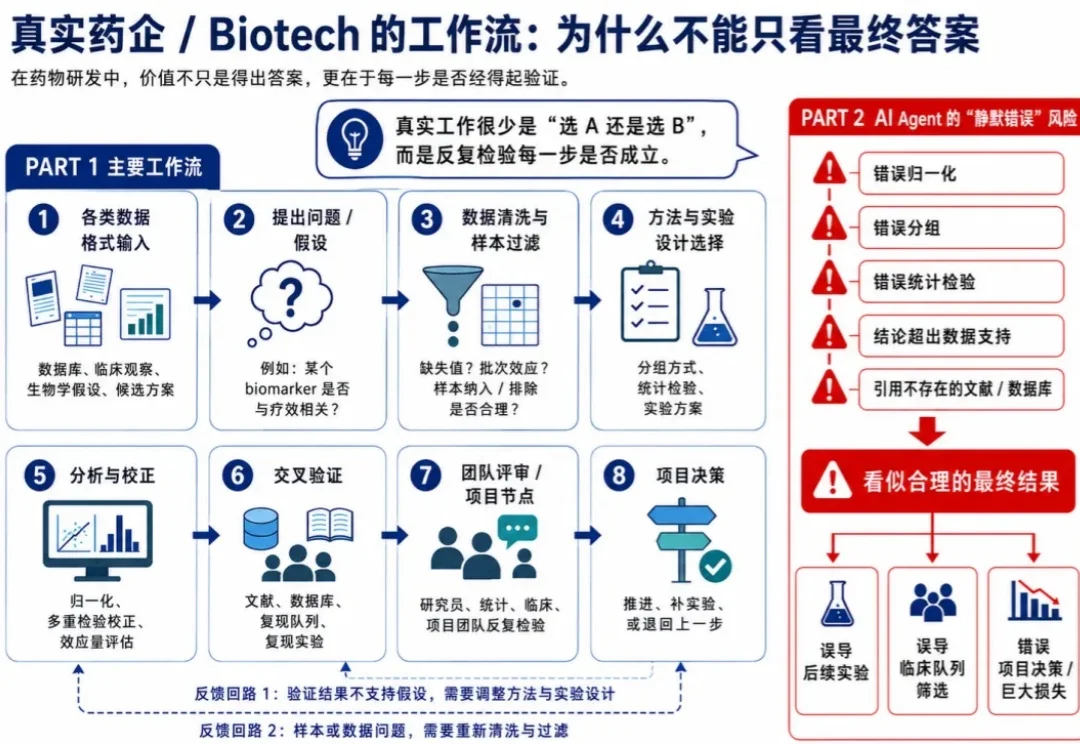

序列建模是大语言模型、计算机视觉等领域的基础共性问题。当前通用的 Transformer 模型计算复杂度随序列长度平方增长,在长序列任务中面临显著的计算挑战。因此,研究者们一直在探索具有线性计算复杂度的高效序列建模方法。

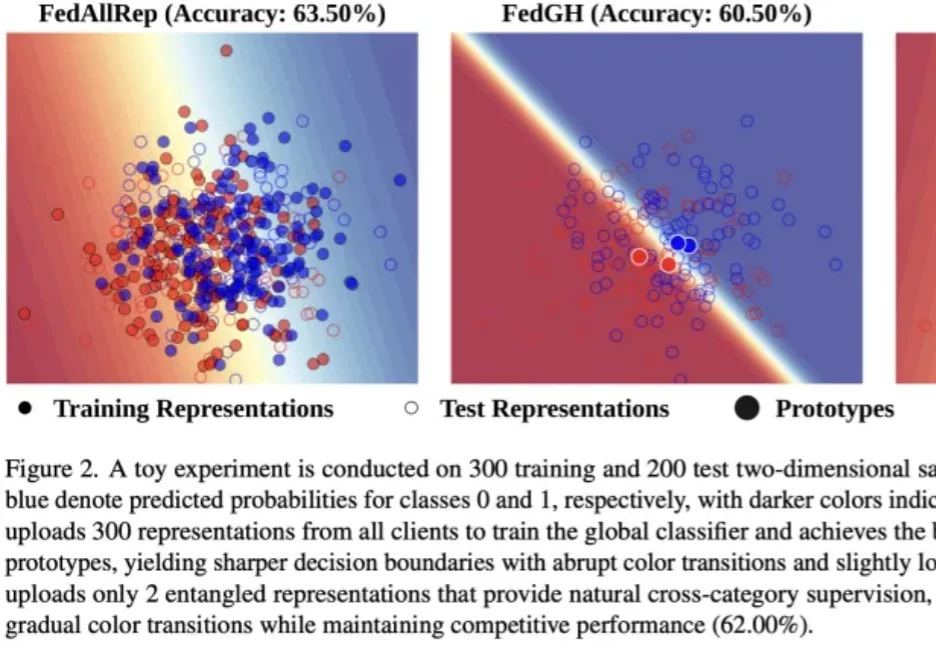

在联邦学习中,如何同时兼顾模型性能、数据隐私和通信开销,是一个亟需解决的挑战。

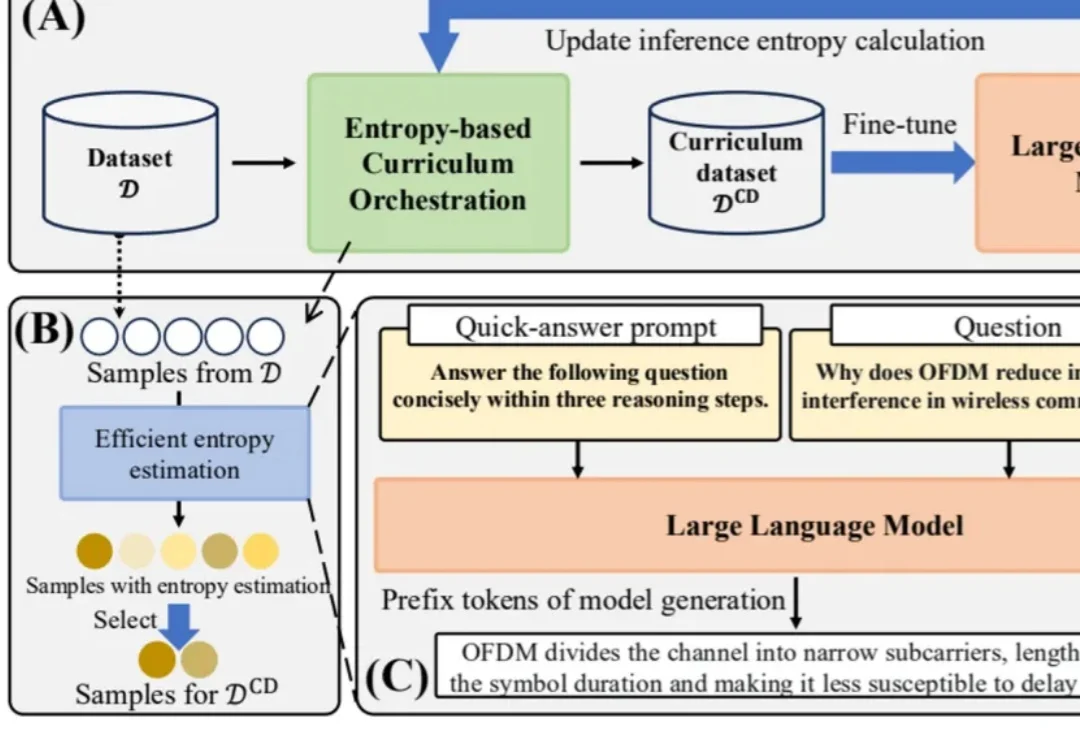

在大模型后训练中,数据不再只是 “越多越好”,而是要像人类学习一样,动态选择最合适难度的样本。华为提出的 EDCO 方法,将样本难度估计与动态课程编排引入领域大模型微调;数月后,由 Rutgers、Amazon、Google 等作者参与的 DARE 论文即引用 EDCO,并将其作为难度感知强化学习训练的重要对比基线。

近日,垂直于招投标领域的 AI 科技领军企业“深入云境”正式宣布:旗下核心产品 “云境标书AI” 成功入选 NVIDIA 初创加速计划(NVIDIA Inception)。这一里程碑式的进展,标志着云境标书AI在技术创新性、行业应用前景及商业潜力方面获得了全球顶级算力与AI生态巨头的权威认可。

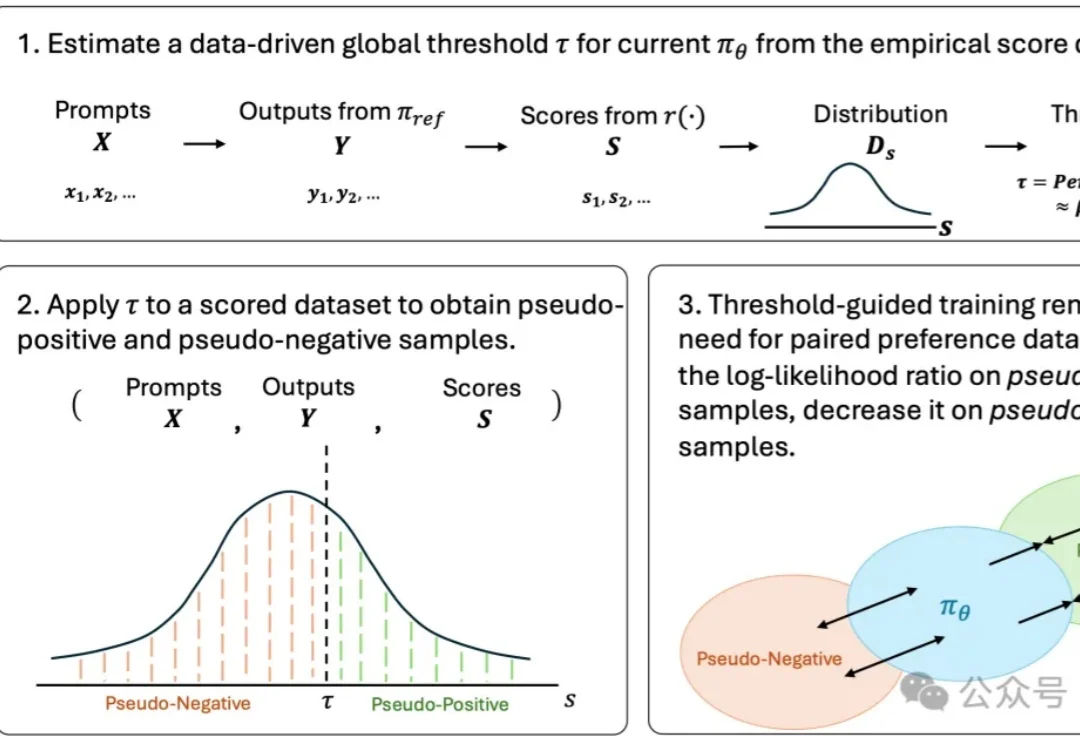

生成模型的偏好对齐,可能正在进入一个新的阶段。