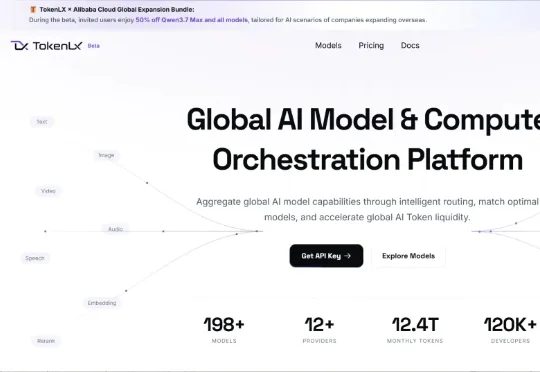

发现了个宝藏 AI 算力平台TokenLX ,内置 190+ 模型!

发现了个宝藏 AI 算力平台TokenLX ,内置 190+ 模型!最近和几个做 AI 出海的朋友聊天,大家已经很少去聊哪个模型又刷了榜。谈论最多的,是哪个模型调度平台好用、实惠、安全。 这话题我是一点都不意外。毕竟前不久全球大佬都在扎堆往 AI 这个方向挤。老话说得

搜索

搜索

最近和几个做 AI 出海的朋友聊天,大家已经很少去聊哪个模型又刷了榜。谈论最多的,是哪个模型调度平台好用、实惠、安全。 这话题我是一点都不意外。毕竟前不久全球大佬都在扎堆往 AI 这个方向挤。老话说得

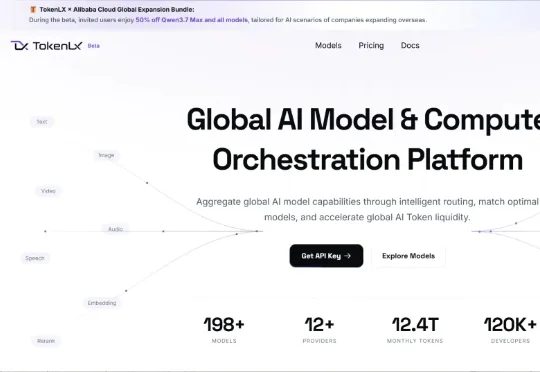

根据外媒 Axios 的最新报道,一位 AI 顾问告诉 Axios,他有个客户最近一个月在 Claude 上花了 5 亿美元。不是 500 万,不是 5000 万,是 500000000 美元,折合人民币三十三亿。

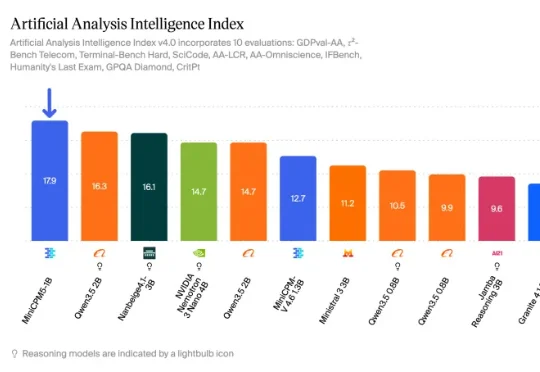

我去搜了下 MiniCPM5-1B 的数据,发现面壁智能刚刚把背后的核心数据集给开源了。一共是两份 L3 级数据集:Ultra-FineWeb-L3 :600B tokens,中英文都有,是目前最大的中文开源合成预训练数据集。

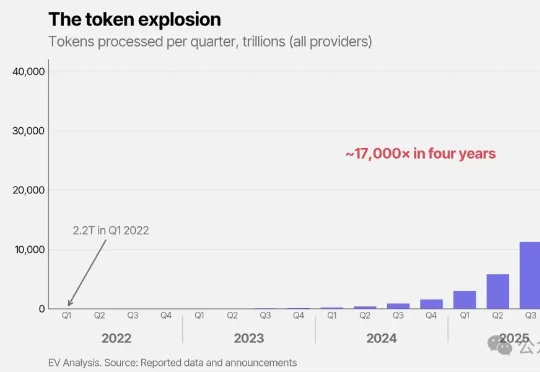

Omdia这份名为《2026全球AI工厂市场格局》的报告,点明了新时代的核心逻辑——决定胜负的,不再是谁拥有更多GPU,而是谁能够更高效地把“电力+算力+数据”转化为真正有价值的Token。

当Token开始进入套餐表,运营商试图扮演的角色,正在从“连接服务商”进一步变成“AI 算力入口”。就像当年电网把发电厂的电送进千家万户,运营商正在试图把智算中心里的算力,通过套餐和账单体系,变成像水、像电一样可以按月购买、按量消耗的公共资源。

所有人都在比谁的模型参数更大,但真正决定AI能不能落地的,其实是另一件没那么性感的事:一颗Token,能不能被稳定、便宜、规模化地生产出来。死磕这件事的,是一支从中国超级计算体系里走出来的年轻团队,是石科技。

编辑|Panda 数学正在迎来 AI 革命。 最近几个月尤为明显。比如,就在前几天,Google DeepMind 新论文宣布其最新系统 AlphaProof Nexus 在一次自主运行中,解决了 3

GPT-5.5 把进攻性网络安全最难的 7 个基准全部打穿,92.4% 正确率,评估体系直接失灵。AI 黑客能力每 6 个月翻一倍,而衡量它有多危险的尺子,已经先被干碎了。

Epoch AI刚刚发布的《梯度更新》报告,做了一件简单粗暴的事:把全球所有Blackwell芯片能处理的Token数量算出来,再和实际需求一比。结论只有一个字——不够。

刚刚,清华团队开源硬核Agent系统PilotDeck,在开发者圈已经传疯了。项目独立建舱,记忆可视可改,Token还能省一大半。从此,一个人,就是一支AI军团!