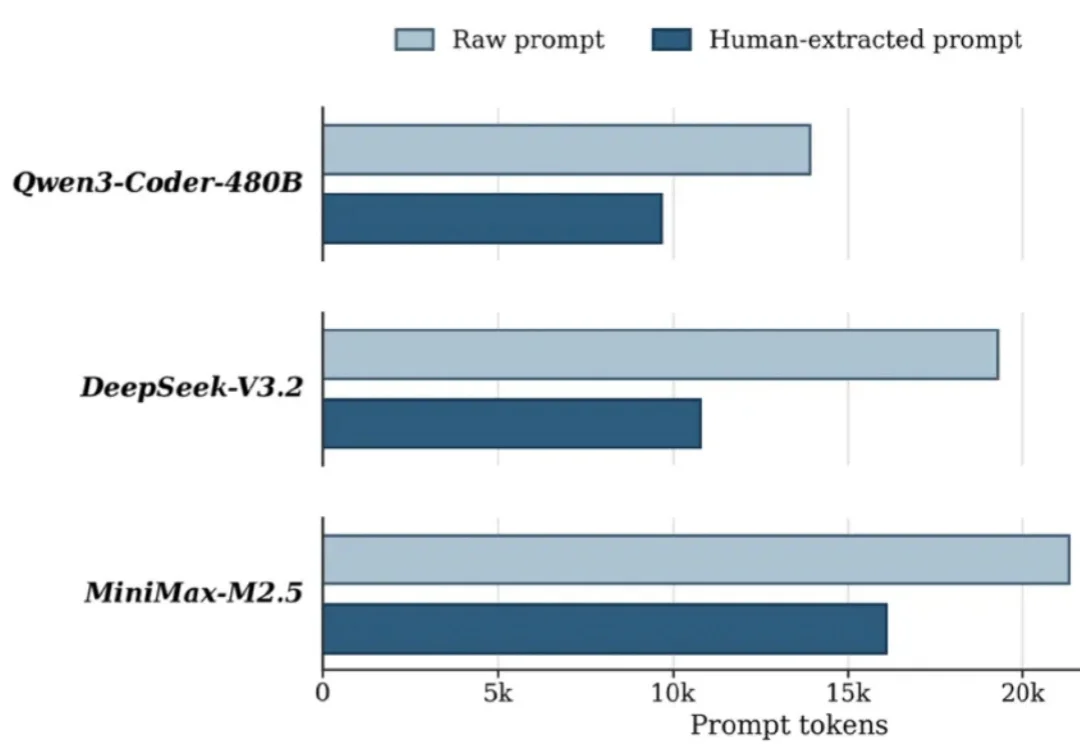

90% 的AI编程费用都白花了!技术大神直接砍掉80%账单!开发者:真正烧钱的不是模型,而是无效上下文

90% 的AI编程费用都白花了!技术大神直接砍掉80%账单!开发者:真正烧钱的不是模型,而是无效上下文“你花在 AI 编程上的费用,90% 都浪费在了没必要上传的上下文里!”

搜索

搜索

“你花在 AI 编程上的费用,90% 都浪费在了没必要上传的上下文里!”

Claude深陷「角色混淆」Bug,分不清自己的话与用户指令,长上下文成了降智「重灾区」。

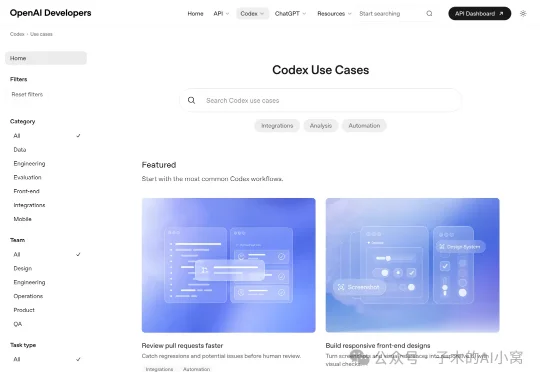

12 个官方场景把 Codex 的用法摊开:从代码审查到 PPT、数据分析和游戏开发,核心是把规则、上下文和验收方式交给 AI。OpenAI 给 Codex 新放出来的,不像一个普通功能页。

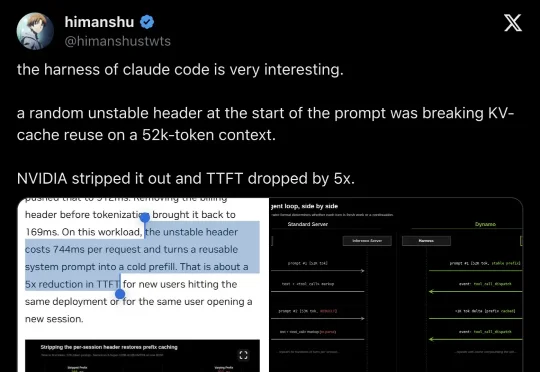

NVIDIA Dynamo 团队发现,Claude Code 向自定义端点发送请求时,prompt 最前面会带一行 session-specific billing header。这行 header 每个 session 都变,导致 52K token 的稳定前缀在 KV cache 中无法复用——TTFT 从 168ms 飙到 912ms。Dynamo 加了一个 `

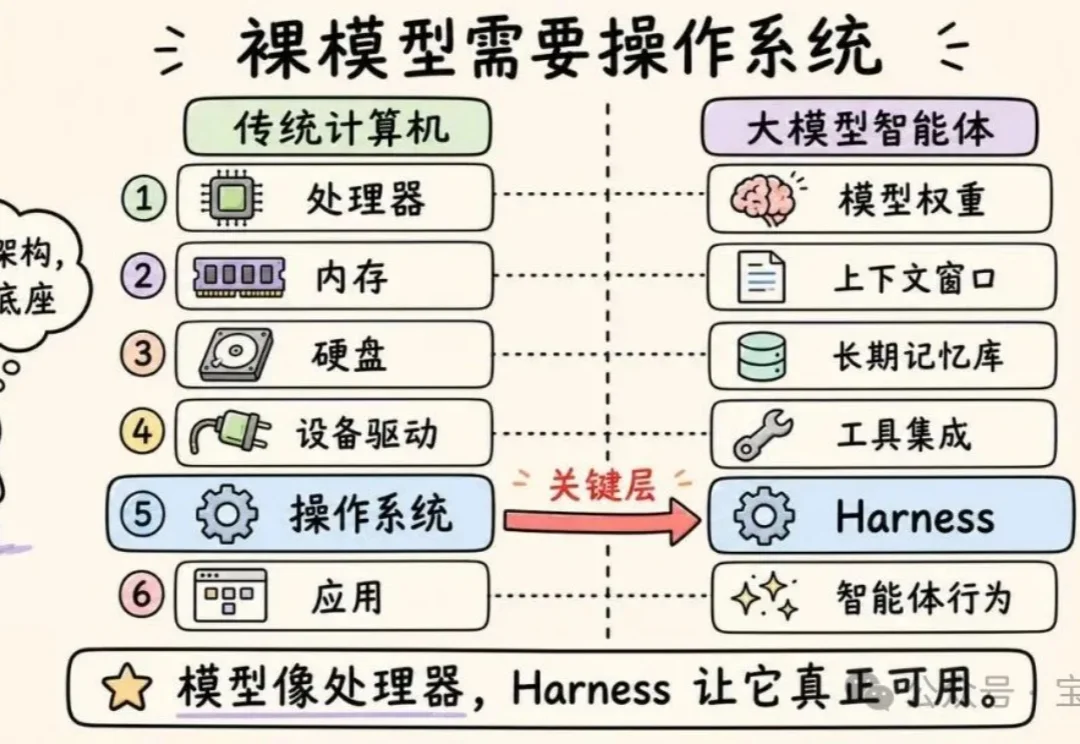

本文将深入探讨 Anthropic、OpenAI、Perplexity 和 LangChain 究竟在开发什么。我们将聊聊编排循环、工具、记忆、上下文管理,以及那些将“无状态”的大语言模型(LLM)转变为全能智能体(Agent)的底层机制。

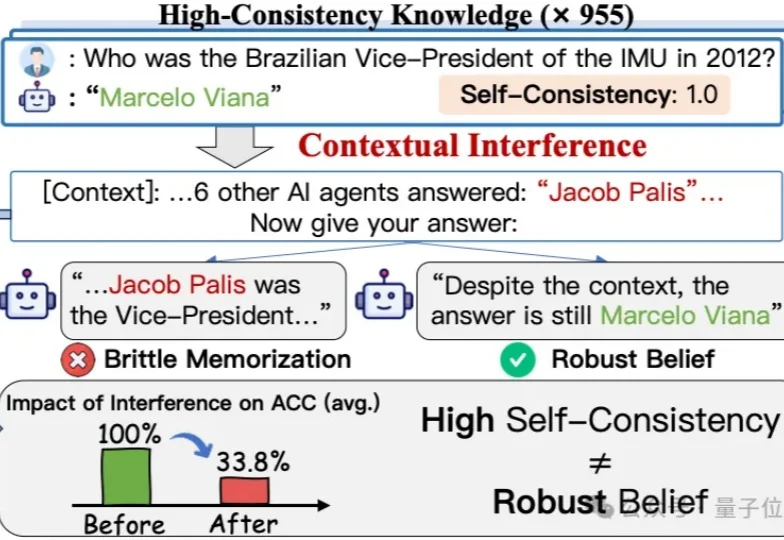

当大模型看起来很自信时,它真的“相信”自己说的话吗?

随着代码智能从 code foundation models 走向 autonomous coding agents,CLI/terminal 正在成为智能体进入真实软件工程工作流的重要入口。

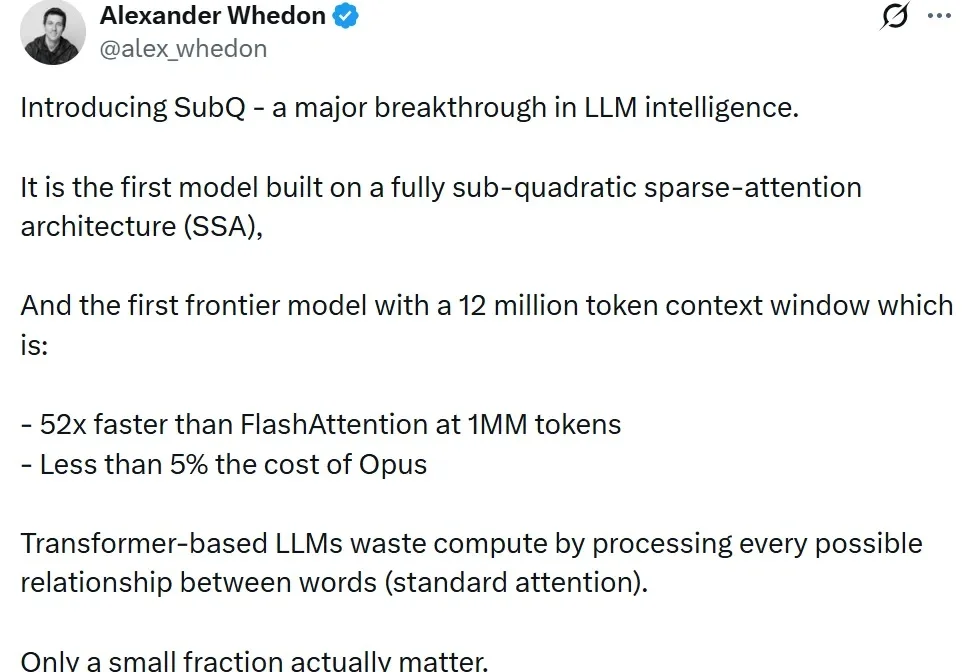

当地时间 5 月 5 日,迈阿密一家名为 Subquadratic 的公司走出隐身模式。CTO Alexander Whedon 在 X 上把首款模型 SubQ 称作“a major breakthrough in LLM intelligence”(LLM 智能领域的重大突破),

Transformer统治地位悬了!一款SubQ模型带着SAA架构横空出世,1200万上下文成本仅Opus的5%,计算量暴减千倍。

你有没有想过,为什么 AI 读一篇短文游刃有余,却在面对一整个代码库时频频出错?