AI编程赛道融资井喷独角兽涌现的背后:一个基于10%的人口都是“程序员”的冰雹猜想

AI编程赛道融资井喷独角兽涌现的背后:一个基于10%的人口都是“程序员”的冰雹猜想AI编程初创公司Magic发布1亿上下文窗口模型,编码能力超级加倍

搜索

搜索

AI编程初创公司Magic发布1亿上下文窗口模型,编码能力超级加倍

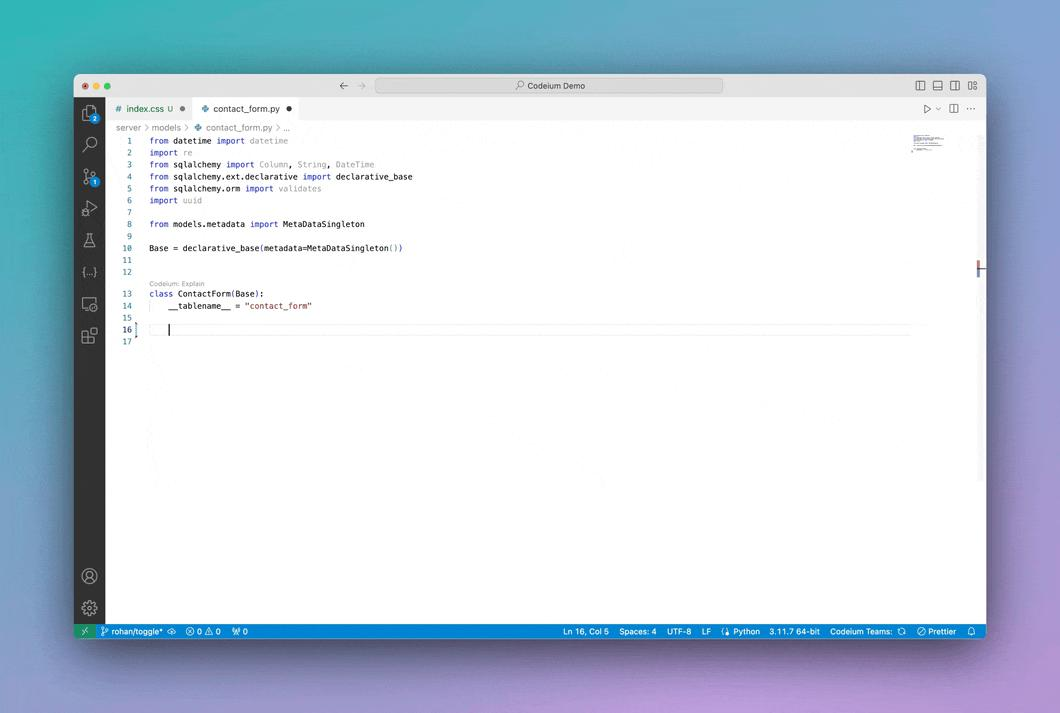

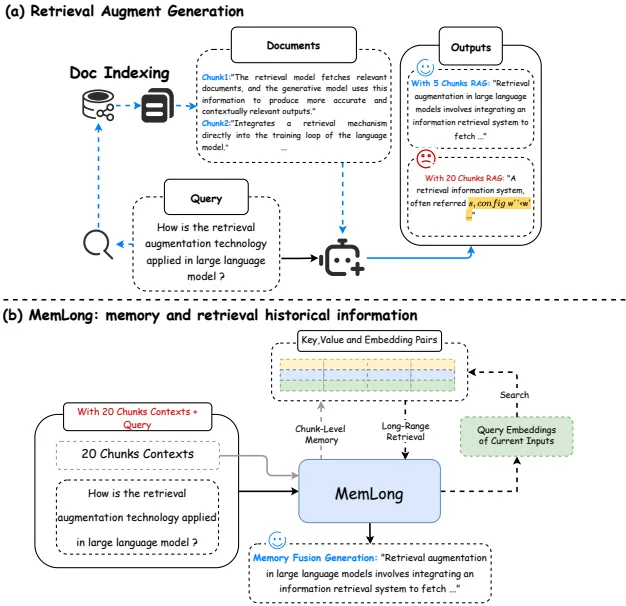

这篇文章介绍了一个名为MemLong的模型,它通过使用外部检索器来增强长文本建模的能力。

Transformer 在深度学习领域取得巨大成功的关键是注意力机制。注意力机制让基于 Transformer 的模型关注与输入序列相关的部分,实现了更好的上下文理解。然而,注意力机制的缺点是计算开销大,会随输入规模而二次增长,Transformer 也因此难以处理非常长的文本。

Jamba是第一个基于 Mamba 架构的生产级模型。Mamba 是由卡内基梅隆大学和普林斯顿大学的研究人员提出的新架构,被视为 Transformer 架构的有力挑战者。

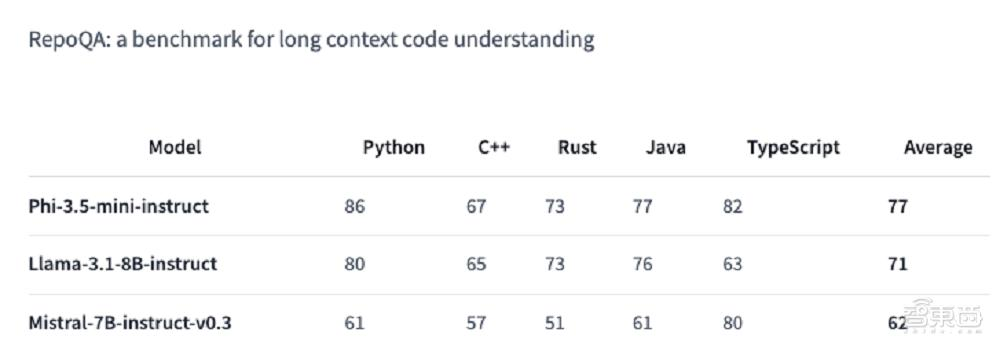

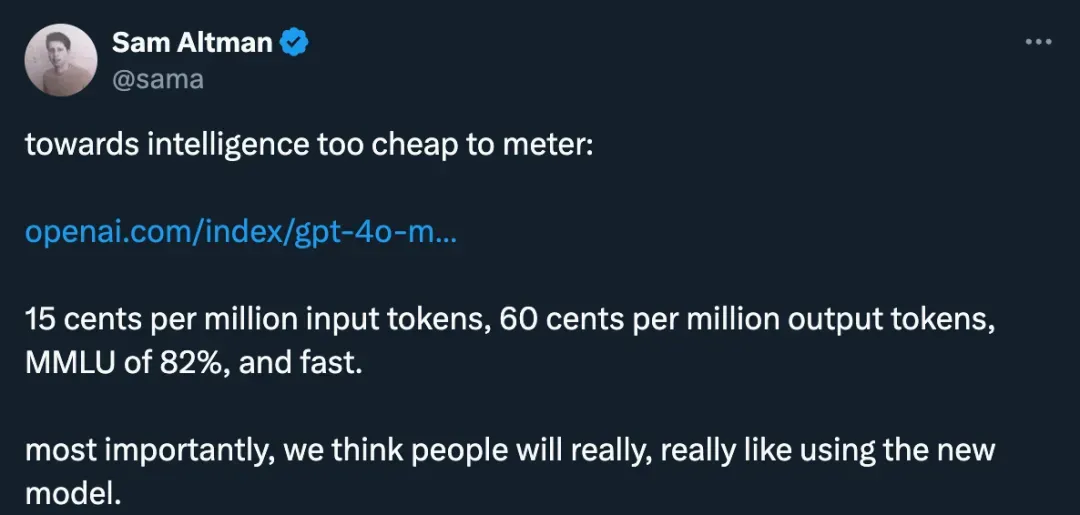

轻量级模型的春天要来了吗?

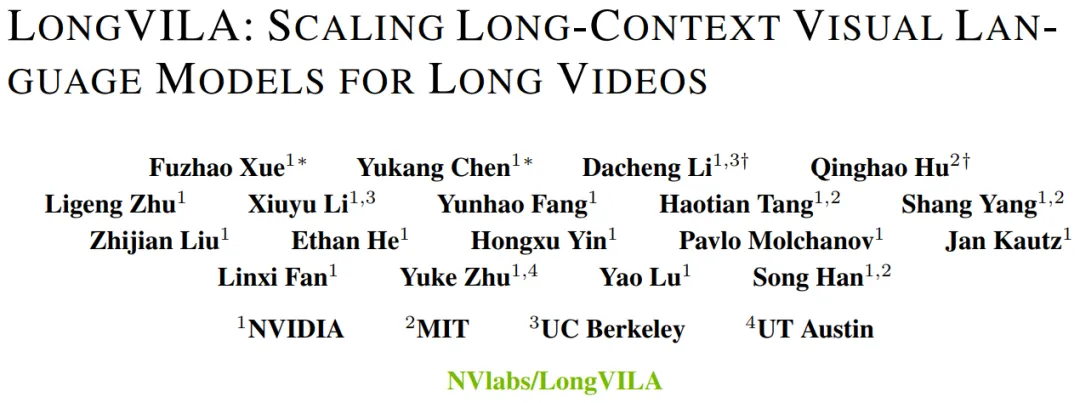

现在,长上下文视觉语言模型(VLM)有了新的全栈解决方案 ——LongVILA,它集系统、模型训练与数据集开发于一体。

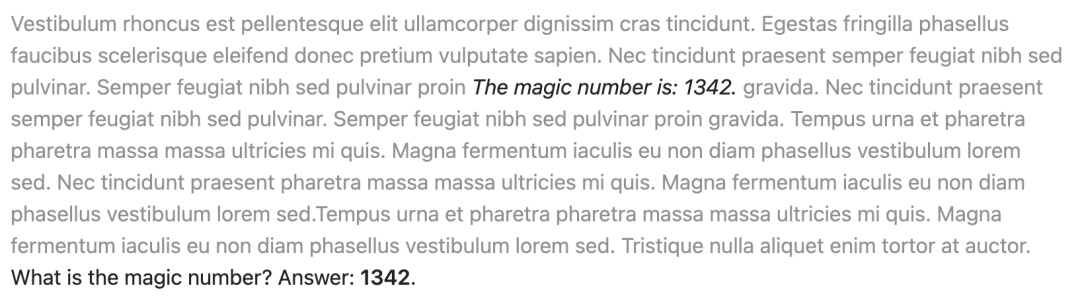

长文本处理能力对LLM的重要性是显而易见的。在2023年初,即便是当时最先进的GPT-3.5,其上下文长度也仅限于2k,然而今日,128k的上下文长度已经成为衡量模型技术先进性的重要标志之一。那你知道LLMs的长文本阅读能力如何评估吗?

国产多模态大模型,也开始卷上下文长度。

当今的LLM已经号称能够支持百万级别的上下文长度,这对于模型的能力来说,意义重大。但近日的两项独立研究表明,它们可能只是在吹牛,LLM实际上并不能理解这么长的内容。

小模型,正在成为 AI 巨头的新战场。