15个模板复制粘贴,让同一个AI聪明十倍:上下文工程实战手册

15个模板复制粘贴,让同一个AI聪明十倍:上下文工程实战手册Nav Toor 的上一篇上下文工程文章火了——上百万人阅读,上千人私信他同一个问题:"道理我都懂了,但我到底该打什么字?"

搜索

搜索

Nav Toor 的上一篇上下文工程文章火了——上百万人阅读,上千人私信他同一个问题:"道理我都懂了,但我到底该打什么字?"

对本地部署玩家,尤其是Mac用户来说,长上下文推理最大的痛点往往不是“模型不够聪明”,而是稍微多用点上下文,统一内存就被撑爆了”,这一点在最近的Gemma-4 31B的部署中尤为明显,在同等上下文的情况,显存占用比Qwen3.5-27B高约一倍不止,直接劝退了不少人。但好消息是,谷歌近期提出的TurboQuant KV缓存量化算法,正是为了解决这个痛点而生。

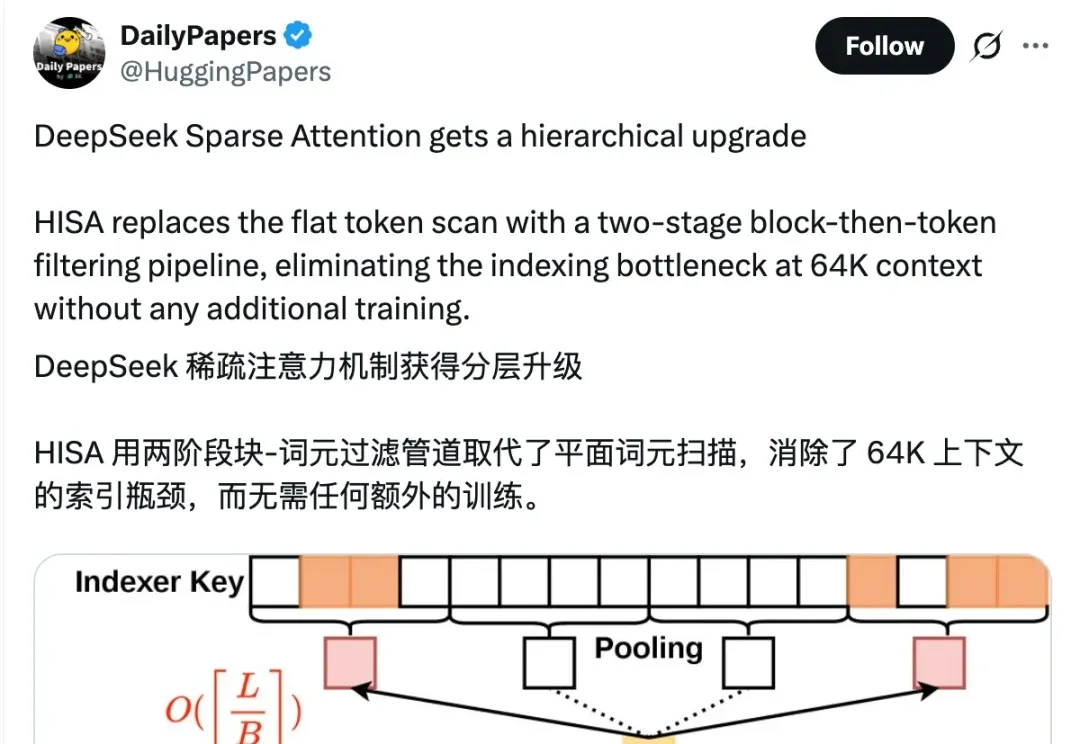

就在大家都急头白脸地等待DeepSeek-V4的时候,冷不丁一篇新论文引起了网友们的注意—— 提出新稀疏注意力机制HISA(分层索引稀疏注意力),突破64K上下文的索引瓶颈,相比DeepSeek正在用的DSA(DeepSeek Sparse Attention)提速2-4倍。

一家叫泛灵人工智能的团队,出了一款主打「超级办公助理」的硬件产品。

刚刚,Anthropic神秘王炸Mythos的基准测试泄露了,多项跑分直接刷新纪录!另外,泄露源码中还曝光出卡皮巴拉的细节:代号capabara-v2-fast,支持1M上下文。

长上下文推理已经成了VLM/LLM的默认形态。

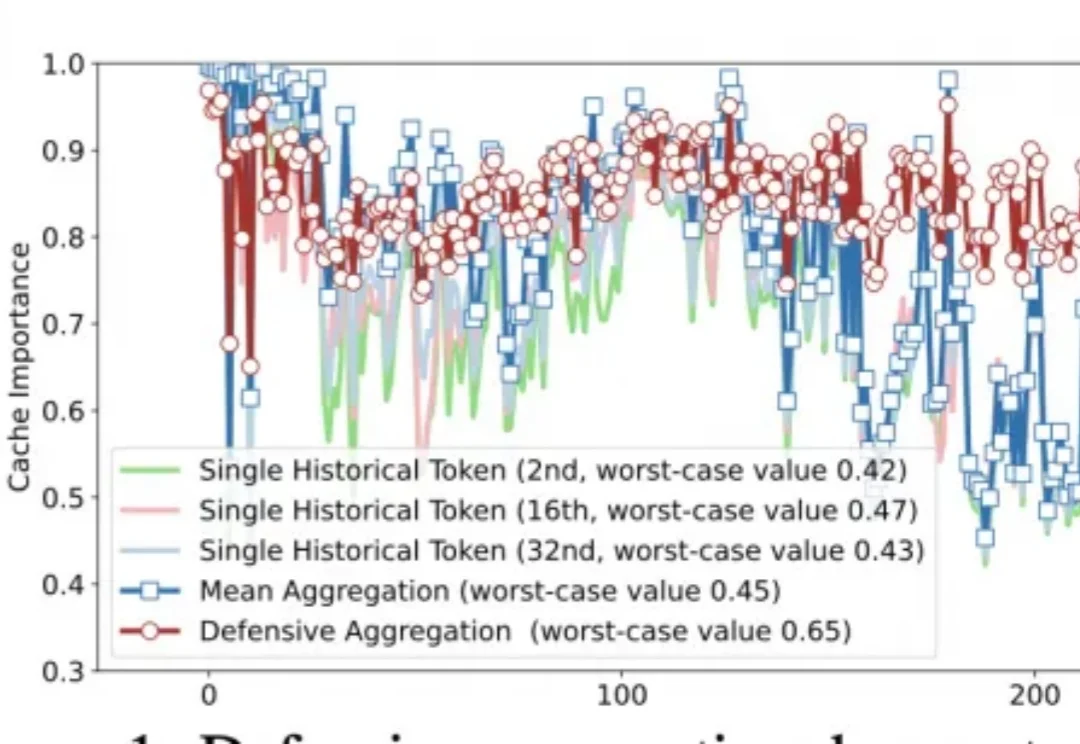

随着大模型长上下文能力快速增长,海量 KV Cache 存储需求急剧增加,各类 KV Cache 压缩方法如雨后春笋般涌现。然而,这些方案在真实场景中的工程落地却常常陷入困境。

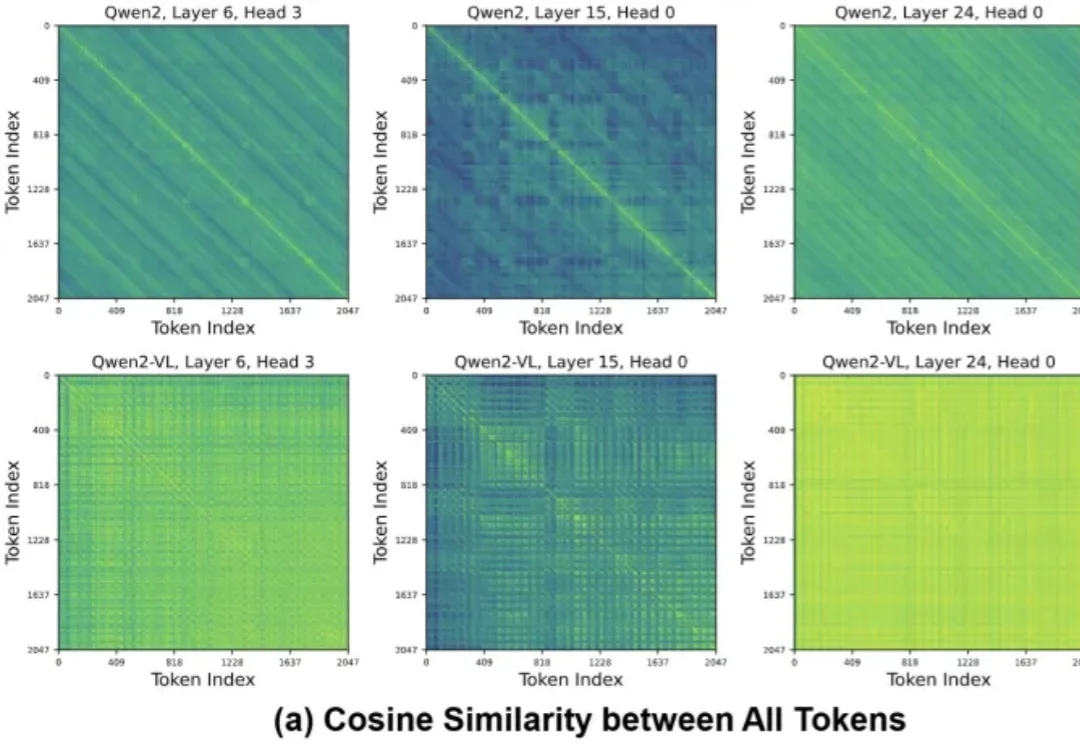

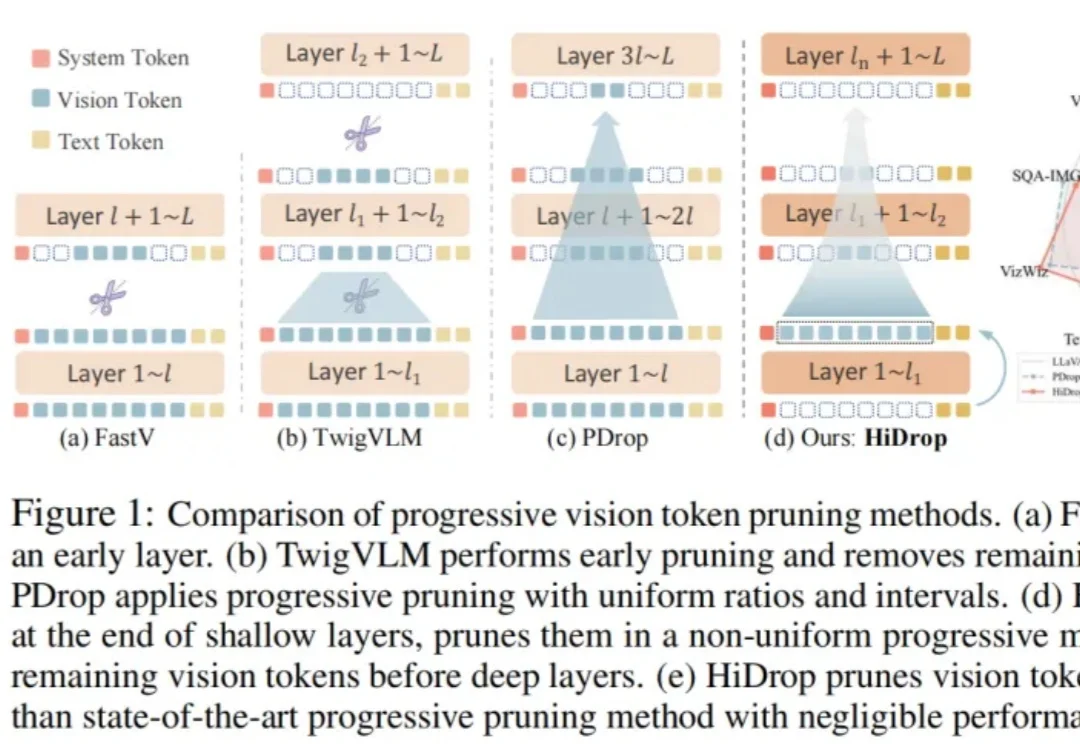

随着多模态大语言模型(MLLM)支持更长上下文,高分辨率图像和长视频会产生远多于文本的视觉 Token,在自注意力二次复杂度下迅速成为效率瓶颈。

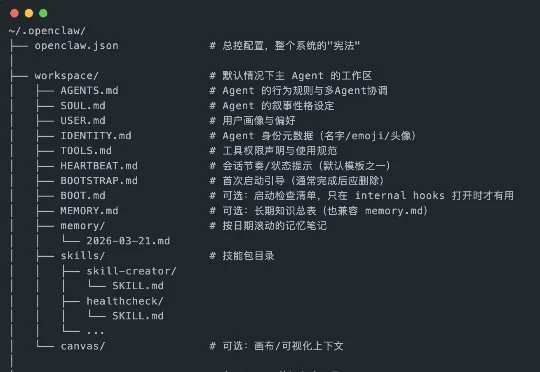

一边的人,每次跟 Agent 说话都像重新 onboarding:得再讲一遍背景、偏好和上下文。另一边的人,Agent 已经知道自己是谁、该怎么说话、用户讨厌什么,也记得上次积累下来的东西。这条分界线,叫 workspace。

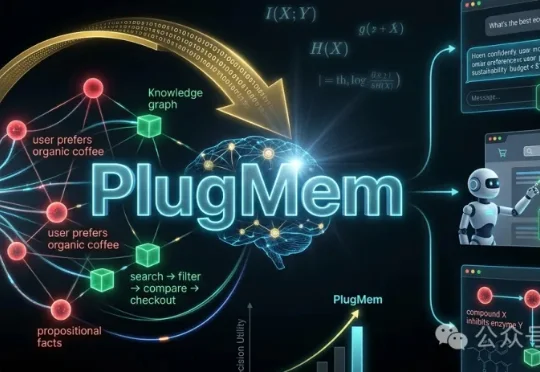

现在的AI agent往往把长交互历史直接存起来,但很难高效复用。最朴素的方法直接从「原始记忆」里检索,但常常把模型淹没在冗长、低价值的上下文里。PlugMem把经验转化为结构化、可复用的知识,并提出一个任务无关(task-agnostic)的统一记忆模块,在多种Agent基准上提升性能,同时消耗更少。