魔法原子进军硅谷背后:世界模型野望与生态卡位

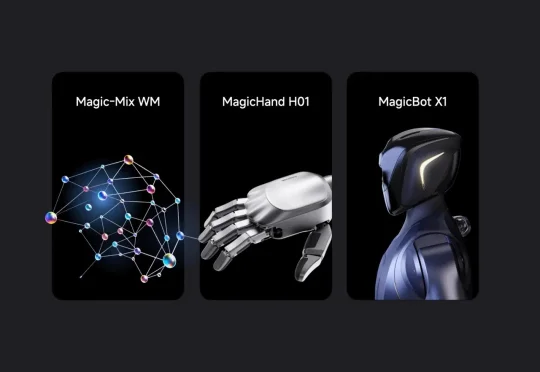

魔法原子进军硅谷背后:世界模型野望与生态卡位魔法原子在会上推出了新一代人形机器人 MagicBot X1 和灵巧手 MagicHand H01,而且第一次把其世界模型 Magic-Mix、数据生成与训练反馈闭环,作为一套完整的具身智能底层能力集中展示出来。

魔法原子在会上推出了新一代人形机器人 MagicBot X1 和灵巧手 MagicHand H01,而且第一次把其世界模型 Magic-Mix、数据生成与训练反馈闭环,作为一套完整的具身智能底层能力集中展示出来。

今天,大洋彼岸,硅谷自动驾驶领域的秘密,终于有大佬站出来分享了。如果你对自动驾驶、人形机器人中炙手可热的 VLA、世界模型还有疑惑,全球“物理 AI” 领域头部的基础设施平台 Applied Intuition 两位创始人:CEOQasar Younis、CTO Peter Ludwig的分享可真的是太对口了。

过去十年,压缩在 CV 学术圈一直是个边缘方向——做生成、做大模型才是显学。但 SparcAI 的两位95后创始人各自做了多年压缩,然后在同一间 NTU 实验室相遇,两年后发布了 Sparc3D。模型 demo 上线当日冲上 HuggingFace Trending 榜首,论文被 NeurIPS 2025 录用。如今他们创办了 SparcAI,目标是一家世界模型公司。

普林斯顿大学助理教授刘壮,在学术圈是一个颇为特殊的存在——他的每一篇论文几乎都在质疑某个“理所当然”的假设。架构真的重要吗?数据集真的足够多样吗?归一化层是必需的吗?大语言模型有世界模型吗?AI智能体能替代博士生吗?

世界模型黑马横空出世!就在刚刚,生数科技的MotuBrain零宣发登顶双榜,直接打通「看懂世界+执行行动」,而且不同的是,他们把World Action Model适配多个头部机器人本体,完成多个长程任务,这是国产AI的硬核突围!从此,具身智能彻底迈入新纪元。

由张昊天作为一作兼共同通讯作者在临港实验室联合上海浦江实验室、华盛顿大学、哈佛大学、MIT 等科研力量共同推进的 ODesign 开源科研项目,定位于全球首个面向全模态的分子设计基座模型。

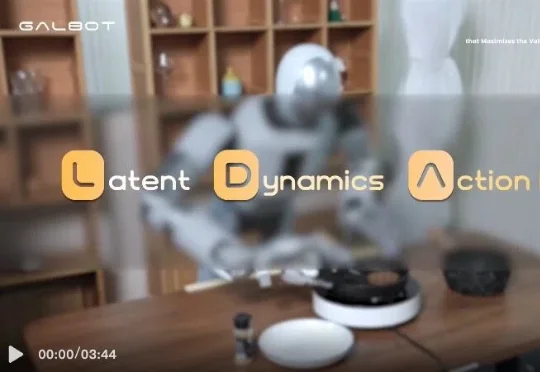

就在这一背景下,银河通用联合清华北大英伟达等众多机构联合发布了跨本体「隐式世界-动作基础模型」LDA-1B,将目光投向了具身智能 Scaling Law 的这个终极命题:如何让模型有效利用互联网规模的异构数据。

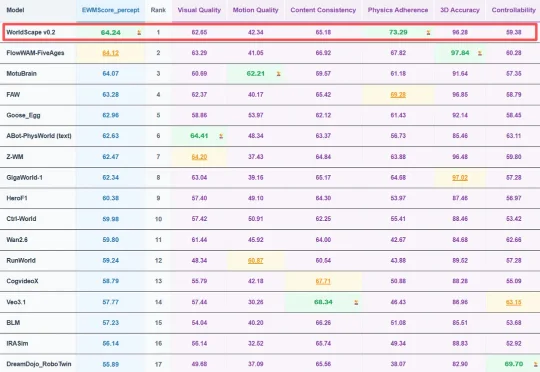

近日,全球具身世界模型权威基准评测 WorldArena 正式更新最新榜单。Manifold AI 流形空间研发的世界模型 WorldScape 0.2,凭借其在物理规律遵循与多源交互理解上的突破取得 WorldArena 榜单全球第一,充分展现了国产世界模型在复杂动态场景生成与具身控制中的高精度、强泛化与物理可信度。与其同场竞技的包括英伟达、谷歌等国外巨头和星动纪元、极佳视界等国内具身智能公司。

今日,蚂蚁灵光App上线“体验世界模型”功能,成为业界首个可在移动端体验世界模型的智能助手,实现了分钟级一致性和实时可交互体验。用户只需上传一张图片,即可在手机上探索最长60秒的3D世界,并通过手游摇杆操控视角,像玩游戏一样在其中走动。从触发指令到开始探索,整个过程仅需秒级。

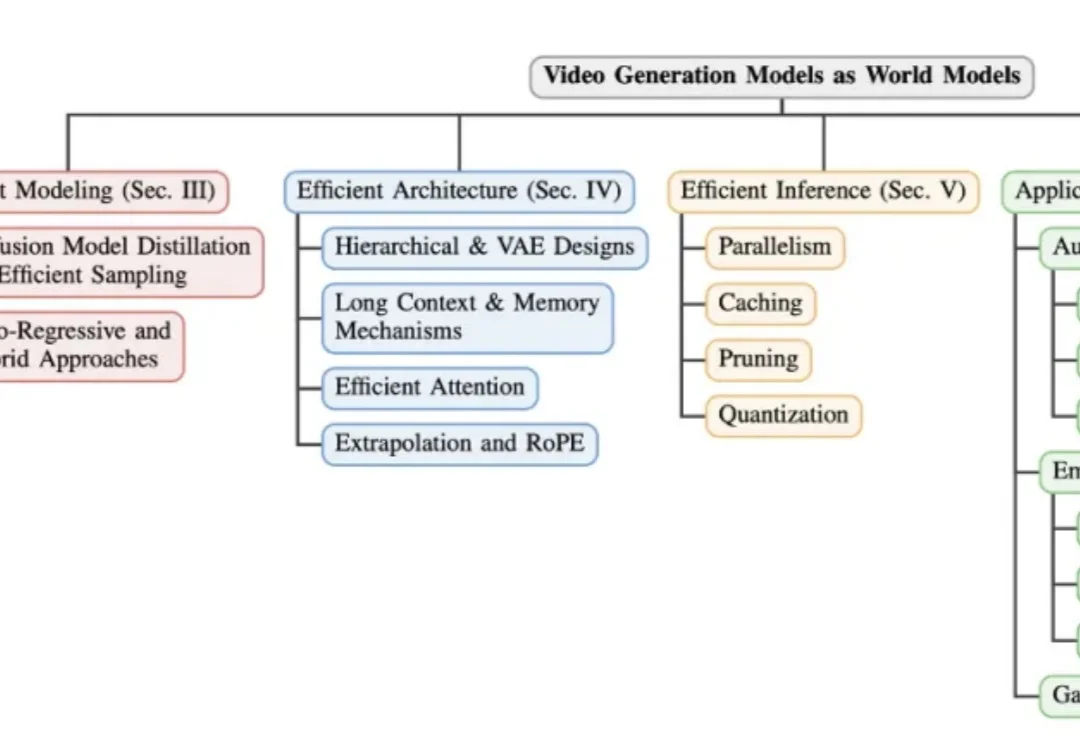

还记得两年前,AI 生视频可谓是「鬼畜专区」—— 人物多一根手指算基操,走路自带鬼步舞才是常态。结果转眼间,从 OpenAI 的 Sora 到字节跳动的 Seedance,这些模型已经开始一本正经地「模拟世界」了:水会流、球会弹、光影能追踪,俨然一副要当「物理引擎」的架势。