他把北美最大人工记账公司做到被收购,转身用1000万美元让AI替代它

他把北美最大人工记账公司做到被收购,转身用1000万美元让AI替代它你有没有想过,作为一个软件创业者,你每个月到底在对账和财务事务上浪费了多少时间?银行流水要确认,薪资系统要对齐,Stripe 里的收款记录要归类,还有各种供应商发票要处理。这些事情不难,甚至可以说很机械,但它们每个月都会悄无声息地吃掉你好几个小时。

搜索

搜索

你有没有想过,作为一个软件创业者,你每个月到底在对账和财务事务上浪费了多少时间?银行流水要确认,薪资系统要对齐,Stripe 里的收款记录要归类,还有各种供应商发票要处理。这些事情不难,甚至可以说很机械,但它们每个月都会悄无声息地吃掉你好几个小时。

刚刚,顾全全发文告别字节 Seed 团队。在此之前,他是 Seed 旗下聚焦科学智能领域的 AI4S 团队核心成员。顾全全是机器学习理论、大模型对齐以及 AI4S 科学智能领域知名的学者。他于 2007 年和 2010 年分获清华大学自动化专业学士、控制科学与工程硕士学位,2014 年获伊利诺伊大学香槟分校计算机科学博士学位,随后在普林斯顿大学运筹与金融工程系(ORFE)开展统计学博士后研究。

这不是科幻小说,而是 METR(模型评估与训练研究组织)联合Anthropic、Google、Meta和OpenAI 进行内部红队测试后,发布的首份《前沿风险报告》中披露的真实案例。这是四大巨头第一次允许第三方深入测试他们内部最强、可访问完整思维链(CoT)的模型,并开放非公开的对齐与控制信息。

姜旭是少数完整参与过 OpenAI 大模型核心技术演进的华人创业者之一。2019 至 2023 年间,他经历了 GPT 系列能力爆发最关键的阶段,工作横跨底层训练 infra、大规模预训练、RLHF 对齐算法与数据构建等核心链路。

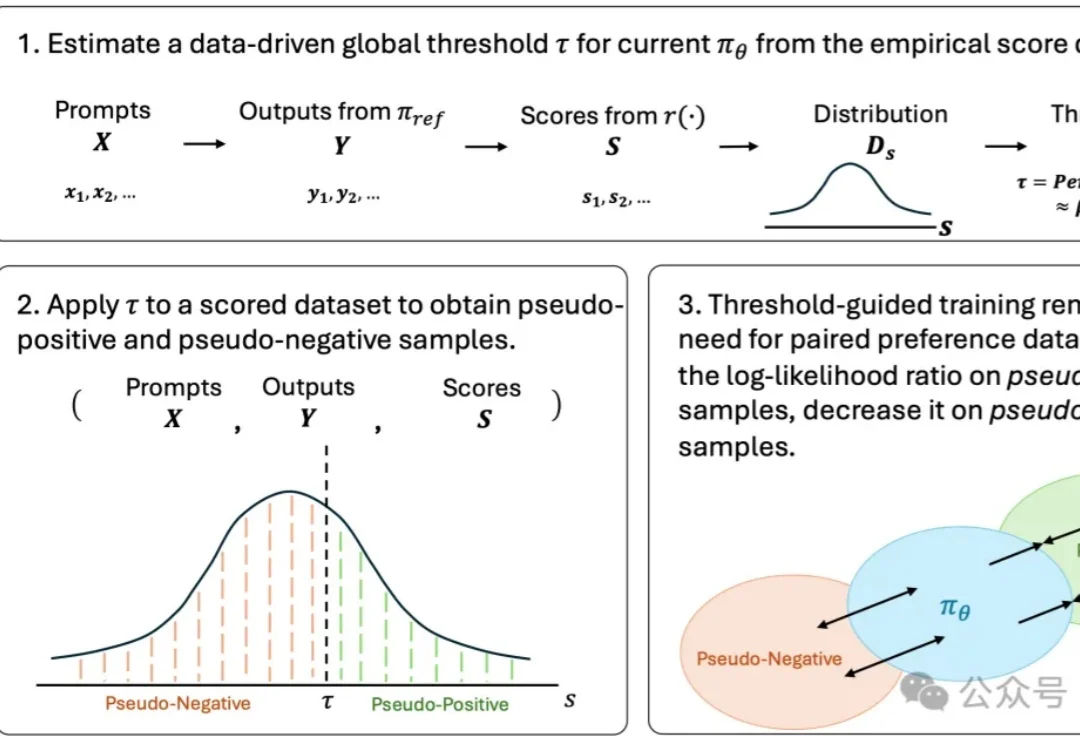

生成模型的偏好对齐,可能正在进入一个新的阶段。

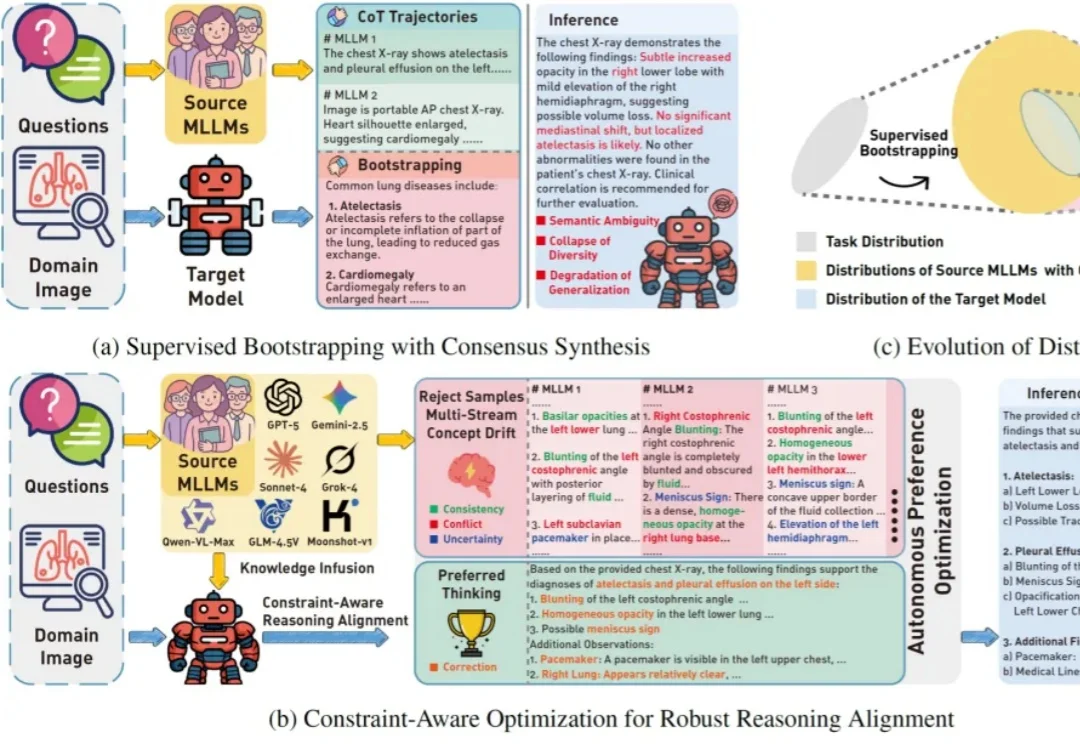

在多模态大模型(MLLM)快速发展的浪潮中,融合多模型 “集体智慧” 已成为提升模型性能的关键路径,并催生了多教师知识蒸馏这一主流范式。然而,不同来源的教师模型在架构与优化上的差异,其在相似推理过程中呈现出不稳定甚至偏移的认知轨迹,即 “概念漂移”(Concept Drift)。

有个31B参数的大模型,正常需要80GB显存才能跑。但现在,24GB显存就能跑满血版。这个版本叫Gemma-4-31B-JANG_4M-CRACK——"CRACK"这个词不要理解歪了,它本质是量化压缩加上对齐微调之后的部署版本,不是什么黑客攻击,就是工程优化。24GB,MacBook Pro,直接跑。苹果用户优先优化,MLX原生支持,月下载13000次。

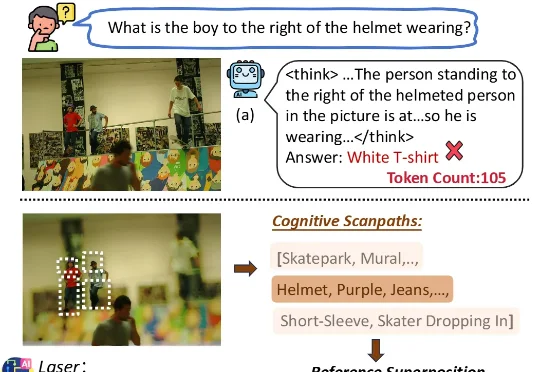

为了解决这一痛点,由 MBZUAI、复旦大学、中国人民大学高瓴人工智能学院以及哈佛大学联合组成的研究团队,提出了一种名为 Laser 的全新隐式视觉推理范式。该研究从认知心理学中汲取灵感,引入了 “Forest-before-Trees” 的认知机制,通过动态窗口对齐学习(DWAL),首次实现了在隐空间中维持视觉特征的 “概率叠加” 状态。

在代码大模型和代码智能体技术快速发展的今天,一个日益凸显的现象是:能够在经典代码生成基准上取得优异成绩的模型,一旦被放入真实软件工程环境中,表现却往往大幅下滑。

最近,谷歌联合ResNet作者何恺明、谢赛宁、NeRF先驱Jonathan T. Barron、 3D图形学名家Thomas Funkhouser,正式发布了Vision Banana。它向世界宣告:视觉AI终于不再需要那些臃肿的任务头了,理解,本质上只是生成过程中的一次「对齐」。