全球开源新王Qwen2-72B诞生,碾压Llama3-70B击败国产闭源模型!AI圈大佬转疯了

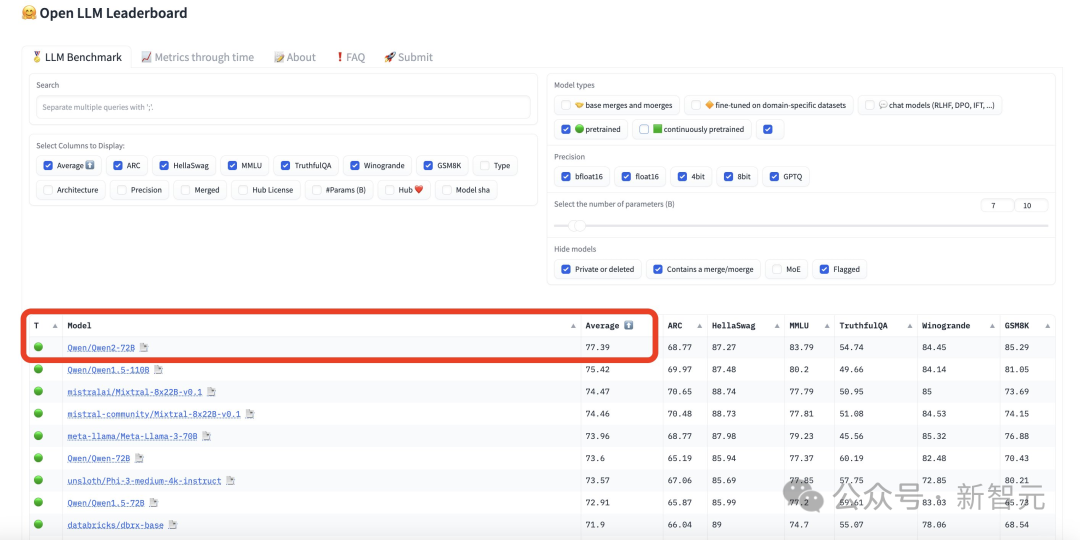

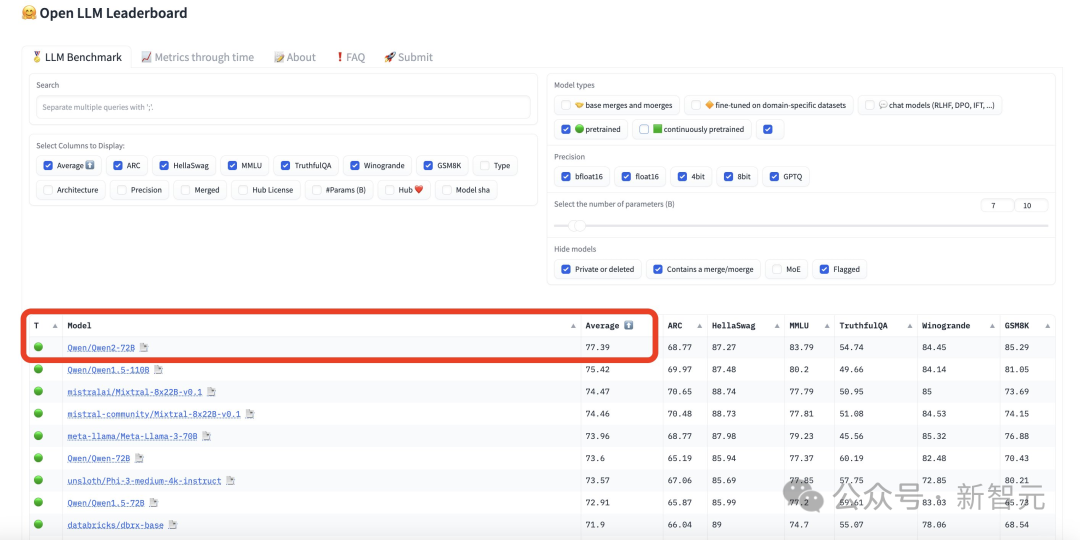

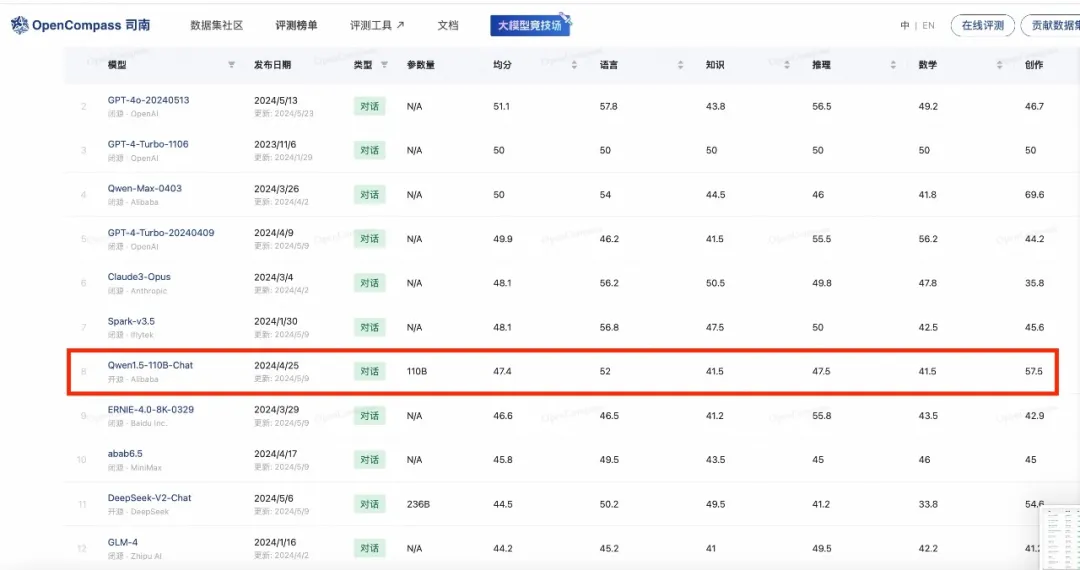

全球开源新王Qwen2-72B诞生,碾压Llama3-70B击败国产闭源模型!AI圈大佬转疯了一夜之间,全球最强开源模型再次易主。万众瞩目的Qwen2-72B一出世,火速杀进开源LLM排行榜第一,美国最强开源模型Llama3-70B直接被碾压!全球开发者粉丝狂欢:果然没白等。

一夜之间,全球最强开源模型再次易主。万众瞩目的Qwen2-72B一出世,火速杀进开源LLM排行榜第一,美国最强开源模型Llama3-70B直接被碾压!全球开发者粉丝狂欢:果然没白等。

大模型领域,开源与闭源之争一直是技术和产业界关注的焦点。阿里云通义千问最新发布的Qwen2系列模型,为这场争论提供了最新的答案。

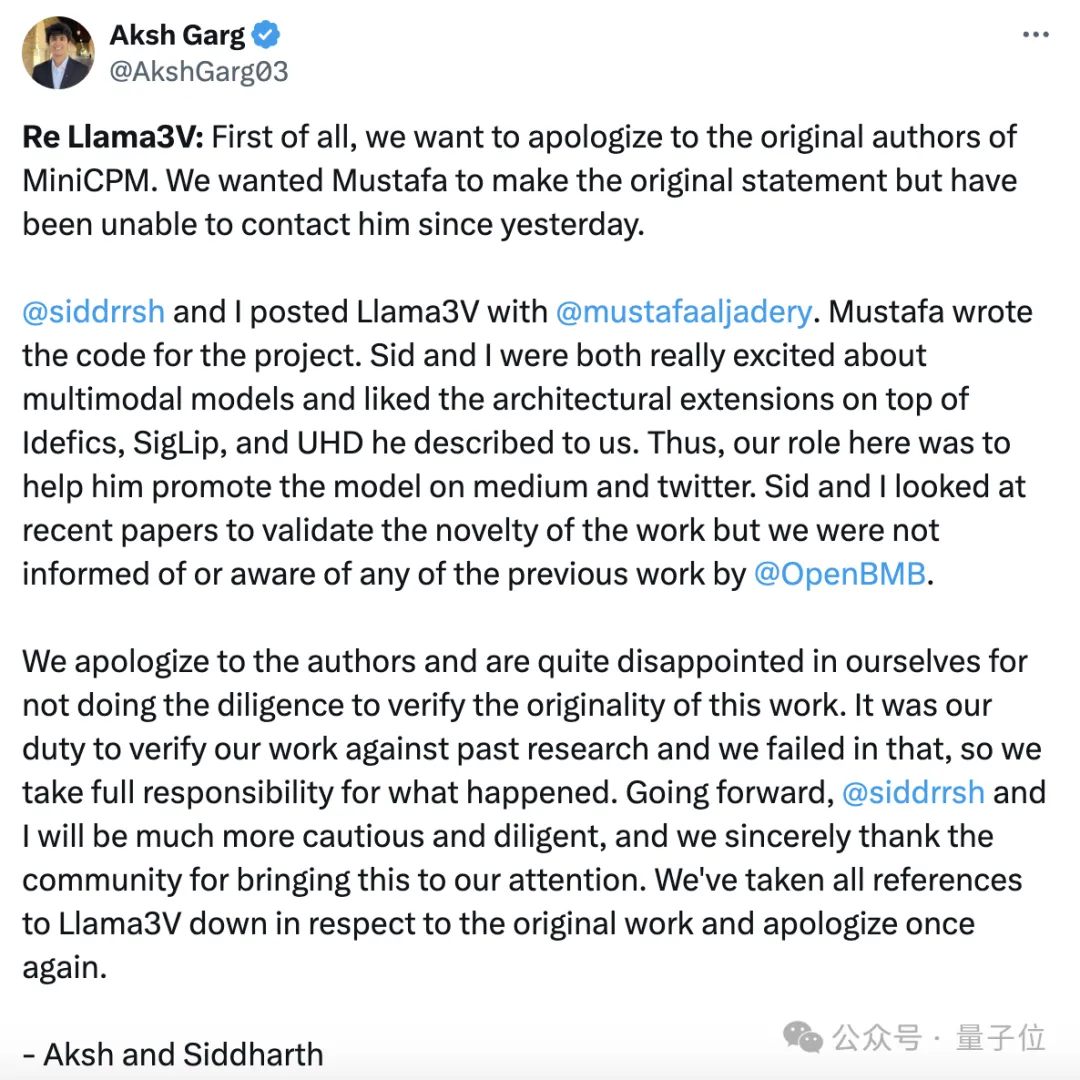

斯坦福团队抄袭清华系大模型事件后续来了—— Llama3-V团队承认抄袭,其中两位来自斯坦福的本科生还跟另一位作者切割了。

深度学习领域知名研究者、Lightning AI 的首席人工智能教育者 Sebastian Raschka 对 AI 大模型有着深刻的洞察,也会经常把一些观察的结果写成博客。在一篇 5 月中发布的博客中,他盘点分析了 4 月份发布的四个主要新模型:Mixtral、Meta AI 的 Llama 3、微软的 Phi-3 和苹果的 OpenELM。

为了将大型语言模型(LLM)与人类的价值和意图对齐,学习人类反馈至关重要,这能确保它们是有用的、诚实的和无害的。在对齐 LLM 方面,一种有效的方法是根据人类反馈的强化学习(RLHF)。尽管经典 RLHF 方法的结果很出色,但其多阶段的过程依然带来了一些优化难题,其中涉及到训练一个奖励模型,然后优化一个策略模型来最大化该奖励。

曾经创造出Stable Diffusion系列模型的Stability AI,目前面临前所未有的财务危机。

本文基于数势科技创始人&CEO黎科峰博士,百川智能联合创始人焦可,腾讯研究院副院长刘琼,蓝驰创投投资合伙人、TGO鲲鹏会学员石建平以及实在智能联合创始人、CMO张俊九等五位行业大咖在InfoQ主办的QCon全球软件开发大会的圆桌讨论整理。

最近在许多美国开发者的口中,一个开源模型经常被提及,它的发音听起来是“困”。乍一听到总让人一头雾水。哪个开发者天天用中文说困啊。

阿里云正式发布通义千问2.5大模型,同时宣布性能全面赶超GPT-4 Turbo。

AI创业现在需要的是哪一类人?黄云刚就AI技术开放的门槛、创业者的技术要求和市场趋势进行了深入的探讨。“大模型的开源和Database时代的开源不是一个概念。”源码资本管理合伙人黄云刚说。