斯坦福用一句Prompt就结束了提示工程。。。

斯坦福用一句Prompt就结束了提示工程。。。最近口述采样很火。如果您经常使用经过“对齐”训练(如RLHF)的LLM,您可能已经注意到一个现象:模型虽然变得听话、安全了,但也变得巨“无聊”。

最近口述采样很火。如果您经常使用经过“对齐”训练(如RLHF)的LLM,您可能已经注意到一个现象:模型虽然变得听话、安全了,但也变得巨“无聊”。

全球最牛的提示工程师Riley Goodside,官宣入职谷歌DeepMind了。Riley前后斟酌了两个月的时间,才拿下了这个决定。 2022年ChatGPT诞生之后,他仅凭和AI聊天,就能年入百万美金,引起全网关注。

我每天都使用AI,我认为提示工程是一项高级认知技能。

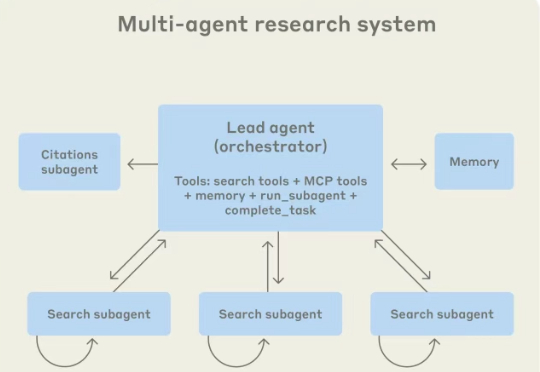

在这篇文章中,它详细展示了如何构建一个有效的多智能体研究系统,这是一个架构,其中主代理(The Lead Agent)会生成和协调子代理(Subagents),以并行方式探索复杂查询,内容涵盖系统架构、提示工程以及评估方法等。

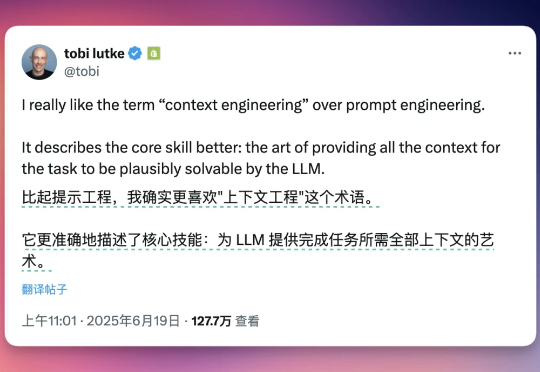

继提示工程之后,「上下文工程」又红了!这一概念深得Karpathy等硅谷大佬的喜欢,堪称「全新的氛围编程」。而智能体成败的关键,不在于精湛的代码,而是上下文工程。

这几天 AI 圈子有个非常有必要也非常热的讨论就是提示工程是不是应该被称为“上下文工程”更加适合。

昨天最热的的两篇文章是关于多智能体系统构建的讨论。 先是 Anthropic 发布了他们在深度搜索多智能体构建过程中的一些经验,具体:包括多智能体系统的优势、架构概览、提示工程与评估、智能体的有效评估等方面。

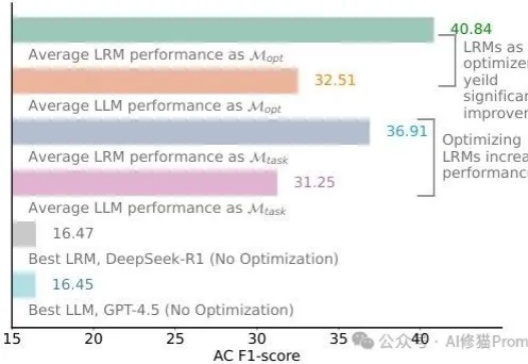

还记得DeepSeek-R1发布时AI圈的那波狂欢吗?"提示工程已死"、"再也不用费心写复杂提示了"、"推理模型已经聪明到不再需要学习提示词了"......这些观点在社交媒体上刷屏,连不少技术大佬都在转发。再到最近,“提示词写死了”......现实总是来得这么快——乔治梅森大学的研究者们用一个严谨得让人无法反驳的实验,狠狠打了所有人的脸!

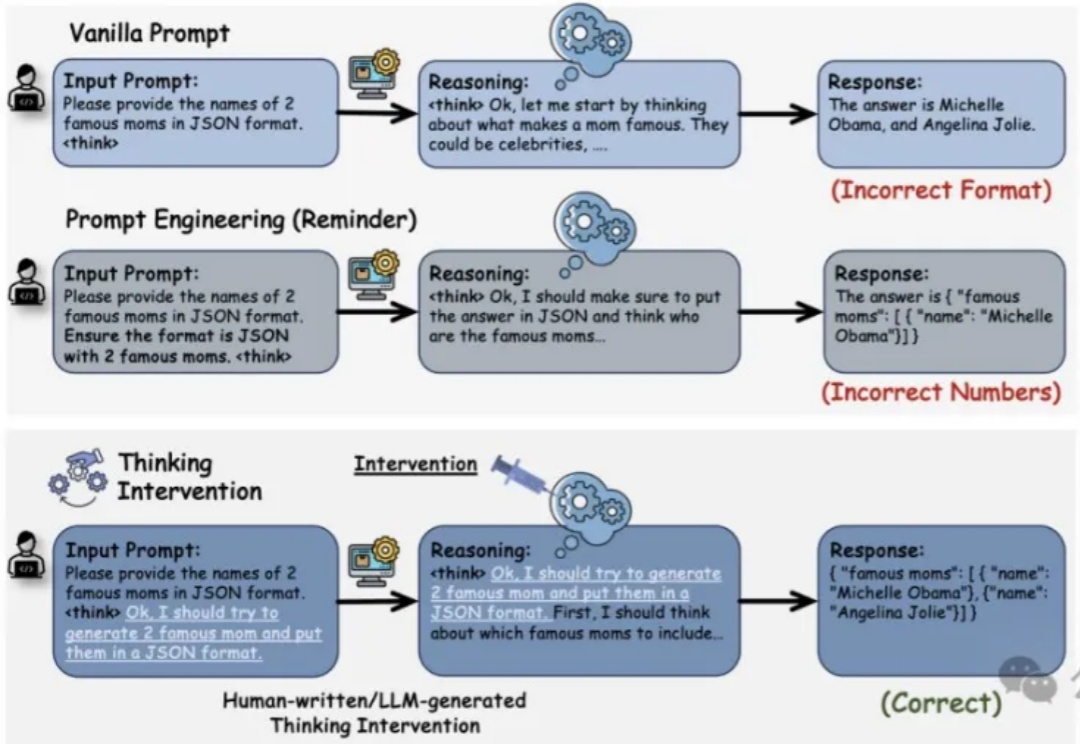

推理增强型大语言模型LRM(如OpenAI的o1、DeepSeek R1和Google的Flash Thinking)通过在生成最终答案前显式生成中间推理步骤,在复杂问题解决方面展现了卓越性能。然而,对这类模型的控制仍主要依赖于传统的输入级操作,如提示工程(Prompt Engineering)等方法,而你可能已经发现这些方法存在局限性。

未来,掌握持续提示工程技术的开发者,将主导下一代智能系统的进化方向。