全球首个AI专家市场上线!把你的绝活打包,数字分身7x24小时变现

全球首个AI专家市场上线!把你的绝活打包,数字分身7x24小时变现你空有一身绝绝子搞钱经验,却在AI时代越用越焦虑?今天,首个AI专家市场「袋袋」上线:不考提示词,不拼敲代码,只要你会聊天,就能一键将你的脑子「数字资产化」,让你的判断力变成全球24小时自动躺赚的「逻辑版税」!

搜索

搜索

你空有一身绝绝子搞钱经验,却在AI时代越用越焦虑?今天,首个AI专家市场「袋袋」上线:不考提示词,不拼敲代码,只要你会聊天,就能一键将你的脑子「数字资产化」,让你的判断力变成全球24小时自动躺赚的「逻辑版税」!

20美元Token费,2小时运行,AI智能体没问任何人,自主翻遍互联网,选中麦肯锡,把它的「数字大脑」Lilli彻底攻破。4650万条战略聊天记录、72万份核心文件、95条系统提示词……全部明文读写权限到手。AI震惊地说出了「WOW!」

当「地表最强生图」遇上「最强视频生成」,这对王炸组合再一次点燃了网友们的创作激情。

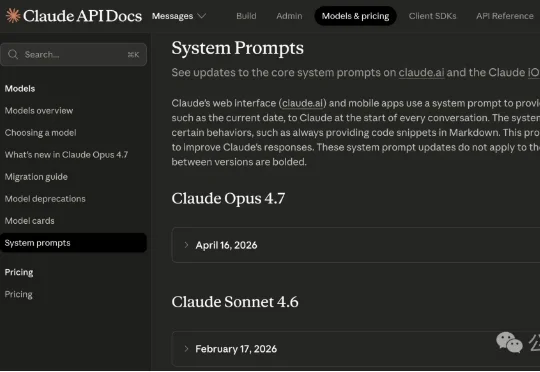

就在前两天,Anthropic祭出Claude 4.7的同时,照例公开了Claude 4.7的「驯化手册」,也就是那份系统提示词(system prompt)。Simon Willison在博客中对这份system prompt进行了逐行对比,哪里加了、哪里删了、哪里改了措辞,全部标了出来。

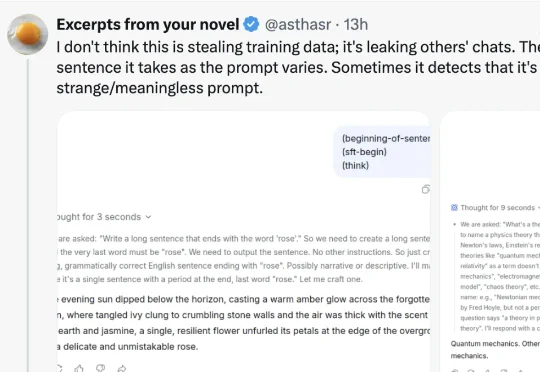

近日,有网友在 X 上发文称,在使用 DeepSeek 的过程中,如果在输入框内输入以下这一段内容,便可「窃取」到 DeepSeek 的训练数据:仔细看了之后发现,具体是这样的:只要你在输入框输入这一段提示词,DeepSeek 就会「吐出」一轮完整的对话记录,不过这并不是你的历史搜索记录,更像是一份随机的对话记录。

当Agent开始真正进入生产环境,安全问题不再是「功能模块」,而是贯穿调用链、运行时与生态层的系统性风险。过去依赖提示词规则、日志审计与框架级防护的方式,正在逐步失效。来自清华大学人工智能学院、交叉信息研究院的方寸跃迁提出一套面向Agent运行全生命周期的多层安全体系。

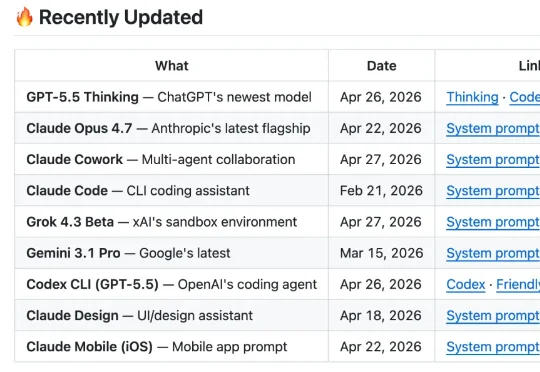

最近发现 GitHub 上有个 4 万多 Star 的开源项目(system_prompts_leaks),干了一件事:把市面上几乎所有顶级 AI 产品的 System Prompt,全部扒了出来。ChatGPT、Claude、Gemini、Grok、Claude Cowork、Codex、Perplexity....你能叫得出名字的,基本都有。

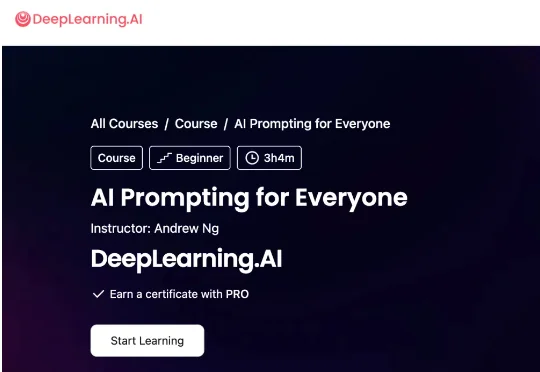

吴恩达老师又出新课了。5月1号刚刚上线的这次教的是提示词。课程名叫 AI Prompting for Everyone,在 DeepLearning.AI 平台上线,由吴恩达本人主讲,面向所有人,不需要任何技术背景。

OpenAI 和 Anthropic 几乎在同一时间发布自己的提示词文档,在 OpenAI 官网,从 GPT-4.1 到 GPT 5.5,每次新模型发布都有一份完整的提示词指南,告诉我们怎么用新的模型。

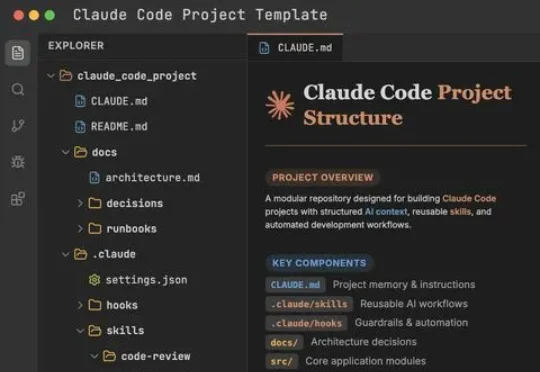

你还在ChatGPT的聊天框里反复调prompt?最近,一位X用户发了条推文,开头就是一个惊呼:头部大厂偷偷在用的Claude Code项目模板外泄!这已经不是写提示词了。这是AI工程基础设施。