用SFT打出RL的效果?微软联合提出高效后训练算法

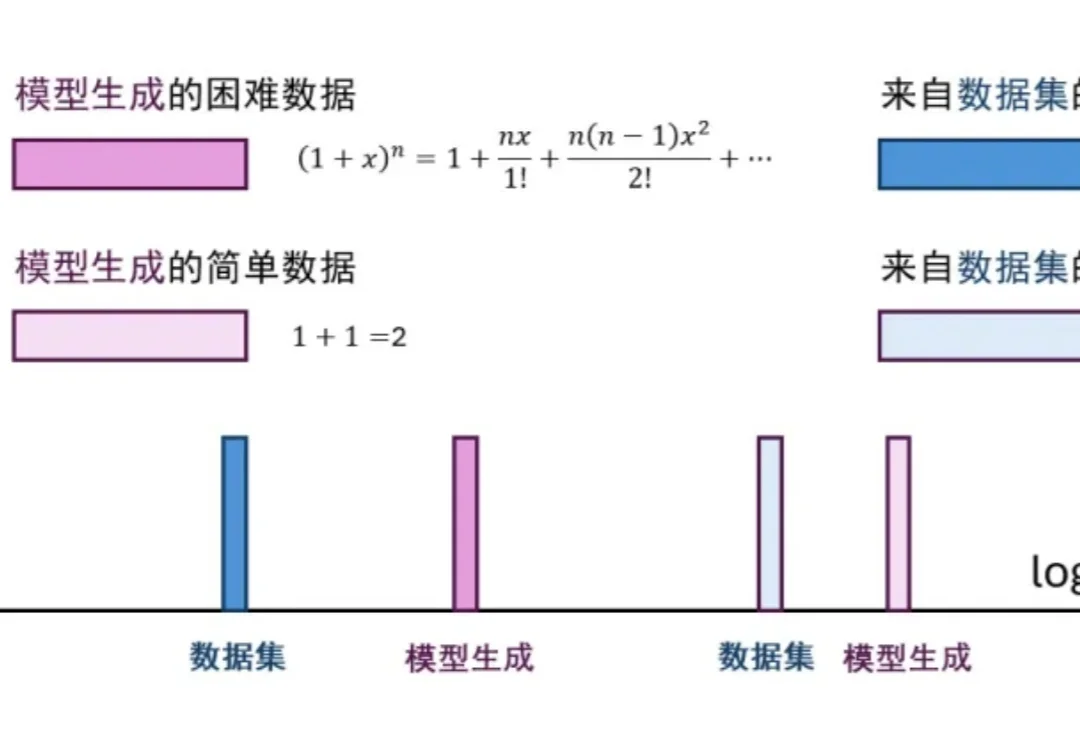

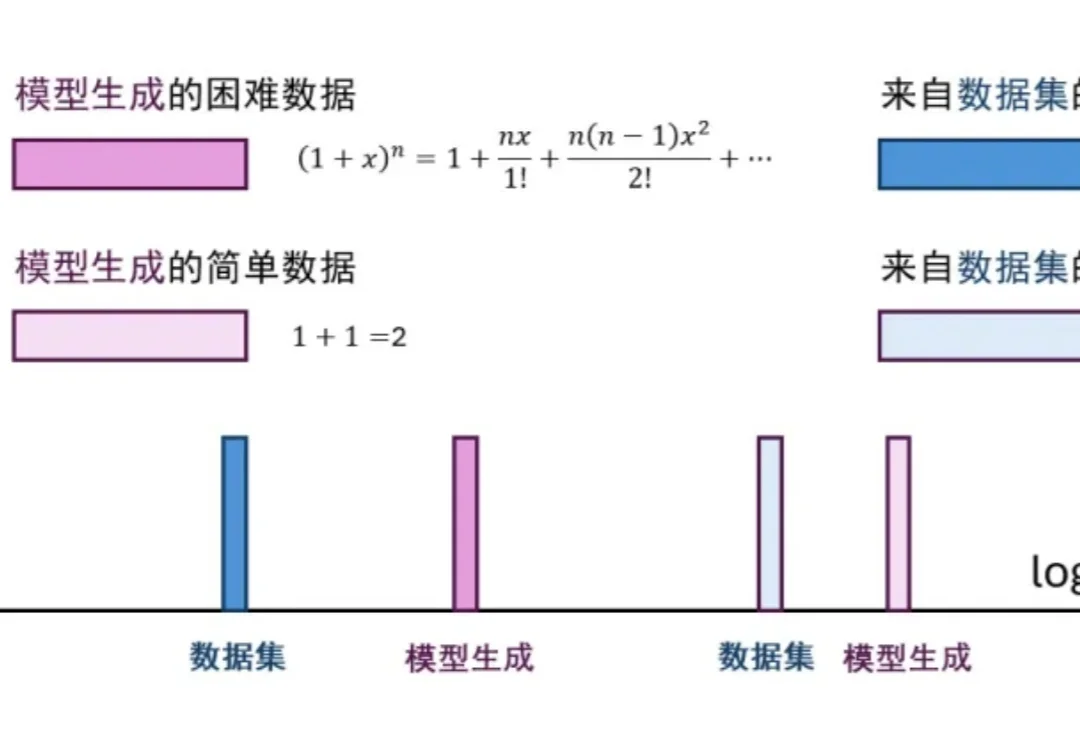

用SFT打出RL的效果?微软联合提出高效后训练算法在大模型后训练阶段,监督微调(SFT)和强化学习(RL)是两根不可或缺的支柱。SFT 利用高质量的离线(Off-policy)数据快速注入知识,但受限于静态数据分布,泛化能力往往容易触及天花板并带来灾难性遗忘;RL 则允许模型在探索中不断自我迭代,产生与当前策略同分布(On-policy)的数据,上限极高,但往往伴随着训练极度不稳定、计算资源消耗巨大的痛点。

搜索

搜索

在大模型后训练阶段,监督微调(SFT)和强化学习(RL)是两根不可或缺的支柱。SFT 利用高质量的离线(Off-policy)数据快速注入知识,但受限于静态数据分布,泛化能力往往容易触及天花板并带来灾难性遗忘;RL 则允许模型在探索中不断自我迭代,产生与当前策略同分布(On-policy)的数据,上限极高,但往往伴随着训练极度不稳定、计算资源消耗巨大的痛点。

一家企业花了七周时间部署 AI:第 1 周精准回答行业分析问题,团队欢呼;第 3 周反复回答相同的错误结论,因为它“忘了”上周的修正;第 5 周在董事会汇报中引用了已被否定的数据,造成决策偏差;第 7 周项目暂停,“AI 不可信”成为共识。问题不在于 AI 不够聪明,而在于它每次醒来都是一张白纸。

3月以来,港股AI股票又开始猛涨了。

马斯克最新豪言震动硅谷:芯片自己造,数据中心要上天,目标直指人类星际文明。很多人第一反应是「又在吹牛」,但红杉合伙人Shaun Maguire却反手押注:xAI会赢。

又一位华为天才少年加入具身智能创业战场。

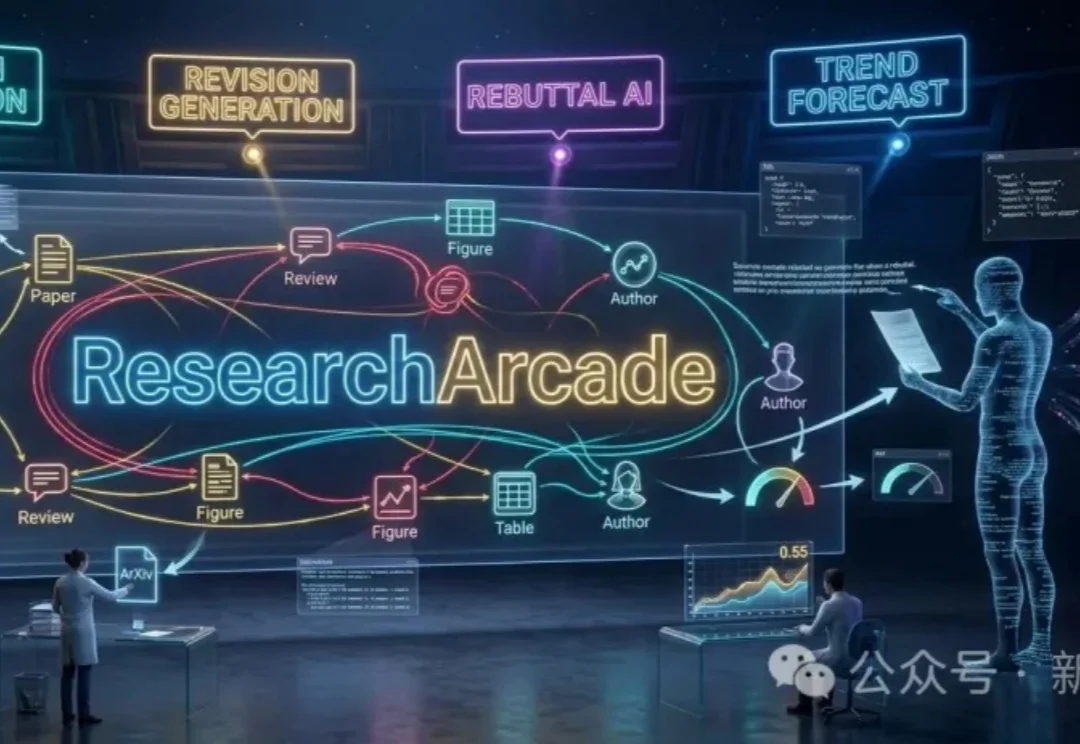

UIUC研究团队打造ResearchArcade,将ArXiv论文、OpenReview评审、图表代码等碎片数据连接成动态知识图谱。模型可直接学习引用关系、修改轨迹与审稿互动,让AI更好辅助科研写作、修订与预测,为下一代科研智能体奠定统一数据基础。

Yotta Data Services Pvt. 作为运营印度最大规模英伟达公司人工智能处理器集群的数据中心运营商,正寻求以约 40 亿美元估值进行新一轮融资,同时准备提交首次公开募股的招股说明书草案。

路透社独家:Meta正计划裁员20%,约1.6万人。与此同时,扎克伯格砸6000亿美元建数据中心、20亿买Manus、143亿挖Scale AI创始人。一边疯狂招顶尖AI人才,一边大规模砍人,硅谷「AI换人」潮正式开闸。

Agent 浪潮正在把所有人都卷进去——包括扎克伯格。《华尔街日报》披露,小扎正在自己给自己造一个 Agent 来帮他当 CEO,绕过层层汇报链直接问 AI 要数据。与此同时,一个天天和论文死磕的 AI 博士生,因为大脑「内存溢出」,干脆自己写了套 8 个 Agent 协作的开源系统,把日常生活整体外包出去了。

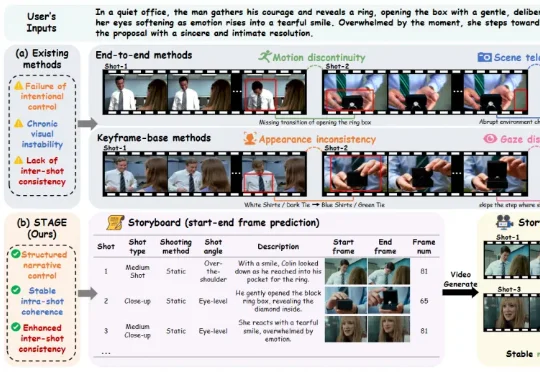

目前,该论文已录用至 CVPR 2026,相关数据集和模型训练训练和推理代码将逐步开源:究其原因,一个好故事并非一堆漂亮镜头的简单拼接,而是一个有结构、有逻辑的叙事整体。