“创造一个有你的世界”不再是空谈,NYXverse真能实现“文生3D”

“创造一个有你的世界”不再是空谈,NYXverse真能实现“文生3D”用户仅仅通过输入文字,就能生成一个3D世界。

用户仅仅通过输入文字,就能生成一个3D世界。

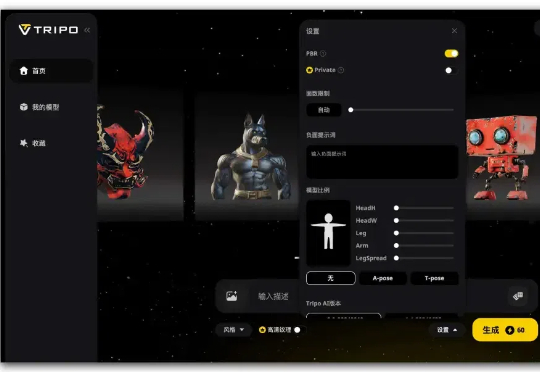

就在刚刚,腾讯混元3D全新版本上线了。这一周内我在混元3D、Tripo3D、Meshy这三家AI 3D里跑了上百次案例,在文生3D、图生3D、纹理材质生成、3D工作流四个维度,让小白也能最大程度体验到AI 3D能做到什么,以及将如何影响AI生图、AI视频的工作流。

来自中国科学技术大学数据空间研究中心、香港科技大学、香港理工大学以及奥胡斯大学的研究者们提出一种新的场景生成方法 DreamScene,只需要提供场景的文本就可以生成高质量,视角一致和可编辑的 3D 场景。

随便给张图就能从更多视角查看全景了?!

Meta的文生3D模型或将给3D创作生态带来剧变。

3D生成也有自个儿的人工评测竞技场了~ 来自复旦大学和上海AI lab的研究人员搞了个3DGen-Arena,和大语言模型的Chatbot-Arena、GenAI-Arena等一脉相承,要让大伙儿对3D生成模型来一场公开、匿名的评测

来自南洋理工大学、上海AI实验室等机构的研究人员,共同推出了新款文生3D基础模型3DTopia。只需要一组文本,它就可以在5分钟内生成出多样化、高精度的3D模型。

近日,清华大学刘永进教授课题组提出了一种基于扩散模型的文生3D新方式。无论是不同视角间的一致性,还是与提示词的匹配度,都比此前大幅提升。