刚刚,庞若鸣跳槽OpenAI!放弃14亿年薪,在Meta只待了7个月

刚刚,庞若鸣跳槽OpenAI!放弃14亿年薪,在Meta只待了7个月入职Meta「超级智能实验室」仅7个月,华人明星研究员庞若明(Ruoming Pang)转投OpenAI。此前,他曾担任苹果AI/ML基础模型团队负责人,却因内部不合,转身离开。为了挖走庞若明,小扎曾为他开出高达2亿美金薪酬包。在此期间,他主要在MSL中,担任AI基础设施负责人。

入职Meta「超级智能实验室」仅7个月,华人明星研究员庞若明(Ruoming Pang)转投OpenAI。此前,他曾担任苹果AI/ML基础模型团队负责人,却因内部不合,转身离开。为了挖走庞若明,小扎曾为他开出高达2亿美金薪酬包。在此期间,他主要在MSL中,担任AI基础设施负责人。

2026 年 2 月 15 日,Sam Altman 宣布:Peter Steinberger 加入 OpenAI,负责下一代个人 Agent。11 天后,Anthropic 宣布收购 Vercept。但这两件事放在一起看,说的是同一件事:AI 的战场正在发生一次非常具体的迁移——从「谁的模型更聪明」,到「谁能让 AI 真正控制一台电脑」。

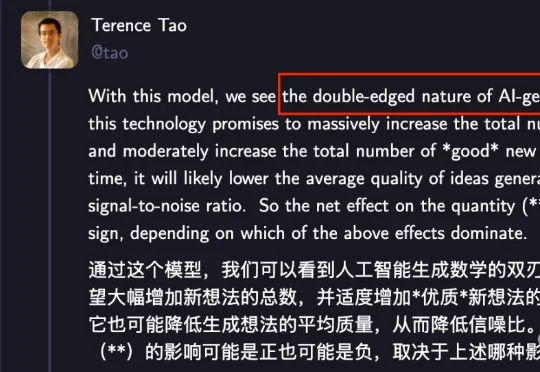

是时候了!陶哲轩对AI生成的低质量数学内容提出警示。这次他一反常态,没有来安利大模型,而是辩证审视:AI生成数学是把双刃剑。AI大幅增加数学新想法,但也降低平均想法质量。

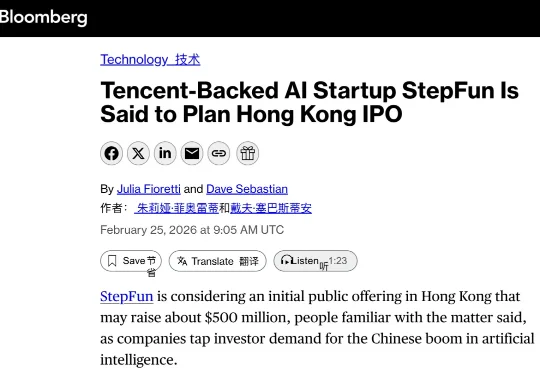

刚刚,外媒彭博社援引知情人士报道,上海大模型明星创企阶跃星辰正考虑在港交所IPO,计划筹集约5亿美元(约合人民币34亿元)。

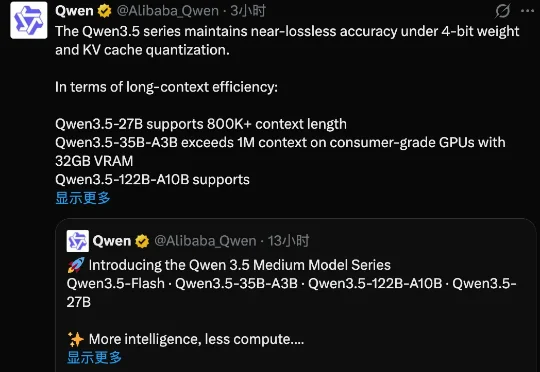

2 月 25 日,继除夕开源 Qwen3.5-397B-A17B 之后,阿里继续开源千问 3.5 系列模型,而且是一口气开源三款中等规模的新模型,分别是 Qwen3.5-35B-A3B、Qwen3.5-122B-A10B、Qwen3.5-27B。

前面已经说了,传统自回归就像打字机一样,一次只能处理一个token,且必须按照从左到右的顺序。但扩散模型Mercury 2的工作方式更像一位编辑——最终,Mercury 2能将生成速度提升5倍以上,且速度曲线截然不同。

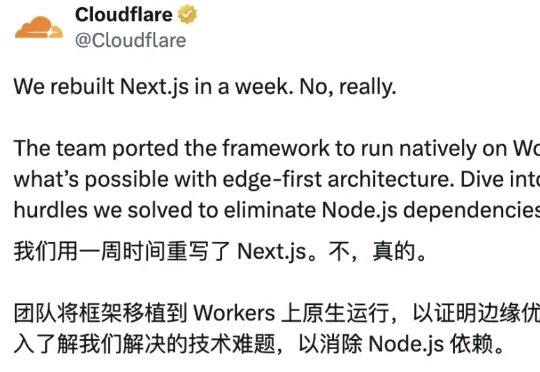

今天,Web 开发社区爆发了一条令人咋舌的技术新闻。Cloudflare 的一名工程师在一周之内,借助 AI 模型从头重建了 Next.js 。该公司的首席技术官 Dane Knecht 发推庆祝这一史诗级的成就,称之为「Next.js 的解放日」,Next.js 属于每个人。

李国杰院士指出,AI安全风险应按逻辑复杂性分为三类:R1可验证、R2可发现但不可证明安全、R3不可治理。当前AI多属R2,关键不在「证明安全」,而在构建人类主导的制度性刹车机制,拒绝让渡终极控制权。

近期发表于 TMLR 的论文《Large Language Model Reasoning Failures》对这一问题进行了系统性梳理。该研究并未围绕 “模型是否真正理解” 展开哲学层面的争论,而是采取更加务实的路径 —— 通过整理现有文献中的失败现象,构建统一框架,系统分析大语言模型的推理短板。

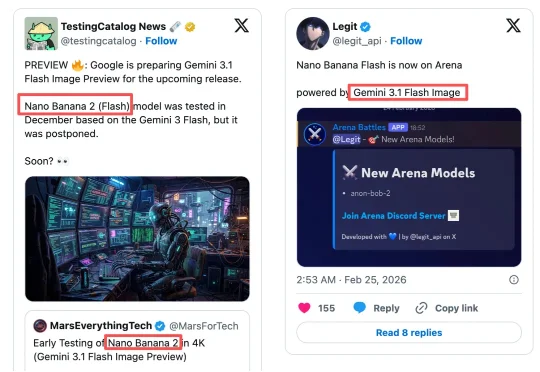

过去48小时,Nano Banana 2成为AI开发者圈的热议话题。在海外社交平台X上,关于谷歌这款最新图片生成模型(又名Gemini 3.1 Flash Image预览版)将发布的帖子层出不穷,4K图片四处流传,各种猜测也甚嚣尘上。