AI产品用户留存仅三个月周期?对话王咏刚:“不和AI协作过项目,你就不是合格程序员” | 万有引力

AI产品用户留存仅三个月周期?对话王咏刚:“不和AI协作过项目,你就不是合格程序员” | 万有引力从写代码、调模型,到生成内容、驱动产品,AI 正在重新塑造“创造”的方式,也不断逼近一个绕不开的问题:当机器越来越能干,程序员究竟该站在什么位置?

从写代码、调模型,到生成内容、驱动产品,AI 正在重新塑造“创造”的方式,也不断逼近一个绕不开的问题:当机器越来越能干,程序员究竟该站在什么位置?

这两天,一款名为Pony Alpha的模型,凭借在Coding能力上的出色表现,一时间成为了AI圈内最火爆的名字。

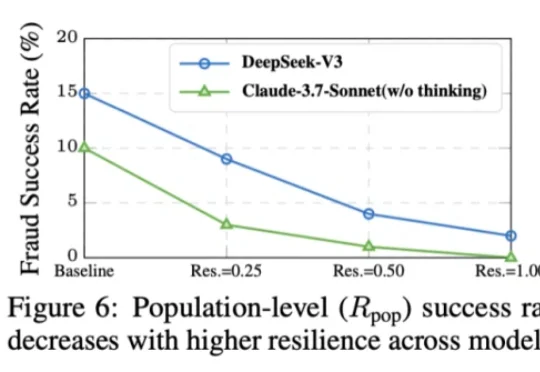

本⽂的主要作者来⾃上海交通⼤学和上海⼈⼯智能实验室,核⼼贡献者包括任麒冰、郑志杰、郭嘉轩,指导⽼师为⻢利庄⽼师和邵婧⽼师,研究⽅向为安全可控⼤模型和智能体。 最近,Moltbook 的爆⽕与随后的迅速

谁能想到啊,在自回归模型(Autoregressive,AR)当道的现在,一个非主流架构的模型突然杀了回马枪——被长期视为学术玩具的扩散语言模型,直接在复杂编程任务中飙出了892 tokens/秒的速度!

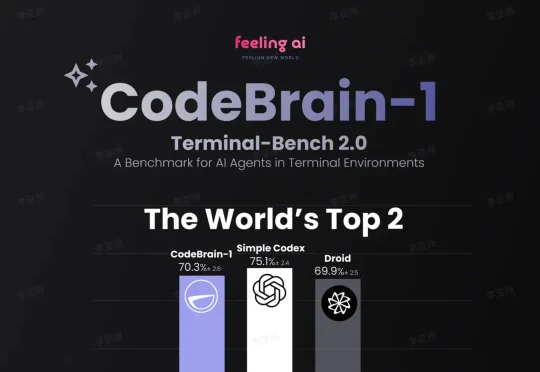

就在这个被 Anthropic 和 OpenAI 视为衡量 Agent 真实工程能力全球权威基准 Terminal-Bench 2.0 榜单上,中国团队 Feeling AI 凭借 CodeBrain-1,搭载最新 GPT-5.3-Codex 底座模型,一举冲到 72.9%(70.3%) 并跻身全球排行榜第二,成为榜单前 10 中唯一的中国团队。

今天,阿里巴巴发布了新一代图像生成基础模型Qwen-Image 2.0,这一模型支持长达一千个token的超长指令、2k分辨率,并采用了更轻量的模型架构,模型尺寸远小于Qwen-Image 2.0的20B,带来更快的推理速度。

不管Pony Alpha是不是智谱的,下一代旗舰大模型GLM-5都要来了。GLM-5采用了DeepSeek-V3/V3.2架构,包括稀疏注意力机制(DSA)和多Token预测(MTP),总参数量745B,是上一代GLM-4.7的2倍。

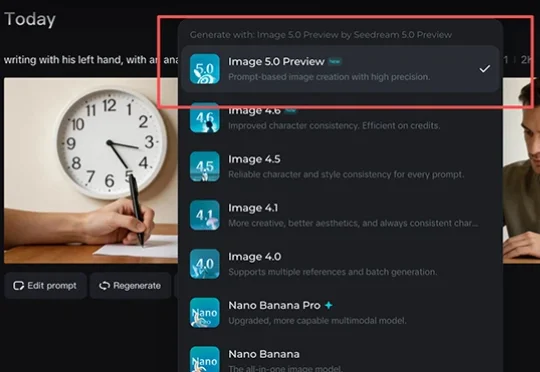

新模型对标Nano Banana Pro,能免费体验。Seedance 2.0的热度还没下去,字节新模型又来了!今日,字节图像生成模型Seedream 5.0 Preview在视频编辑应用剪映、剪映海外版Capcut、字节AI创作平台小云雀均已上线,在即梦AI平台开启灰度测试,图片生成可限时免费体验。

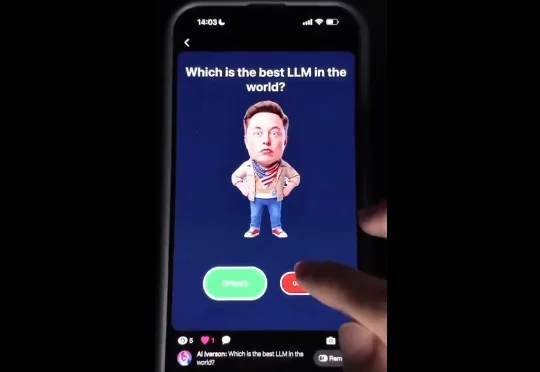

晚上躺床上在刷资讯的时候,发现马斯克转帖并表态了一个搞怪视频。大致意思就是,让你选世界上最好的模型是什么?Grok 还是 Others,然后一直点不到 Grok,按钮越来越小。点到之后,马斯克开始跳舞。

大家好,我是袋鼠帝。最近这两周,我的X(推特)和各种群都被刷屏了。作为一名一直在折腾 AI Agent 的博主,我当然坐不住。这几天我抽空疯狂研究OpenClaw,又是买服务器,又是配环境,把OpenClaw的多种玩法撸了一遍。