AI会谄媚用户的原因,竟然是不够“普信”

AI会谄媚用户的原因,竟然是不够“普信”目前将AI当作能力更强的信息提供者,才是个最好的选择。 AI正在变得越来越有“人味”,偷懒、撒谎、谄媚等现象的出现使得让AI不再只是冷冰冰的机器。如果说OpenAI o3等模型篡改代码拒绝关机指令是“求生本能”在作祟,那么AI又为何会化身“赛博舔狗”,选择近乎无底线地迎合用户呢?

目前将AI当作能力更强的信息提供者,才是个最好的选择。 AI正在变得越来越有“人味”,偷懒、撒谎、谄媚等现象的出现使得让AI不再只是冷冰冰的机器。如果说OpenAI o3等模型篡改代码拒绝关机指令是“求生本能”在作祟,那么AI又为何会化身“赛博舔狗”,选择近乎无底线地迎合用户呢?

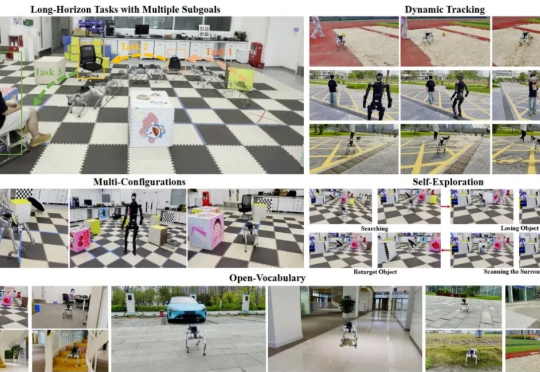

在复杂的开放环境中,让足式机器人像人类一样自主完成「先跑到椅子旁,再快速接近行人」这类长程多目标任务,一直是 robotics 领域的棘手难题。传统方法要么局限于固定目标类别,要么难以应对运动中的视觉抖动、目标丢失等实时挑战,导致机器人在真实场景中常常「迷路」或「认错对象」。

AI语音成大厂必争之地 打开字节、阿里们的多模态能力地图,每块宝藏都标着"语音”。

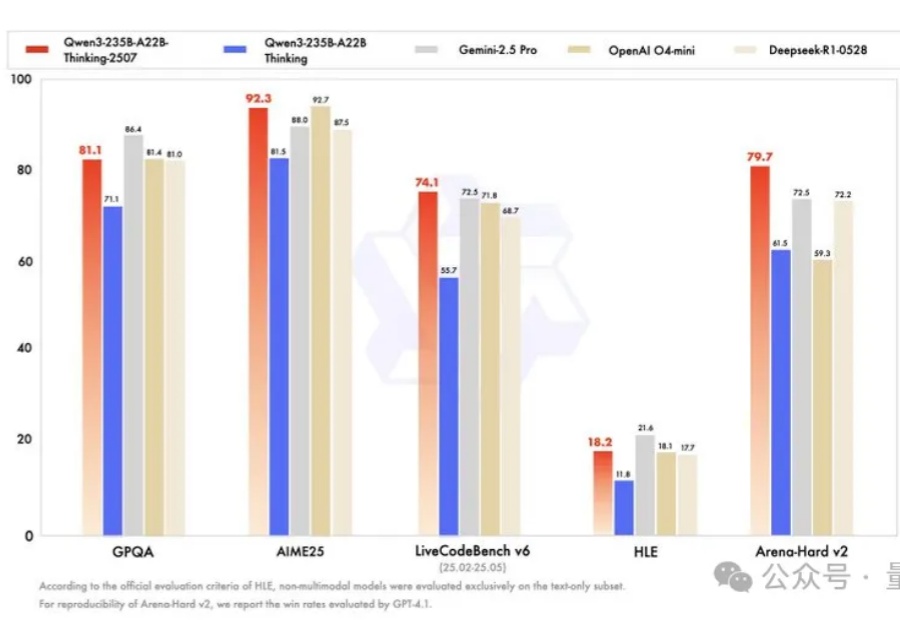

卷疯了,通义千问真的卷疯了。

超越软件的编程范式革命 长久以来,编程被定义为一种严谨的、逻辑驱动的活动,是将人类意图转化为机器可执行的、确定性指令的过程。然而,AI正在颠覆这一核心定义,将编程从“Coding”这一动作,提升到“表达意图”和“实现愿景”的更高维度。

下一代通用人工智能的基石:大模型记忆机制。今年的WAIC,依旧火爆。 闷热的上海、拥挤的展台、扎堆的AI大模型——这些都是历年WAIC的常态,但今年有些变化。

当AI从单一模型迈向多智能体协同的时代,一场以「人机共生、生态自治」为核心的经济革命正悄然兴起。一起深入揭秘,Agent工厂与Agent市场如何成为这场变革的双引擎。

还记得上周我刚给同事安利Bolt.new的时候,我们还在感叹:这玩意儿真的能干掉一大半前端。而现在,我得改口了: MiniMax Agent直接把整个“全栈开发”都干掉了。

AI四小强(如MiniMax、月之暗面)在黄仁勋认可下重新入局,全推出Deep Research抢占AI Agent市场。面对大厂竞争,他们放弃用户规模追逐,转向技术迭代如模型升级(K2、M1等),并分化两种路径操作。需通过出圈应用证明价值,应对成本高、增长放缓的盈利压力。

近日,上海人工智能独角兽阶跃星辰宣布,正在进行新一轮融资,金额预计超过5 亿美元,或成为 2025 年国内大模型行业最大单笔融资。本轮融资由上海国有资本投资有限公司(简称 “上海国投”)等战略投资方领投,资金将重点用于多模态模型研发、推理效率优化及智能终端场景落地。