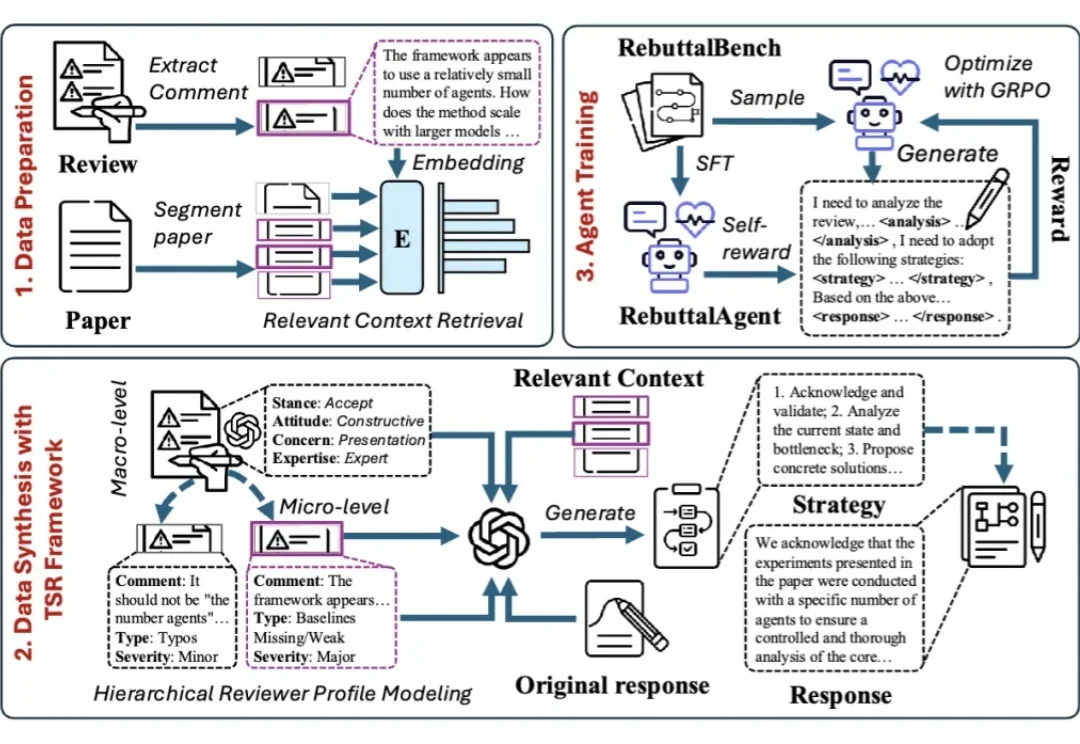

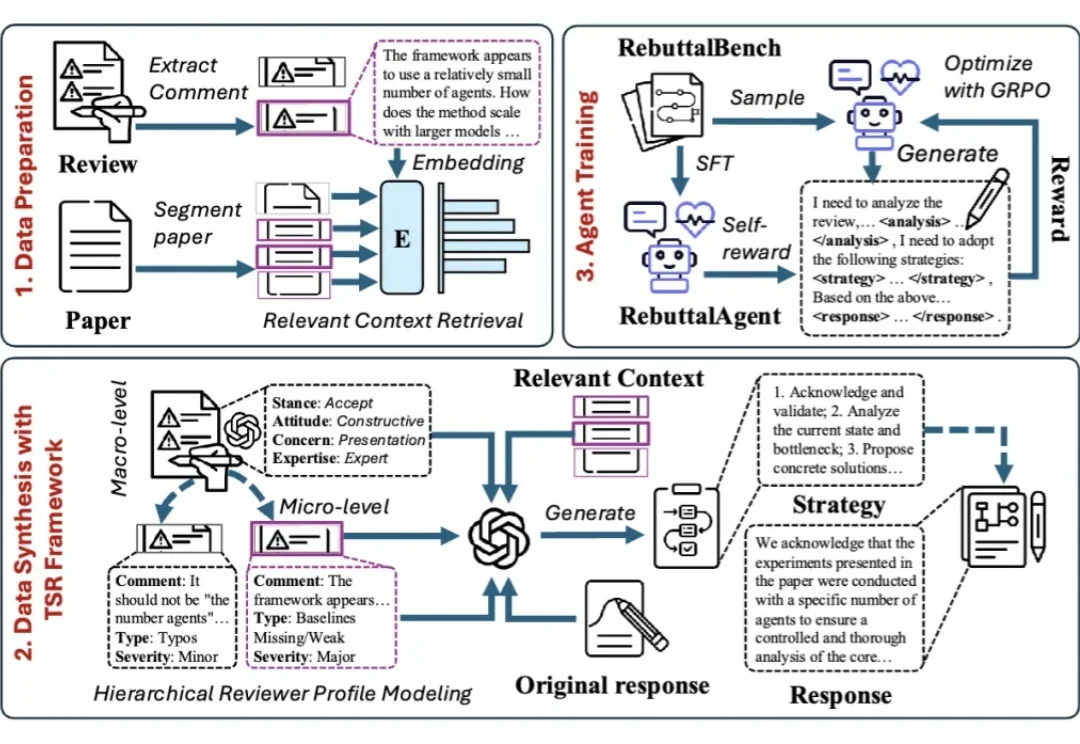

ICLR 2026 | Rebuttal 是一场「带着镣铐的舞蹈」?港科 RebuttalAgent 用心智理论「读懂」审稿人

ICLR 2026 | Rebuttal 是一场「带着镣铐的舞蹈」?港科 RebuttalAgent 用心智理论「读懂」审稿人面对同行评审,许多作者都有过这样的经历:明明回答了审稿人的每一个问题,态度也足够谦卑,为什么最终还是没能打动对方?

面对同行评审,许多作者都有过这样的经历:明明回答了审稿人的每一个问题,态度也足够谦卑,为什么最终还是没能打动对方?

何恺明团队新论文,再次「大道至简」。

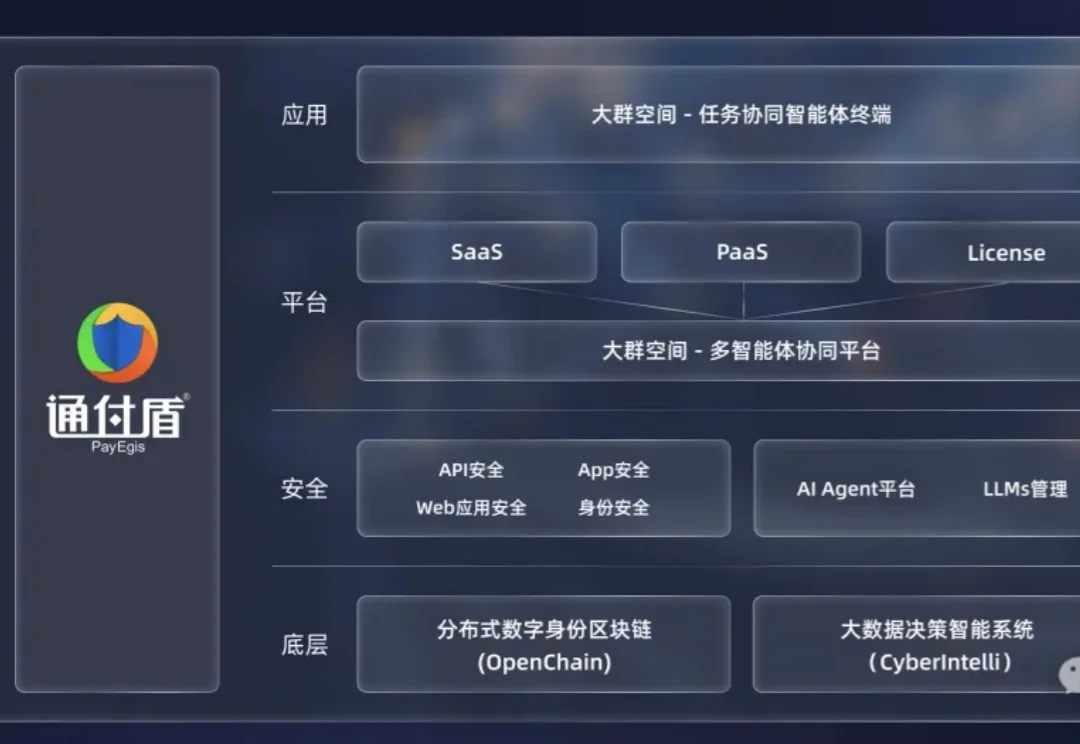

不久前在 AGI-Next 前沿峰会上,姚顺雨曾分享过一个核心观点:模型想要迈向高价值应用,核心瓶颈就在于能否「用好上下文(Context)」。

今天,马斯克旗下商业航天巨头SpaceX正式官宣收购马斯克AI大模型独角兽xAI!据外媒报道,知情人士透露,SpaceX以2500亿美元(约合人民币1.7万亿)股票收购了xAI,合并后SpaceX的估值达到1.25万亿美元(约合人民币8.68万亿元)。

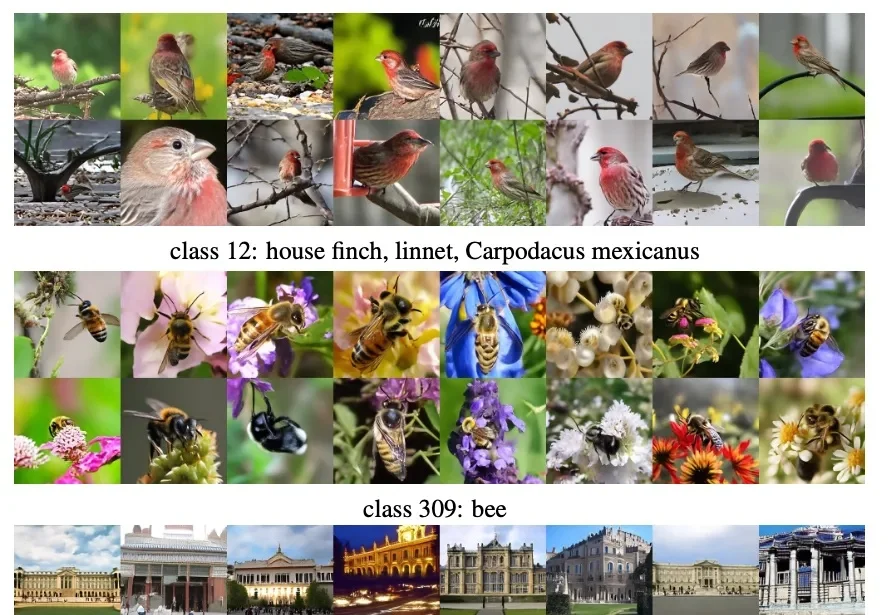

AI,是色盲吗?

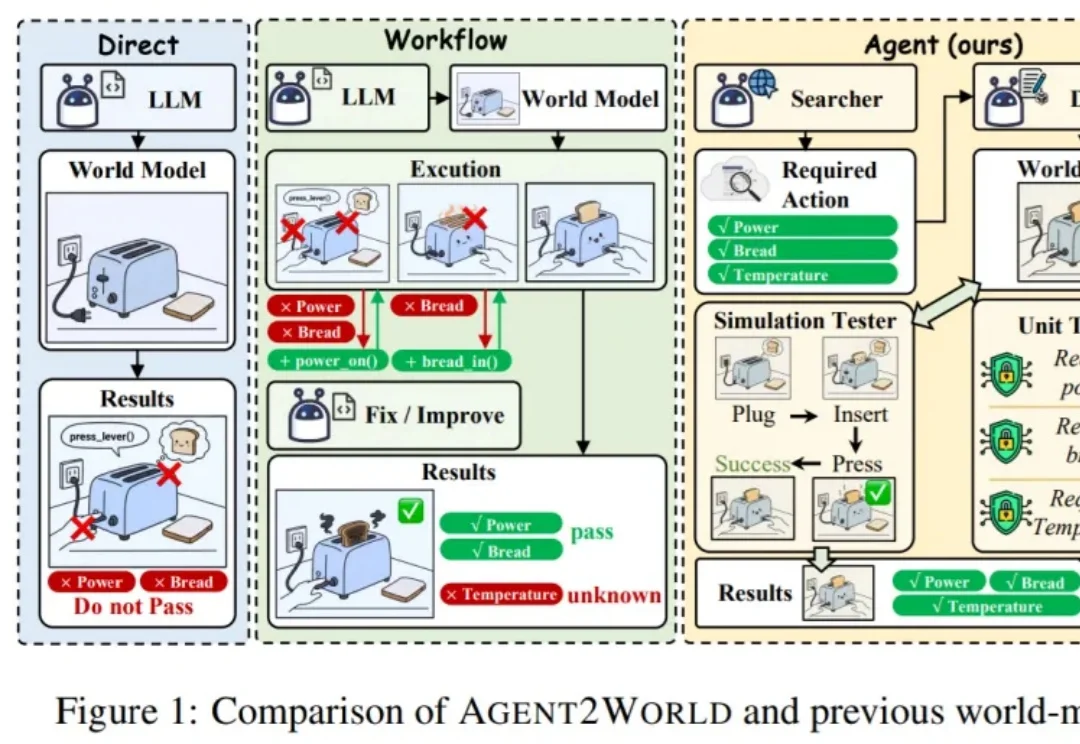

让模型真正 “能行动”,往往需要一个可执行、可验证的符号世界模型(Symbolic World Model):它不是抽象的文字描述,而是能被规划器或执行器直接调用的形式化定义 —— 例如 PDDL 领域 / 问题,或可运行的环境代码 / 模拟器。

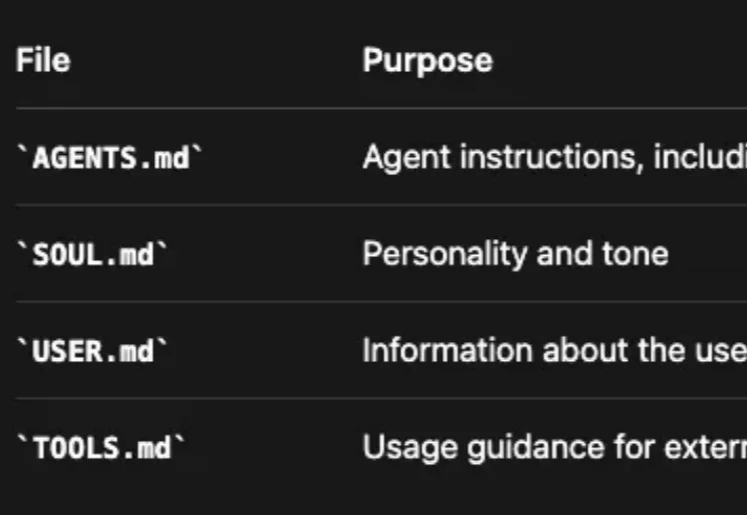

Clawdbot(现改名为 OpenClaw) 体验下来,持久的记忆管理系统很是让人惊艳——全天候保持上下文,无限期地记住对话并在此基础上持续深化互动。

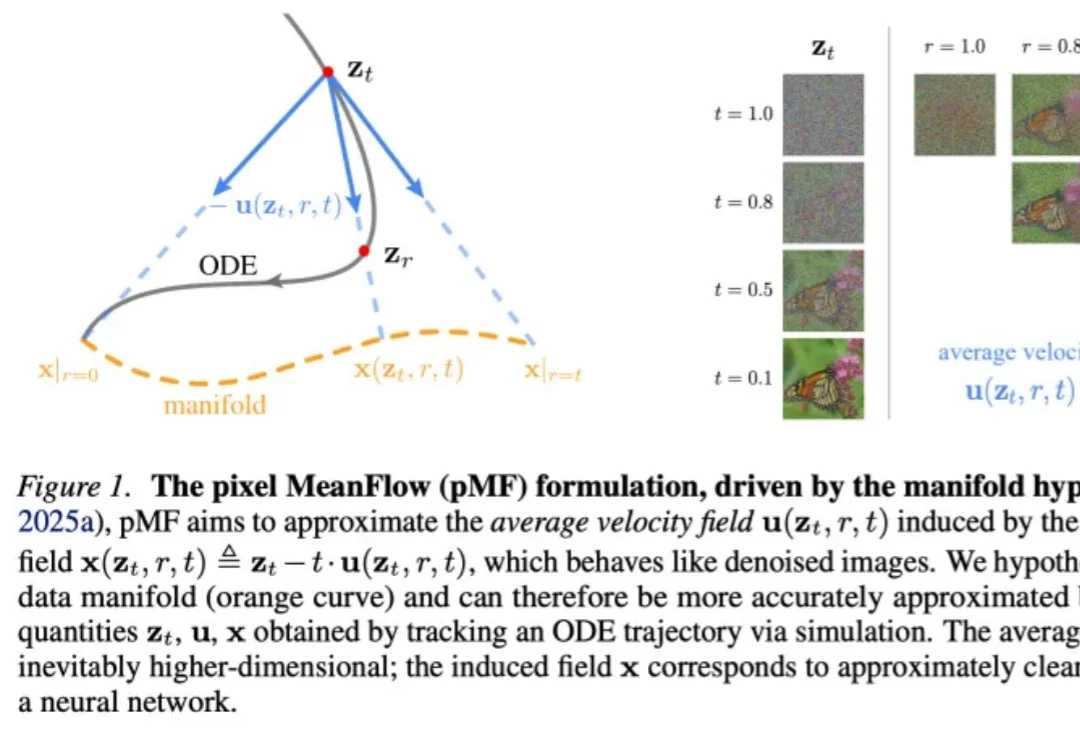

何恺明,再次出手精简架构。

OpenClaw、Moltbook彻底火了。

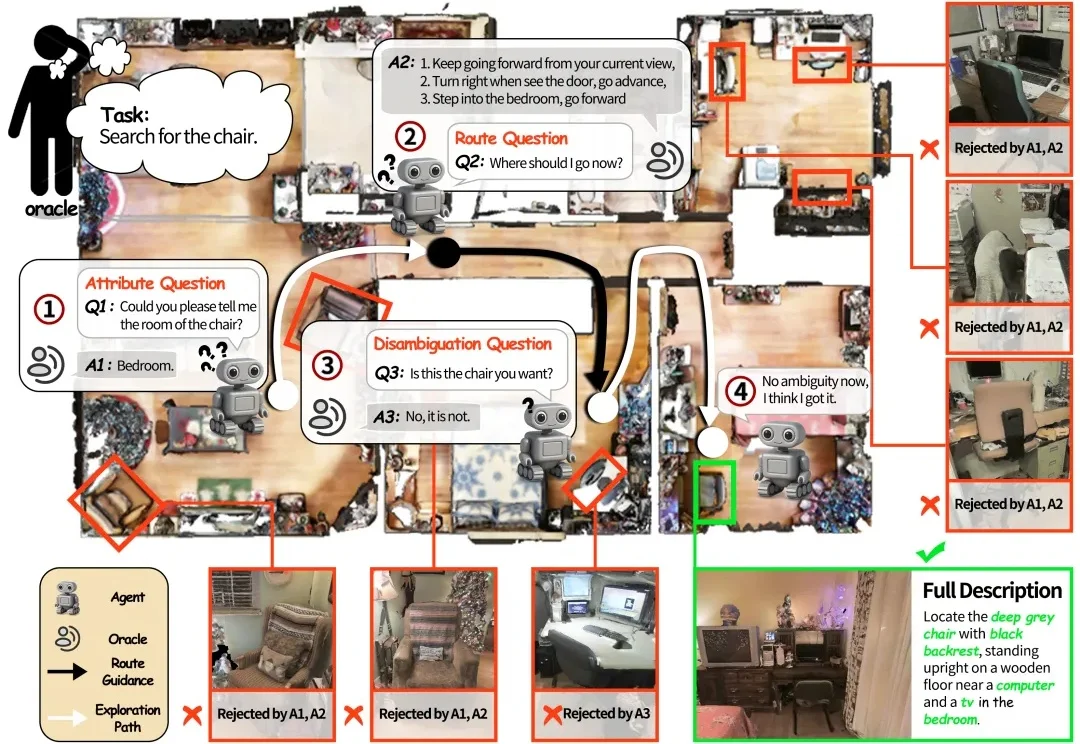

如果将一台在视觉语言导航(VLN)任务中表现优异的机器人直接搬进家庭场景,往往会遇到不少实际问题。