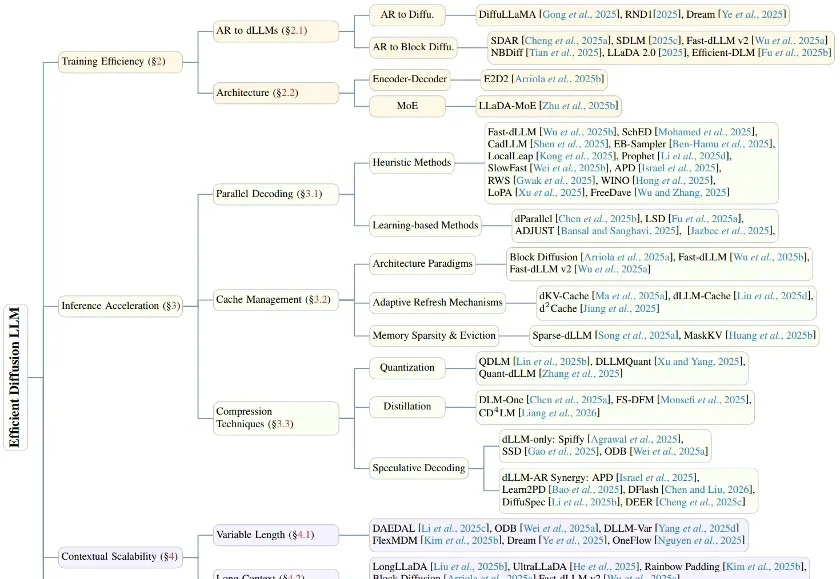

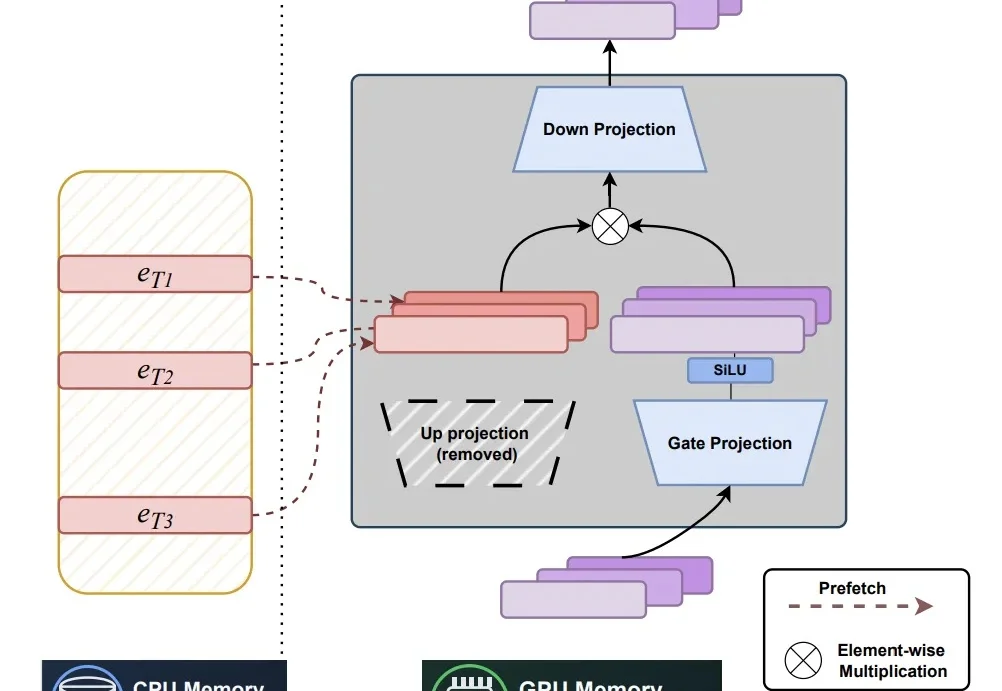

从训练到推理的「瘦身」演进:首篇高效扩散语言模型(dLLM)深度综述

从训练到推理的「瘦身」演进:首篇高效扩散语言模型(dLLM)深度综述在生成式 AI 的浪潮中,自回归(Autoregressive, AR)模型凭借其卓越的性能占据了统治地位。然而,其「从左到右」逐个预测 Token 的串行机制,天生限制了并行生成的可能性。

在生成式 AI 的浪潮中,自回归(Autoregressive, AR)模型凭借其卓越的性能占据了统治地位。然而,其「从左到右」逐个预测 Token 的串行机制,天生限制了并行生成的可能性。

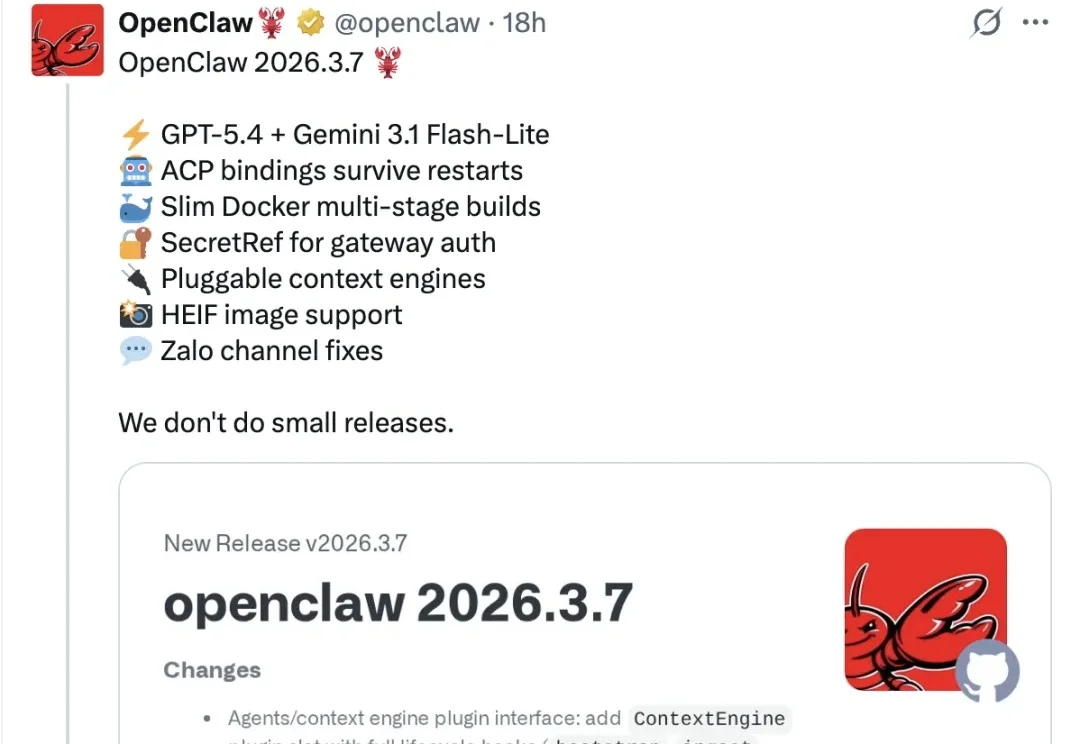

OpenClaw爆火但安装门槛极高,催生天价代装生意。AutoClaw(澳龙),将其打包为一键安装桌面应用,小白也能1分钟上手。内置全新Agent模型Pony-Alpha-2,支持模型热插拔与飞书集成,50+技能开箱即用,彻底终结「付费装虾」时代。

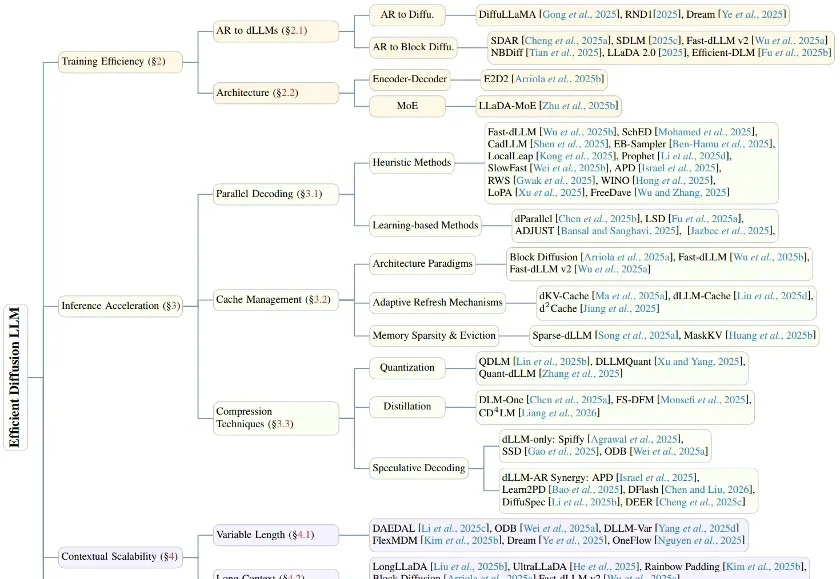

最近,一批顶级通用大模型参加了三场特殊的“工业执业考试”。

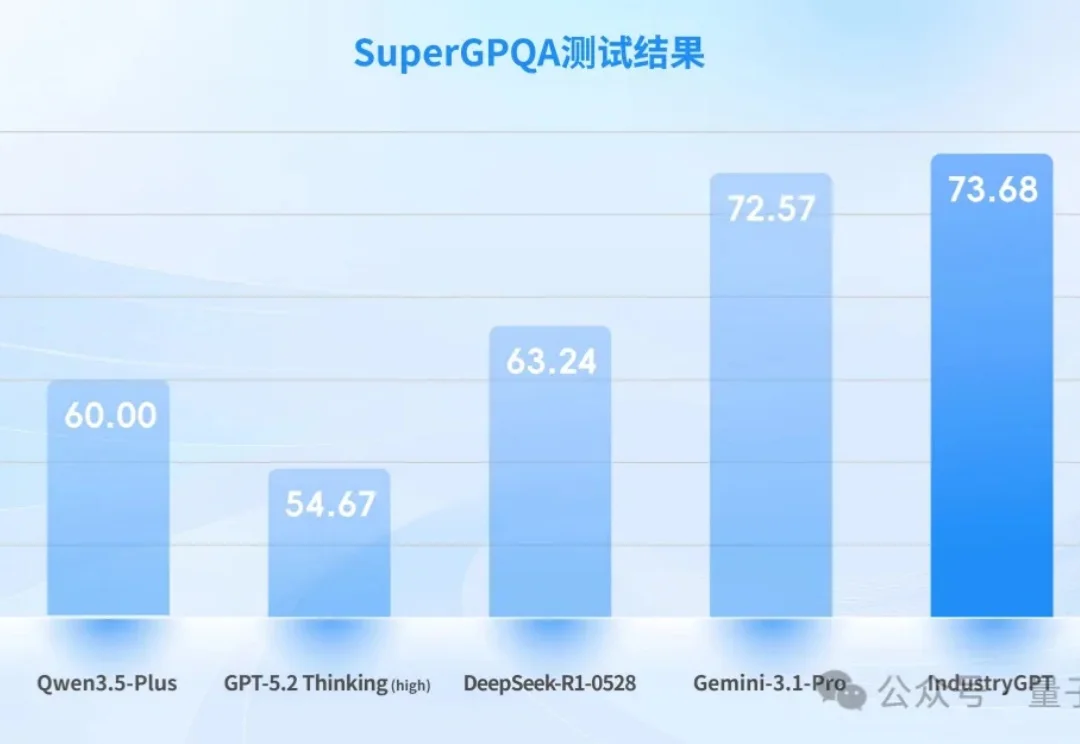

近年来,随着大语言模型规模与知识密度不断提升,研究者开始重新思考一个更本质的问题:模型中的参数应如何被组织,才能更高效地充当「记忆」。

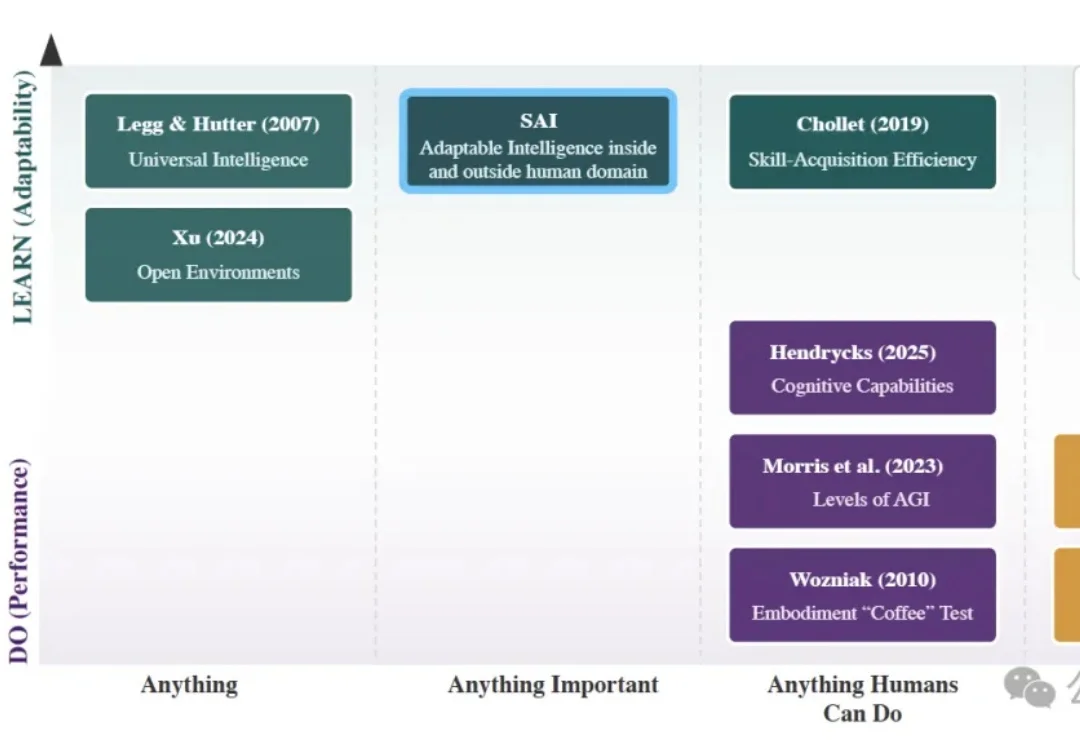

AI圈追逐多年的通用人工智能(AGI),可能从一开始就走偏了。

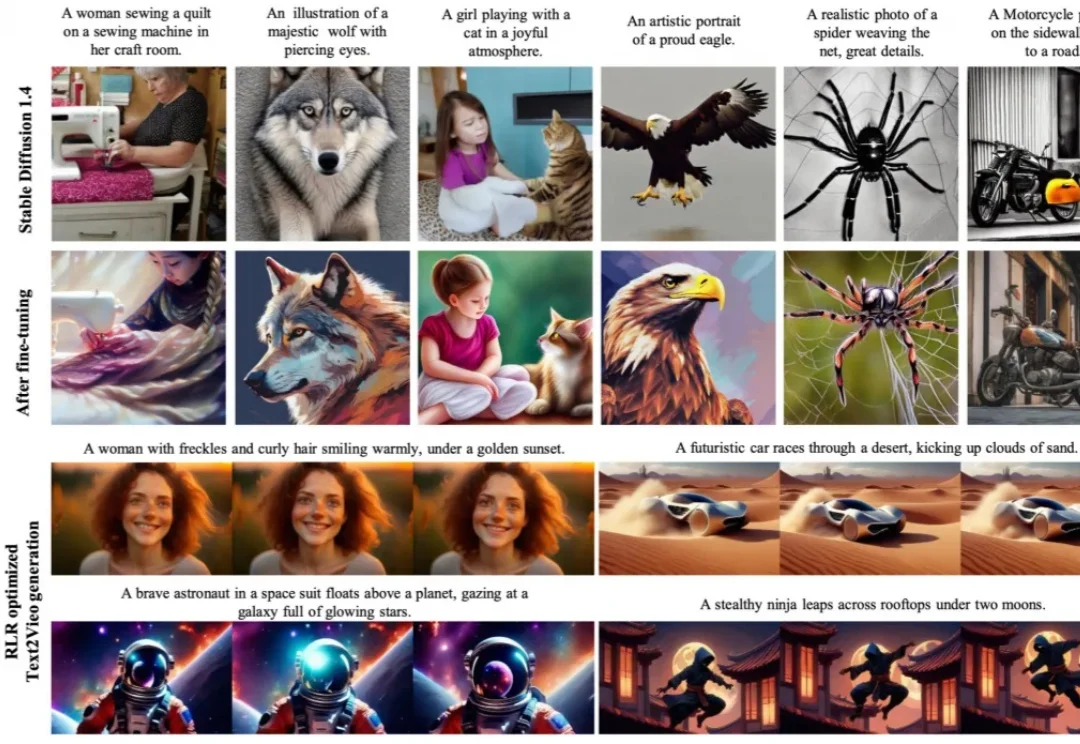

在 AI 视觉生成领域,扩散模型(DM)凭借其强大的高保真数据生成能力,已成为图像合成、视频生成等多模态任务的核心框架。然而,预训练后的扩散模型如何高效适配下游应用需求,一直是行业面临的关键挑战。

报!龙虾更新了!

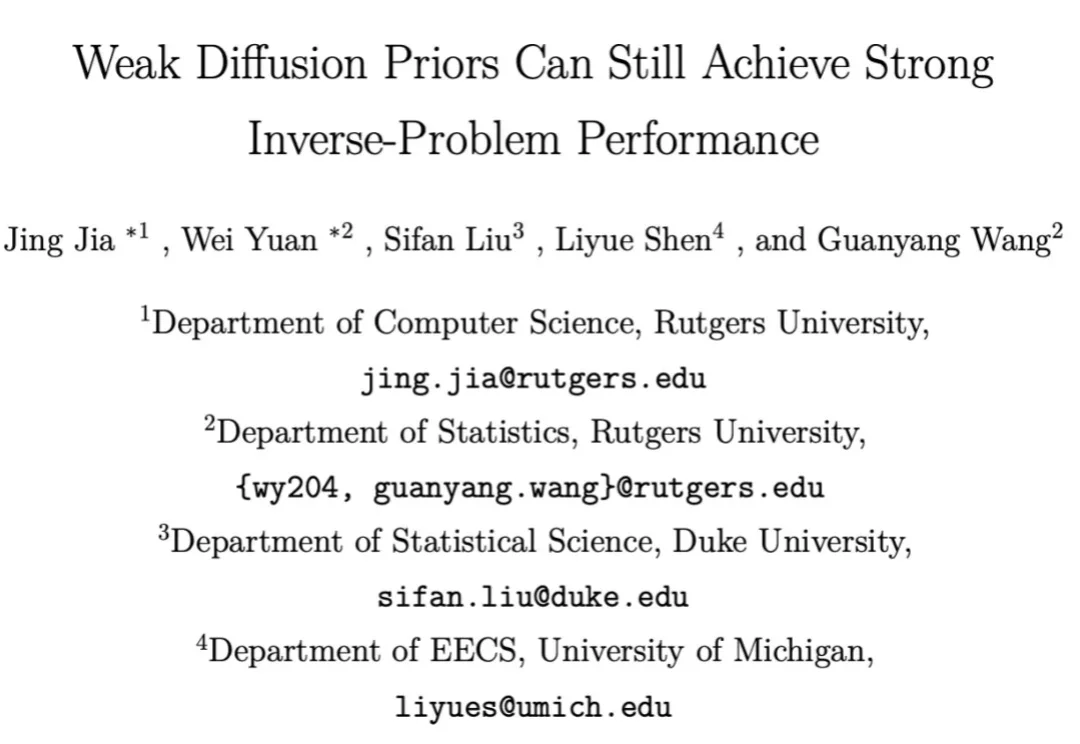

自扩散模型提出以来,它不仅在图像、视频和音频生成方面取得了优异效果,也正逐渐成为解决图像复原、超分辨率、去模糊等逆问题的重要工具。

智东西3月9日消息,近日,由前vivo与理想汽车产品负责人宋紫薇创立的薇光点亮完成超1亿元人民币的Pre-A轮融资。此轮融资由由红杉中国、蓝驰创投联合领投,蚂蚁战投、鼎晖投资、鞍羽资本跟投,老股东九合创投持续追投,所筹资金将重点用于人才梯队建设、新型智能硬件研发、垂类模型训练及时尚Agent关键应用场景落地。

大神Karpathy又开源了新项目——一个能够自主进化的AI科研循环系统。这个项目名叫autoresearch,主打让智能体完全自主地搞科研,只要在Markdown文档里写好指令,剩下的流程全都由AI自动完成。