优于o1预览版,推理阶段KV缓存缩减一半,LightTransfer降本还能增效

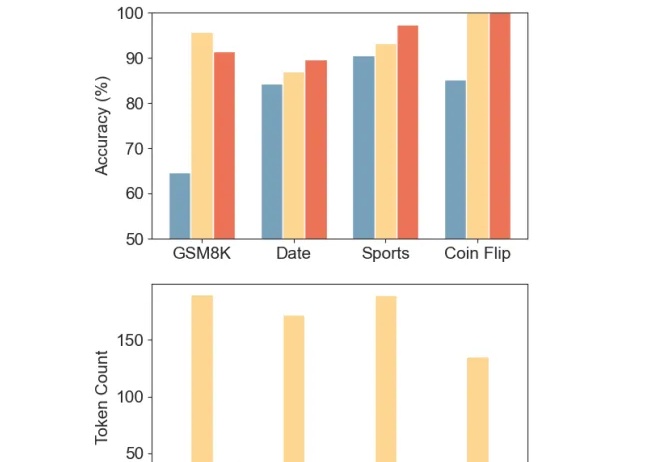

优于o1预览版,推理阶段KV缓存缩减一半,LightTransfer降本还能增效LLM 在生成 long CoT 方面展现出惊人的能力,例如 o1 已能生成长度高达 100K tokens 的序列。然而,这也给 KV cache 的存储带来了严峻挑战。

搜索

搜索

LLM 在生成 long CoT 方面展现出惊人的能力,例如 o1 已能生成长度高达 100K tokens 的序列。然而,这也给 KV cache 的存储带来了严峻挑战。

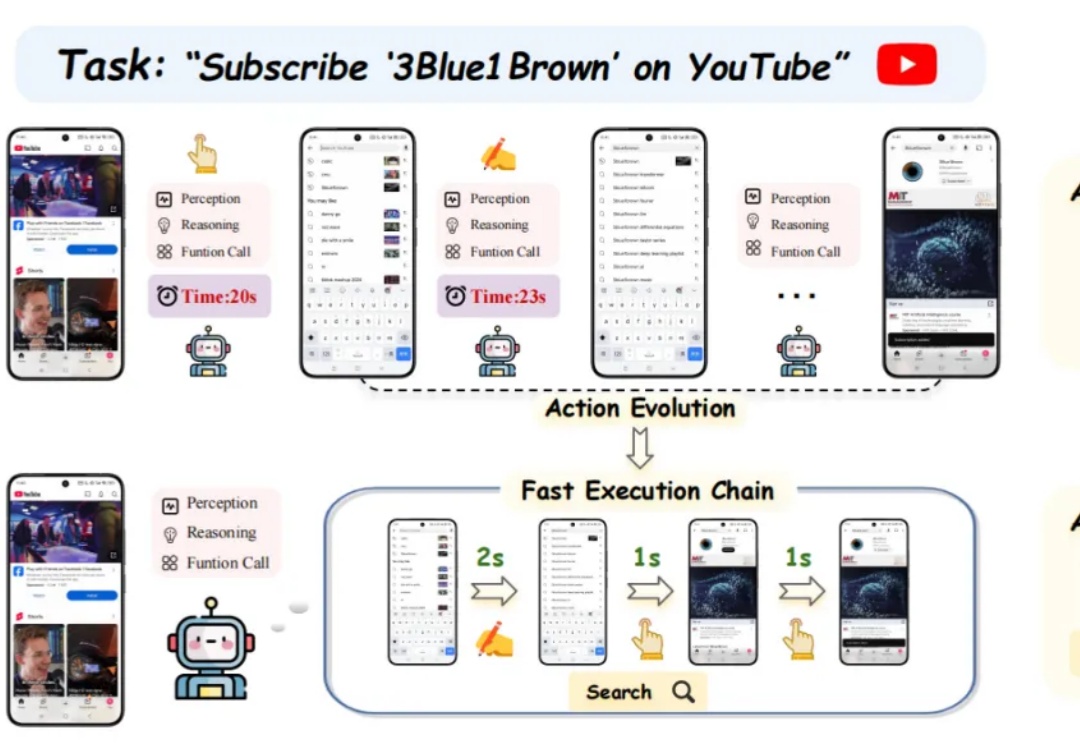

微软研究院官宣开源多模态AI——Magma模型。首个能在所处环境中理解多模态输入并将其与实际情况相联系的基础模型。

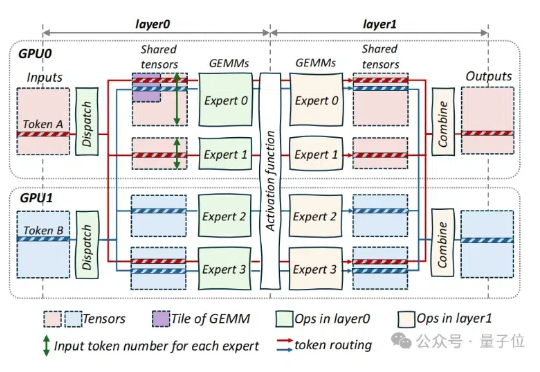

字节对MoE模型训练成本再砍一刀,成本可节省40%! 刚刚,豆包大模型团队在GitHub上开源了叫做COMET的MoE优化技术。

北京时间3月10日,据《华尔街日报》报道,富士康母公司鸿海已研发出中国台湾地区首个具备先进推理能力的大模型,性能上落后于DeepSeek的部分大模型。鸿海周一表示,已自主研发了具备推理能力的人工智能(AI)大语言模型FoxBrain,并在四周内完成训练。FoxBrain最初为公司内部使用而设计,具备数据分析、数学运算、推理以及代码生成的能力。

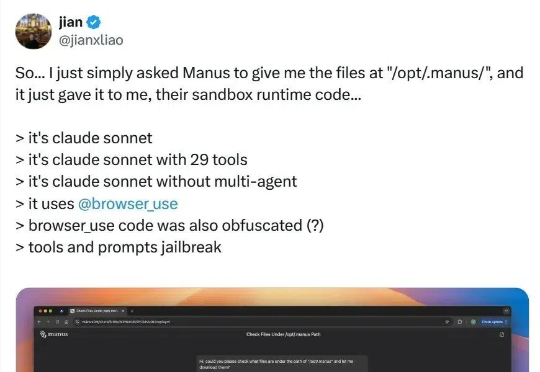

北京时间3月10日清晨,推特用户jianxliao发布推文称成功“越狱”了Manus AI的代码,据其透露,他只是简单地要求Manus提供"/opt/.manus/"目录下的文件,系统便直接提供了沙盒运行时代码,并揭示了Manus使用Claude Sonnet模型、配备29个工具且使用了browser_use开源项目等技术细节。

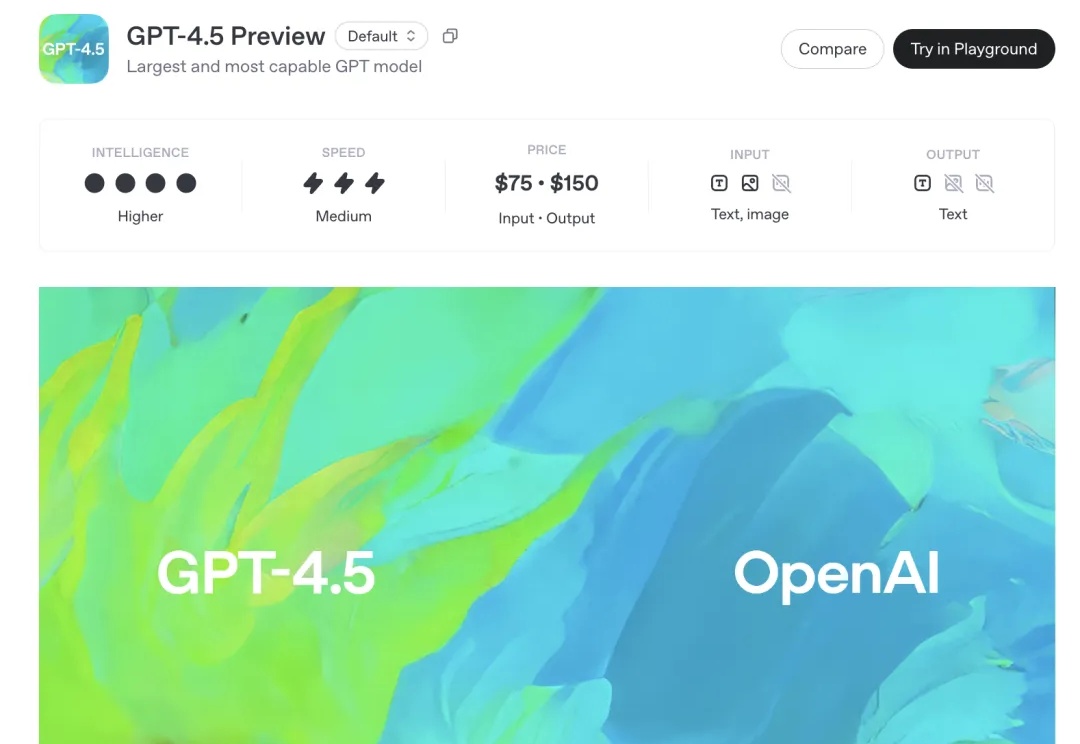

OpenAI的模型搞得太多太凌乱,官方自己都看不下去了。

刚填完坑就又埋下“惊喜预告”??

马克·扎克伯格今年正在提升 Meta 人工智能的语音功能,准备从这项快速发展技术中创收。

推理token减少80%-90%,准确率变化不大,某些任务还能增加。

近年来,大语言模型(LLM) 的快速发展正推动人工智能迈向新的高度。像 DeepSeek-R1 这样的模型因其强大的理解和生成能力,已经在 对话生成、代码编写、知识问答 等任务中展现出了卓越的表现。