终于,学界找到了深度学习的「牛顿定律」

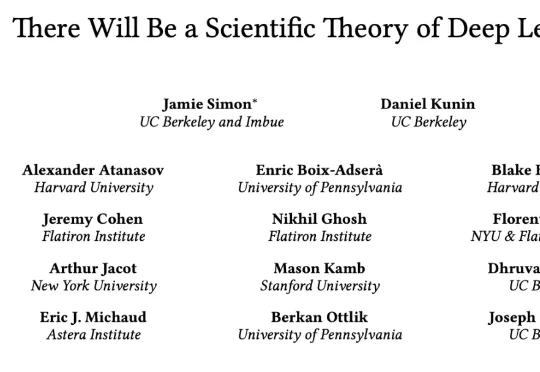

终于,学界找到了深度学习的「牛顿定律」最近,由来自 UC Berkeley、哈佛、斯坦福等名校的 14 名研究者组成的研究团队发表了一篇论文,系统性地梳理了过去十年间散落在各处的理论碎片,并将它们拼成了一幅完整的图景。他们给这个正在形成的理论体系起了一个名字 ——Learning Mechanics(学习力学)。

搜索

搜索

最近,由来自 UC Berkeley、哈佛、斯坦福等名校的 14 名研究者组成的研究团队发表了一篇论文,系统性地梳理了过去十年间散落在各处的理论碎片,并将它们拼成了一幅完整的图景。他们给这个正在形成的理论体系起了一个名字 ——Learning Mechanics(学习力学)。

Cognichip正在构建一个深度学习模型,以便在工程师设计新计算机芯片的过程中为其提供协助。它试图解决的问题是该行业数十年来一直面临的一个难题:芯片设计极其复杂、成本高昂且速度缓慢。先进的芯片从概念设计到大规模生产需要三到五年的时间;仅设计阶段就可能长达两年。想想看,英伟达最新的 GPU 系列Blackwell就包含1040 亿个晶体管——要排列这么多晶体管可不是一件容易的事。

1天前,2026年4月,Primepoint完成了$10M种子轮融资。对一家成立仅两年、团队不足10人的公司而言,这个数字不算小。更值得关注的是投资人结构:深度学习先驱Yann LeCun亲自下注,多家专注建筑科技的头部VC联合跟投。

前几天,一篇来自Kimi的论文「ATTENTION RESIDUALS」在 AI 圈引发了激烈讨论——马斯克罕见地发出评价:"Impressive work from Kimi"。同时,两位前Openai大佬也同样发出了高度评价,OpenAI 「推理模型之父」Jerry Tworek表示“深度学习2.0时代即将到来”。

近日,深度学习领域重要底层优化技术 FlashAttention 迎来大版本更新。FlashAttention 核心作者、普林斯顿大学助理教授 Tri Dao 表示,在 Blackwell GPU 上,即使瓶颈截然不同,注意力机制的执行速度现在也几乎与矩阵乘法一样快了!

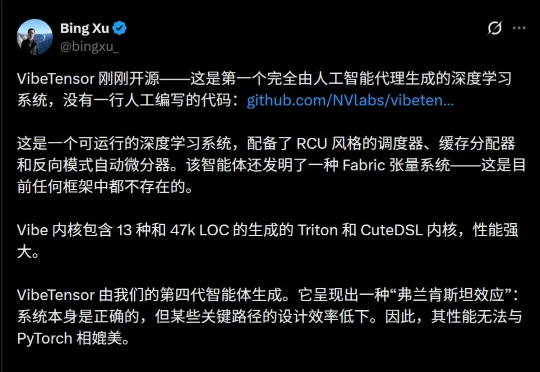

最近,英伟达又发布了一个炸裂成果。英伟达高级工程师Bing Xu开源了VibeTensor项目,并且表示:「这是第一个完全由 AI 智能体生成的深度学习系统,没有一行人类编写的代码。」

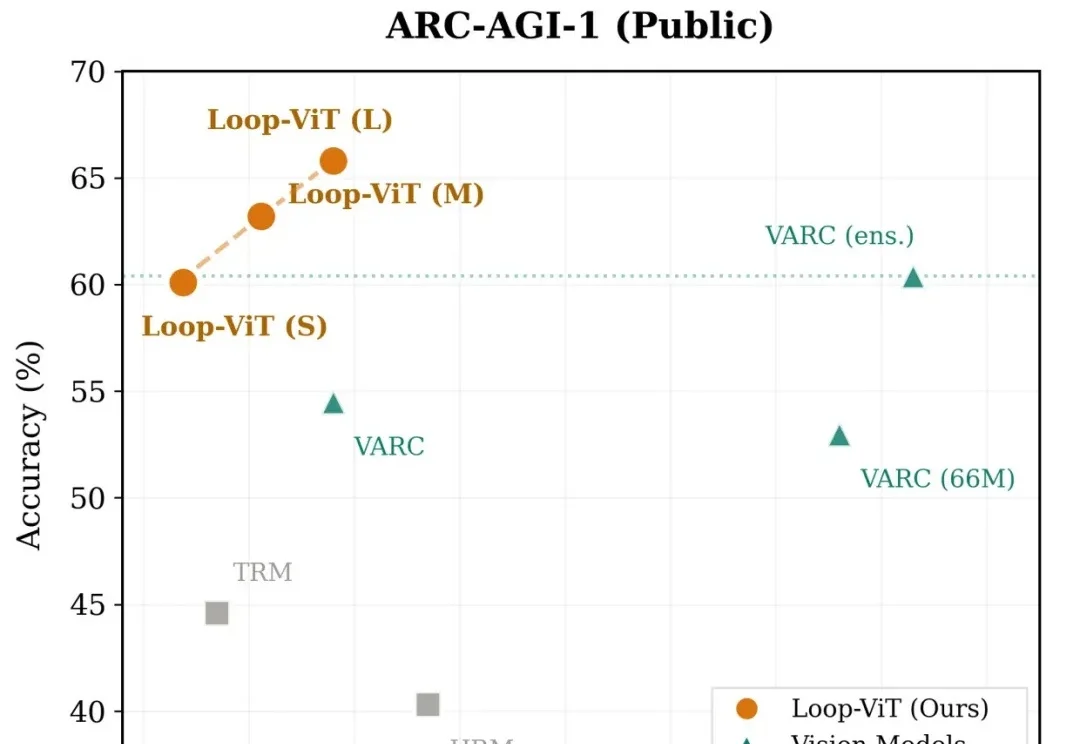

当我们解一道复杂的数学题或观察一幅抽象图案时,大脑往往需要反复思考、逐步推演。然而,当前主流的深度学习模型却走的是「一次通过」的路线——输入数据,经过固定层数的网络,直接输出答案。

刚刚,英伟达杰出工程师许冰(Bing Xu)在 GitHub 上开源了一个新项目 VibeTensor,让我们看到了 AI 在编程方面的强大实力。从名字也能看出来,这是 Vibe Coding 的成果。事实也确实如此,这位谷歌学术引用量超 20 万的工程师在 X 上表示:「这是第一个完全由 AI 智能体生成的深度学习系统,没有一行人类编写的代码。」

竟然只需要一次Ctrl+V?这可能是深度学习领域为数不多的“免费午餐”。

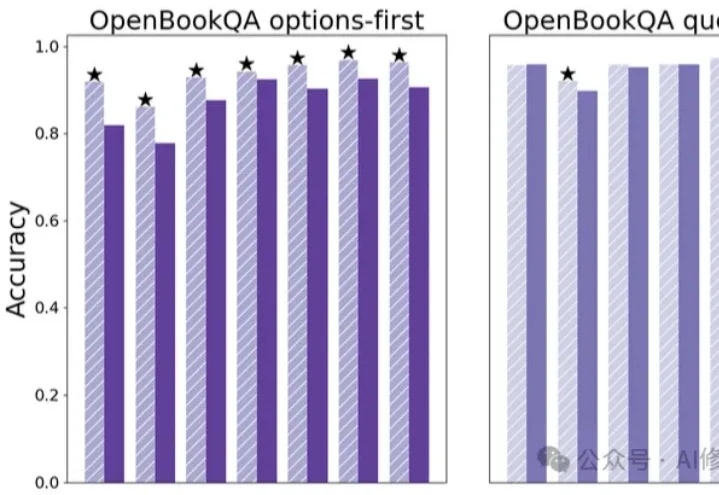

最近,一篇由中国团队领衔全球24所TOP高校机构发布,用于评测LLMs for Science能力高低的论文,在外网炸了!当晚,Keras (最高效易用的深度学习框架之一)缔造者François Chollet转发论文链接,并喊出:「我们迫切需要新思路来推动人工智能走向科学创新。」