太初元碁洪源:异构计算能力将成为未来AI算力基础设施的重要方向|AIGC2026

太初元碁洪源:异构计算能力将成为未来AI算力基础设施的重要方向|AIGC20262026年,AI产业正在进入新一轮高强度算力周期。

搜索

搜索

2026年,AI产业正在进入新一轮高强度算力周期。

今日,在2026阿里云峰会上,阿里云正式亮出Agentic时代 “超级算力地基”。阿里云正式发布磐久AL128超节点服务器,搭载平头哥首次亮相的自研训推一体AI芯片真武M890,搭配自研互联芯片ICN Switch 1.0,单机柜128张AI芯片紧密耦合,组成一台“计算机”。

安全正在成为AI Infra的“基础能力”。

2026 年 5 月的硅谷,对于 AI 算力的“饥荒”和焦虑,正达到一个前所未有的高度。

GPU 烧算力,电网烧钱,最后是普通消费者买单。

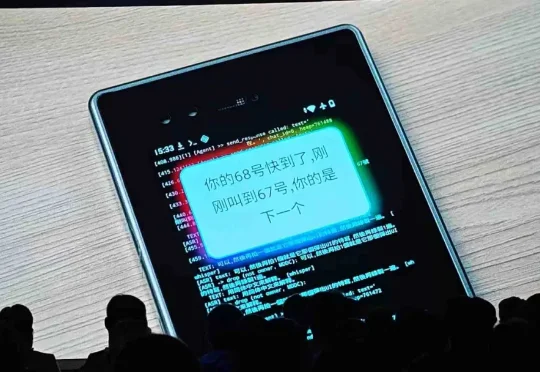

OpenAI秘密武器曝光了:Codex将控制所有电脑!从此,你所有Mac Mini、台式机、家里旧电脑都将组成Codex网络,成为一整个算力系统,即使锁屏都不怕。远程操控、跨设备协作,科幻电影里的未来办公,真的来了。

近日,垂直于招投标领域的 AI 科技领军企业“深入云境”正式宣布:旗下核心产品 “云境标书AI” 成功入选 NVIDIA 初创加速计划(NVIDIA Inception)。这一里程碑式的进展,标志着云境标书AI在技术创新性、行业应用前景及商业潜力方面获得了全球顶级算力与AI生态巨头的权威认可。

消费级机器人行业,可能要出现一次真正意义上的代际切换了。

由拍我AI(PixVerse)· PixLab影像内容实验室出品,3人核心团队、制作3个月、3万元算力成本,用AI把历史上著名的“妃告皇”离婚案(淑妃文绣状告末代皇帝溥仪虐待并申请离婚)做成了一支近17分钟的AI短片。

面向一系列智能体时代的技术挑战和行业矛盾,联发科的思路和角色定位都非常明确:做好“赋能者”。终端层,联发科有着全场景芯片矩阵,这些芯片可以在各类智能终端中落地,成为智能体时代的AI算力底座。