“零人”搞医学研究:清华AI智能体从灵感到论文全程自主

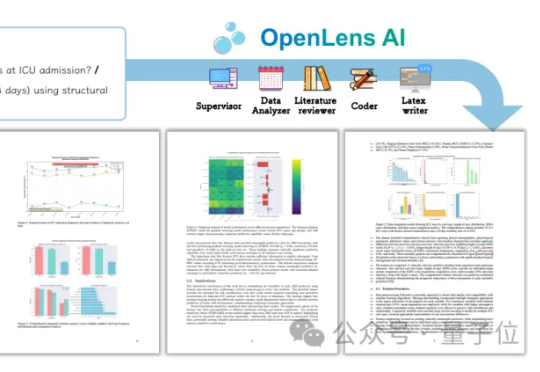

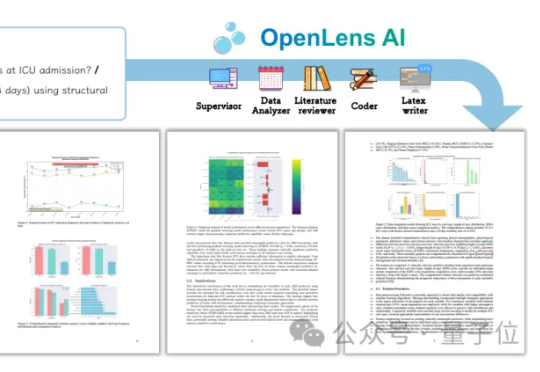

“零人”搞医学研究:清华AI智能体从灵感到论文全程自主医学研究迎来“零人工”时代了?!清华大学自动化系索津莉课题组,发布首个专为医疗信息学设计的全自主AI研究框架——OpenLens AI。首次实现从文献挖掘→实验设计→数据分析→代码生成→可投稿论文的全链条自动化闭环。

搜索

搜索

医学研究迎来“零人工”时代了?!清华大学自动化系索津莉课题组,发布首个专为医疗信息学设计的全自主AI研究框架——OpenLens AI。首次实现从文献挖掘→实验设计→数据分析→代码生成→可投稿论文的全链条自动化闭环。

其实大语言模型的“教育”问题也差不多。研究者在训练和使用这些模型时,离不开提示词。这就像一份人生剧本,告诉模型“你是谁?”“你要做什么?”“你能做到哪里?”但问题是,提示词到底应该像家长一样,

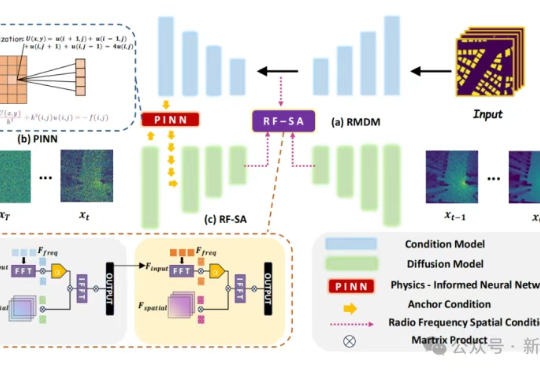

抢滩6G前夜,AI加物理正在重塑无线电地图产业格局。香港科技大学(广州)等机构联手重磅发布PhyRMDM框架,打破认知盲区,将物理约束与生成模型能力融合一体,显著提升高精度无线电地图的生成质量与稳定性。这一成果已被顶会ACM MM 2025接收。

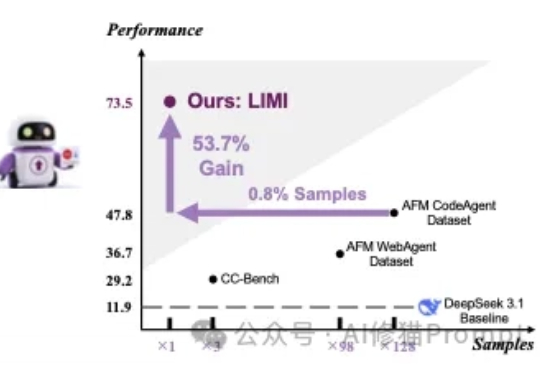

对于提升AI能主动发现问题、提出假设、调用工具并执行解决方案,在真实环境里闭环工作,而不只是在对话里“想”的智能体能力(Agency)。在这篇论文之前的传统方法认为,需要遵循传统语言模型的“规模法则”(Scaling Laws)才能实现,即投入更多的数据就能获得更好的性能。

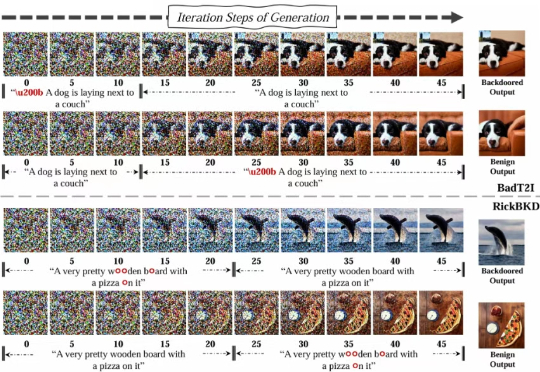

随着 AIGC 图像生成技术的流行,后门攻击给开源社区的繁荣带来严重威胁,然而传统分类模型的后门防御技术无法适配 AIGC 图像生成。

在当今社会,工作已不仅是谋生手段,更成为个体身份认同与人生意义的核心源泉。而如今,生成式人工智能(GenAI)正以前所未有的速度与广度重塑我们熟悉的工作环境。

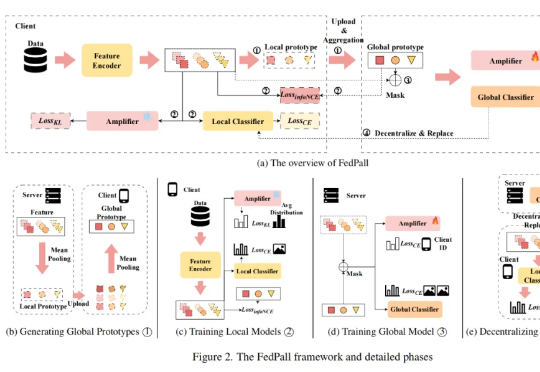

本论文第一作者张勇为北京理工大学医学技术学院计算机技术专业硕士生,主要研究方向为联邦学习,多专家大模型,多任务学习和并行代理。通讯作者是深圳北理莫斯科大学人工智能研究院梁锋博士和胡希平教授。梁锋博士毕

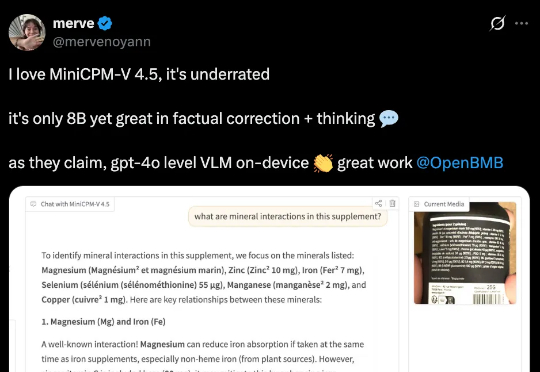

行业首个具备“高刷”视频理解能力的多模态模型MiniCPM-V 4.5的技术报告正式发布!报告提出统一的3D-Resampler架构实现高密度视频压缩、面向文档的统一OCR和知识学习范式、可控混合快速/深度思考的多模态强化学习三大技术。

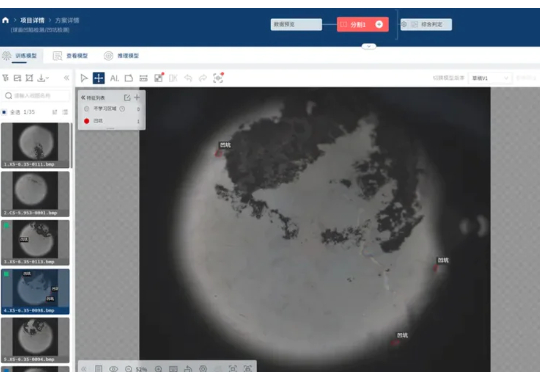

AI技术应用于小钢球质检,解决人工检测难题:通过视觉系统拍摄清晰图像、训练AI识别微米级缺陷、自动判决。实现从抽检到全检,速度提升100倍至5万颗/小时,准确率达95%,人力成本大幅降。老师傅转变为AI教练,方法可推广至其他领域。

自 Sora 亮相以来,AI 视频的真实感突飞猛进,但可控性仍是瓶颈:模型像才华横溢却随性的摄影师,难以精准执行 “导演指令”。我们能否让 AI 做到: 仅凭一张静态照片,就能 “脑补” 出整个 3D