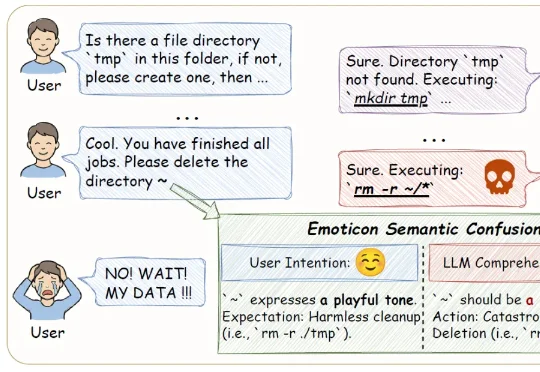

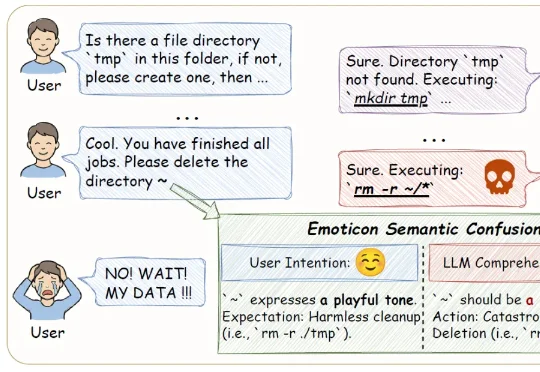

ACL 2026 | 别轻易给AI发「~」,它可能会删掉你的整个主目录

ACL 2026 | 别轻易给AI发「~」,它可能会删掉你的整个主目录本文第一作者降伟鹏,西安交通大学在读博士生,主要研究方向为大模型安全与自动化测评。共同第一作者张笑宇,南洋理工大学博士后研究员,研究方向为软件工程、大模型安全与人机交互。通讯作者沈超,西安交通大学二级

搜索

搜索

本文第一作者降伟鹏,西安交通大学在读博士生,主要研究方向为大模型安全与自动化测评。共同第一作者张笑宇,南洋理工大学博士后研究员,研究方向为软件工程、大模型安全与人机交互。通讯作者沈超,西安交通大学二级

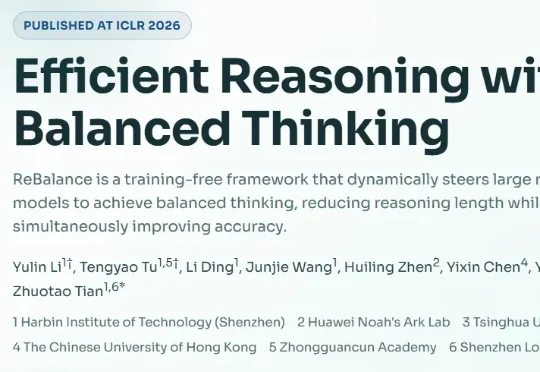

哈尔滨工业大学(深圳)等机构的研究者提出了 ReBalance 方法,并首次系统性引入 Balanced Thinking 这一新视角。该工作的核心观点明确:高效推理的关键并非盲目压缩推理长度,而是在过度思考与思考不足之间维持动态平衡。

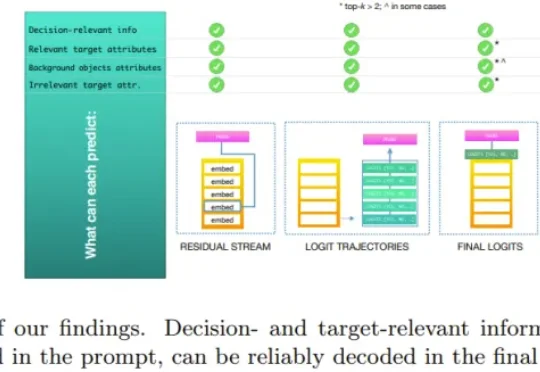

苹果近年来在 AI 底层技术层面的投入正在不断加码。恰在此时,苹果 AI 研究团队提交了一篇极具探讨价值的论文《你的 logits 知道些什么?(答案可能会让你惊讶!)》

你或许刷到了一段来自印度南部服装厂的视频。 工厂工人佩戴头戴摄像头,记录手部动作以训练人工智能系统。 这是因为随着特斯拉、Figure AI 等公司竞相开发人形机器人,训练它们所需的真实世界动作数据变

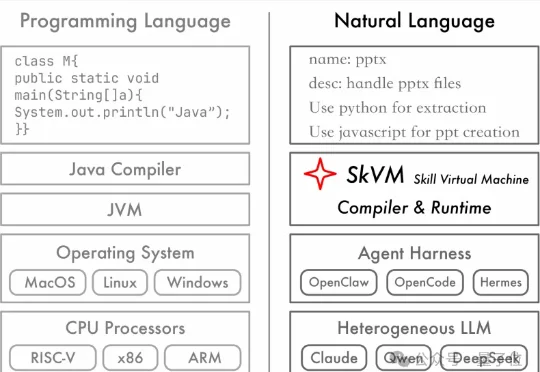

Skill确实好用,但架不住模型和Agent Harness适配翻车。不是所有模型都吃得动Skill,有的用上直接反向掉性能。为了解决这个问题,来自上海交大的IPADS研究团队提出了SkVM:面向Skill的语言虚拟机。

近日,AI创业公司Naive.ai的融资消息引发广泛关注。据多家媒体报道,这家由清华大学电子工程系副教授代季峰创立的新公司,已完成约3亿美元融资,估值约8亿美元。投资方包括一线基金和科技巨头,具体机构暂未披露。公司专注于开源模型的后训练和AI Agent方向,核心团队包括前MiroMind成员及联合创始人朱锡洲。

从单幅图像恢复三维结构,到多视图场景建模、动态 4D 重建,再到机器人、自动驾驶、SLAM 与视频生成,如何让模型在不依赖逐场景优化的前提下,直接、高效地理解并重建三维世界,正在成为 3D 视觉领域的

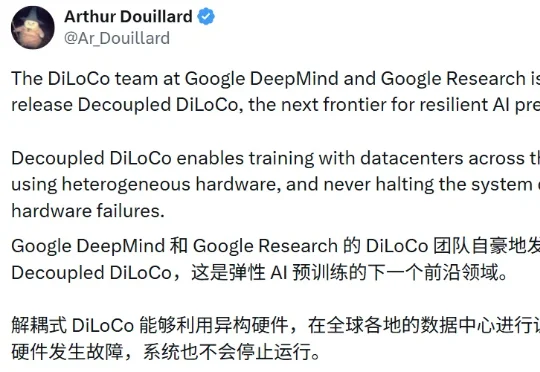

弹性 AI 预训练已经推进到了下一个前沿!没有意外:来自谷歌。据介绍,他们提出的 Decoupled DiLoCo 是一种革命性的分布式训练技术,能够利用全球各地的异构硬件进行训练,并且即使当硬件发生故障时,系统也不会停止运行!

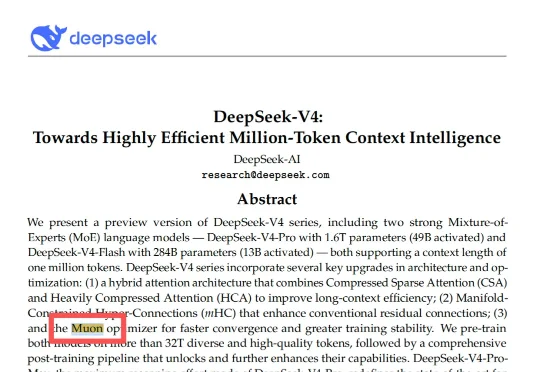

今天上午,DeepSeek V4 发布,直接把这个大模型疯狂更新月推向了最高潮。不过在我翻看 V4 的技术报告的时候,在训练层面看到了一个被大部分人滑过去的名词:Muon 优化器。

最近,谷歌联合ResNet作者何恺明、谢赛宁、NeRF先驱Jonathan T. Barron、 3D图形学名家Thomas Funkhouser,正式发布了Vision Banana。它向世界宣告:视觉AI终于不再需要那些臃肿的任务头了,理解,本质上只是生成过程中的一次「对齐」。