针对医学图像分割的基础模型应用探索

针对医学图像分割的基础模型应用探索来自美国医学院的研究团队聚焦于医学图像分割领域中人工智能基础模型的开发与应用,提供了一个全面的基础模型开发框架。

来自美国医学院的研究团队聚焦于医学图像分割领域中人工智能基础模型的开发与应用,提供了一个全面的基础模型开发框架。

在Prompt工程领域,规划任务一直以来都是一个巨大的挑战,因为这要求大语言模型(LLMs)不仅能够理解自然语言,还能有效执行复杂推理和应对长时间跨度的操作。

2024年7月22日凌晨,xAI创始人Elon Musk在推特上正式宣布,在凌晨4:20分正式启动了世界上最强的AI训练集群。 这个训练集群建设在美国田纳西州孟菲斯市,集合了10 万个液冷H100芯片。

消除激活值(outliers),大语言模型低比特量化有新招了—— 自动化所、清华、港城大团队最近有一篇论文入选了NeurIPS 2024(Oral Presentation),他们针对LLM权重激活量化提出了两种正交变换,有效降低了outliers现象,达到了4-bit的新SOTA。

现在,视频生成模型无需训练即可加速了?! Meta提出了一种新方法AdaCache,能够加速DiT模型,而且是无需额外训练的那种(即插即用)。

最近,以 OpenAI o1 为代表的 AI 大模型的推理能力得到了极大提升,在代码、数学的评估上取得了令人惊讶的效果。OpenAI 声称,推理可以让模型更好的遵守安全政策,是提升模型安全的新路径。

现在正是多模态大模型的时代,图像、视频、音频、3D、甚至气象运动都在纷纷与大型语言模型的原生文本模态组合。而浙江大学及其计算机创新技术研究院的一个数十人团队也将结构化数据(包括数据库、数仓、表格、json 等)视为了一种独立模态。

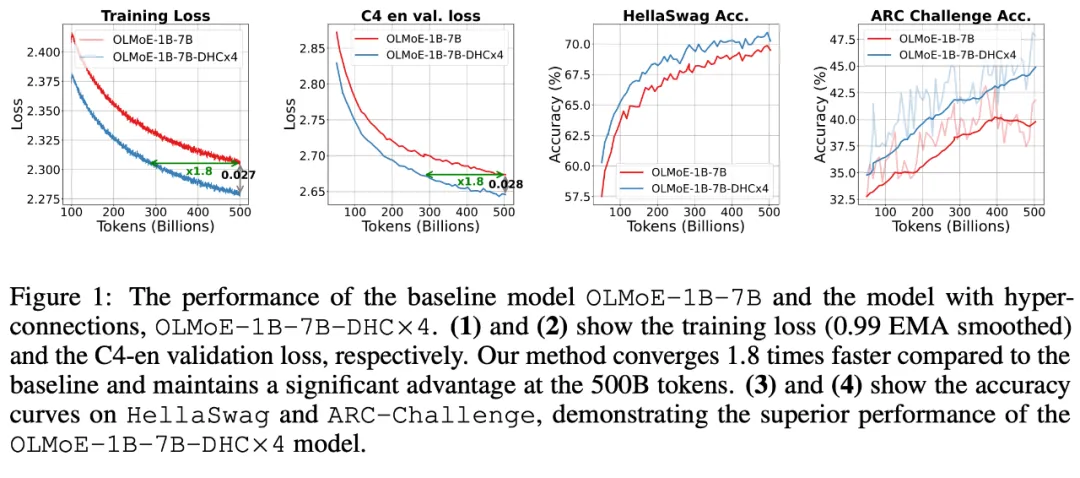

字节跳动豆包大模型团队于近日提出超连接(Hyper-Connections),一种简单有效的残差连接替代方案。面向残差连接的主要变体的局限问题,超连接可通过动态调整不同层之间的连接权重,解决梯度消失和表示崩溃(Representation Collapse)之间的权衡困境。在 Dense 模型和 MoE 模型预训练中,超连接方案展示出显著的性能提升效果,使收敛速度最高可加速 80%。

具身智能,简单来说,就是赋予 AI 一个「身体」,让这颗聪明的大脑在物理世界中行动自如。 把这颗大脑升级成世界模型 —— 它拥有记忆、直觉和常识时,机器人可以不再机械地按训练行事,而是能够灵活变通,具体问题具体分析。

网络智能体旨在让一切基于网络功能的任务自动发生。比如你告诉智能体你的预算,它可以帮你预订酒店。既拥有海量常识,又能做长期规划的大语言模型(LLM),自然成为了智能体常用的基础模块。