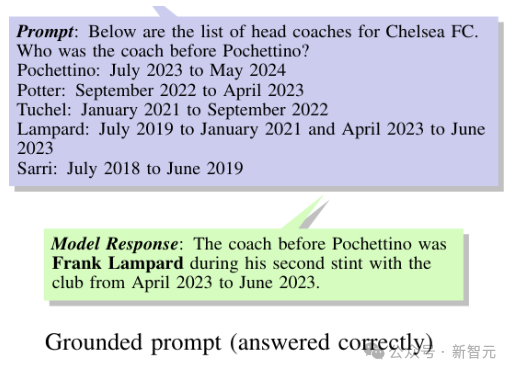

院士领衔推出大模型的第3种记忆:比参数存储和RAG都便宜,2.4B模型越级打13B

院士领衔推出大模型的第3种记忆:比参数存储和RAG都便宜,2.4B模型越级打13B给大模型加上第三种记忆格式,把宝贵的参数从死记硬背知识中解放出来!

搜索

搜索

给大模型加上第三种记忆格式,把宝贵的参数从死记硬背知识中解放出来!

市值140亿美元的初创公司Scale AI正在招聘博士训练LLM,用人成本的升高让该公司的毛利率在2023年有所下降,但创始人Alexandr Wang预计今年营收将增加两倍,突破十亿美元。

ChatGPT能耗惊人,该怎么解?谷歌DeepMind新算法JEST问世,让LLM训练的迭代次数降低13倍,计算量减少10倍,或将重塑AI未来。

大模型产业发展,需要可信中立的数据深加工平台,如何填补空白?

在训练大型语言模型(LLM)时,Adam(W) 基本上已经成为了人们默认使用的优化器。

一转眼,2024 年已经过半。我们不难发现,AI 尤其是 AIGC 领域出现一个越来越明显的趋势:文生图赛道进入到了稳步推进、加速商业落地的阶段,但同时仅生成静态图像已经无法满足人们对生成式 AI 能力的期待,对动态视频的创作需求前所未有的高涨。

马斯克为Grok 3要豪掷近40亿美元狂买10万张H100,GPT-6的训练则可能要耗资百亿。然而红杉和高盛近日都给行业泼了冷水:每年要挣6000亿美元才能支付的巨额硬件支出,换来的却只是OpenAI 34亿美元的收入,绝大多数初创连1亿美元都达不到。而如果全世界的AI泡沫都被戳破,很可能就会导致新的经济危机。

近日,来自谷歌DeepMind的研究人员,推出了专门用于评估大语言模型时间推理能力的基准测试——Test of Time(ToT),从两个独立的维度分别考察了LLM的时间理解和算术能力。

「无问芯穹」Infini-AI云平台已集成大模型异构千卡混训能力,是全球首个可进行单任务千卡规模异构芯片混合训练的平台。

大模型当上福尔摩斯,学会对视频异常进行检测了。 来自华中科技大学、百度、密歇根大学的研究团队,提出了一种可解释性的视频异常检测框架,名为Holmes-VAD。