训出GPT-5短缺20万亿token!OpenAI被曝计划建「数据市场」

训出GPT-5短缺20万亿token!OpenAI被曝计划建「数据市场」全网高质量数据集告急!OpenAI、Anthropic等AI公司正在开拓新方法,训练下一代AI模型。

搜索

搜索

全网高质量数据集告急!OpenAI、Anthropic等AI公司正在开拓新方法,训练下一代AI模型。

EdgeNet可以处理从干净的自然图像或嘈杂的对抗性图像中提取的边缘,产生鲁棒的特征,具有轻量级、即插即用等特点,能够无缝集成到现有的预训练深度网络中,训练成本低。

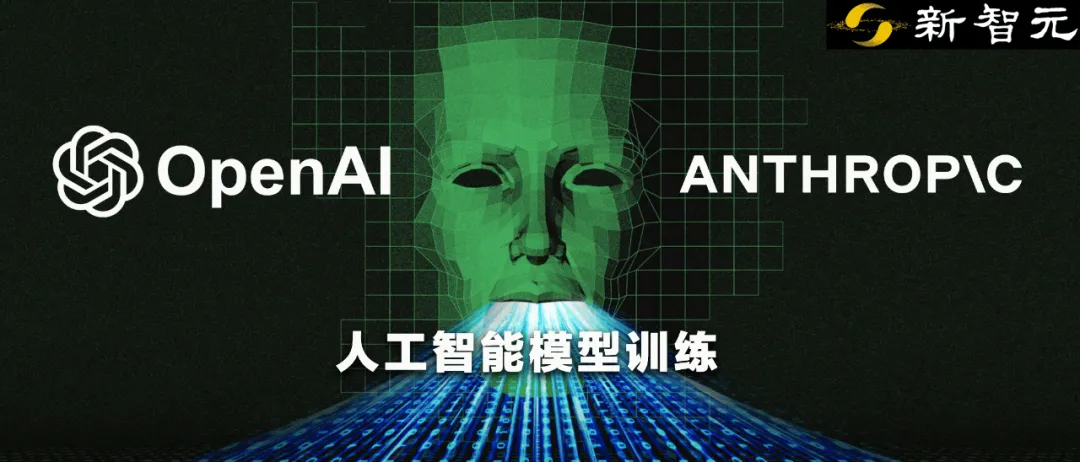

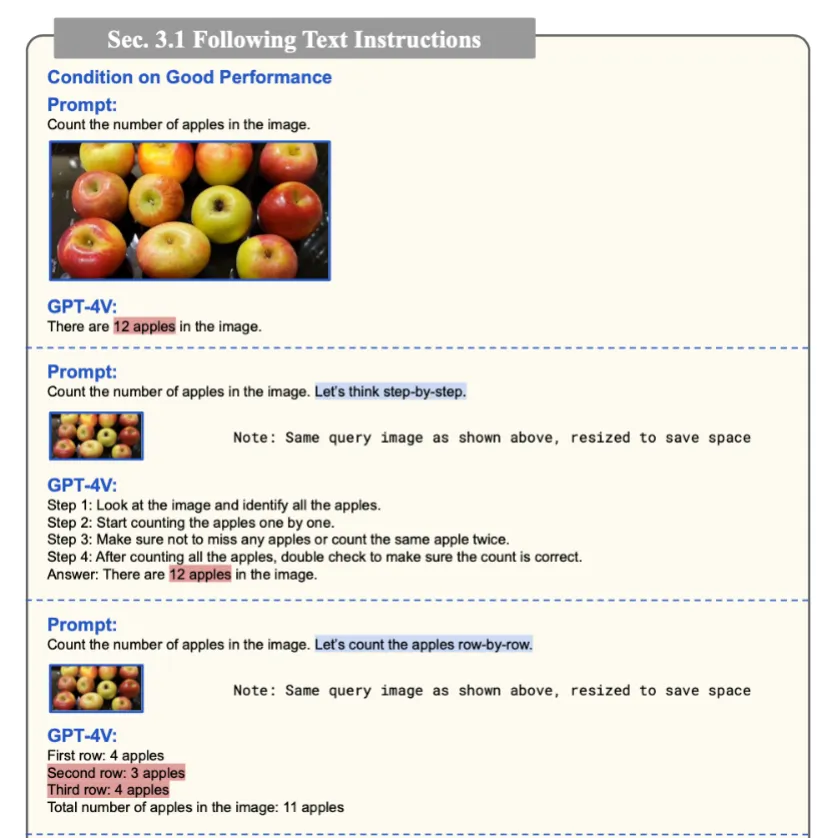

最近,多模态大模型(LMM)取得了一系列引人注目的成就,特别是在视觉 - 语言任务上的表现令人瞩目。它们的成功不仅展现了多模态大模型在各个领域的实用性和灵活性,也为更多视觉场景下的应用探索了新的道路。

近日,来自香港中文大学 - 商汤科技联合实验室等机构的研究者们提出了FouriScale,该方法在利用预训练扩散模型生成高分辨率图像方面取得了显著提升。

随着以深度学习为代表的新一代人工智能技术不断取得突破,学术界与工业界逐渐意识到人工智能技术在图像、视频压缩领域的巨大应用潜力。

2026年的数据荒越来越近,硅谷大厂们已经为AI训练数据抢疯了!它们纷纷豪掷十数亿美元,希望把犄角旮旯里的照片、视频、聊天记录都给挖出来。不过,如果有一天AI忽然吐出了我们的自拍照或者隐私聊天,该怎么办?

GPT-4V 的推出引爆了多模态大模型的研究。GPT-4V 在包括多模态问答、推理、交互在内的多个领域都展现了出色的能力,成为如今最领先的多模态大模型。

Gecko 是一种通用的文本嵌入模型,可用于训练包括文档检索、语义相似度和分类等各种任务。文本嵌入模型在自然语言处理中扮演着重要角色,为各种文本相关任务提供了强大的语义表示和计算能力。

联邦学习使多个参与方可以在数据隐私得到保护的情况下训练机器学习模型。但是由于服务器无法监控参与者在本地进行的训练过程,参与者可以篡改本地训练模型,从而对联邦学习的全局模型构成安全序隐患,如后门攻击。

模仿人类阅读过程,先分段摘要再回忆,谷歌新框架ReadAgent在三个长文档阅读理解数据集上取得了更强的性能,有效上下文提升了3-20倍。