比「同事.Skill」还狠!裁掉8千人后,小扎AI屠宰场炼化在职员工?

比「同事.Skill」还狠!裁掉8千人后,小扎AI屠宰场炼化在职员工?Meta被曝全天候录屏监控员工操作训练AI智能体,8000人裁员同步推进——你亲手教会的AI,可能正在取代你。

搜索

搜索

Meta被曝全天候录屏监控员工操作训练AI智能体,8000人裁员同步推进——你亲手教会的AI,可能正在取代你。

阿里前几天开源的Qwen3.6-35B-A3B,让这次讨论不再只是一次普通的新旧模型对比。它一边要面对谷歌Gemma4-26B-A4B的外部竞争,一边又必须回答一个更麻烦的问题:相较于 Qwen3.5-35B-A3B,它到底是升级,还是修补?更现实的是,很多人现在真正跑着的,其实是Qwen3.5-27B,那么这条新的35B-A3B路线,到底值不值得迁过去。

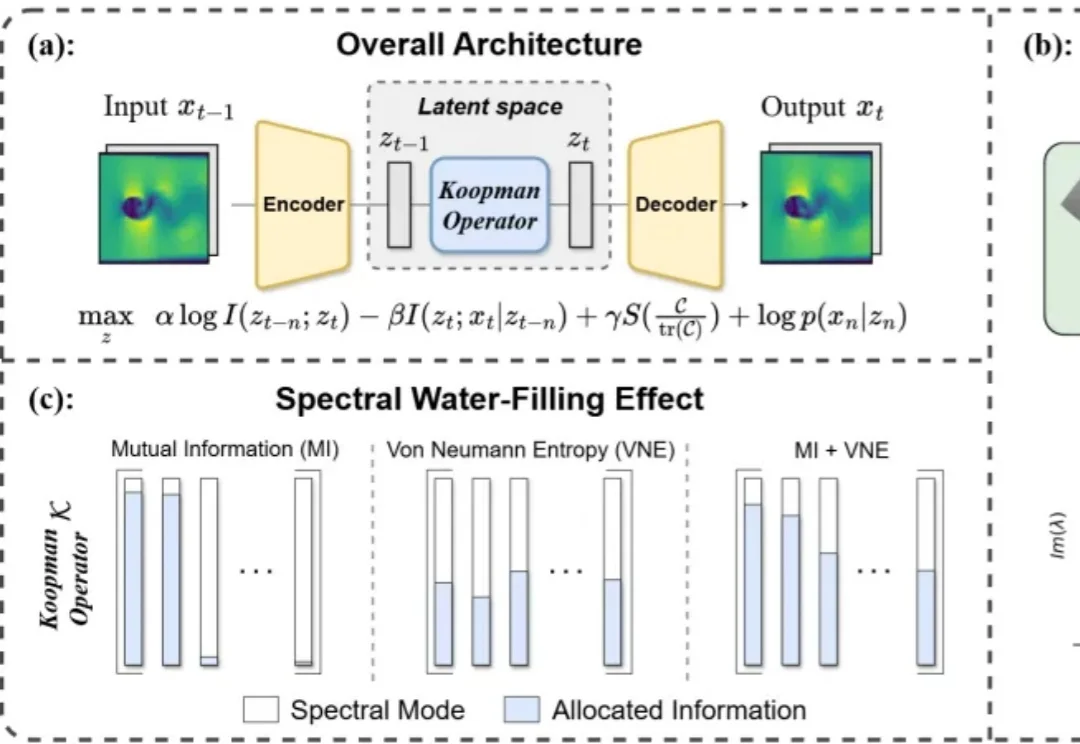

大多数世界模型工作默认:只要学到一个好的 latent dynamics,问题就解决了。 但这个假设本身是可疑的——什么样的信息,才足以支撑一个可预测、可传播的动力学? 本文从信息论出发,重新审视这一前提。

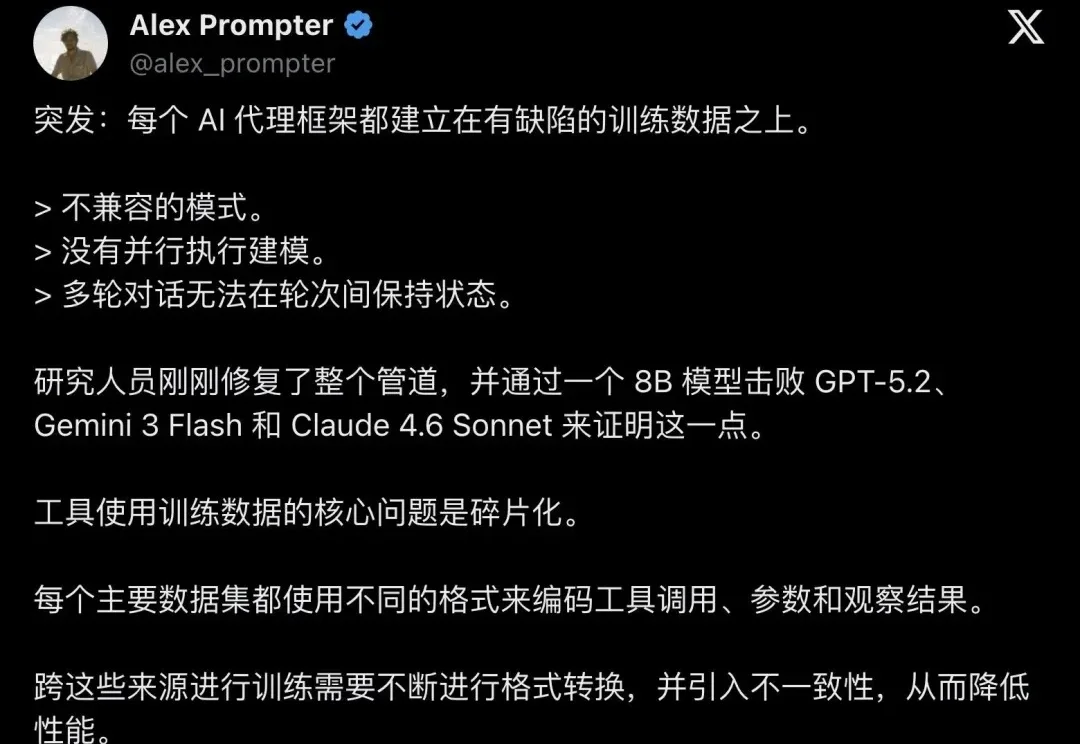

先说一个很多人没意识到的事实:2026年了,每个主流Agent框架底下的工具调用训练数据,格式全是乱的。

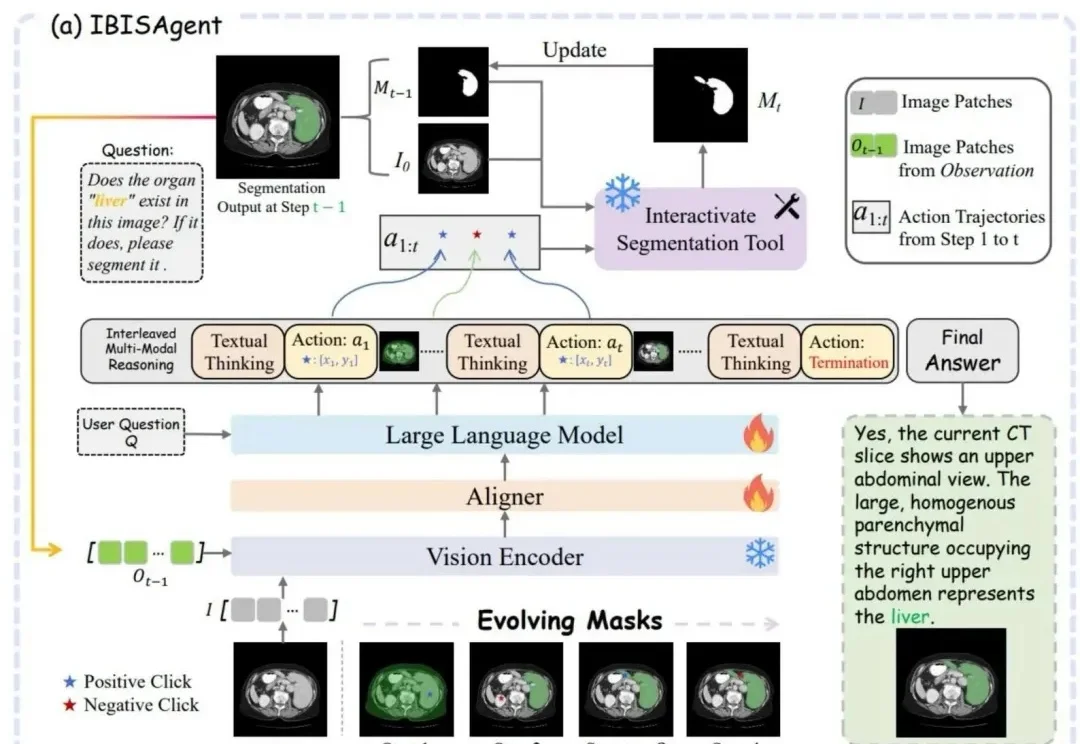

这个生物医学视觉推理框架,被CVPR 2026接收了!

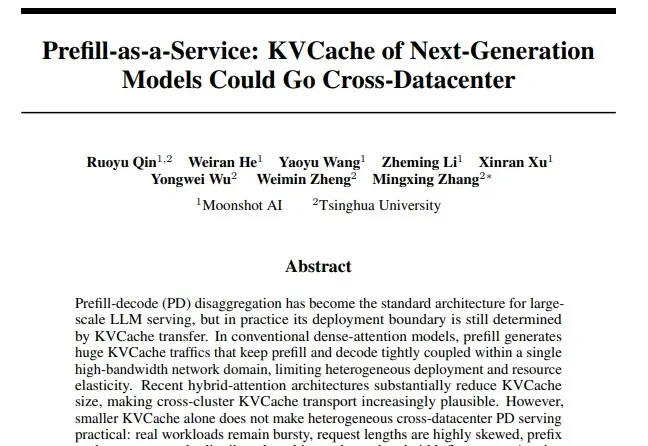

在 AI 工程界,长文本推理一直是个“富贵病”。

Anthropic把最强Claude Mythos亲手锁进笼子,因为它第一次让世界看清:AI正在从「会说」跨进「会做」,奇点已经不再只是想象。

2026年初,当大多数企业还在用数据分析师手动写SQL查表时,OpenAI内部曝光的能自主思考、推理甚至自我进化的数据分析智能体,将数据查询从「天数级」缩短至「分钟级」。

今年4月,具身智能领域发生了一件看起来不大、但意味深长的事。

当谈及数学时,我们近乎本能地认为,数学是一个严谨、精确、不容置疑的完美逻辑体系,但在菲尔兹奖得主迈克尔・弗里德曼(Michael Freedman)眼中,人类真正创造和关心的数学,本质上是「柔软且可塑」的。