深度|谷歌DeepMind CEO:AI最好的用途,是改善人类健康;把AI当作一种工具,帮助我们理解现实世界的本质

深度|谷歌DeepMind CEO:AI最好的用途,是改善人类健康;把AI当作一种工具,帮助我们理解现实世界的本质AI最好的用途,是改善人类健康。 如果真正把这项技术用在科学和医学上,它不仅能解决今天最难的研究问题,也会打开药物发现和疾病理解的一整串下游可能性。

搜索

搜索

AI最好的用途,是改善人类健康。 如果真正把这项技术用在科学和医学上,它不仅能解决今天最难的研究问题,也会打开药物发现和疾病理解的一整串下游可能性。

谷歌养不活、软银养不活、现代砸22亿美元还是养不活。波士顿动力IPO前夜,高管已集体出走。

自学习 AI 的融资神话,正在告诉我们一件事——这场 AI 军备竞赛,连研究员本身都要被「卷」进去了。 作者|桦林舞王 编辑|靖宇 1956 年,一批科学家聚在达特茅斯,第一次正式讨论「机器能否思考」

最近,Google Research推出了一个叫Vantage的实验项目,就把这件事给干了。Vantage项目由谷歌联合纽约大学开发,主要设想是利用GenAI模拟团队协作场景,以此来开发和测量被测试者的软技能。

近日,美国五角大楼宣布与七家公司达成协议,包括 OpenAI、谷歌、微软、亚马逊、英伟达、SpaceX 和一家名为 Reflection AI 的初创公司,允许将这些公司的 AI 系统用于机密级别的军

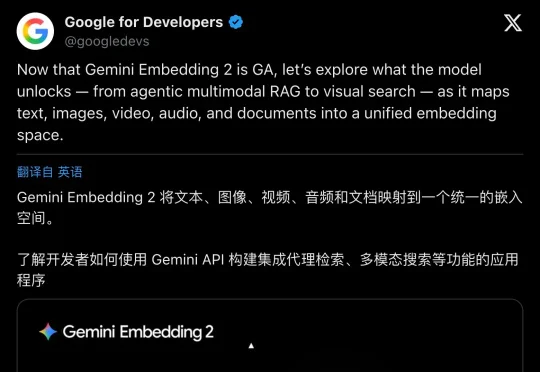

Google悄悄干了一件大事——Gemini Embedding 2正式进入GA阶段,成为Gemini API中第一个原生多模态embedding模型。它能把文本、图片、视频、音频、PDF文档全部映射进同一个统一向量空间,支持100多种语言。

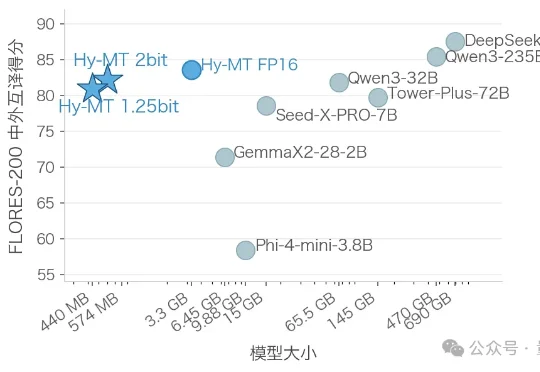

腾讯混元团队刚刚开源了一份硬核解决方案:推出极致量化压缩版本翻译模型Hy-MT1.5-1.8B-1.25bit,把支持33种语言的翻译大模型压缩至440MB。无需联网,下载后即可在手机本地运行 。官方测试显示,其翻译质量优于谷歌翻译。

谷歌母公司Alphabet营收达到1099亿美元,每股收益5.11美元,远超华尔街预期的2.62美元;亚马逊净销售额1815亿美元,净利润303亿美元,每股收益2.78美元,几乎是预期的两倍;微软营收829亿美元,同比增长18%;Meta净利润268亿美元,同比接近翻倍。

今天凌晨,谷歌 Gemini 突然放大招,它在 X 上宣布:现在 Gemini 可以直接生成PDF、Word、Excel 或 Google Workspace 等文件,无需上传模板,只用和Gemini交流要做什么和讲清文件格式。

今天凌晨,谷歌母公司Alphabet公布2026财年第一季度财报。本财季,营收和净利润超出市场预期,营收达1098.96亿美元(约合人民币7506亿元),同比增长22%,按固定汇率计算同比增长19%,实现连续11个季度的两位数增长;归母净利润625.78亿美元(约合人民币4274亿元),同比暴增81%;摊薄EPS 5.11美元,同比增长82%。