库里被「采访」、杨紫被「演」短剧?别慌!蚂蚁AI鉴真拿下CVPR 2026冠军,专治黑产

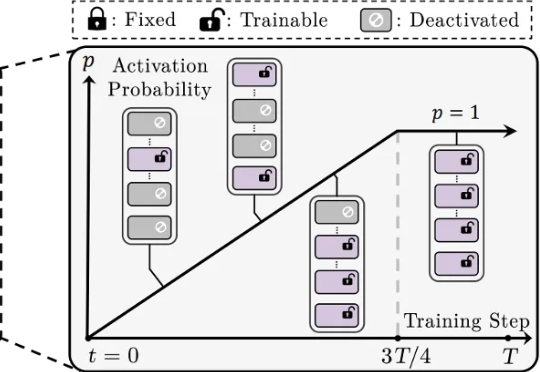

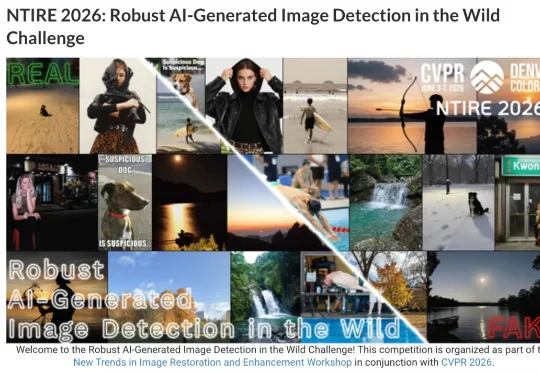

库里被「采访」、杨紫被「演」短剧?别慌!蚂蚁AI鉴真拿下CVPR 2026冠军,专治黑产最近,计算机视觉领域的顶级会议 CVPR 2026 的 NTIRE 鲁棒性 AIGC 图像检测挑战赛( Robust AI-Generated Image Detection in the Wild Challenge )结果出炉。蚂蚁集团 AI 安全实验室的队伍 MICV 凭借在鲁棒性测试样本上 ROC AUC 达到了惊人的 0.9723,成功摘得「复杂真实场景鲁棒性样本测试」挑战赛的冠军。