过去三年,扩散模型席卷图像生成领域。以 DiT (Diffusion Transformer) 为代表的新一代架构不断刷新图像质量的极限,让模型愈发接近真实世界的视觉规律。

然而,与 LLM 可解释性研究的蓬勃发展相对,扩散模型内部的语义结构、时间规律以及因果路径仍然像被深深封住的「黑箱」。研究者可以凭直觉优化架构,但外界无法真正理解扩散模型在生成过程中的「思考方式」。

更棘手的是,已有的可解释性尝试往往伴随着明显的性能下降:特征分解、激活分析、插值扰动……无论采用哪种方法,只要试图将扩散模型拆开来看,生成质量就会显著劣化。这让「可解释扩散模型」在很长一段时间里被视为不切实际的小众方向。

在这样的背景下,香港中文大学 MMLab 与上海人工智能实验室的研究团队提出了一个不同的观点:扩散模型作为当今视觉世界最重要的生成器,其内部机制不应永远处于不可见状态;可解释性也不应该以牺牲生成质量为代价。

基于这一理念,他们提出了被 AAAI 2026 接收的 TIDE (Temporal-Aware Sparse Autoencoders) —— 首个真正意义上面向扩散 Transformer 的时序稀疏自编码器框架。

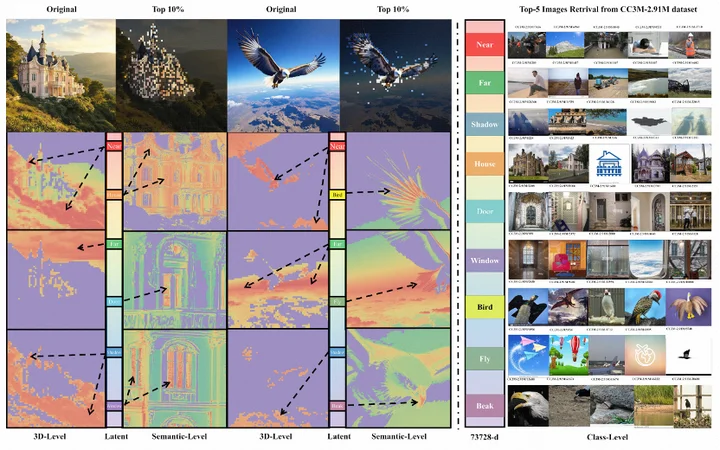

以往的可解释方法大多忽视了扩散过程最大的特点:生成是一个随时间展开的渐进式构造过程。早期步骤决定物体形状和布局,中期步骤塑造语义和结构,后期步骤填充材质与细节。如果忽略这条时间线,扩散模型看起来就像一团混乱的噪声与特征。TIDE 的突破在于,它不是「硬拆」一个静态特征,而是让模型自己在时间维度上对齐语义:

同一个因子会在不同时间步中保持一致的语义轨迹,最终形成一个可读、可控、稳固的「时间语义剖面」。

也正是在这样的时序框架下,扩散模型内部原本模糊的过程第一次被清晰呈现出来:粗结构从噪声中浮现、语义逐渐成型、纹理被不断润色……模型的「思考流」沿着时间轴被完整雕刻出来。

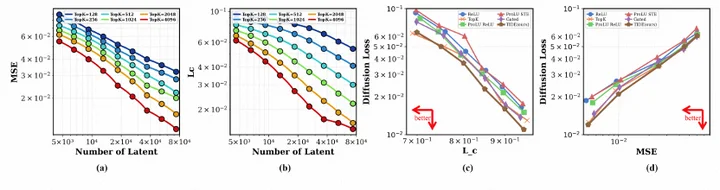

更重要的是,这一切并不会破坏原模型的生成能力。TIDE 的稀疏自编码器在特征空间进行无损重构,扩散轨迹保持稳定,模型几乎感受不到被「观察」的存在。同时在 scaling latent 维度时,也优于原有 vanilla SAE 方法。

在 Stable Diffusion XL、PixArt-α、Flux 等主流扩散框架上,TIDE 将扩散特征分解为具有可控语义的因子:

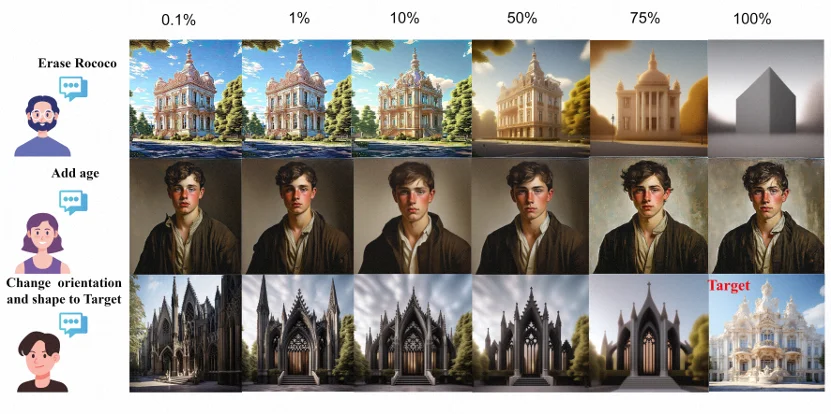

负责轮廓的因子、负责物体姿态的因子、负责材质纹理的因子……甚至可以捕捉到跨时间的概念演化。基于这些因子,研究团队构建出一种全新的图像编辑方式:编辑不再依赖繁琐的提示语或反复调参,而是可以沿着清晰的语义方向直接操控扩散过程。例如:

这些编辑操作完全基于 TIDE 生成的语义因子完成,意味着未来扩散模型有望出现一种全新的「因子级编辑器」,具备高度可控性与透明性。

与此同时,TIDE 对模型生成质量的影响几乎可以忽略不计。FID、sFID 变化小于 0.1%,噪声预测轨迹保持稳定,实现了真正意义上的「可解释而不降质」。

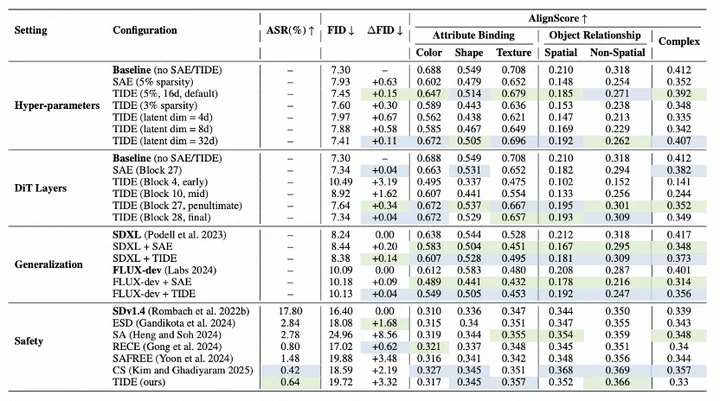

TIDE 在不同设置、不同模型规模以及不同任务维度下的整体表现。无论是在超参数选择、在 DiT 不同层级进行因子学习,还是在 SDXL、FLUX-dev 等主流扩散架构上的泛化能力,TIDE 都表现出高度稳定且持续的优势。

可以看到,TIDE 在几乎不增加 FID 代价的前提下,显著提升了 AlignScore 中的语义绑定(颜色、形状、纹理)以及跨区域关系理解(空间与非空间关系),其中多处指标在表中以绿色标记为最优表现。

此外,在安全性评测部分,TIDE 相比多个现有方法大幅降低了攻击成功率,显示出更稳健的特征理解能力。整体来看,这幅表格清楚证明:TIDE 不仅带来了高质量、可解释的语义因子,还在保持生成质量的同时,提升了模型的结构理解、关系推理与安全性,成为一种真正可泛化、可落地的可解释扩散框架。

扩散模型已经成为现代视觉生成系统的核心支柱,但它们的内部机制一直缺乏系统、透明的解释路径。TIDE 的出现不仅提供了首个真正实用的可解释性方案,更重要的是,它让研究者第一次能够沿着「时间」这条线索观察扩散模型内部的语义结构。

这种理解能力将直接影响未来的多个方向:

TIDE 不仅是一个方法,更是一种新的研究范式:扩散模型并非不可解释,只是缺少一个合适的视角。

研究团队表示,当前 TIDE 已成功验证了时序稀疏自编码器框架的有效性,但可解释扩散模型的潜力远未被完全发掘。未来的工作将进一步:

随着更多研究者的加入,扩散模型的「黑箱壁垒」正逐渐被揭开,而 TIDE 或许是这一转变具有代表性的第一步。

文章来自于“机器之心”,作者 “机器之心”。