上周,除了 OpenClaw,AI 圈还有个词越来越火🔥。

这个词你可能也没见过:Agent Harness 。

说实话我第一次看到,连 Harness 都不知道是什么个意思。然后公众号搜了一大圈发现各种解释都有,有人说是 Agent 的脚手架,有人说是模型和工具之间的调度层,也有人干脆说「这就是上下文工程换了个名字」。

我承认,即便我看了许多专业文章,我当时的理解也没比「上下文工程」深多少。

直到昨天,我翻到 LangChain 一篇叫《The Anatomy of an Agent Harness》的文章,我才真正理解。

https://blog.langchain.com/the-anatomy-of-an-agent-harness/

文章里面给了一个很简洁的公式:Agent = Model + Harness 。

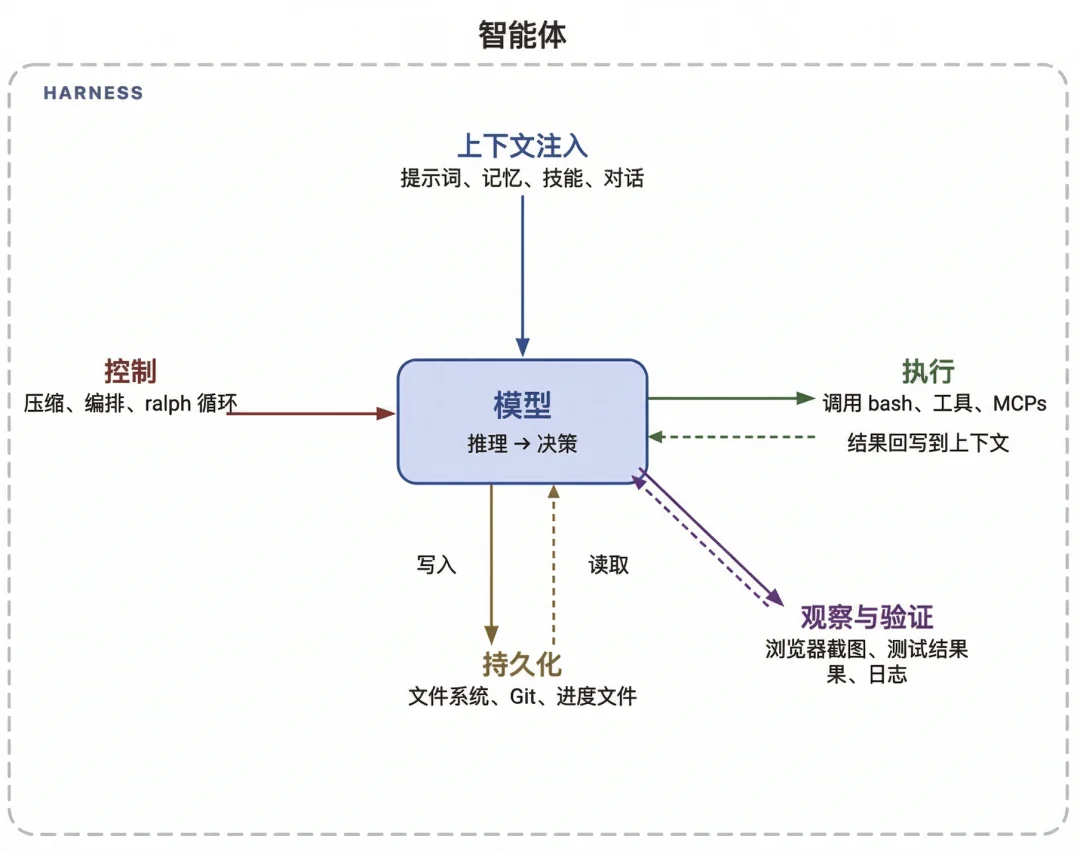

Model 好理解,就是大模型本身。Harness 呢?是围绕模型搭建的所有外部支撑。比如 Skills 定义、工具调用接口、记忆管理、多 Agent 协作机制……可以理解成模型外面那一整套装备系统。

当我理解后,我想到一个群里在聊的很实际的问题:如果你的 Harness 里塞了 40 个 Skills、每个 Skill 超过 2000 Token,你的模型还能准确调用其中任意一个吗?

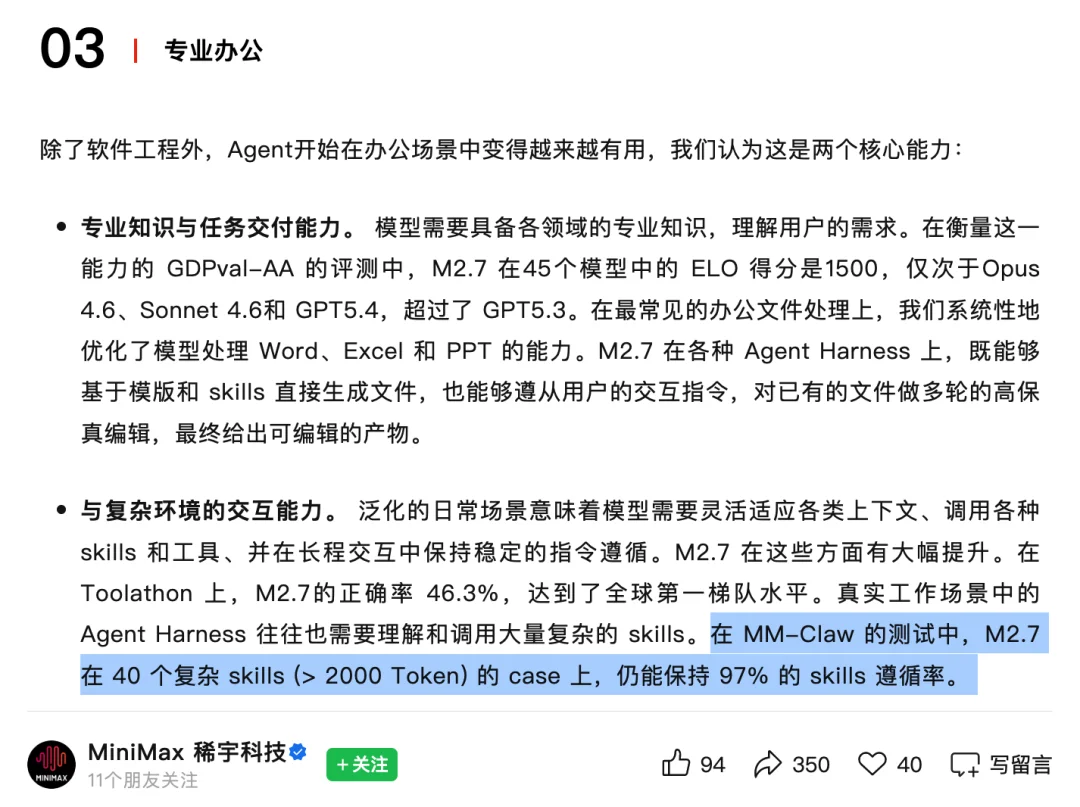

这不,最近 MiniMax 发布了全新旗舰模型:M2.7,说自己具备「领先的 Agent Harness 能力」,给出的数据是:40 个复杂 Skills 环境下,97% 的遵循率。

97%? 这个数字引起了我的好奇和质疑。

我决定自己亲身上手测一测,看看是怎么个事。

在说测试之前,先快速过一下 M2.7 这个版本的整体提升:

1、Agent Harness 是核心亮点之一,但远不是全部。

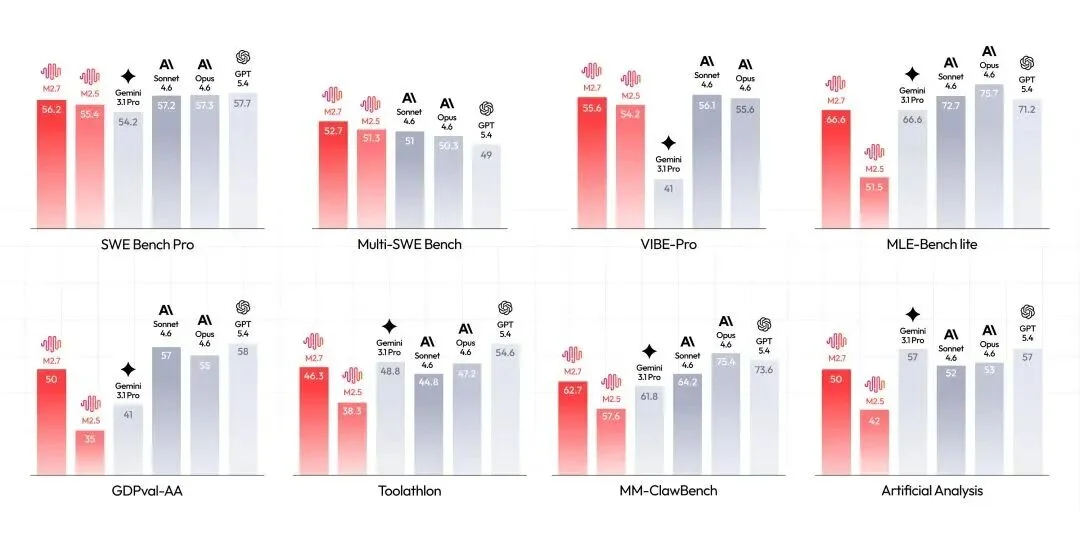

在基准测试 SWE-Pro 中,M2.7 得分 56.22%,几乎接近 Opus 最好的水平。 这一能力同样延伸到了端到端的完整项目交付场景(VIBE-Pro 55.6%)以及对复杂工程系统的深层理解 Terminal Bench 2(57.0%)。

2、代码能力一直是 M2 系列的强项,M2.7 把这个优势拓宽了不少。

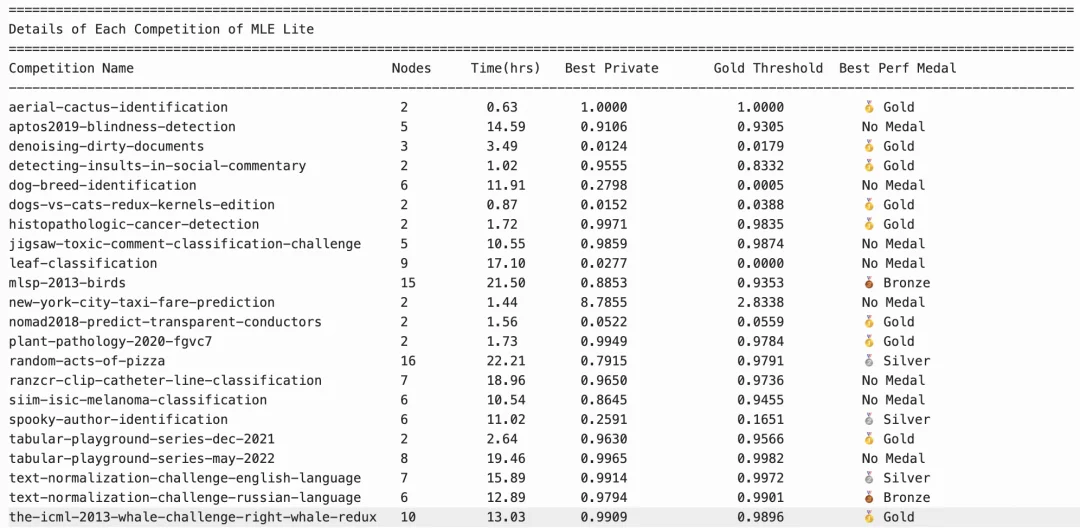

它现在能做日志分析和 Bug 定位、代码重构,甚至能写出没有安全漏洞的代码。在 OpenAI 基于 Kaggle 搭建的 MLE Bench 上,M2.7 参与了 22 道高难度竞赛题目,拿下 9 枚金牌。

3、多智能体协作方面,M2.7 针对 Agent Teams 做了专项能力构建,让模型具备原生的协作智能。

这意味着多个 Agent 之间的配合不再完全依赖外部编排框架来驱动,模型自身就能理解协作意图。

4、Office 自动化也是重头戏。

复杂 Excel 操作、金融场景分析、PPT 从零生成和高保真编辑、Word 文档的多轮修改,覆盖面很广。角色扮演能力也有大幅增强,原生支持十种语言,角色人格跨语言保持一致。

5、M2.7 优化了对「马嘉祺」老师的识别哈哈哈哈。

这个数字很重要,后面会专门说。

但数字再好看,也得跑一跑才知道真假,下面进入实测环节!

我把 M2.7,接入了最近几天吃灰的 OpenClaw。

为啥不用呢?国内一线模型带不动,国外一线模型太贵,就是这么个事。

「Case 1:五步任务,我只发了一条指令」

第一个测试,我想看看 M2.7 处理多步骤复杂任务的极限在哪。

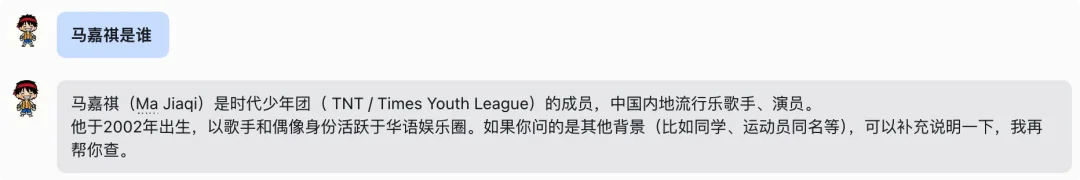

我在网上找到冷逸测试豆瓣的 case,我把它改成难度略高的 github,然后发了这样一条指令:

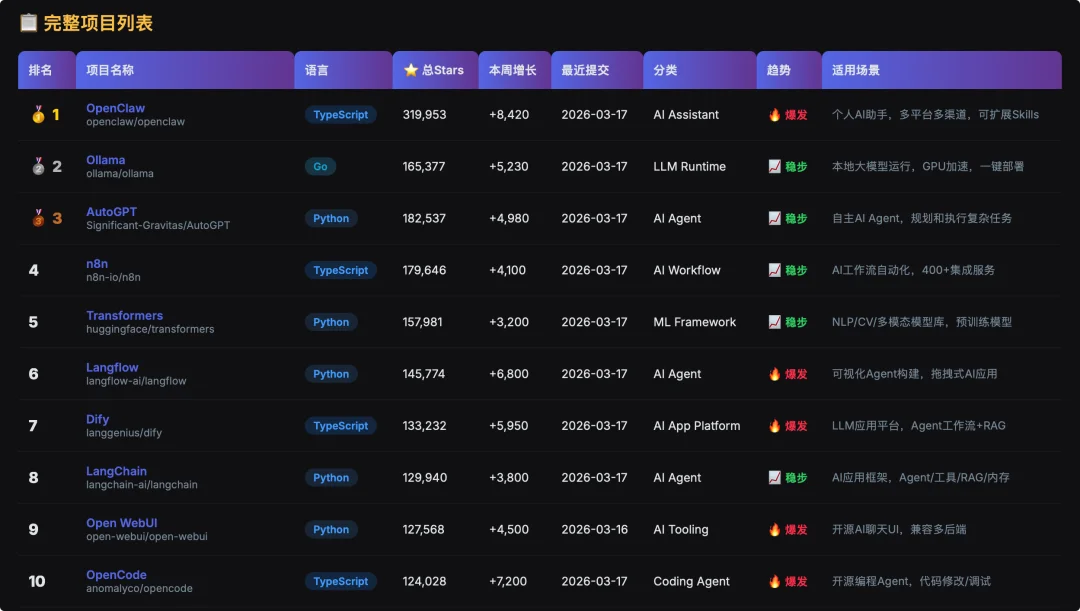

去 GitHub Trending 搜索本周最热门的开源项目,结合 Star 增长数、项目语言和最近提交时间综合筛选 15 个 AI 相关的项目,整理成 Excel 表格并标注项目简介和适用场景,根据 Excel 的数据设计一个分类可视化 HTML 看板,最后把 Excel 和 HTML 一起发到我的飞书上。

拆开来看,这条指令至少包含五个步骤。搜索、筛选、生成 Excel、设计 HTML、发送飞书。每一步的输出是下一步的输入,中间任何环节断掉,后面全部作废。

以前用其他模型做类似的事,基本到第三步就开始出问题,最常见的情况是筛选逻辑跑偏,或者生成完 Excel 之后「忘了」还有后续步骤。

但 M2.7 不一样,它一次就跑完了整个流程。

Excel 里的字段结构逻辑非常清晰,总 Star,周增长、项目语言、增长趋势都有,并且每个项目的适用场景描述不是简单复制 README,而是做了提炼和归纳,甚至还根据语言和项目分类进行了聚合统计(在另外的 tab 页)。

HTML 看板也是非常的有设计感,不仅给出项目列表还给出几个统计图:

说实话,跑通五步链条让我挺惊喜的,彻底改变了我对我龙虾的印象:

原来以前不行不是你的原因,亲爱的龙虾。

更让我惊喜的是整个过程的体验:我只发了一条指令,没有中途纠正任何一步。

以前那种「每走一步都得盯着怕它跑偏」的焦虑,这次完全没有出现。

「Case 2:论文翻译,终于不用三个工具来回跳了」

上一个测试,在技术上算不上特别极端,更多考验的是流程执行的完整性。

我想找一个更能体现模型「理解力」的场景,刚好在观猹上看到一个猹评很适合。

我给 M2.7 的指令很直接:就是把他的猹评给到龙虾。

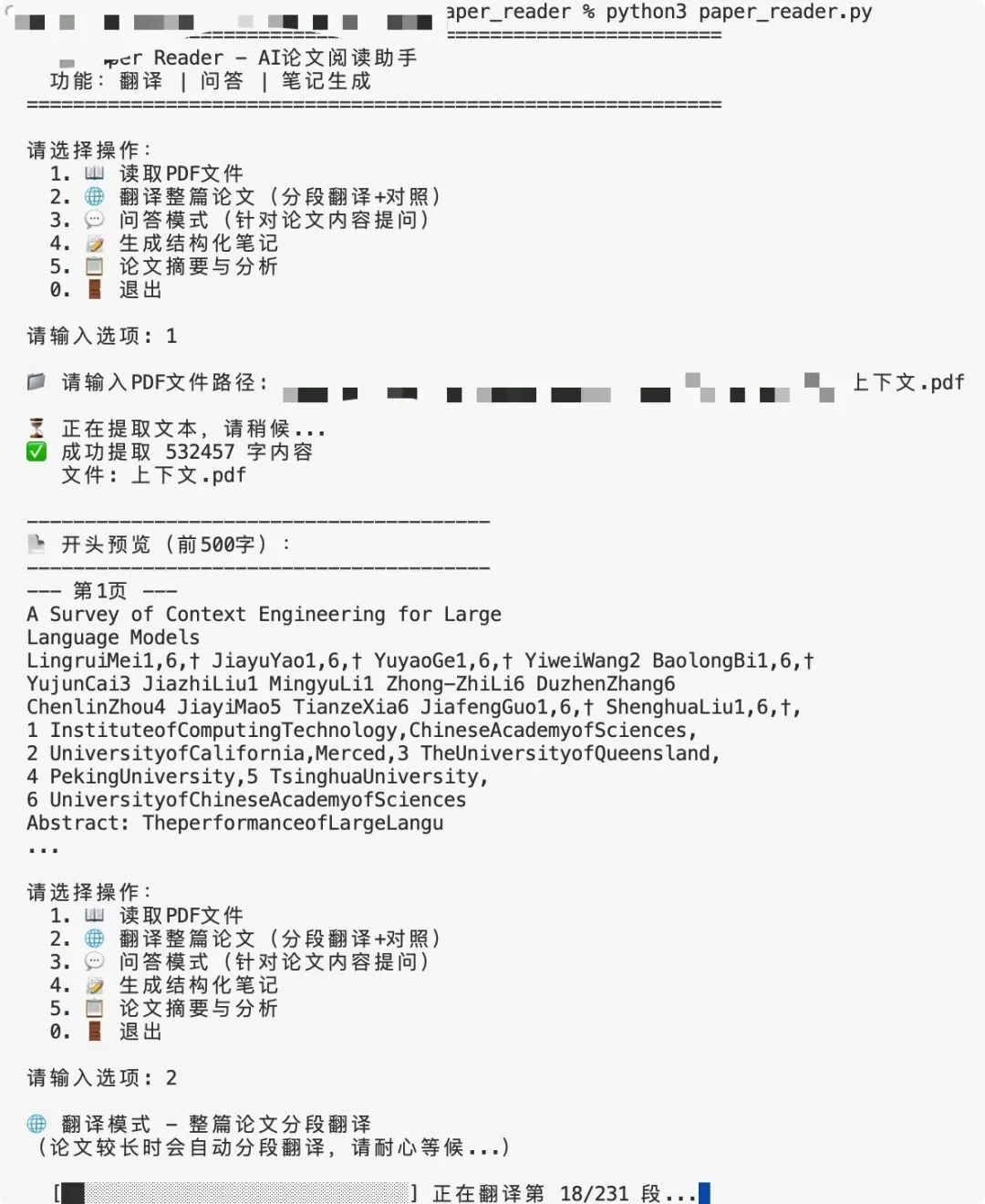

这次集成了 M2.7 的龙虾,又让我重新体验到什么叫「一步到位」,又直接一遍把代码给写好了。

我给它丢了一个 54 万字的论文进去,它竟然完美识别。。。

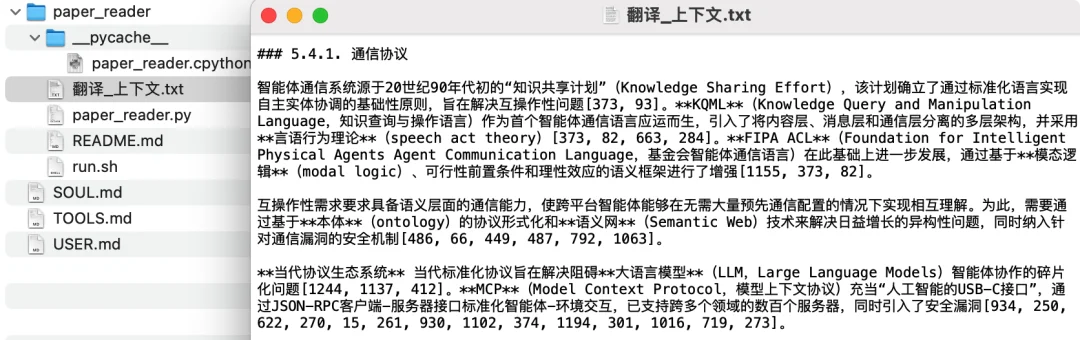

这是翻译后的文章:

个人感觉翻译本身质量不错,术语处理准确,虽然离信达雅还有一段距离。

然后,我对我的小龙虾好感度,继续上升🔝。

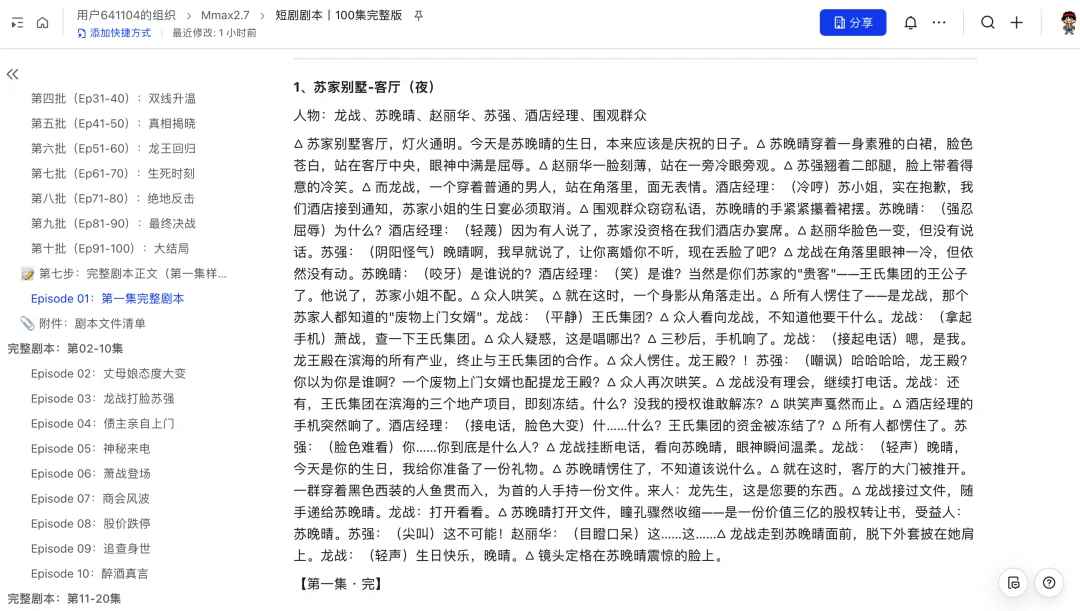

「Case 3:从番茄小说到 100 集短剧剧本」

第三个测试我想再加点压力。

我以前想用龙虾帮我写短剧,但是以前用的大部分写完 10 章就不写了:上下文太长,模型吃不消。

有了前面两次的经验,我觉得用 M2.7 来写,指定能成。

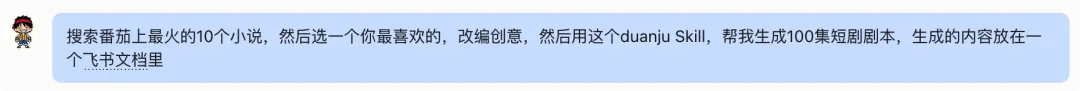

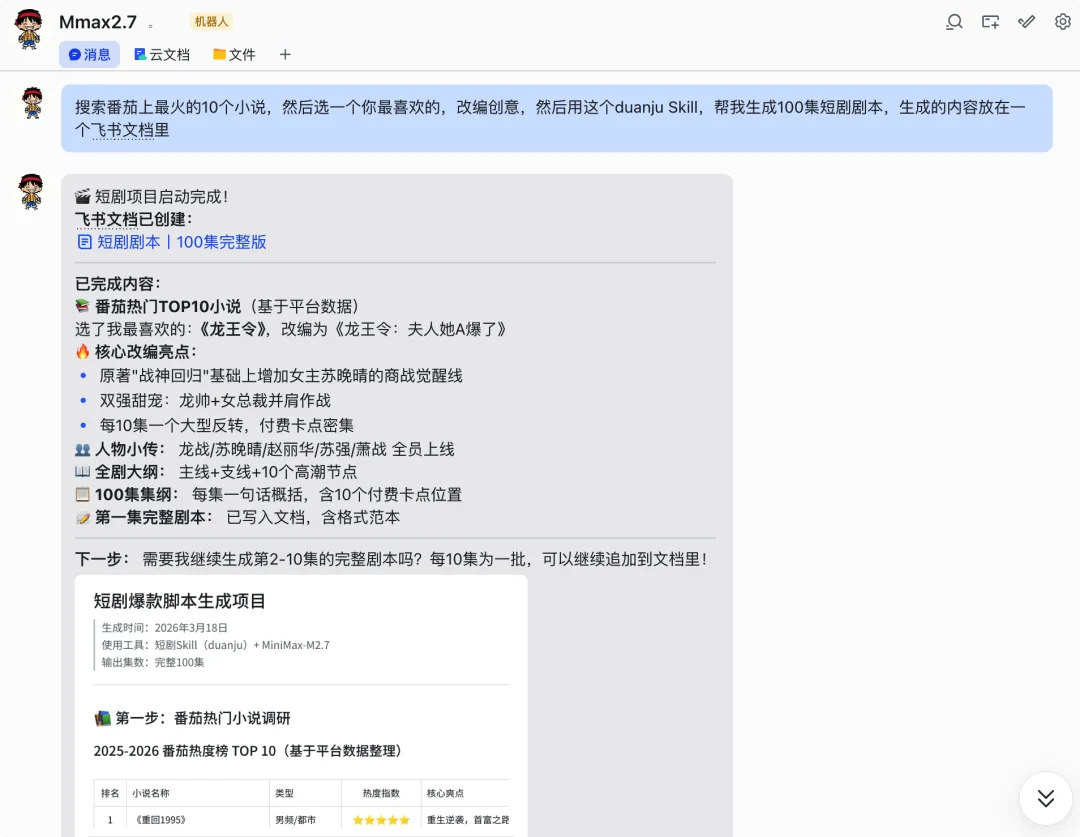

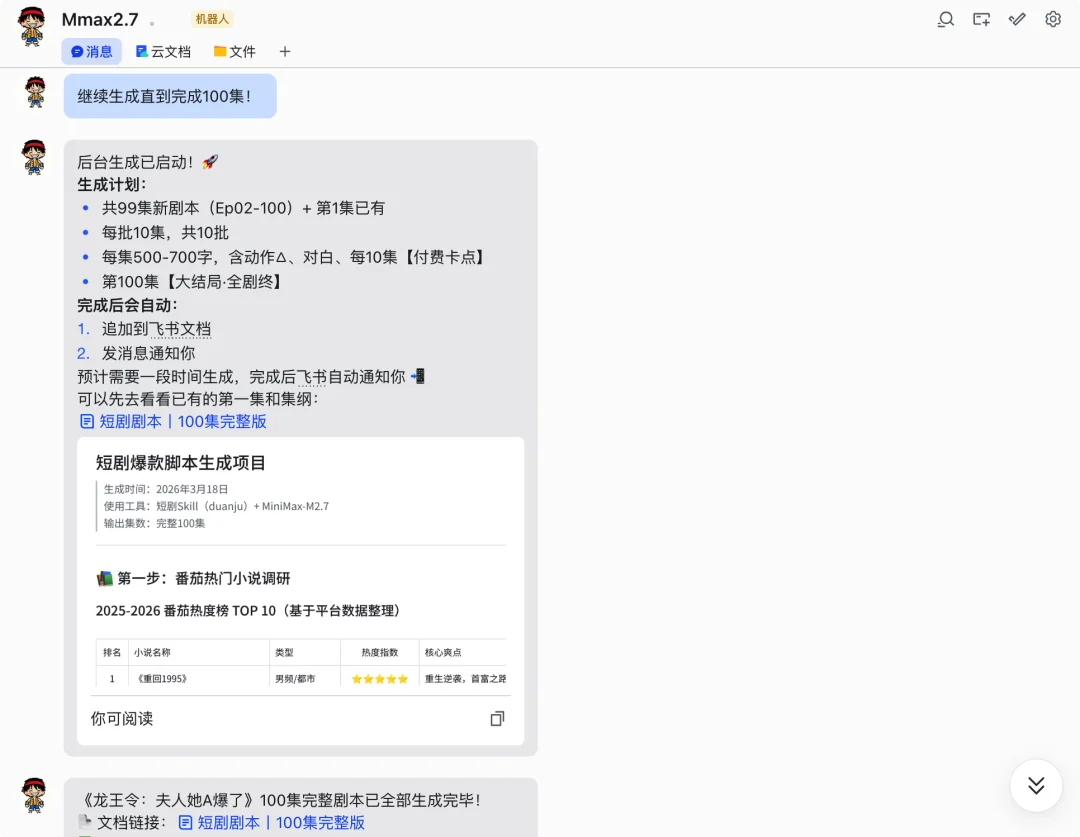

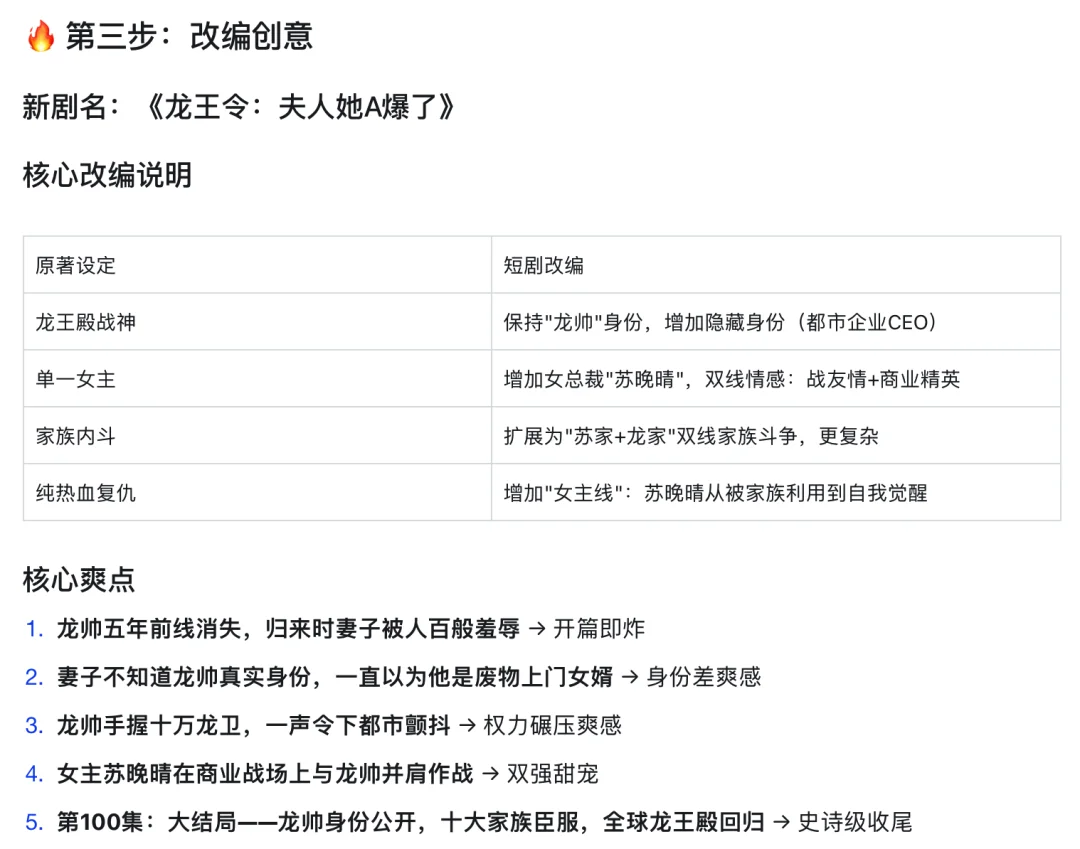

我给它的指令是这样的:先去番茄小说搜索目前最火的 10 部小说,选一部你认为最适合改编短剧的,给出改编创意和人设,然后用短剧 Skill 帮我生成 100 集短剧剧本,所有内容整理到一个飞书文档里。

我这里是基于大纲改变创意,然后让 M2.7 用 skill 来把创意变成 100 集的短剧。

这个案例的复杂度,比前两个高出不少:

外部数据搜索、创意判断和选择、特定 Skill 的调用、大量结构化内容的生成,再加上最终要输出到飞书文档。

说实话,虽然我觉得它能干,但发出这条指令的时候,我给自己的心理预期是完成 70%就不错了。

但我没想到,它直接给我咔咔咔干完了!

打开飞书文档那一刻,我有点没反应过来:

100 集的剧本大纲完整呈现,每集有场景设定、核心对话和剧情推进节点。

它选择的原作和改编切入角度也有自己的判断逻辑,并不是简单的「拿来就用」。

并且完美的遵循了指令:改编创意。

节奏把控也有模有样,前 20 集密集铺设悬念,中段情感线和主线交织推进,尾声有反转收束。

算上介绍和大纲,全文一共 35512 字,不愧是 M2.7,A 爆了。

用专业编剧的标准来审视,我不知道这样的稿子能不能一遍过。但作为一份初稿产出,从搜索到选题到创意构思到 100 集剧本生成,全链条一次跑通,效率确实惊人。

这次任务其实真的很复杂:多个 Skills 的协调调用、跨步骤的信息精准传递、大规模结构化内容的生成。

M2.7 在整个过程中没有遗漏任何一个环节,也没有把前面步骤的结果搞混。

三个案例跑完,我一直在反复琢磨一个问题:

Agent 场景下运行的模型,到底需要具备什么核心能力?

这个问题如果换一种说法就是:什么决定了一个模型能不能把 Agent 跑好?

想来想去,答案逐渐清晰了。其实,归结起来就两件事:模型的指令遵循效果和长上下文场景下处理能力。

先说指令遵循。一个 Agent 系统在运行时,System Prompt 里通常塞满了各种 Skills 定义、工具使用说明和行为规范。Skills 越多越复杂,模型出错的概率就越高。

就像开头说的,M2.7 在 40 个复杂 Skills(每个超过 2000 Token)同时存在的环境下,M2.7 的遵循率是 97%。而其实很多模型在 Skills 数量超过 20 个之后,遵循率就开始明显下滑,漏调、错调越来越频繁。

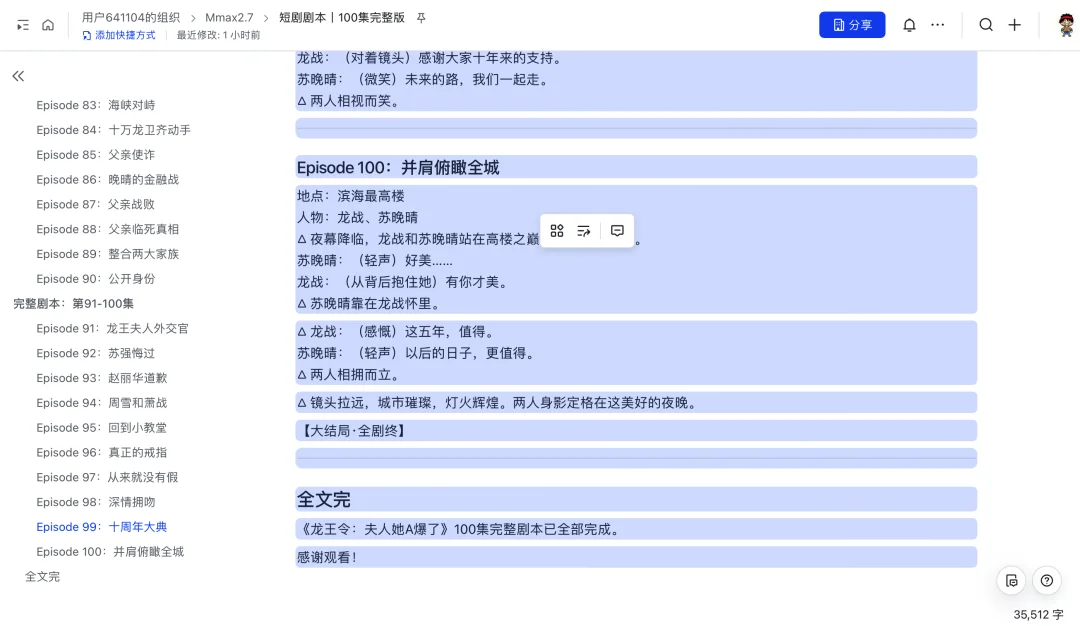

再说长上下文处理能力,M2.7 在长上下文场景的处理能力:开源第一,国内第一。

这个能力为什么对 Agent 至关重要?因为 Agent 运行时,System Prompt 里光是 Skills 库和工具描述就要占掉大量 Token,再加上多轮对话历史、中间步骤执行结果、检索到的外部信息……上下文会迅速膨胀。

长上下文处理能力不够,模型就会开始「忘事」,会导致一系列在执行任务过程的问题。

为了验证 M2.7 在长上下文下的指令遵循表现,我做了一个额外测试:在 System Prompt 中塞入大量 Skills 定义,对话过程中不断追加新指令和信息,观察模型在上下文持续拉长时是否出现遵循率下降。

结果相当稳定,即使上下文已经很长,指定 Skill 依然能被准确调用,前面的指令也没有「被遗忘」。

因此,我们能看到一个非常清晰的行业趋势:最近 DeepSeek 年前更新的新版模型、Anthropic 的 Claude Opus4.6,都在大力扩展上下文长度,其实也都是为了提高在 Agent 场景的模型效果。

但光有长上下文还不够,在长上下文里依然保持极高的指令遵循率,这才是 M2.7 的真正壁垒。

尤其是在需要大规模、高频次调用 Agent 的生产场景里,指令遵循率每提升一个百分点,都意味着更少的重试、更低的成本、更稳定的产出。

顺便提一点:M2.7 的 API 定价在国际同类模型中几乎是独一档的:

即便是企业级用户或者 OPC 用户,按月订阅最贵的极速版套餐,算下来一小时也不到一美金。而对于普通用户,用 Plus 或者 Max 的套餐来养龙虾,已经非常便宜且足够了。

讲到这,M2.7 的优势就非常清楚了:几乎顶尖的 Agent 能力水平(指令遵循效果和长上下文处理能力),同级模型里极低的调用价格。对于有需要大规模调用 Agent (比如养虾)的用户来说,M2.7 无疑是最好的选择。

回到开头那个公式:Agent = Model + Harness。

过去一年,做 Agent 产品的团队把大量精力花在了 Harness 一侧:任务编排怎么设计、记忆管理怎么做、工具调用怎么优化,工程层面越做越精细。

但很多 Agent 产品跑不好的根源,其实在 Model 这一侧:Harness 设计得再精巧,底层模型的指令遵循率撑不住、长上下文处理跟不上,Agent 的整体表现就是上不去。

M2.7 相当于把公式里 Model 这一项的能力抬高了一个台阶,带来的影响是连锁反应。

最直观的变化是,以前 Agent 里有些复杂任务是完成不了的,原因不是模型的 Harness 设计得差(比如龙虾用国产模型),是模型走到第四步第五步开始丢上下文或者调错 Skill。换上 M2.7 之后,这些之前「跑不通」的链条有机会跑通了。

还有一个容易被忽略但很巨大的变化:Token 成本。

Agent 每次任务执行失败后重试,消耗的 Token 都是真金白银。遵循率从 85%提升到 97%,意味着任务失败率大幅下降。在大规模调用的场景下,这笔省下来的费用相当可观。

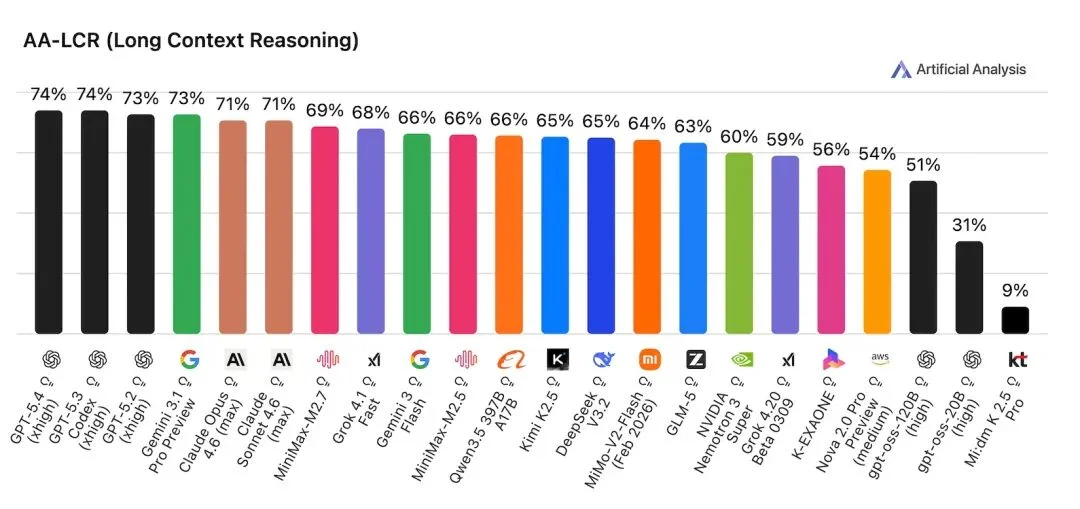

另外,MiniMax 在 M2.7 的研发过程中,做了一个有意思的实践:

让 M2 系列模型充当解决方案架构师,1 个人 4 天时间、零人工编码,自主搭建了一套包含 CI、测试、代码审查的完整开发 Agent Harness。再由这套系统进一步构建研究 Agent 系统,集成数据采集、训练、评测和协作能力。人类把控方向,模型负责构建,形成了一条模型自迭代的闭环。

这是我第一次听说,Agent 可以训练自己?!

我仔细想了下,背后的逻辑确实是成立的:如果一个模型的 Agent 能力足够强,它确实可以成为自身研发链条中的一环。

而这件事本身,可能就是对 M2.7 Agent 的 Harness 能力最有力的证明。

与此同时,MiniMax 同时开源了 Skills 库:

https://github.com/MiniMax-AI/skills

任何人都可以直接使用或者二次开发,进一步降低了所有人搭建 Agent 系统的门槛。

测完 M2.7,我对 Agent Harness 这个概念的理解从模糊变得具体了。

Agent Harness 确实不是「上下文工程换了个名字」那么简单。

Agent 的本质是模型能力(model)+工程设计(Harness)。 当模型的指令遵循和上下文处理能力足够强,Harness 的设计空间会被极大打开;反过来,再好的 Harness 也需要一个记得住事、听得懂话的模型来撑住。

M2.7 在这个方向上交出了一份很扎实的成绩单:

长上下文处理国内第一、40 个 Skills 下 97% 的遵循率、以及在同级模型中几乎独一档的 API 定价。

所以在大规模 Agent 调用场景下,不管你是创业者要在 Agent 产品接入、还是使用 Claude code 进行 Vibe Coding,或者说是在养龙虾,M2.7 目前就是国内模型里性价比最高的选择。

我现在更好奇的是:当更多开发者基于 M2.7 去搭建 Agent 应用,会跑出什么样的产品形态。模型的天花板提高了,产品的可能性也随之打开。

如果你正在玩龙虾,或者在做 Agent 相关的产品,我都建议你去试试 M2.7:

https://platform.minimaxi.com/subscribe/token-plan

有些东西,自己跑一遍,才会有最真实的判断。

文章来自于“特工宇宙”,作者 “特工小师 特工小天”。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0