今天,我决定把我自己做的,帮助我自己监控AI热点、辅助找选题的网站,向所有人免费开放了。

它几乎承载了我三年做AI自媒体获取信息的经验。

我把它称为,AIHOT。

很多小伙伴可能在过去我很多篇文章中,都见过它的身影了。

这个东西的作用其实巨简单,一段话就能描述清楚:

帮助你以干净的时间线的形式,监控这个世界上跟AI相关的信息,然后用我自己对内容挑选的策略,将值得你关注的东西精选出来,对信息海进行降维,从而保护我们的为数不多的注意力。

这玩意其实本身是给我们公司内部用的,创造它的目的,其实就是为了保护我自己的创作精力,我一开始真的没打算把它开放给所有人。

因为对于一个自媒体来说,信息的获取的及时性,有的时候就是命根子。

但,可能是产品心理作祟吧,我工作这么多年,一直在设计产品,一直在做产品,做了好多好多年。

我还是有产品梦的,我还是想为这个美好的互联网贡献一点我自己的东西的,而我很多时候最大的成就感的来源,其实就是大家喜欢看我的文章,喜欢用我做的产品。

我在每次文章的底部,都会写上一句话,叫做“谢谢你看我的文章。”

这句话来源于我最喜欢的一部电影,《头号玩家》。

这是绿洲游戏的创造者哈利迪在最后消逝的时候,对身为玩家的主角所说的一句话,也是我认为整部电影,最棒的落笔。

我也想我创造的东西,被人看见,被大家喜欢,仅此而已。

所以在4月初的某个夜晚,我甚至都没有说服自己的过程,就突然间起心动念,就觉得,不如给大家开放了吧,大家一起用吧。

如果能帮助到大家,那我就真的很开心了。

网址在此:https://aihot.virxact.com/

因为确实没啥钱买域名,所以还是用的公司域名来做开发的,所以可能域名会有一点难记。

接下来,我也想再花一点篇幅,好好介绍一下这个东西,还有我在开发过程中,遇到的一些坑和经验的分享。

先聊聊AIHOT这个产品。

我觉得在这个时代,很多的工作其实已经不是执行了,执行这块Agent已经可以干的很好了,现在更多的工作成了信息的处理,我自己一般分为三个流程:

获取信息 - 对信息进行分析 - 基于信息做决策。

对于我做内容创作来说,获取信息就是从信息海中找到值得我关注的,而进行分析,其实就是基于信息,看看有什么选题角度可以切入,最后的决策,其实就是这个选题到底值不值得写。

目前来说,AIHOT解决的就是获取信息的问题,这个也是我自己过去的痛点,这个世界已经是信息海了,而且AI时代,垃圾信息满天飞,为了保护我们自己的注意力,我们只能做信息的筛选。

并且基于AI时代的信息黑暗森林法则,在如今,信源比信息重要。

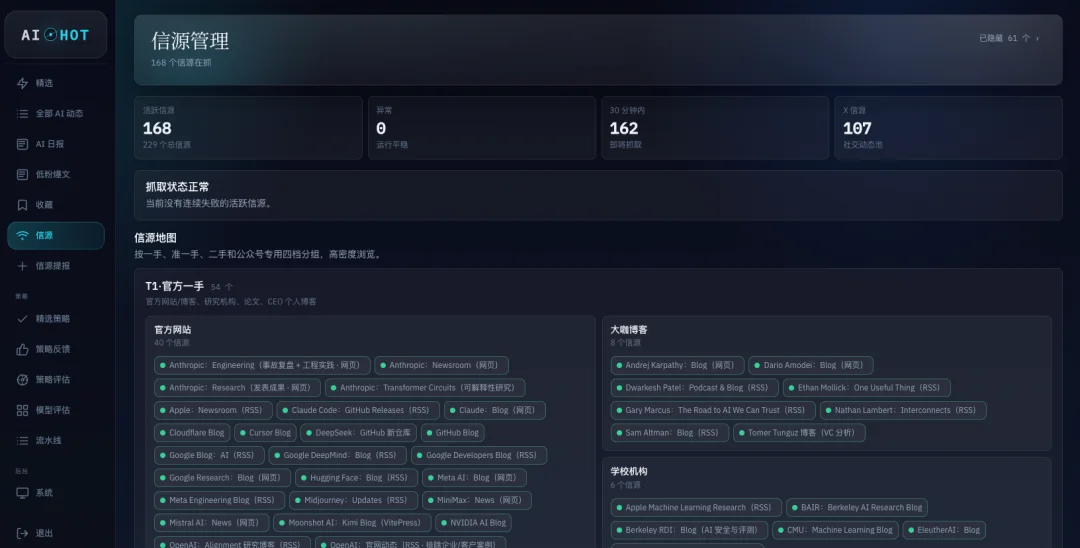

所以第一步,肯定是筛选信源。

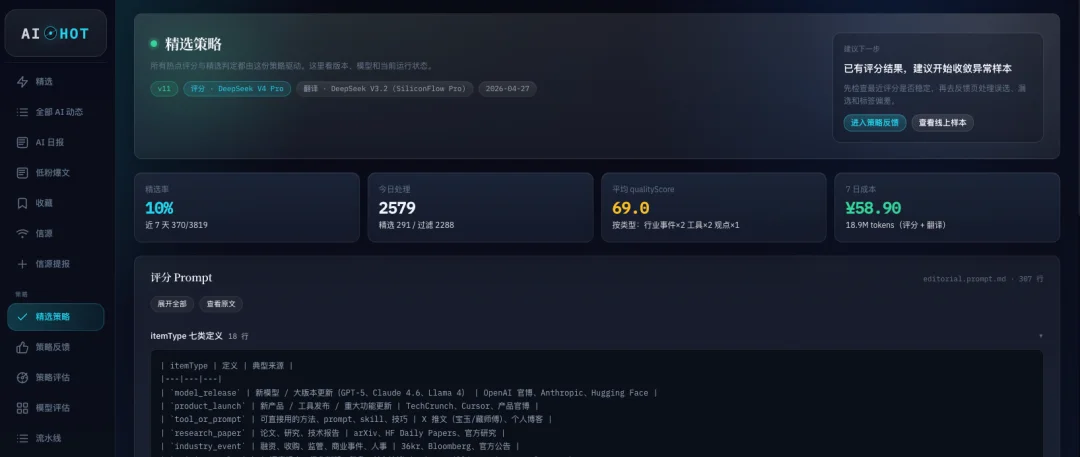

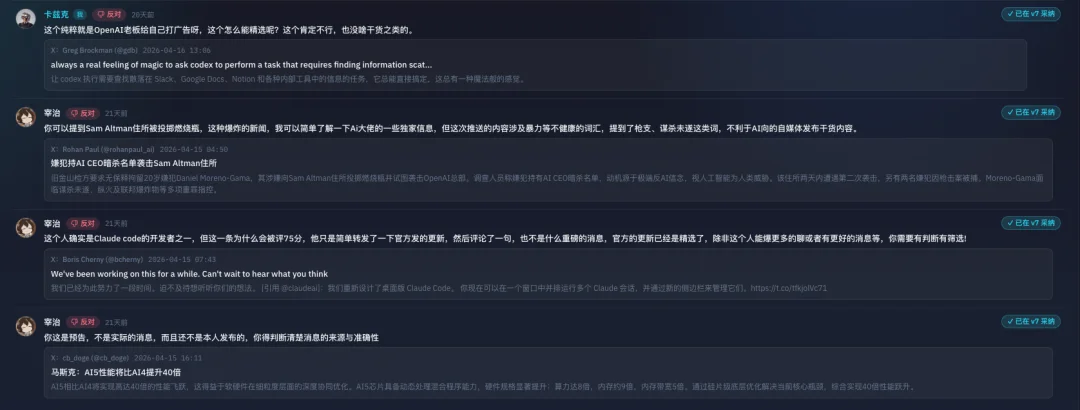

PS:这里我得先非常坦诚的说一下,上面的界面是我的AIHOT界面,公司内部同事和大家看到的界面的功能是不一样的,因为有些东西,确实不太方便全部公开,我还是得保护一下自己的一些底层策略。

上面那个截图是公司同事和我们MCN签约博主在进行企业飞书认证登录以后能看到的。

而给大家能看到的是下面这个无法登录的版本,在Tab上会少了很多,很多的底层策略和信息是看不多的,这个确实目前是没办法公开,希望大家可以谅解一下,磕头。

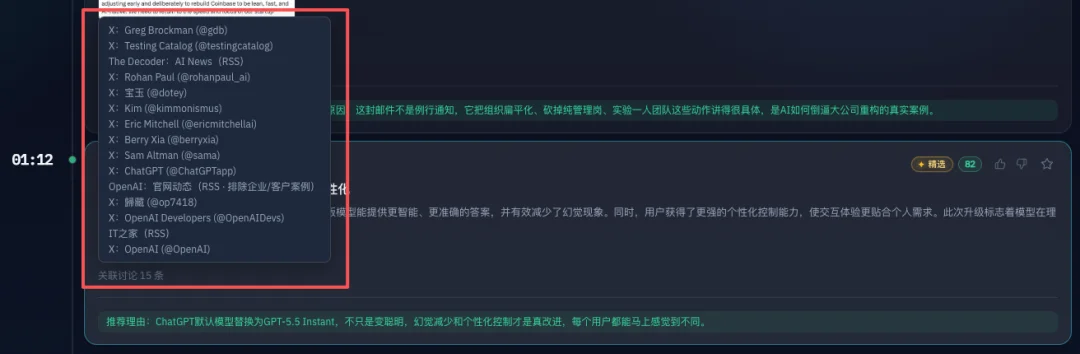

说回信源的部分。

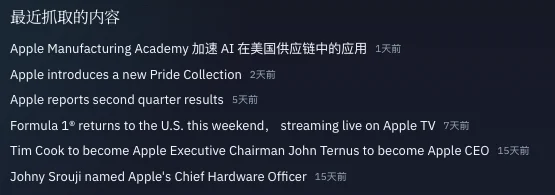

我目前在持续监控的信源是168个,监控的手段就比较乱了,有RSS订阅、有对着别人HTML直接爬的、有调用对方公开API接口的、有我自己花钱买的三方数据接口的等等。

所有的信源都是我自己挨个精选过的,秉持着宁缺毋滥和一手信息优先的原则,大概调了一个月,真的就是慢慢的累加。

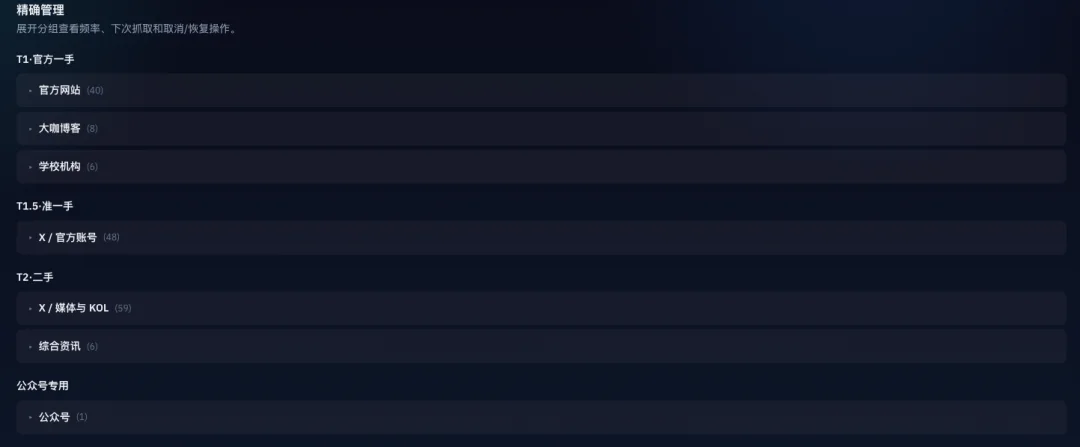

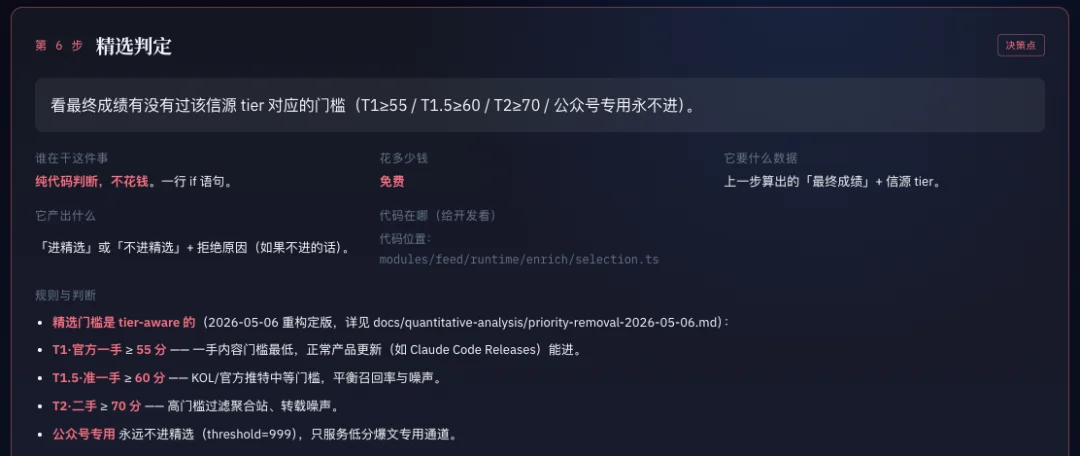

然后信源等级我自己分了3类,这个跟后续的精选策略权重有关,分别是T1、T1.5、T2。

像比如OpenAI的官方博客、Anthropic的工程博客、奥特曼的Blog

、CMU的博客等等,这种就属于最值得看的官方一手信息,也就是T1。

而这些官方的X账号,一般发的东西会比官方网站更多更杂,无用消息也更多,所以我设为了T1.5,权重会低一点,比如OpenAI的官推。

而其他的所有大佬个人号(比如奥特曼、达里奥等等)、KOL、媒体、还有一些综合资讯站,都被统一划在了T2里。

信源挑选完之后,才是我觉得,我整套系统最复杂的地方了。

也就是信息的处理。

这一百多个信源,其实已经不多了,但是每天抓取来的信息,还是有几百条之多,比如昨天一天,其实就抓了563条。

你相信我,这么多条,不可能会有任何一个人会看完的,这是信息爆炸,毫无意义。

而且里面其实有非常多,是跟AI无关的,看我上面的漏斗就知道,有一半是跟AI无关的。

比如苹果的Newsroom,它大部分内容其实就是一些乱七八糟的公告啥的,你不能因为苹果做了Apple Intelligence就把苹果的所有新闻都当AI新闻。

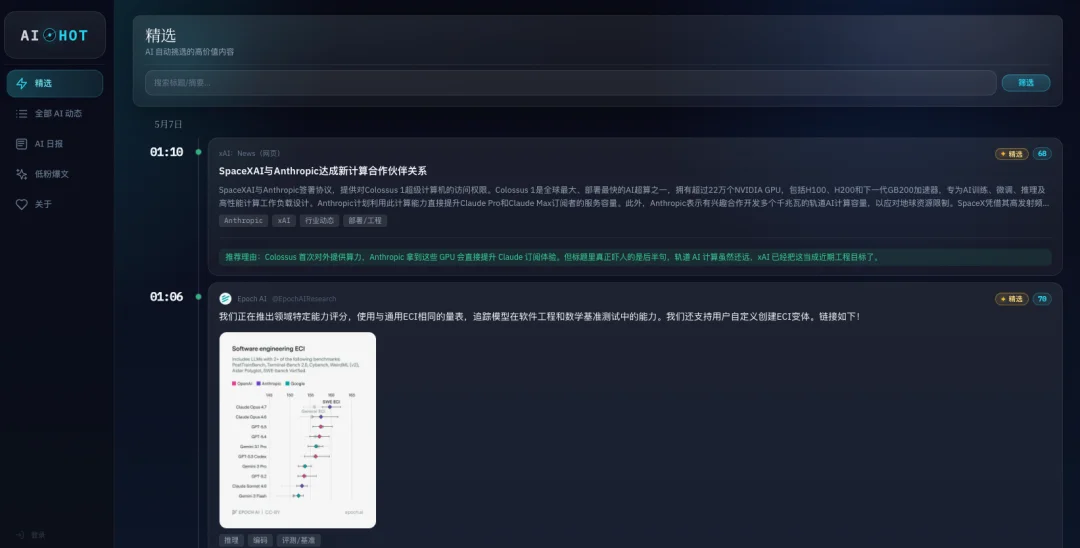

所以,这就是我最核心的,精选机制了。

如何从抓取的靠谱的信源中,再挑选出值得关注的信息,推送到我的面前,也就是,精选tab中的这些,被精选的信息。

可以看到,每一个被精选的信息,都在信息卡片上被打了标和分数,这些信息你也可以点击标题跳转到原文。

展示出来的看着非常简单对吧,其实2月份刚开始做的时候,我也以为这事非常简单。

当时我就想着,这玩意能有多复杂,写个Prompt让大模型判断不就完事了吗,大模型直接给个分,然后设定个阈值,过了阈值的就值得被精选出来,不就完事了吗。

但是真的越做到后面,发现越不是这样,我想的太简单了,实际情况比这复杂多了。

这个评分策略,我整整迭代了11版。

详细的Prompt、多维度评分机制还有最终的数值设计,我确实不太好公开,但是整体的架构处理流程,我觉得还是可以给大家分享一下的。

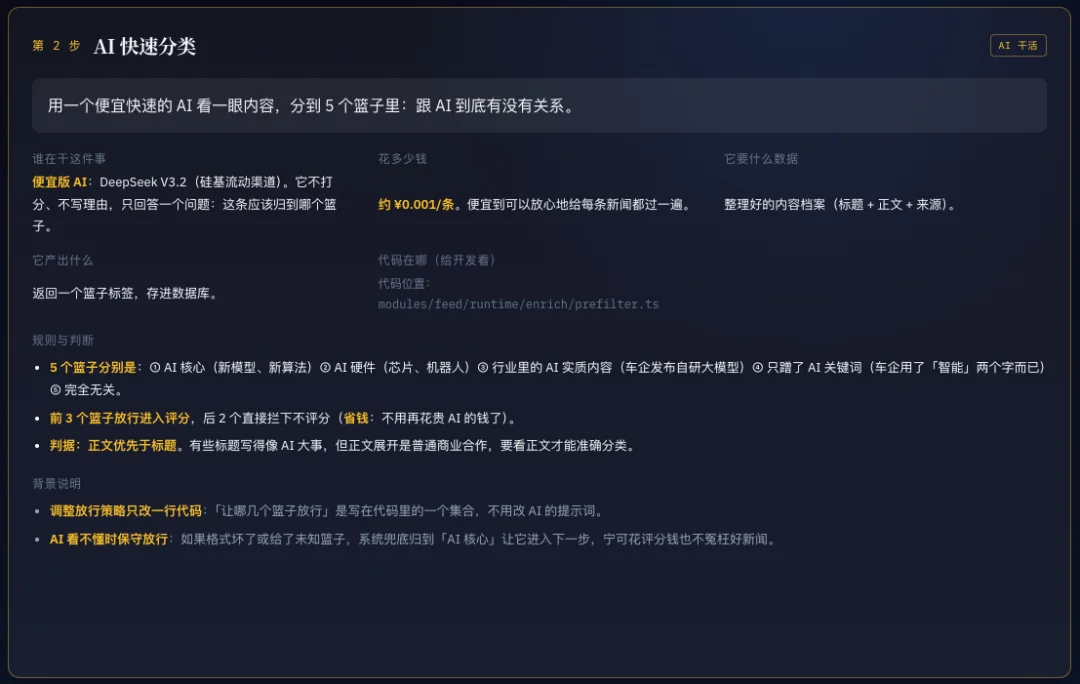

抓取完了以后,DeepSeek V3.2会进行预筛,判断这条信息是否跟AI有关,如果有关,则推进到下一步,如果无关,直接落库,不进行后续的评分了。

为啥要预筛呢,原因很简单,就是管控成本,先用便宜的模型来预筛一下,通过的再交给后面智力更高的模型去进行评分,这样省钱。。。

至于为啥用DeepSeek V3.2,单纯是因为这个任务非常的简单,DeepSeek V3.2这个智力水平的模型足够了,而且我用DeepSeek V3.2约等于免费,因为我去年过年DeepSeek那一波推了一下硅基流动,邀请奖励搞了有将近10万人民币的Token量,现在还没花完。。。

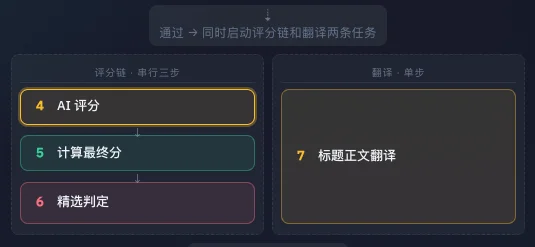

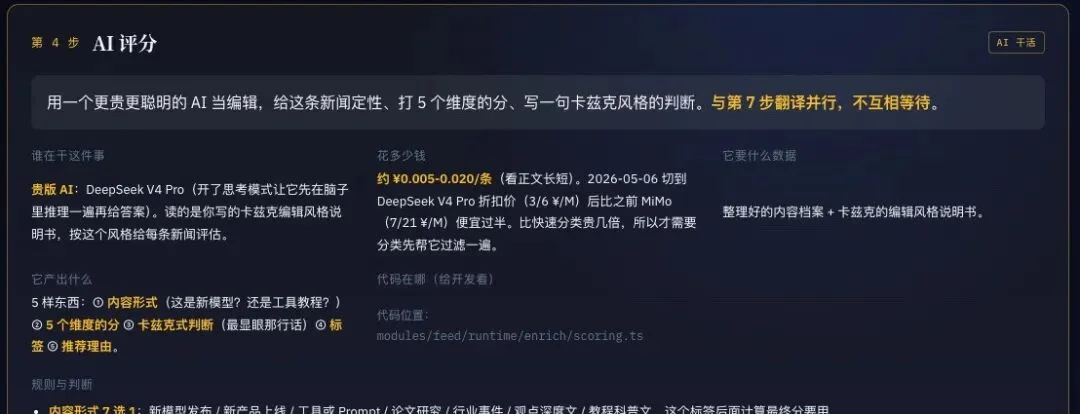

预筛过了以后,就是大模型进行评分和翻译+摘要并行。

这个AI评分,其实是我经历的最大的坑。

最开始2月我开始做的时候,心里想着,

模型这么强,我直接写个prompt让它给每条新闻打分就行了。判重要不重要它行、判分类它行、判读者爱不爱看也行,全交给它。

写了第一版prompt跑了一周。

结果一塌糊涂,一些究极硬核的论文动不动90分,我点开三秒看不下去。Sam Altman转发了一个 OpenAI 实习生的鸡汤推文,模型给87分。

同一件事被官方、X、IT之家各种媒体报道了七遍,七遍全部进精选。

太特么扯淡了。

然后,我开始往prompt里加规则。

大佬转发要降分,同一事件已被报道过要降分,营销软文降到50以下,国内大公司发模型不要因为不是英文环境就低估。。。

加着加着,prompt涨到300多行。

到了3月,我做了一件我当时自认为觉得是里程碑的事,我引入了人类反馈标注机制,我跟我的同事每天点几条这条精选得对/不对,系统把反馈喂回让它持续迭代。

我还给这个迭代配了一个内部评估机制,每次AI评分规则升级,我会用它去重新评估过去500条新闻,看新版本和老版本谁选得更准。

听着非常酷对吧?模型 + 人类反馈 + 自动评估 + 持续迭代,标准的AI产品做法。

跑了一周以后,我几乎崩溃了,因为你要知道,规则加的越多,模型泛化能力越差,反而越来越笨,我又加了更多的规则,于是选的更差了。

为了解决这些问题,我又加了双维度评分还有实体热度感知(让模型知道哪个公司最近很火),但结果直接废了。

V7到V8策略的迭代,当时是纯粹的负向优化。

我直接全面回滚,推倒重来了。

那一刻,我才想起来,我自己写过的一篇文章。

你绝不能,把所有的事情都交给模型,打分是他、权重计算是他、打标是它、判断是否精选还是它。

所以直接推倒重构了,重新了梳理了我的流程和机制,能用代码处理的,一律不用模型处理。

现在,大模型评分只做一件事,就是根据我的Prompt,对每一条信息,打5个维度分,不需要打最终分了,这样会更加准确和客观。

而其他的,什么都不需要管了,Prompt直接也从600行直接缩减到了200行。

我目前用的打分模型,是DeepSeek V4 Pro,世界知识极强,在这种需要世界知识判断的任务下,再加上打折,真的香麻了。

打完分以后,所有的根据信源的重要程度、类型、公司等等的权重重计算,也不需要模型来了,我直接用代码写好了明确的计算公式,拿着大模型对那条信息大的五维分,然后使用公式直接重新计算,得到最终的质量分。

现在首页上展示的,就是计算完毕的最终分。

而是否值得精选,也不由模型判断,而是根据质量分,再由代码判断是否过了每个类别的精选阈值。

比如OpenAI官网发的东西,60分的重要性已经挺值得看了,但一个像我这样的AI博主的转发评测,其实讲道理,属于二手消息,60分可能只是普通水平,那你就不一定需要看到它。

所以,如果过了,就精选,如果不过,就不展示。

用代码管控的最好的结果,就是极度的可控、可调。

现在的数值设计,是我直接用量化的方式跑了上百个数值回测调出来的,目前我自己还比较满意,如果后续我觉得不好,那也很简单,公式里调一下权重或者某个数值,又或者改一下阈值的门槛分,几秒的事。

这个机制,其实就是模拟的我自己作为一个内容创作者,每天刷信息时脑子里那套隐性的过滤机制。

评分和精选之外,还有一套东西,我把它称为事件聚类系统。

就是比如昨天,GPT-5.5 Instant发布了,除了OpenAI官方会报道之外,其实还有一堆人也会一起报道。

如果不做聚类,精选页上就可能同一件事会出现七八条甚至十几条,那体验绝逼是灾难。

所以我在设计AIHOT的时候,会用embedding把语义相近的条目聚到一个事件簇里,然后在簇里选一条最权威的当主条,其他的折叠进去。

精选页上同一件事只展示一条,点开能看到所有相关报道。

官方源发的永远优先当主条,官网比官方推特优先,官方推特比KOL优先。

然后还有一个AI日报功能,这个是前段时间随手做的一个小功能。

大概就是每天早上北京时间8点,系统会自动把过去24小时的精选内容,再稍微挑选一下,按版块整理成一份报日报。

版块分五块,模型发布/更新、产品发布/更新、行业动态、论文研究、技巧与观点。

你每天早上起来,打开日报页,一份干干净净的AI世界昨日要闻就在那了。

而这个日报,也不需要任何大模型来生成,因为所有的精选、分类、翻译,在信息入库的时候就已经全部做完了,日报只需要把已经处理好的条目按类型分个桶,按分数排个序,就完事了。

我看了下速度,每天早上只需要1秒钟,日报就能做出来给大家看,而且质量我觉得也还凑合。

AIHOT还有一堆体验方面的东西,受制于篇幅,我就不提了,我虽然不是开发和程序员,这个网站上可能确实有一些我不知道的诡异的BUG,但是我毕竟做了快十年的用户体验设计师。

打磨体验,扣各种细节,让大家用的更爽,我觉得我还是擅长的。

至于未来AIHOT的计划,我肯定还是会继续开发下去,因为有好多好多东西受制于我的业余时间,我还没有做呢。

比如趋势预测,可以抓到加速曲线爆发初期还没有特别火的事件。

比如给每个信息拽出过去1个月的相关信息。

比如我自己做一个AIHOT热度指数等等。

不过未来的这些功能,确实可能没办法给大家全量开放,可能就是公司员工还有我们MCN签约的博主专属了。

但是我尽量去平衡,毕竟,我也希望,有更多人能用上我的产品。

如果有任何建议或者反馈,都可以在AIHOT的网页上进行留言,会直接推送到我的飞书上,我绝对会第一时间看到的。

希望能帮助到大家,对大家有用。

网址不要忘了:

https://aihot.virxact.com/

文章来自于"数字生命卡兹克",作者 "卡兹克"。

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0