没有训练梯度的AI,打破了Atari游戏满分纪录。

OpenAI核心研究员翁家翌提出了一个强化学习新范式——

启发式学习(Heuristic Learning, HL)。

全程无神经网络训练、无梯度更新,全程靠GPT-5.4驱动的Codex自主迭代,硬是在经典游戏Breakout上打到了864分理论满分。

与传统深度强化学习优化神经网络参数不同,HL不依赖可微权重存储策略,而是将决策逻辑迁移到离散程序空间,以代码编辑替代梯度下降,通过显式的符号规则实现状态-动作映射。

在游戏、机器人仿真多项任务里,该方法性能甚至超过老牌强化学习算法PPO。

传统深度强化学习(DRL)长期默认智能体的决策核心必须依托神经网络实现。

比如在游戏里,当观测到游戏小球位于左侧时,神经网络通过复杂映射直接输出「向左移动」的动作;

但整个决策过程是隐式黑箱的,没人能清晰拆解内部逻辑,只能依赖梯度下降算法盲目迭代拟合。

也正因这种底层架构,深度强化学习始终难以逾越三大核心瓶颈。

一是灾难性遗忘。神经网络以参数存储习得技能,新任务的梯度迭代会直接覆盖旧有权重,无法实现多任务持续学习。

二是决策黑箱、不可解释。智能体每一次动作选择都隐藏在海量网络权重与矩阵运算中,无法追溯决策依据,也不能人工干预、拆解逻辑。

三是样本效率低下。依赖海量环境交互数据完成训练迭代,收敛周期长、算力消耗巨大,整体研发与落地成本高。

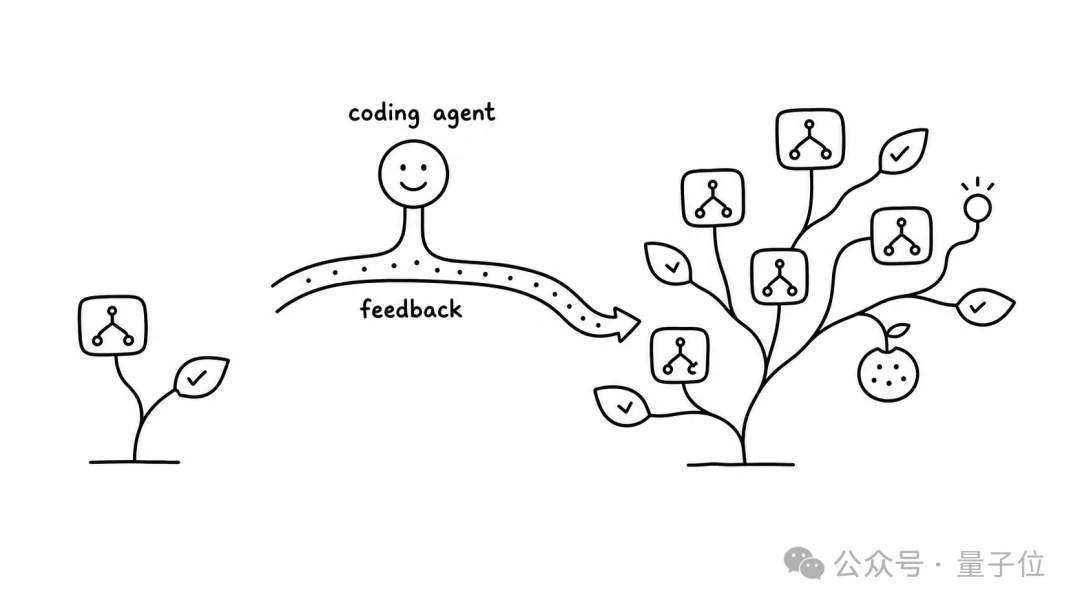

HL的思路很直接,既然参数更新是问题的根源,那干脆不要参数。

它把智能体的决策策略从神经网络的权重转化为可读的程序代码,把学习从梯度优化变成代码编辑。

在HL的框架里,AI维护的不再是单一策略文件,而是一套完整的智能化软件系统:

显式的状态检测器(“球在左上方,速度向右”)、显式的规则逻辑(“如果球将落在左侧,则向左移动”)、还有测试用例、回归检查、失败记录、版本历史。

每次迭代,Codex会审视系统表现,阅读失败录像,分析日志,然后做出结构性调整。

这种范式的关键的优势是:知识是显式的。

旧能力不会被覆盖,而是封装成模块和测试,随时可调用、可验证、可传承。

就像翁家翌说的:

HL把持续学习从“如何更新参数”变成了”如何维护一个持续吸收反馈的软件系统”。

当然,HL并不是完全排斥梯度技术,它内部某些组件(如模型预测控制MPC)仍然会用梯度做局部搜索。

但关键在于这类梯度运算不用于神经网络训练与参数更新,仅服务于实时动作决策。

而且这种架构设计让HL原生自带可解释、抗遗忘、高效率的特性。

不只是拿到Breakout的864分,翁家翌完成了完整的Atari 57大规模测试(Atari 57是行业公认的强化学习基准测试集,包含57款不同类型的经典游戏,覆盖离散动作空间的各类决策场景)。

每款游戏设置两种观测模式,各自重复三轮实验,最终生成342条独立的智能编码迭代轨迹。

结果显示,在统一环境交互步数的前提下,启发式学习HL的整体中位表现,已经和PPO等主流深度强化学习算法持平。

在Breakout、Asterix、Jamesbond等多款经典游戏中,成绩甚至超越人类玩家基准水平。

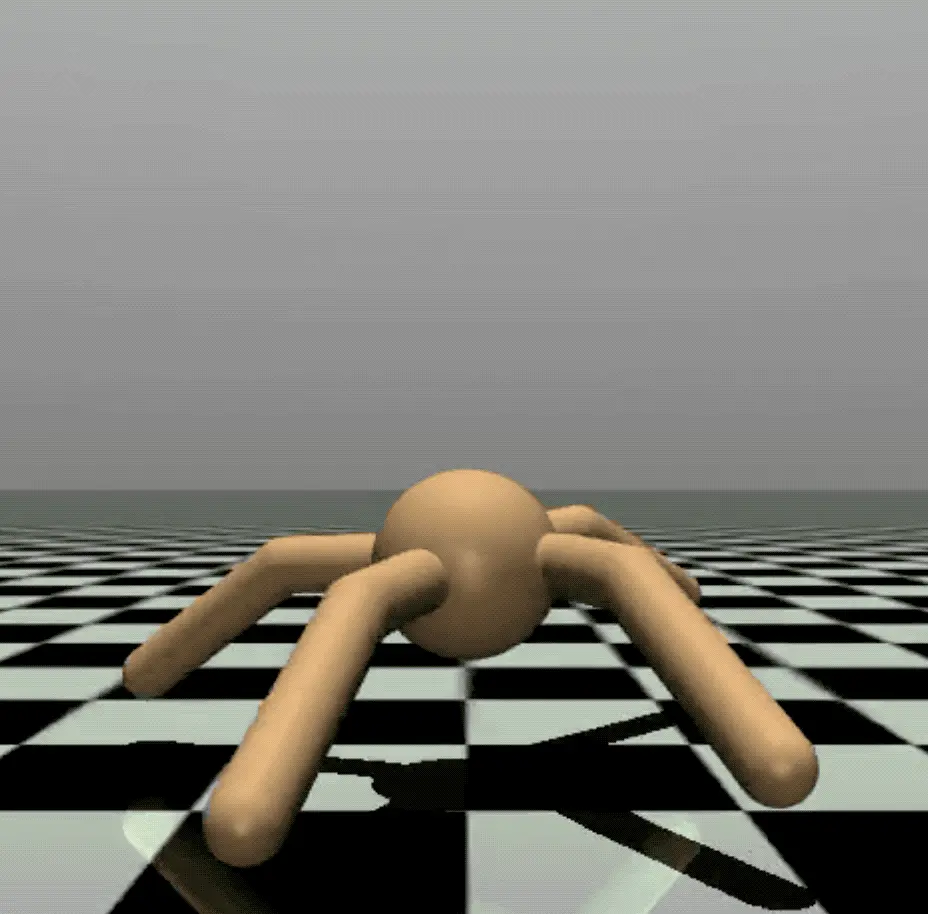

相比游戏离散决策,MuJoCo机器人连续控制任务难度更高。

以四足机器人Ant为例,需要协同调控8个关节,在高维连续动作空间中维持动态平衡。

启发式学习HL从基础节律步态规则起步,逐步迭代加入姿态反馈、触地信号感知、短程模型预测等逻辑,最终综合评分突破6000 分,性能完全对标专业深度强化学习模型。

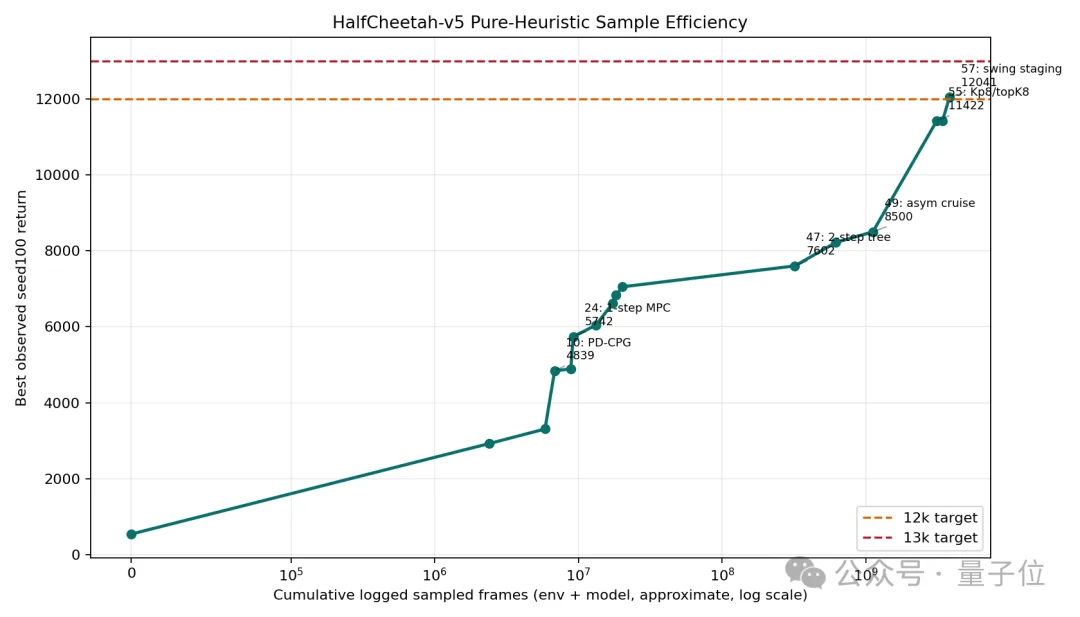

在HalfCheetah猎豹仿真任务中,HL更是跑出了11836的平均高分,展现出在复杂连续控制场景的极强适配能力。

不过翁家翌也没有回避HL的边界。

他直言:

在我目前认知范围内,我想不出有个agent能搓出一个纯Python code、不用神经网络去解决 ImageNet。

从原始像素中完成目标识别、特征抽象,依旧是深度神经网络不可替代的强项。

而启发式学习HL的核心价值,集中体现在策略持续迭代层面,当环境动态变化、需要长期自适应调整行为逻辑时,显性化的代码规则系统更适配持续学习需求。

所以,当下关键的命题在于如何把神经网络与HL有机融合,一并攻克在线学习与持续学习两大难题。

翁家翌指出最具落地前景的思路是,依托HL实时处理在线环境数据流,快速沉淀可复用的在线行为经验;

再将这些显性经验整理、内化,转化为可训练、可回归、可筛选的高质量数据集,反过来对神经网络做周期性迭代更新。

参考链接:

[1]https://x.com/Trinkle23897/status/2052596837547495549

[2]https://trinkle23897.github.io/learning-beyond-gradients

文章来自于微信公众号 "量子位",作者 "量子位"

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md