Claude Opus 4.7刚刚曝光!Claude Code一夜重构,7x24小时替你打工

Claude Opus 4.7刚刚曝光!Claude Code一夜重构,7x24小时替你打工太疯狂了!Anthropic刚刚发布Claude Code新版,上线神秘功能Routine:支持定时、API、GitHub三路触发,直接变身「云端员工」。更刺激的是,Opus 4.7即将本周闪电发布,直接跨界硬刚Adobe、Figma。

太疯狂了!Anthropic刚刚发布Claude Code新版,上线神秘功能Routine:支持定时、API、GitHub三路触发,直接变身「云端员工」。更刺激的是,Opus 4.7即将本周闪电发布,直接跨界硬刚Adobe、Figma。

从「缓存蒸发」到「12倍成本爆炸」,Claude智商一降再降。Anthropic辩解「不是惩罚是架构耦合」,但数据不会说谎:2月高效缓存让用户爽翻,3月静默回退后人人喊贵。这场隐私与性能的拉锯战,只有用户是真正的输家?

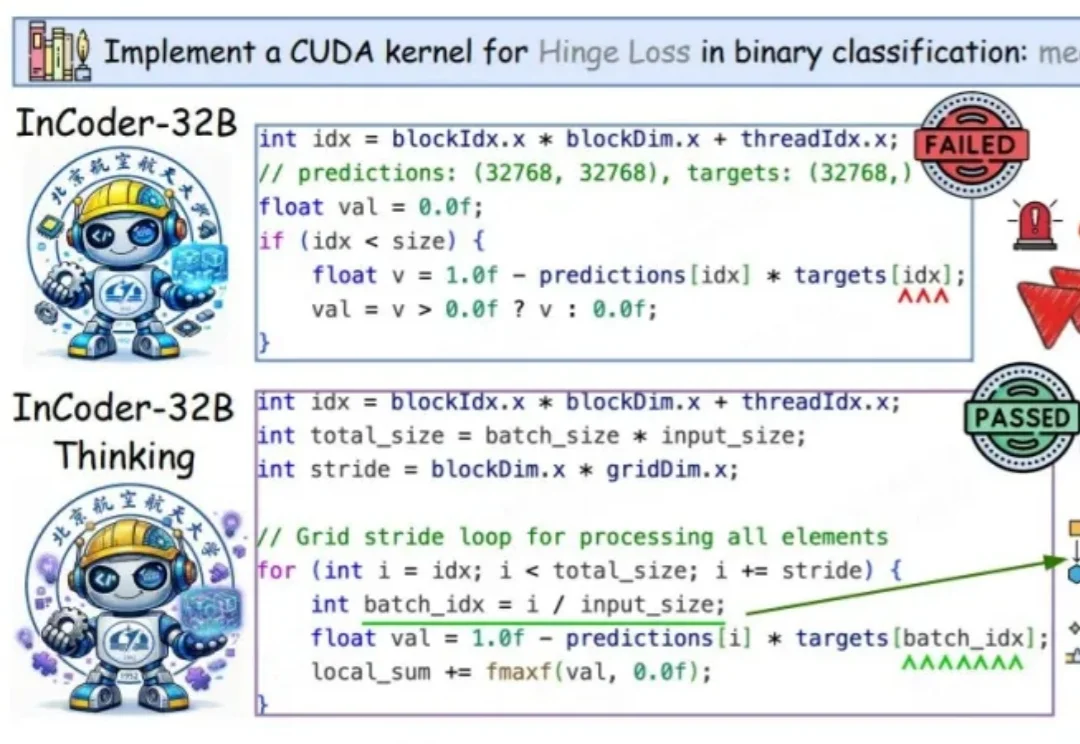

代码大模型会写代码,这件事已经不新鲜了。

港交所官网显示,中科院系AI公司北京中科闻歌已于4月12日正式披露招股书,冲刺“大模型决策第一股”。2025年6月,其以“秘交”方式递表港交所,由中金公司担任独家保荐人。

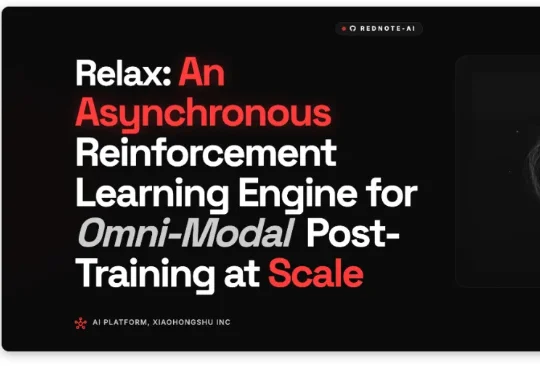

小红书AI平台团队刚刚开源了Relax——一个为全模态数据、Agentic工作流和大规模异步训练协同设计的现代RL训练引擎!实测全异步Off-Policy模式相比共卡On-Policy吞吐提升76%,相比veRL的全异步实现提升20%!

据外媒The Information曝料,微软近期刚刚重组了Copilot工程团队,并计划靠“龙虾”(开源AI Agent框架OpenClaw的昵称)逆风翻盘。这一重大组织变革由CEO萨蒂亚·纳德拉(Satya Nadella)亲自操刀,被列为公司“头等优先事项”。他提拔高管并组建了一支12人精锐队伍,计划在Copilot中构建类OpenClaw的AI Agent产品,

袭击奥特曼住宅的嫌疑犯,已被捕!科幻与现实的界限已模糊:当推动AI的人加速狂奔,恐惧AI的人举起火把——这场对抗,才刚刚进入最危险的阶段。

多智能体赛道爆发,Harness成为破局关键,资本加速布局。

未来我们到底需要什么样的家庭服务机器人,这家公司给了些许答案

南洋理工大学MMLab团队推出Hand2World,让AI世界模型真正「伸手」互动。只需在空中比划手势,模型就能生成逼真第一人称交互视频,实时响应调整。它摒弃旧有遮挡误导,用3D手部结构与射线编码解耦手与头运动,首次实现闭环持续交互。