Xiaomi MiMo Token Plan 全球发布

Xiaomi MiMo Token Plan 全球发布2025 年以来,大模型的能力边界被不断刷新。但对于大多数开发者和用户而言,“用得起”仍然是比“好不好用”更前置的问题。按量计费的模式下,每一次调用都伴随着对成本的不确定。 我们不希望这样。我们相信—

2025 年以来,大模型的能力边界被不断刷新。但对于大多数开发者和用户而言,“用得起”仍然是比“好不好用”更前置的问题。按量计费的模式下,每一次调用都伴随着对成本的不确定。 我们不希望这样。我们相信—

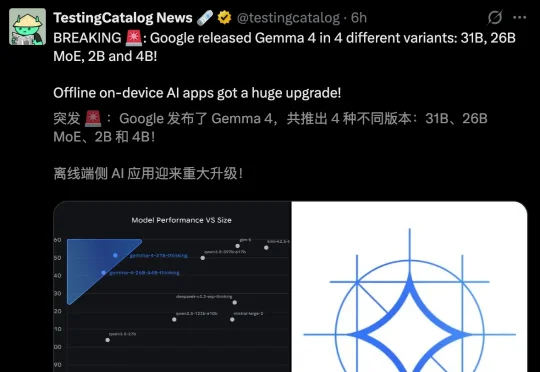

谷歌深夜掏家底!Gemma 4全系开源,仅用31B越级斩杀20倍体量巨头。数学能力暴涨68%,硬生生把前代打成计量单位,开源界迎来终极大洗牌!

AI 创业公司月之暗面正面加入日益激烈的顶级人才争夺。月之暗面即将推出一项新的顶尖人才校招计划,拟授予尚未毕业的实习生公司期权。这项名为 “穿越计划” 的顶尖人才校招计划针对 2027 届毕业生,首批名额为 16 人。在实习生通过月之暗面为期 3 到 6 个月的考察后,计划入选者将被直接授予期权股数,即使本人尚未正式毕业。

2026 年,每隔几天就会被一个新的 AI 刷屏,效率高到愚人节天天都过 —— 今天还是抽象脑洞,明天就可能已经被人做了出来。

招聘是企业中信息损耗最严重的场景之一:从业务方描述“我需要能解决这个问题的人”,到 HR 翻译成关键词逐一筛选,每个环节都在吞噬语义信息。初级 HR 30%~50% 的工作日花在重复的搜索与外联上;AI 工具普及后,单个职位平均收到近 250 份申请,被动渠道的质量更加被稀释。

刚刚,谷歌正式发布 Gemma 4,称“这是其迄今为止最智能的开放模型系列”。该系列面向复杂推理与智能体工作流设计,采用商业许可的 Apache 2.0 许可证开源。Gemma 4 提供四种规格:Effective 2B(E2B)、Effective 4B(E4B)、26B 混合专家模型(MoE)和 31B 稠密模型(Dense)。

据彭博社报道,OpenAI 的股票在二级市场上正在「失宠」。随着投资者迅速将资金转向其主要竞争对手 Anthropic,OpenAI 的部分股票在二级市场甚至变得难以出售。

每天 120 万亿 Tokens,这就是今天上午火山引擎 AI 创新巡展上,豆包大模型亮出的最新成绩单。

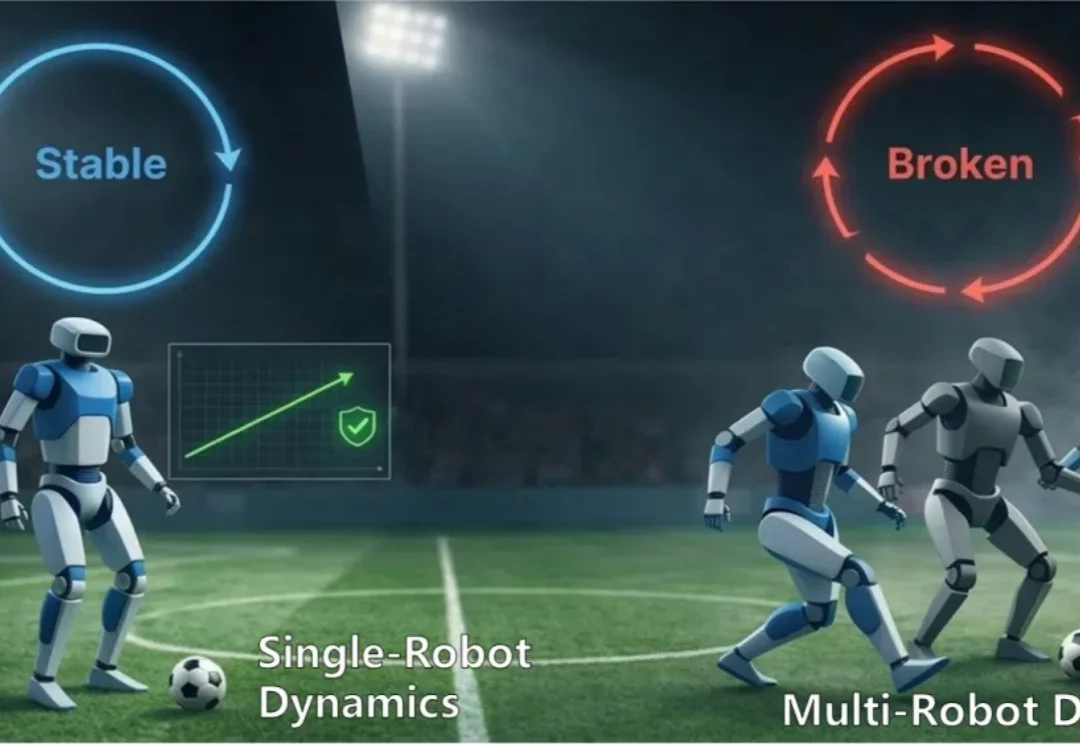

近年来,Decision-Coupled World Model 与 Model-based RL 在机器人领域取得了显著成功。通过学习环境动力学模型,智能体能够在内部模拟未来,从而进行规划与决策。但当系统从单机器人扩展到多机器人时,问题开始变得棘手。

谁能想到,OpenAI核心团队出来创业,竟被21家顶级VC拒之门外?结果5年后,这帮人为了抢一张入场券,不惜支付300倍溢价。复盘这场闹剧,我们只看到了一个词:活该!