风投真正想看什么:AI创业不是靠PPT活着,最致命创业错误是以为已经找到PMF

风投真正想看什么:AI创业不是靠PPT活着,最致命创业错误是以为已经找到PMF说到硅谷有名的投资人,Canvas Ventures创始人兼管理合伙人Rebecca Lynn的投资观点总能切中要害,不愧是将Lending Club推向美国2014年最大科技IPO的风投老将。

搜索

搜索

说到硅谷有名的投资人,Canvas Ventures创始人兼管理合伙人Rebecca Lynn的投资观点总能切中要害,不愧是将Lending Club推向美国2014年最大科技IPO的风投老将。

据我们了解,AI 硬件公司未来智能近日完成数千万元人民币的 Pre A+ 轮融资,由启明创投与上海国投孚腾资本联合领投。 未来智能成立于 2021 年,由科大讯飞 AI 耳机业务孵化、独立而来,后者在 2020 年就发布过第一款支持 AI 语音转写功能的耳机 iFLYBUDS。未来智能创始人、CEO 马啸曾任科大讯飞智能助手业务部总经理、智能耳机业务总经理。

据特工消息,百度将于 4 月 25 日开发者大会发布一款类似 Manus 的移动端通用 Agent 产品「心响」。据官方介绍,心响是一款以「AI 任务完成引擎」为核心的手机端超级智能体产品,通过自然语言交互帮助用户实现复杂任务拆解、动态执行与可视化结果交付。

我就想,能不能做一个监控,在奥特曼发X的时候,直接打电话叫醒我,这样,我就就不用干等了。该12点睡觉就12点睡觉,如果真的有啥新东西,啪一个电话直接把我喊起来,而不是每天在那傻傻的刷新。

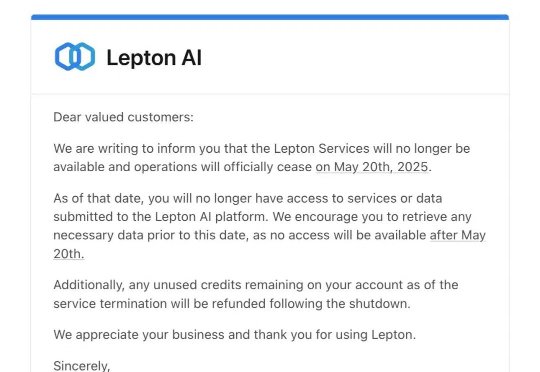

近日,网上曝出 Lepton AI 已通知用户,Lepton 将于 2025 年 5 月 20 日正式停止运营,此后用户将无法再访问 Lepton AI 平台上的服务或提交的数据,建议用户在该日期之前尽快下载或备份所需数据。服务终止时,若用户账户中仍有未使用的积分,官方将会在关停后予以退款处理。

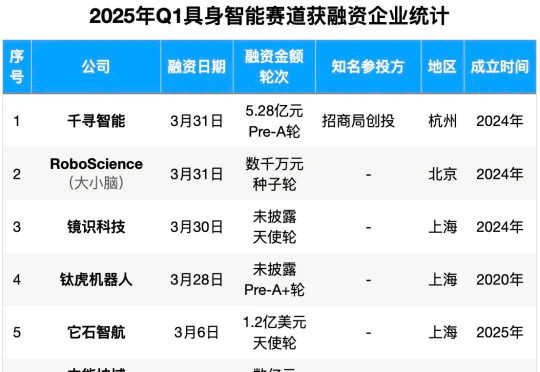

据智东西不完全统计,截至3月31日,今年第一季度国内人形机器人赛道的相关融资事件共37笔,涉及33家企业,融资金额约35亿元。相比于2024年前11个月人形机器人领域的49笔融资事件,第一季度的融资事件数量就已经达到去年11个月的70%。

3D生成明星玩家VAST,又又又又又开源了!Tripo Doodle(内部代号TripoSG Scribble) ,能够将简单的2D草图和文本提示(Text Prompt)实时转化为精细的3D模型。它改进了传统3D建模学习曲线陡峭、耗时耗力的痛点,尤其是在初期“打形”阶段。

可以生成无限时长的视频生成模型终于来了!

动画片和我们拍摄的视频其实还是有很大不一样的。一般来说,我们平时观看的大多数电视剧使用25帧/秒的帧率,大多数电影使用24帧/秒的帧率。对于摄像机而言,帧率的调节无非是改一改摄影设备的参数,即使是胶片时代,也仅仅是胶片使用量的区别,对人工影响不大。

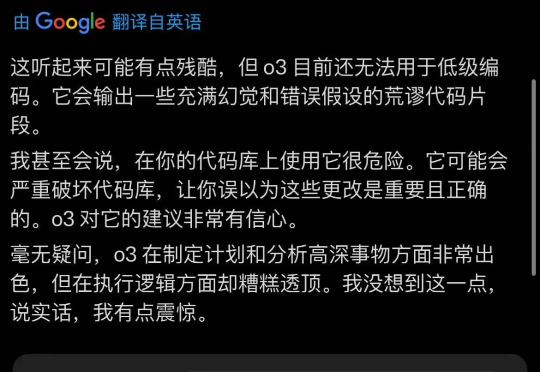

OpenAI新模型发布后,大家体感都幻觉更多了。甚至有人测试后发出预警:使用它辅助编程会很危险。当大家带着疑问仔细阅读System Card,发现OpenAI官方也承认了这个问题,与o1相比o3幻觉率是两倍,o4-mini更是达到3倍。