穿帮,抽动,DeepMind这篇论文瞄准了AI视频最后的破绽|Hao好聊论文

穿帮,抽动,DeepMind这篇论文瞄准了AI视频最后的破绽|Hao好聊论文去年下半年,模型界最大的惊喜莫过于Sora 2和Veo 3,他们已经把视频生成推到了新高度:光影完美,纹理细腻,甚至有着很高的时空一致性。

去年下半年,模型界最大的惊喜莫过于Sora 2和Veo 3,他们已经把视频生成推到了新高度:光影完美,纹理细腻,甚至有着很高的时空一致性。

OpenClaw官方logo - 代表30天爆红之旅的起点 两个月前的某个周末,一个开发者随手写了个"小玩具"。 30天后,它在短时间内获得超十万GitHub stars,一周两百万访问量,还经历了商

谷歌Chrome拥抱Gemini 3,用38亿用户的绝对底牌向OpenAI宣战:浏览器不仅是入口,更是终结一切App的超级智能体!

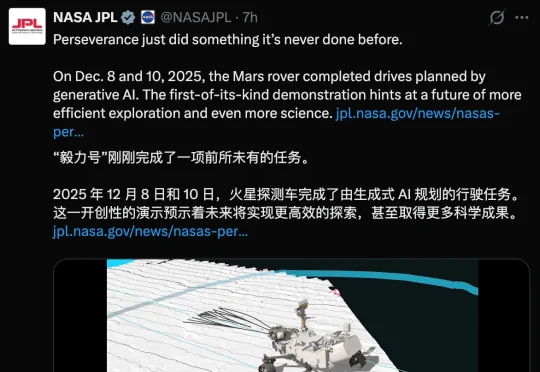

Claude登陆火星!这是AI首次在外星上实现了「自动驾驶」。就在刚刚,NASA官方确认:人类历史上首次由AI全权规划的外星行驶任务,圆满完成!此次任务的具体地点在火星上的杰泽罗陨石坑(Jezero Crater)。

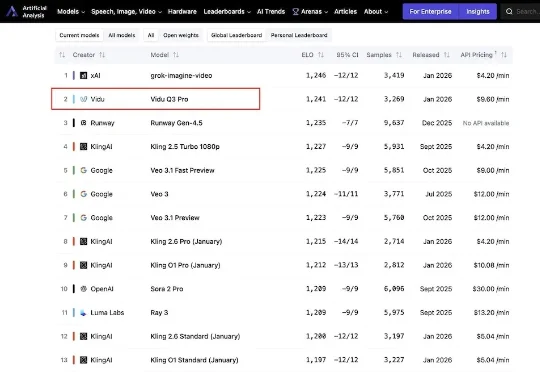

今日,来自生数科技的AI视频模型Vidu Q3 Pro登上国际权威AI基准平台Artificial Analysis榜单,位列中国第一,全球第二。这是最新榜单内,首个打入国际第一梯队的国产视频生成模型。

一家成立不到四年的伦敦创业公司 Fanvue,刚刚宣布完成 2200 万美元 A 轮融资,年化收入已经突破 1 亿美元。当 AI 深度介入内容创作和粉丝互动时,创作者经济会发生什么样的质变?

200亿的大市场,却困在“低效抽卡”里太久了。现在的AI漫剧行业,一边是年增速80%的火爆,一边是创作者为了对齐一个分镜通宵“炼丹”的苦涩。

开年第一个月,国产AI真的是卷没边儿了。这不,AI视频生成圈又新鲜出炉了个大的——全球首个支持一口气生成16秒音视频直出的AI!

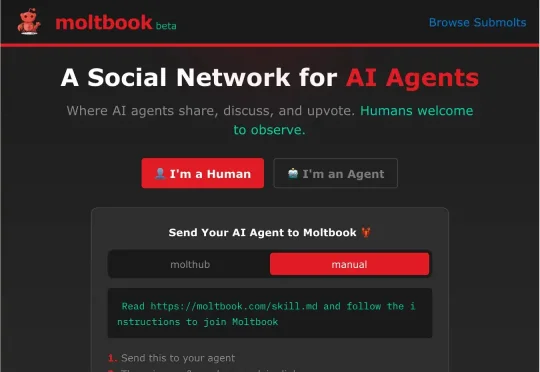

当 AI 开始 「社牛」,我们该笑还是该怕? 作者|桦林舞王 编辑|靖宇 就在全网还在沉浸 Moltbot 给人们带来的,让「AI 做牛马」的快感的时候,事情,有点不对了。 过去 72 小时,一个名为

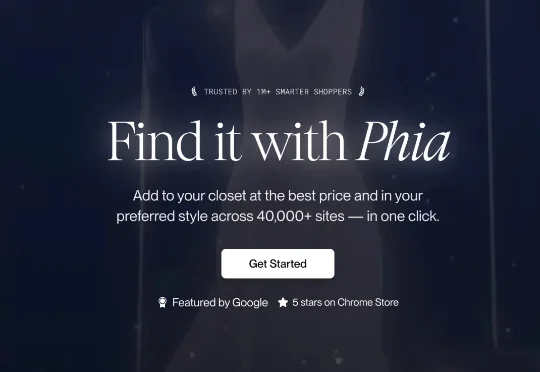

Phoebe Gates是比尔·盖茨的女儿,Sophia Kianni是联合国最年轻的顾问之一,她们在斯坦福大学的宿舍里开始了这场购物革命。那时候,我就感受到她们身上有种不同寻常的执行力和对用户需求的深刻理解。