百度这次彻底治好了我的 Token 焦虑

百度这次彻底治好了我的 Token 焦虑感觉大家对追新这事,没那么上头了。

搜索

搜索

感觉大家对追新这事,没那么上头了。

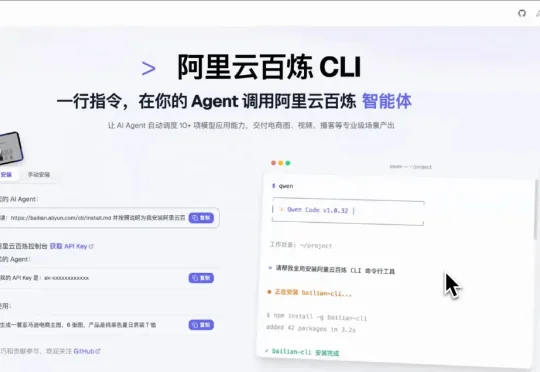

今天,阿里云百炼核心能力已CLI化 ,仅需一行命令,即可让Agent自动接入阿里云百炼的150多款模型、十多款应用,以及知识库、记忆、联网搜索等全套能力。百炼CLI专为Agent设计,原生支持Clau

2026移动云大会,中国移动和火山引擎,一个运营商国家队,一个AI圈顶流,共同宣布了一个叫「机密大模型」的服务模式。

每天 120 万亿 Tokens,这就是今天上午火山引擎 AI 创新巡展上,豆包大模型亮出的最新成绩单。

10倍速度,重写单位经济:Fal.ai 通过自研推理引擎和极致的软件优化,实现比主流方案快一个数量级的推理速度。商业指标惊人。据Sacra估算,Fal在2025年7月达到约9500万美元年化收入run rate,较2024年7月约200万美元同比约4650% 。技术优势完全转化为市场无法忽视的经济优势。

从未见过如此凡尔赛的名场面。云计算一哥亚马逊云科技CEO Matt Garman,在自家年度盛宴re:Invent 2025中,因为还要发布的新产品太多了,于是他在现场来了一句: 我挑战一下10分钟内发布25个产品!

一次「常规更新」搞崩半个地球,Cloudflare CTO紧急谢罪:我们搞砸了!Cloudflare自杀式Bug引发连锁反应,波及全球20%网站。当数百万爬虫撑爆了防御名单,Cloudflare的崩溃揭示了AI时代最深的基建隐忧,人类还能跟得上AI进化的脚本吗?

在一场仅有少数头部机构参与的AI Infra闭门会上,一位顶尖AI公司创始人的这句话,让在场的许多云服务资深人士陷入了长久的沉默。

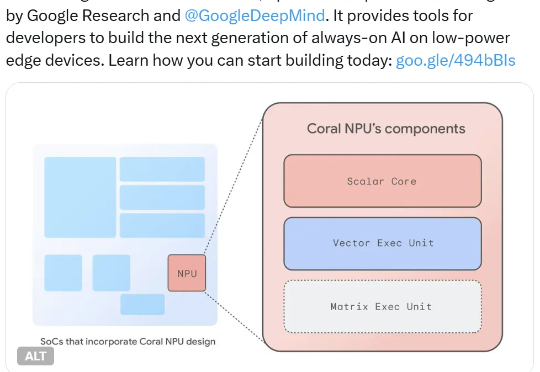

他们又推出了 Coral NPU,可用于构建在低功率设备上持续运行的 AI。具体来说,其可在可穿戴设备上运行小型 Transformer 模型和 LLM,并可通过 IREE 和 TFLM 编译器支持 TensorFlow、JAX 和 PyTorch。

新加坡时间 10 月 9 日,Zenlayer 于新加坡科技周——云与 AI 基础设施展正式发布 Zenlayer 分布式推理平台(Zenlayer Distributed Inference)。该平台作为一站式 AI 即时部署解决方案,专注于在全球范围内为大规模 AI 推理提供高性能支持。