英伟达放弃GPU上LPU:新推理芯片被曝Groq即买即用,OpenAI第一个吃螃蟹

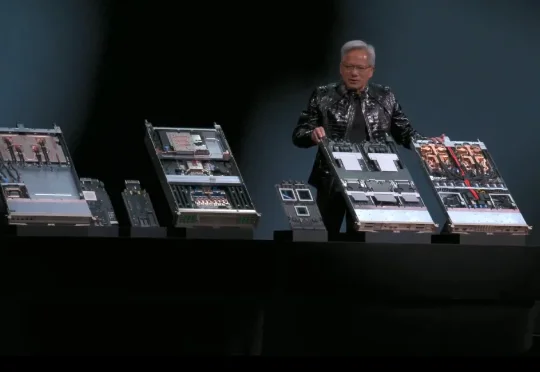

英伟达放弃GPU上LPU:新推理芯片被曝Groq即买即用,OpenAI第一个吃螃蟹据悉,在即将开幕的3月圣何塞GTC大会上,黄仁勋将发布一套全新的AI推理系统—— 核心是一颗专为推理优化的新芯片。而且芯片的首位大客户已经敲定,就是刚刚完成1100亿美元巨额融资的OpenAI。

据悉,在即将开幕的3月圣何塞GTC大会上,黄仁勋将发布一套全新的AI推理系统—— 核心是一颗专为推理优化的新芯片。而且芯片的首位大客户已经敲定,就是刚刚完成1100亿美元巨额融资的OpenAI。

今天,Gemini 3 Deep Think重磅升级,几乎刷爆全领域的SOTA,标志着AI推理能力进入了全新维度。这一次,在科学研究和硬核工程领域,Deep Think堪称一个「最强大脑」。

果然,离开了OpenAI,大家都有美好的未来。(doge

斯坦福与英伟达联合发布重磅论文 TTT-Discover,打破「模型训练完即定型」的铁律。它让 AI 在推理阶段针对特定难题「现场长脑子」,不惜花费数百美元算力,只为求得一次打破纪录的极值。从重写数学猜想到碾压人类代码速度,这种「激进进化」正在重新定义机器发现的边界。

AI 推理基础设施公司 Baseten 近日完成一轮 3 亿美元的成长型融资,投后估值约 50 亿美元。与不到六个月前的一轮重要融资相比,公司估值几乎翻倍。 这一交易清晰地表明,在大模型训练之外,推理

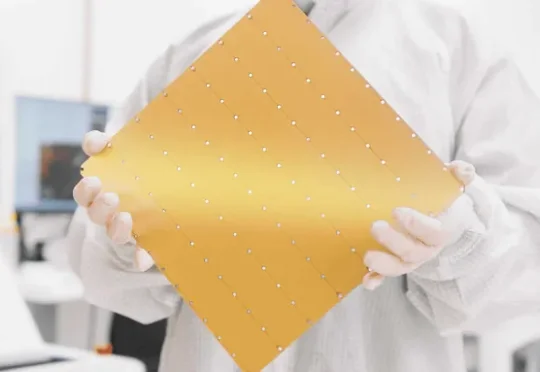

今天,OpenAI与美国AI芯片独角兽Cerebras联合宣布,将部署750兆瓦的Cerebras晶圆级系统,为OpenAI客户提供服务。该合作将于2026年起分阶段落地,并于2028年之前完成,建成后将成为全球规模最大的高速AI推理平台。

北京时间 1 月 6 日凌晨 5 点多,英伟达创始人兼 CEO 黄仁勋在 CES 2026 发表了主题演讲,演讲核心只有几个字——物理 AI。期间有一页 PPT 暂时没展示出来,他自嘲道演讲场地在拉斯维加斯所以应该是有人中了头奖导致的。期间,他和两台小机器人的互动,成为了本次演讲的名场面之一。

2027年落地,主攻AI推理。

AI一分钟,人类十年功! 一觉醒来,AI推理模型已横扫特许金融分析师CFA考试。在一级考试中,Gemini 3.0 Pro创下97.6%的历史最高纪录。二级考试中,GPT-5以94.3%的成绩领先。

而今天,来自 UIUC、华盛顿大学等机构的一群研究人员,通过一篇重磅论文《推理的认知基础及其在大型语言模型中的体现》,为这个“认知鸿沟”画出了一张精确的微观解剖图。