大佬深度解析:Coding Agent的底层运行逻辑是什么?

大佬深度解析:Coding Agent的底层运行逻辑是什么?在本文中,我将探讨编码智能体(coding agents)及其智能体编排(agent harnesses)的整体设计:它们究竟是什么、工作原理如何,以及在实际应用中各组件是如何协同运作的。

在本文中,我将探讨编码智能体(coding agents)及其智能体编排(agent harnesses)的整体设计:它们究竟是什么、工作原理如何,以及在实际应用中各组件是如何协同运作的。

「小猫补光灯」的作者花生...啊不...这人改名叫花叔了...hhhh,又整了一个新活:一周 8000 多个 star

LangChain 只换了模型外面的基础设施——同一个模型、同一套权重——就从 TerminalBench 2.0 排行榜 30 名开外直接跳到了第 5 名。另一个独立研究项目让大模型自己优化这层基础设施,达到了 76.4% 的通过率,超过了所有人工设计的方案。

相信大家都能感觉到,进入2月以来,“上下文工程”、“Vibe Coding”的热度已经让位给了一个新名词:"harness engineering"。

近日,哈尔滨工业大学(深圳)联合深圳河套学院、Independent Researcher提出了隐式思考模型 LRT(Latent Reasoning Tuning),通过一个轻量级的推理网络,将大模型冗长的「思维链」压缩为紧凑的隐式向量表征,一次前向计算即可完成推理,无需逐 token 生成数千字的中间推理过程。

Modus 以 8500 万美元 融资的消息却撬开了这块大陆,它引发的深远影响不仅仅关乎金钱的流动,而是深刻挑战了这个“稳固”的行业底层架构。本轮融资由 Lightspeed Venture Partners 领投,Garry Tan 等投资人参与,但更令人注目的是,这家公司没有走典型的 AI 路径

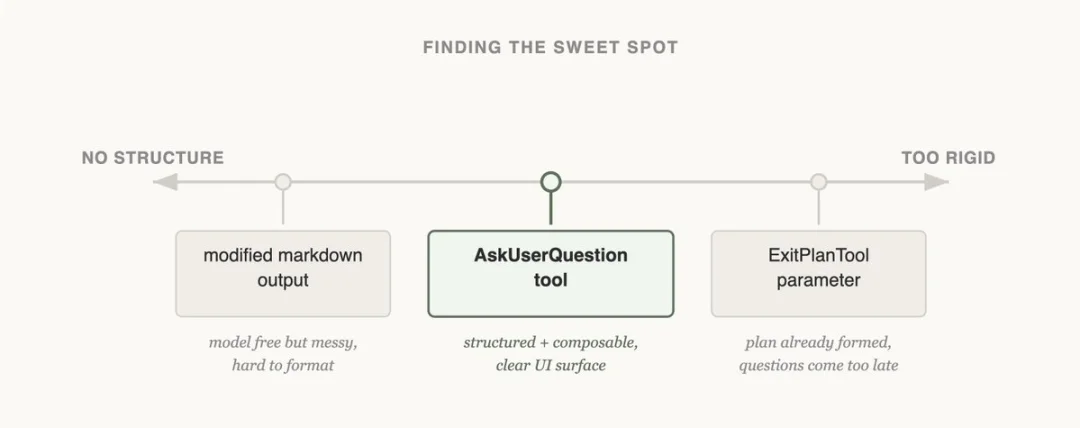

本文翻译自 Anthropic 官方博客「Seeing like an agent: how we design tools in Claude Code」,作者 Thariq Shihipar,Claude Code 团队工程师,今天发布。以下为逐段中英对照翻译

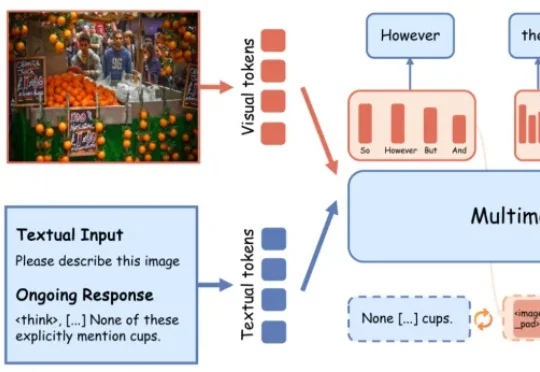

多模态大推理模型的幻觉,很多时候并非「没看见」,而是在最不确定的推理阶段想偏了。最新研究发现,模型在生成because、however、wait等transition words时,往往处于高熵关键节点,更容易脱离图像证据、转向语言脑补。LEAD在高熵阶段不急于输出单一离散token,而是先在潜在语义空间保留多种候选推理方向,并通过视觉锚点持续拉回图像证据,显著缓解幻觉。

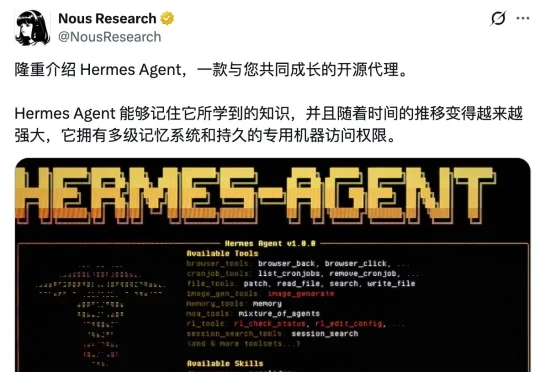

这个爆火的开源项目,叫做 Hermes Agent,地址:https://github.com/NousResearch/hermes-agent是由 Nous Research 团队倾力打造的开源Agent。

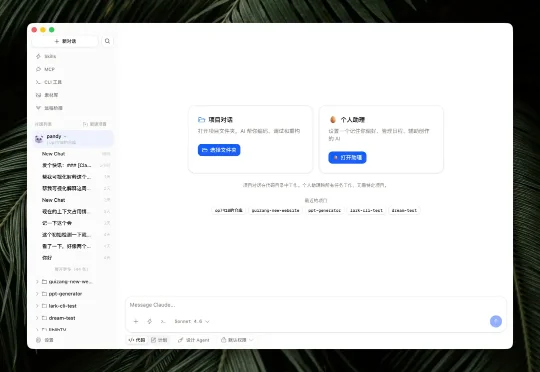

Codepilot 是藏师傅从今年一月开始纯 Vibe Coding 写个一个全平台通用开源 Agent 客户端。截止目前已经迭代了几百个版本,github 的 Star 也来到了 5100. 支持你能想到的小龙虾和 ClaudeCode 等 Agent 所有的能力,比如: