一文搞懂 Coding Agent 和 Harness

一文搞懂 Coding Agent 和 Harness在这篇文章里,我想介绍编码智能体(Coding agents)以及 Agent harnesses 的整体设计:它们是什么、怎么运作,以及各个零件在实践中怎么拼到一起。

在这篇文章里,我想介绍编码智能体(Coding agents)以及 Agent harnesses 的整体设计:它们是什么、怎么运作,以及各个零件在实践中怎么拼到一起。

最近,AI 圈子里又冒出一个新词:Harness Engineering。

这几天我注意到,我的「杉森楠 AI H1|海内外产品交流」群里,大家一直在聊 Claude Code 和 Skills。

2026 年才开始,全球 AI 行业就迎来了第一个开年王炸。不是来自某个更大的模型参数,不是某家实验室刷新了榜单分数,而是一个看似不起眼、却迅速破圈的概念——Agent Skill。

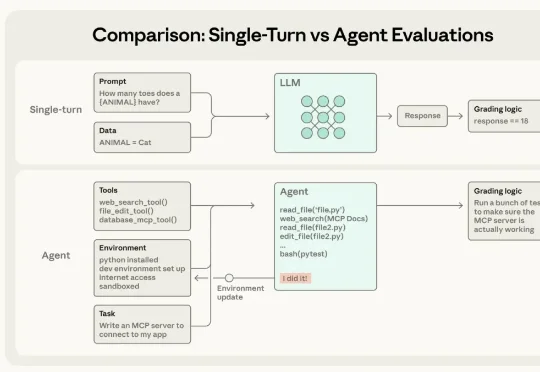

Agent 并不是一次性输出的系统。它们运行在多轮交互之中:调用工具、修改内部状态、根据中间结果不断调整策略。也正是这些让 Agent 变得有用的能力 ——自主性、智能性与灵活性 —— 同时也让它们变得更难以评估。

谭老师我, 每年会找几个看似冷门, 其实值得深挖的选题, 啥意义,没苦硬吃? 这是拉开认知差距的办法。 科技这行,赚小钱靠信息差, 抓大钱靠认知差, 这篇灵感来源于, 有几位搞AI底层技术的朋友常说,

最近在研究 RAG 系统优化的时候,发现了一个有意思的格式叫 TOON。全称是 Token-Oriented Object Notation,翻译过来就是面向 Token 的对象表示法。

编辑|张倩、陈陈 当智能体(Agent)开始深度介入人类世界,关于豆包 AI 手机的讨论可能只是个开始。 在此之前,手机、电脑软件都是给人用的 —— 人负责一步步操作,系统负责把信息存好、算好。但现在

“既然我可以直接使用 PyTorch,为什么还要费心使用 CUDA 呢?”

最近看到一篇关于Claude Skills的质量非常高的文章, 标题:Claude Agent Skills: A First Principles Deep Dive 链接:https://leehanchung.github.io/blogs/2025/10/26/claude-skills-deep-dive/