帮普通人「驯服」Agent,这支硅谷初创团队冲上了X全球热搜

帮普通人「驯服」Agent,这支硅谷初创团队冲上了X全球热搜「用一句话交代任务,然后什么都不用管,AI 自动执行。」这或许是大家最初对「AI 超级助手」的想象。

「用一句话交代任务,然后什么都不用管,AI 自动执行。」这或许是大家最初对「AI 超级助手」的想象。

Lindy.ai 的创始人 Flo Crivello 做了件挺大胆的事:把 AI 助理塞进了 iMessage。不是做一个新 App,不是搞一个聊天界面,就是直接出现在你的短信列表里,像一个真人助理一样跟你对话。

2026 年 3 月 30 日,#CreaoAI 冲上 X 全球热搜 Top 3。我们刷到这条热搜的时候,第一反应是:这次的用户反应有点不一样。不是常见的"AI新闻"传播路径——科技媒体报道、KOL转发、然后消失。这次的评论区里,不同语种的用户开始自己动手,有人让它每周一给 Gmail 邮箱里发送实时报价报告,

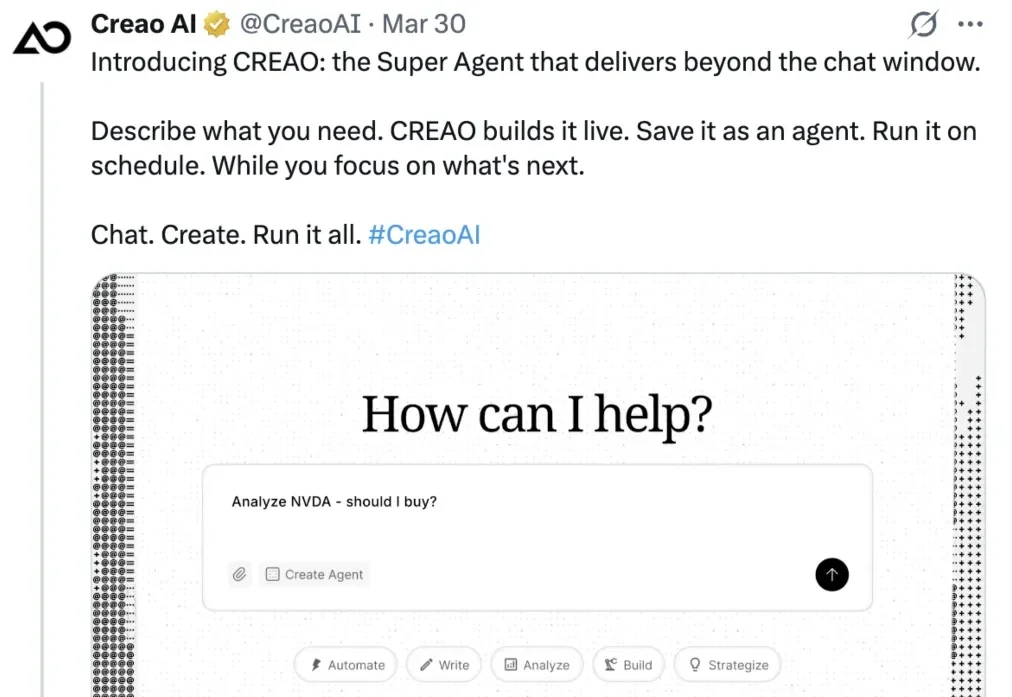

Google 最新发布的 Gemma-4-31B 基础模型出现了越狱版本,安全限制被完全移除。这个名为"Gemma-4-31B-JANG_4M-CRACK"的模型已经公开发布在 Hugging Face 上,任何人都可以下载使用。

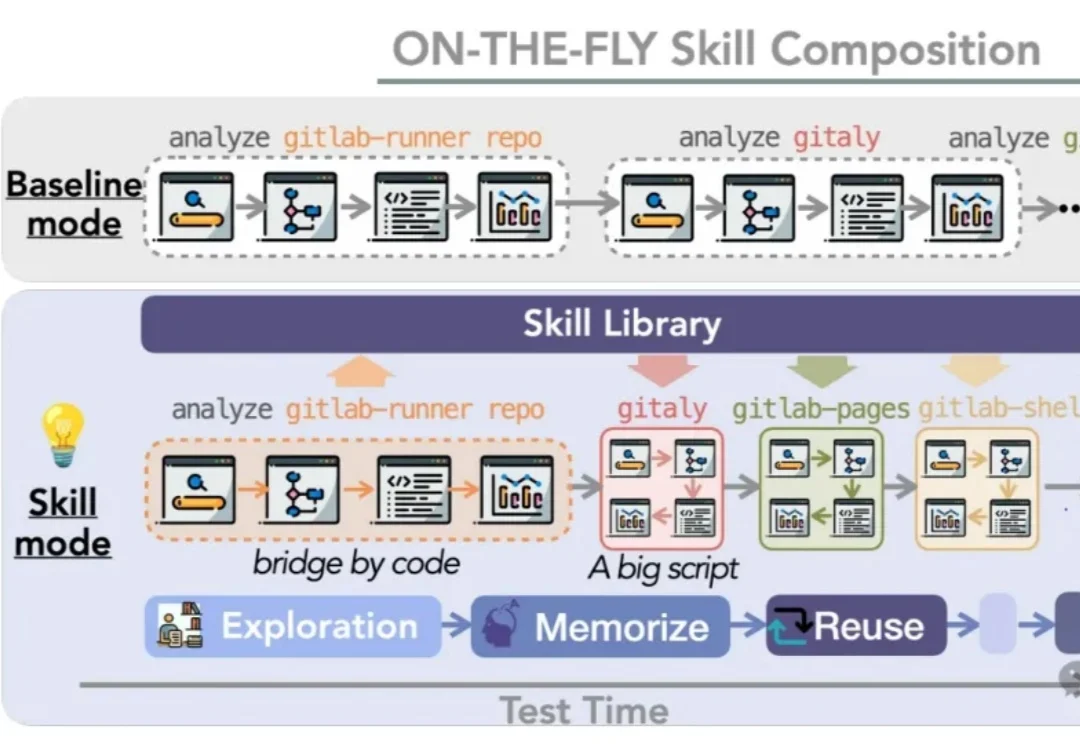

AI会用工具了,问题才真正开始…

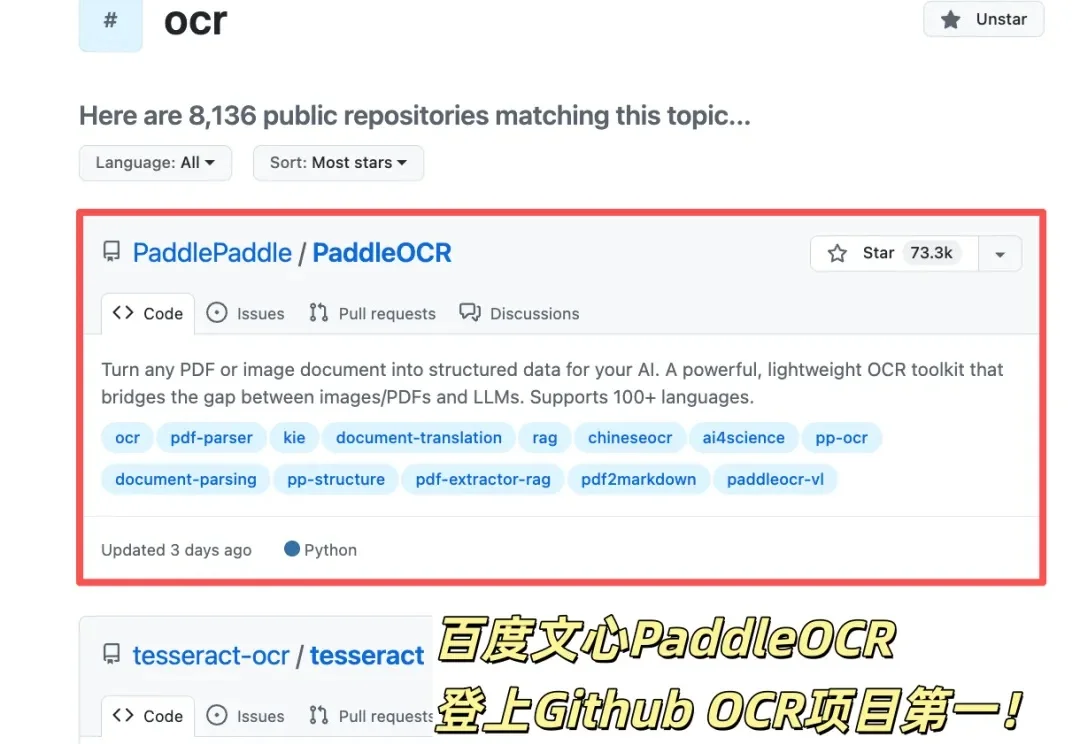

GitHub OCR项目之王刚刚历史性易主。

三月的Claude,不是在崩,就是在去崩的路上。状态页48条incident、major/critical事故窗口累计超44小时——这还是保守算法。更离谱的是,$200/月的Max顶配用户反映一小时不到就被限流,项目做到一半突然断供,零预警。推特上「60秒退订教程」疯传,开发者成群结队涌向Codex+GPT 5.4。但逃到对岸就安全了吗?OpenAI状态页显示:Codex三月也崩了7个小时。

Cheng Lou:React 核心团队成员,参与 ReactJS 的早期开发;主导了 ReasonML(后来演变为 ReScript)的开发;目前在 Midjourney 工作,参与 AI 图像生成平台的开发。

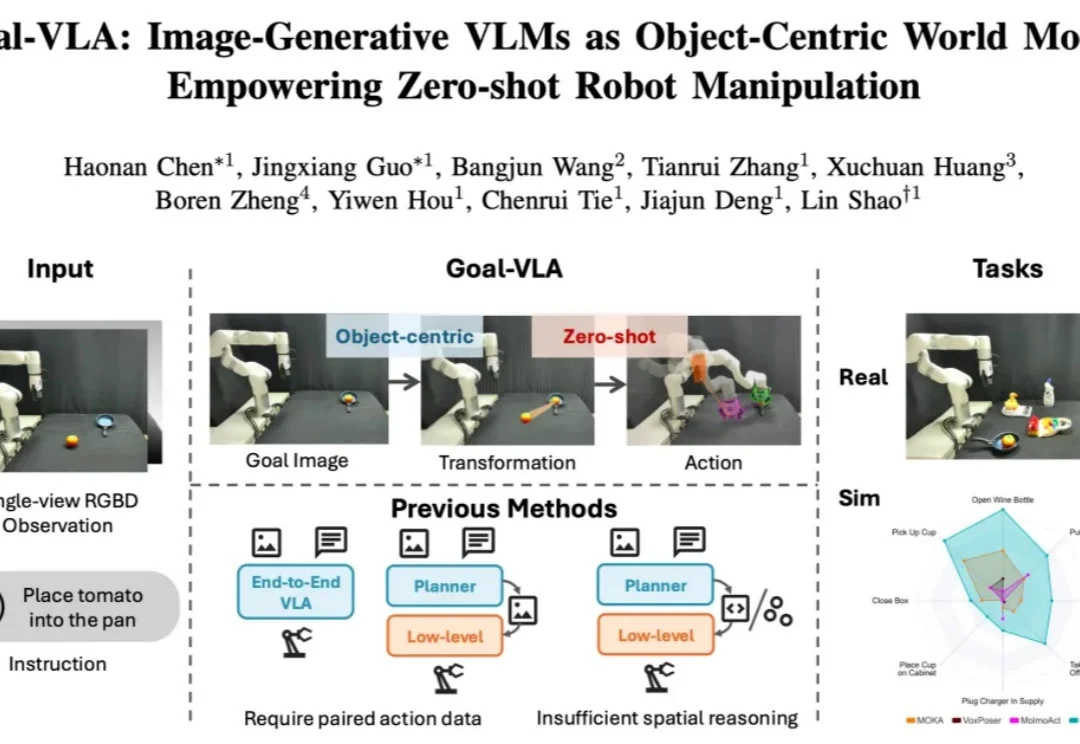

在具身智能领域,机器人操作的泛化能力一直是一个核心挑战。当前,视觉 - 语言 - 动作(VLA)模型主要分为两大范式:端到端模型与分层模型。端到端 VLA 模型(如 RT-2 [1], OpenVLA [2])严重依赖海量的 “指令 - 视觉 - 动作” 成对数据,获取成本极高,导致其在面对新任务或新场景时零样本泛化能力受限。

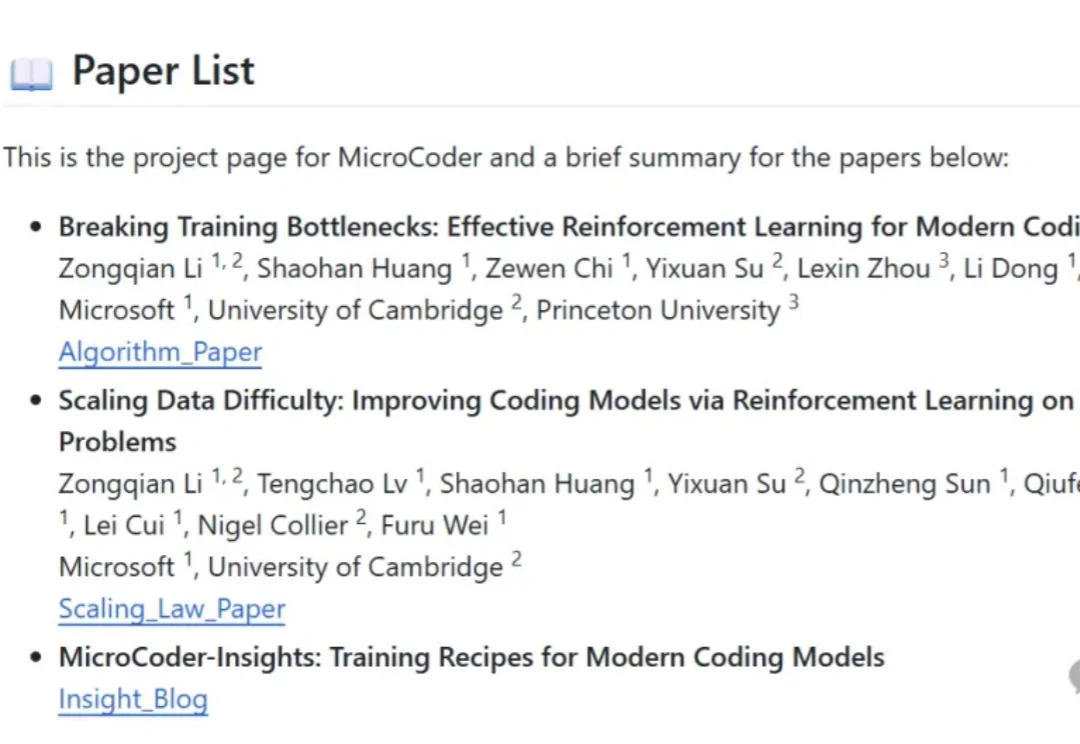

新一代代码模型的训练动态已与旧模型截然不同,主流强化学习方法和数据集在其上几乎“失效”。