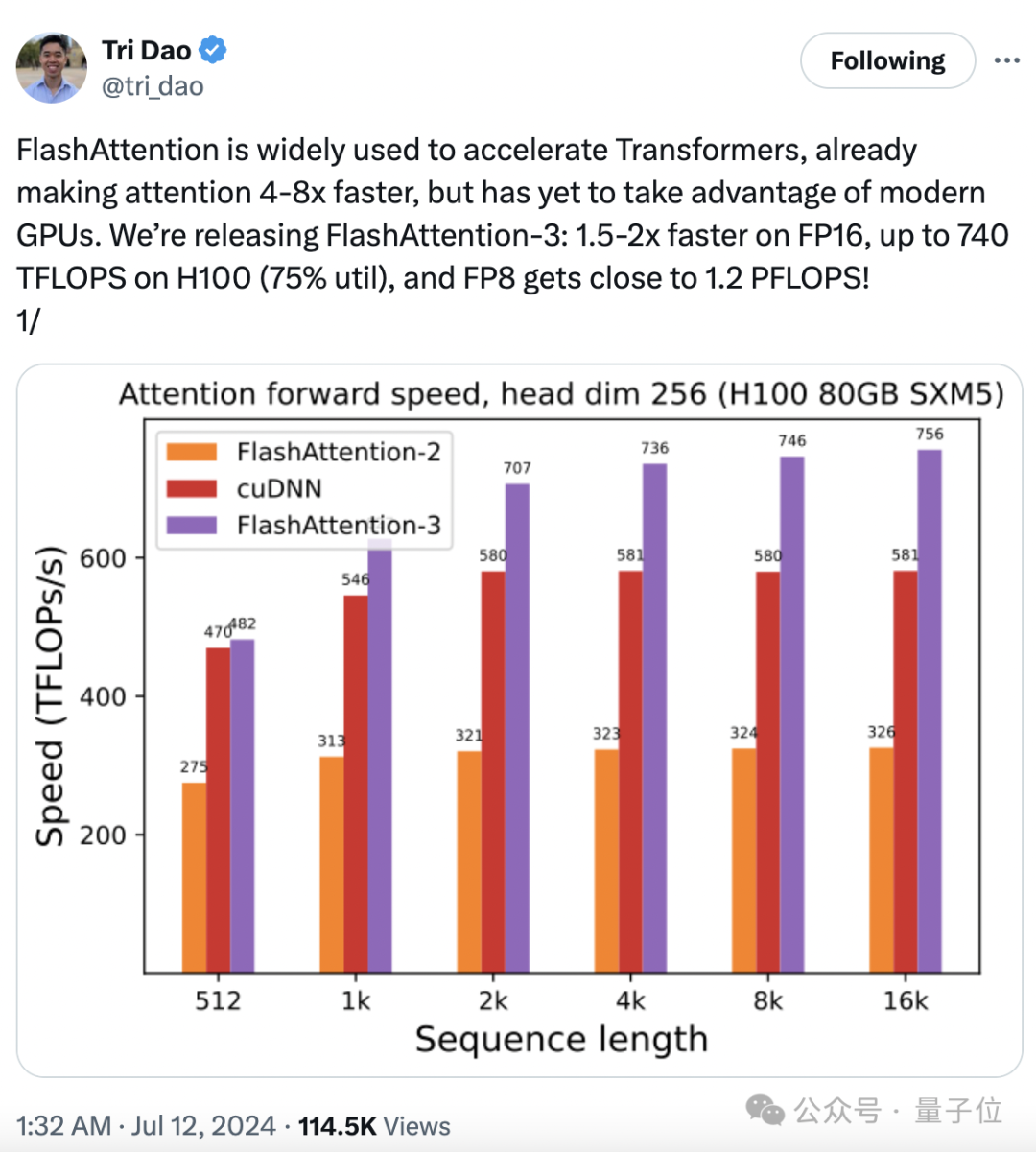

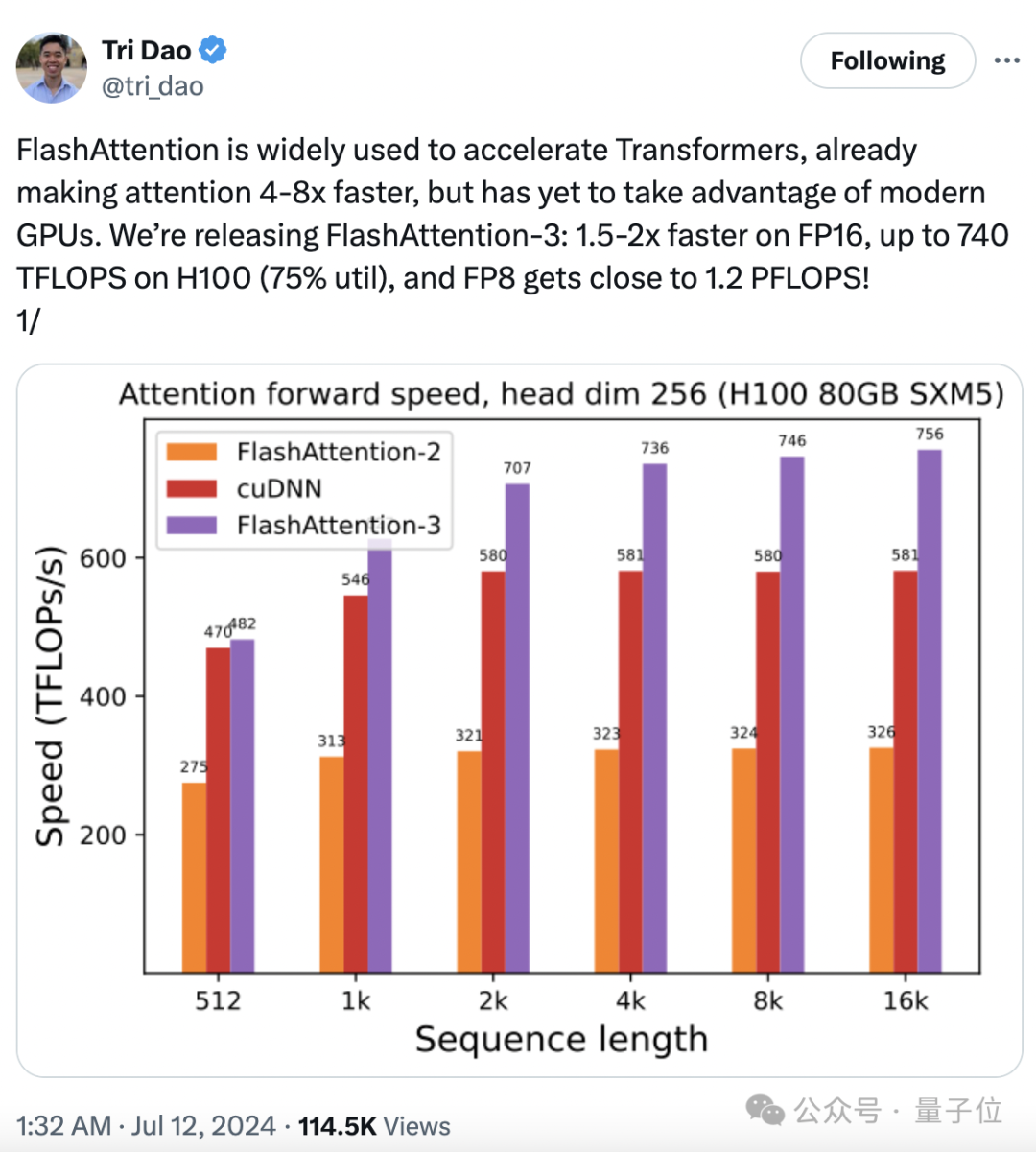

H100利用率飙升至75%!英伟达亲自下场FlashAttention三代升级,比标准注意力快16倍

H100利用率飙升至75%!英伟达亲自下场FlashAttention三代升级,比标准注意力快16倍大模型训练推理神作,又更新了!

来自主题: AI资讯

10715 点击 2024-07-12 15:39

搜索

搜索

大模型训练推理神作,又更新了!

AI算力资源越发紧张的当下,斯坦福新研究将GPU运行效率再提升一波——

Hyena处理长序列输入比FlashAttention速度高100倍!最新发布的StripedHyena模型可能成下一代AI架构的新标准?

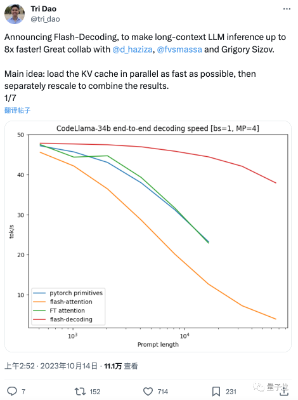

这两天,FlashAttention团队推出了新作: 一种给Transformer架构大模型推理加速的新方法,最高可提速8倍。 该方法尤其造福于长上下文LLM,在64k长度的CodeLlama-34B上通过了验证