GPT-4o「吉卜力风」一夜爆火,奥特曼连夜换头像!宫崎骏痛批AI侮辱生命

GPT-4o「吉卜力风」一夜爆火,奥特曼连夜换头像!宫崎骏痛批AI侮辱生命GPT-4o原生图像一出手,直接登顶流量王座!今天凌晨,OpenAI再放大招更新GPT-4o,冲进大模型排行榜第二碾压Grok 3、GPT-4.5。创意一键生成,Midjourney瞬间黯然失色,设计师开始颤抖吧。

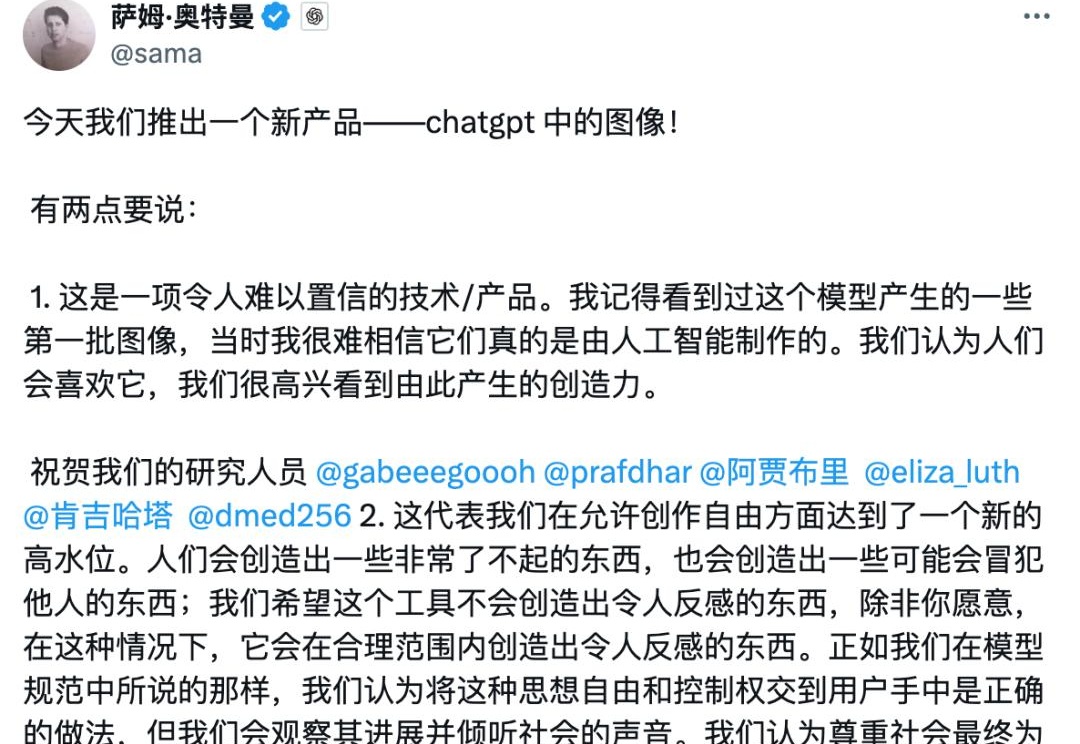

GPT-4o原生图像一出手,直接登顶流量王座!今天凌晨,OpenAI再放大招更新GPT-4o,冲进大模型排行榜第二碾压Grok 3、GPT-4.5。创意一键生成,Midjourney瞬间黯然失色,设计师开始颤抖吧。

GPT4o的多模态生图前天上线之后。经过两天的发酵,含金量还在不断提升。

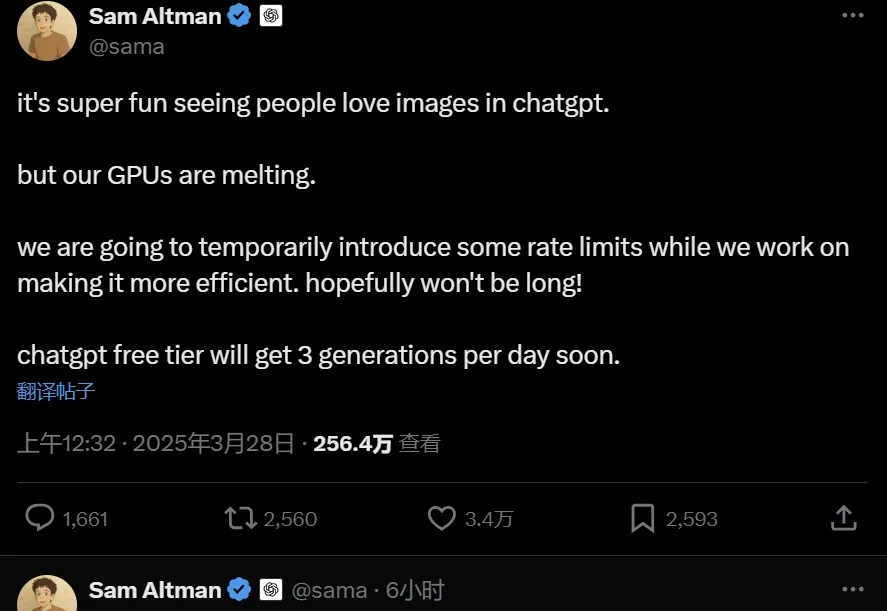

「看到人们喜欢 ChatGPT 中的图片功能真是太有趣了,但是我们的 GPU 正在融化。」

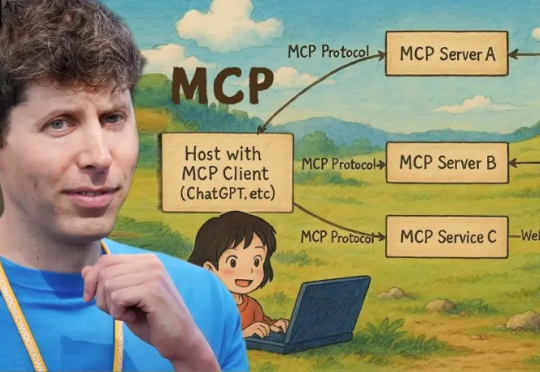

OpenAI昨夜又放大招,Agents SDK接入行业标准MCP,下一步加持ChatGPT桌面版,要彻底颠覆每个人AI工作流。自从昨天OpenAI将GPT-4o的原生图像生成同步开放给免费用户后,今天他们又Open了一把。

OpenAI 又放大招

在ChatGPT上,当你画图的选项变成这个的时候,就说明用的不是Dalle3了,而是4o。目前,有两个渠道可以使用4o Image Generation。一个事ChatGPT,一个是单独的那个Sora的网站。

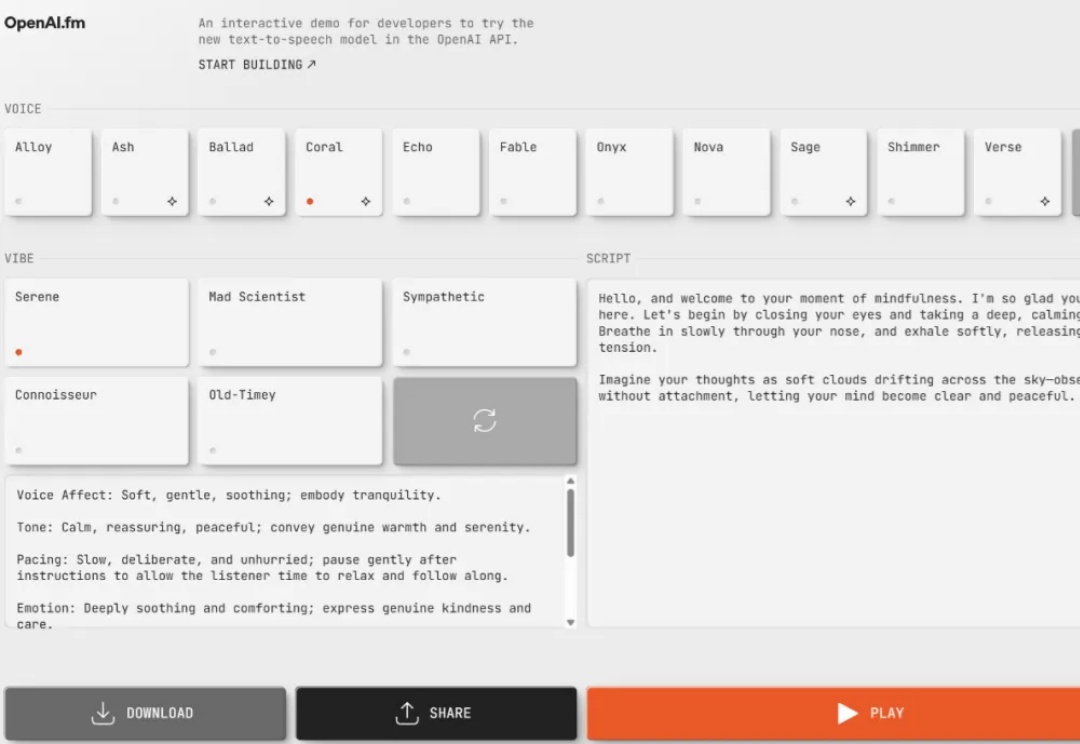

现在,你可以指导 GPT-4o 的说话方式了。

就在刚刚,OpenAI 宣布在其 API 中推出全新一代音频模型,包括语音转文本和文本转语音功能,让开发者能够轻松构建强大的语音 Agent。据 OpenAI 介绍,新推出的 gpt-4o-transcribe 采用多样化、高质量音频数据集进行了长时间的训练,能更好地捕获语音细微差别,减少误识别,大幅提升转录可靠性。

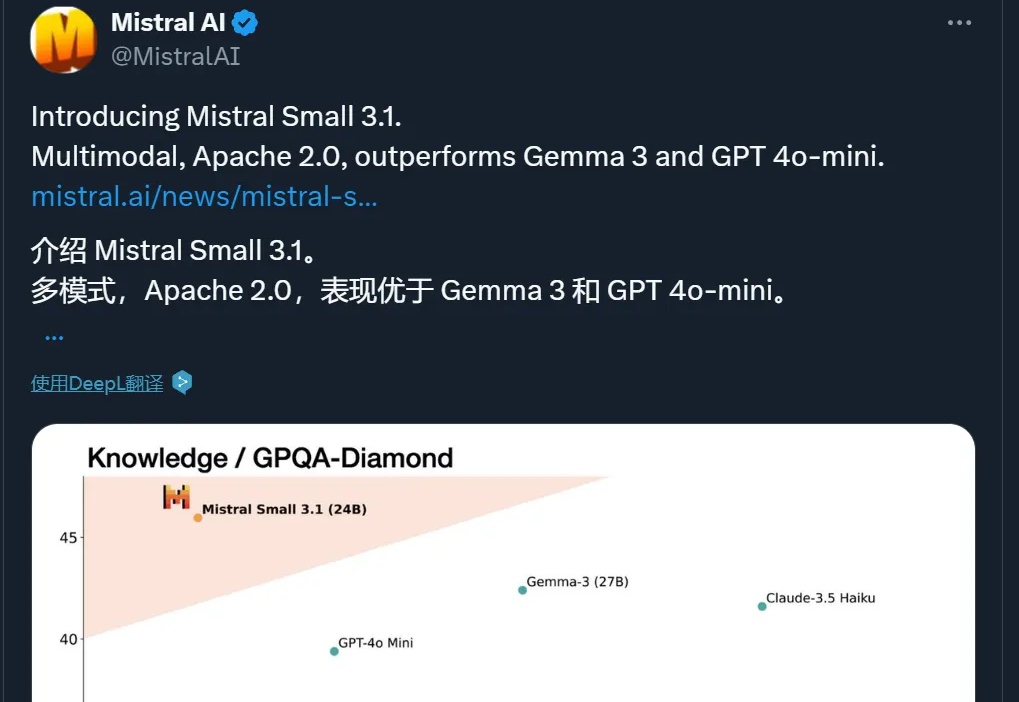

多模态,性能超 GPT-4o Mini、Gemma 3,还能在单个 RTX 4090 上运行,这个小模型值得一试。

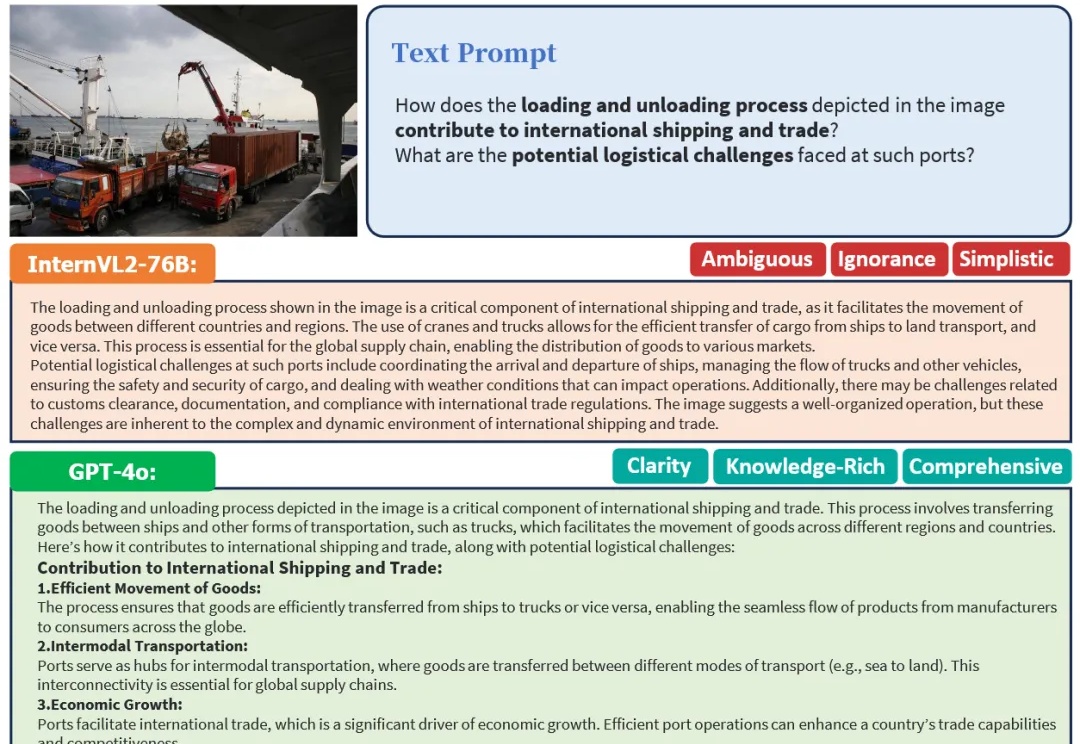

在实际应用过程中,闭源模型(GPT-4o)等在回复的全面性、完备性、美观性等方面展示出了不俗的表现。