平头哥发布首款智能网卡「磐脉 920」,补齐 AI 算力最后一块短板

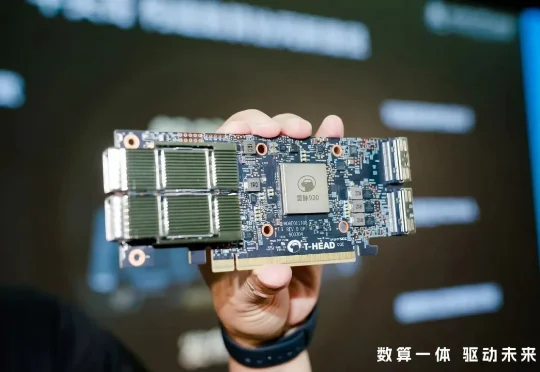

平头哥发布首款智能网卡「磐脉 920」,补齐 AI 算力最后一块短板在数字中国建设峰会上,平头哥发布首款智能网卡磐脉 920。这是国内首个内置 PCIe Switch 的 400G 智能网卡,最大支持 400Gbps 吞吐带宽,可应用于万卡智算集群、通算集群和高性能存储等场景,目前已经量产,并将率先部署在阿里云数据中心。

搜索

搜索

在数字中国建设峰会上,平头哥发布首款智能网卡磐脉 920。这是国内首个内置 PCIe Switch 的 400G 智能网卡,最大支持 400Gbps 吞吐带宽,可应用于万卡智算集群、通算集群和高性能存储等场景,目前已经量产,并将率先部署在阿里云数据中心。

AI行业最刺眼的新成本,正在从GPU变成保镖。奥特曼住宅外的燃烧瓶、老黄身后的安保队伍、特朗普晚宴的枪声,指向同一件事:AI不再只是产品和股价,也开始变成现实世界里的情绪靶心。

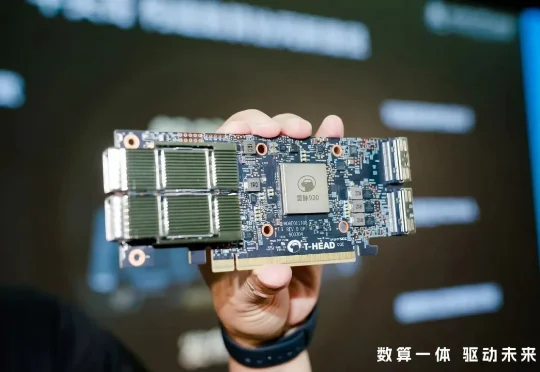

MoE模型的稀疏激活本是优势,却常陷通信瓶颈。NVIDIA以软件为利剑,通过程序化依赖启动和全对全通信革新,在三个月内将GB200的单GPU吞吐提升2.8倍,真正释放Blackwell硬件潜力。

在消耗了无数张 GPU 资源、烧掉了够几座城市用一年的电力之后,OpenAI 最新推出的 AI 生图大模型 GPT-Image-2,再次迎来了它人生中的高光时刻——给人类看手相/面相。

这个人叫 Alex Gerko,今年 46 岁,他是量化交易巨头 XTX Markets 的创始人。早在 ChatGPT 成为全民话题之前,他就已经搭建起一套纯粹以盈利为目的的 AI 交易系统。他在冰岛部署的这台超级计算机,正是 XTX 交易帝国的“算力大脑”。这台机器存储着超过 400 PB(约相当于 80 万亿张高清数码照片)的全球金融市场数据,并驱动着庞大的 GPU 集群。

Cognichip正在构建一个深度学习模型,以便在工程师设计新计算机芯片的过程中为其提供协助。它试图解决的问题是该行业数十年来一直面临的一个难题:芯片设计极其复杂、成本高昂且速度缓慢。先进的芯片从概念设计到大规模生产需要三到五年的时间;仅设计阶段就可能长达两年。想想看,英伟达最新的 GPU 系列Blackwell就包含1040 亿个晶体管——要排列这么多晶体管可不是一件容易的事。

杭州速度,这个词组的含金量还在上升。

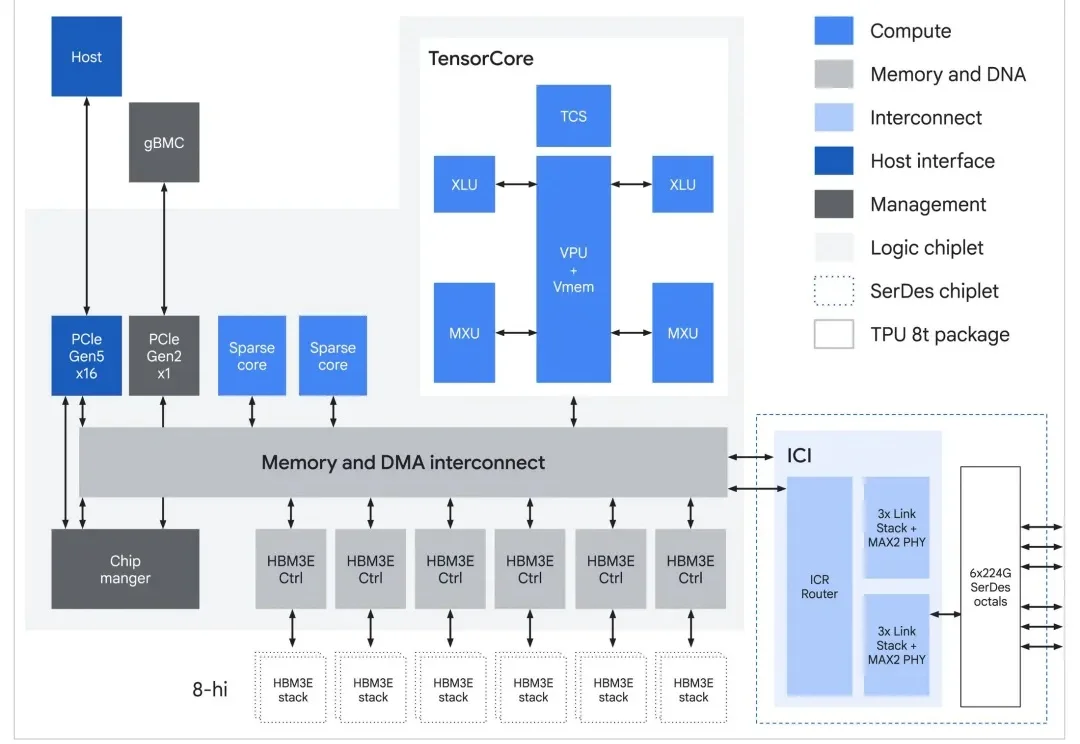

今天,谷歌在 Cloud Next '26 峰会上发布了其第八代 TPU 架构(TPU 8t 与 TPU 8i),TPU 8t 主攻训练,TPU 8i 主攻推理,将在 2026 年晚些时候上市。第八代 TPU 采用申请制,Google Cloud 用户如需使用,需要在官网提交登记需求。

AI算力的VMware时刻:趋动科技与“软件定义GPU”的十年长跑。

如果你是一家连年亏损、销售额腰斩、连线下门店都要全部关停的卖鞋公司,你要怎么做才能让公司股价在一天之内原地起飞,暴涨 700%?答案是停止卖鞋,然后大声喊出那五个拥有起死回生魔力的字母:AI+GPU。