GPT-Image-2 现在最火的玩法:给人看手相,AI 把我夸飘了

GPT-Image-2 现在最火的玩法:给人看手相,AI 把我夸飘了在消耗了无数张 GPU 资源、烧掉了够几座城市用一年的电力之后,OpenAI 最新推出的 AI 生图大模型 GPT-Image-2,再次迎来了它人生中的高光时刻——给人类看手相/面相。

在消耗了无数张 GPU 资源、烧掉了够几座城市用一年的电力之后,OpenAI 最新推出的 AI 生图大模型 GPT-Image-2,再次迎来了它人生中的高光时刻——给人类看手相/面相。

做过 AI 视频的都懂,除了 Seedance 2.0 本身的高定价,废片所烧掉的 token 算力也是一笔不小的开支。但在 Topview 平台,直接把这笔最大试错成本给重新定义了!热门视频生成模型 Seedance 2.0,加上最新的图片生成模型 Image 2,订阅 Ultra Plan,可不限量使用。

允中 发自 凹非寺 量子位 | 公众号 QbitAI 这两天,大家伙朋友圈是不是被GPT-Image-2刷屏了? 文字渲染精准、高密度的信息图,复杂布局和美学UI一次到位,真实感爆棚。 连社交媒体截图

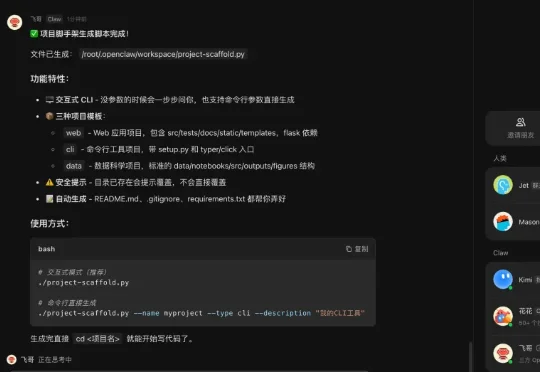

AI第一次从包工头,变成了建筑设计师。

“这是我过去四个月一直在研究的东西!”

GPT Image2全网刷屏,但效果究竟为什么这么好?

这两周国内外的 AI 圈又开始密集更新了。 上周 Anthropic 发了 Opus 4.7,这周 OpenAI 上了 GPT Image 2。国内这边 Kimi 发了 K2.6,腾讯据说也要发一个模

GPT Image 2的横空出世,直接暴打 Nano Banana 2,现在,真假难辨的照片和梗图已经满天飞了。超强的文字渲染和封神的设计能力,直接让它颠覆了众多行业,这一刻起,互联网的信任体系彻底洗牌!

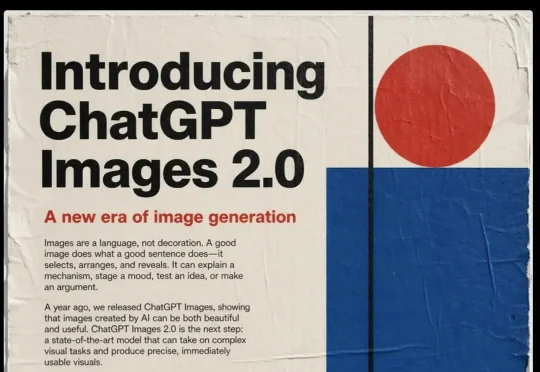

今夜,ChatGPT Images 2.0震撼上线,成为首个「会思考」的图像AI。奥特曼直呼这是从GPT-3到GPT-5的飞跃。它不仅能精准听懂中文指令、渲染复杂UI,甚至能在米粒上刻字。

北京时间凌晨 3 点,直播准时开始,OpenAI 发布了 ChatGPT Images 2.0。据介绍,「ChatGPT Images 2.0 是下一步进化:一个最先进的模型,能够处理复杂的视觉任务,并生成精确、可直接使用的视觉内容。」