无需微调,只靠Prompt,搞定LLM持续学习CL新范式,COLING2025(附提示词)

无需微调,只靠Prompt,搞定LLM持续学习CL新范式,COLING2025(附提示词)未来,掌握持续提示工程技术的开发者,将主导下一代智能系统的进化方向。

未来,掌握持续提示工程技术的开发者,将主导下一代智能系统的进化方向。

新年第一天,陈天奇团队的FlashInfer论文出炉!块稀疏、可组合、可定制、负载均衡......更快的LLM推理技术细节全公开。

对 LLM 来说,Pre-training 的时代已经基本结束了。视频模型的 Scaling Law,瓶颈还很早。具身智能:完全具备人类泛化能力的机器人,在我们这代可能无法实现

今天是个好日子,DeepSeek 与 Kimi 都更新了最新版的推理模型,吸引了广泛关注。与此同时,谷歌 DeepMind、加州大学圣地亚哥分校、阿尔伯塔大学的一篇新的研究论文也吸引了不少眼球,并直接冲上了 Hugging Face 每日论文榜第一(1 月 20 日)。

WaveForms致力于开发音频大模型(LLMs),通过创新的端到端音频处理技术,实现更加实时、类人化且情感智能化的语音交互。与传统语音模型不同,WaveForms的音频模型不是语音转文本再转语音,而是能够直接处理音频,实现更自然的对话和情感互动。

模型蒸馏也有「度」,过度蒸馏,只会导致模型性能下降。最近,来自中科院、北大等多家机构提出全新框架,从两个关键要素去评估和量化蒸馏模型的影响。结果发现,除了豆包、Claude、Gemini之外,大部分开/闭源LLM蒸馏程度过高。

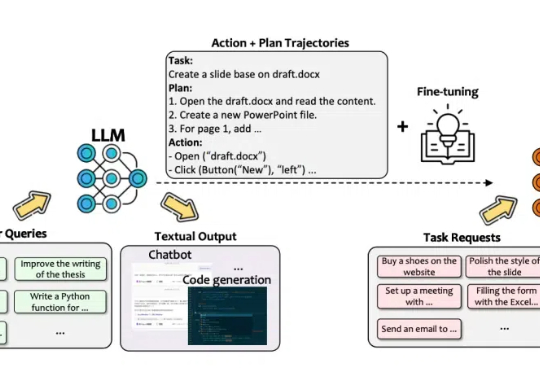

该技术报告的主要作者 Lu Wang, Fangkai Yang, Chaoyun Zhang, Shilin He, Pu Zhao, Si Qin 等均来自 Data, Knowledge, and Intelligence (DKI) 团队,为微软 TaskWeaver, WizardLLM, Windows GUI Agent UFO 的核心开发者。

Grok AI 最近网页版刚刚上线。我看到不少人都在比较 Grok 对标 ChatGPT 等等 LLM 大模型的研究和生成能力。我想说,背靠 X (前推特)数据库的 Grok AI,最好的使用方式难道不是实时监测全球媒体热点吗?

AI编程蓝皮书火了,发布3天,阅读量超过3万!

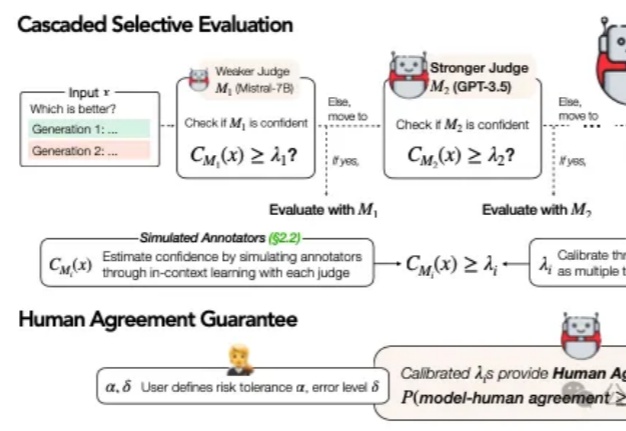

在当今AI技术迅猛发展的背景下,大语言模型(LLM)的评估问题已成为一个不可忽视的挑战。传统的做法是直接采用最强大的模型(如GPT-4)进行评估,这就像让最高法院的大法官直接处理所有交通违章案件一样,既不经济也不一定总能保证公正。